AnyWord-3M

收藏github2024-04-18 更新2024-08-26 收录

下载链接:

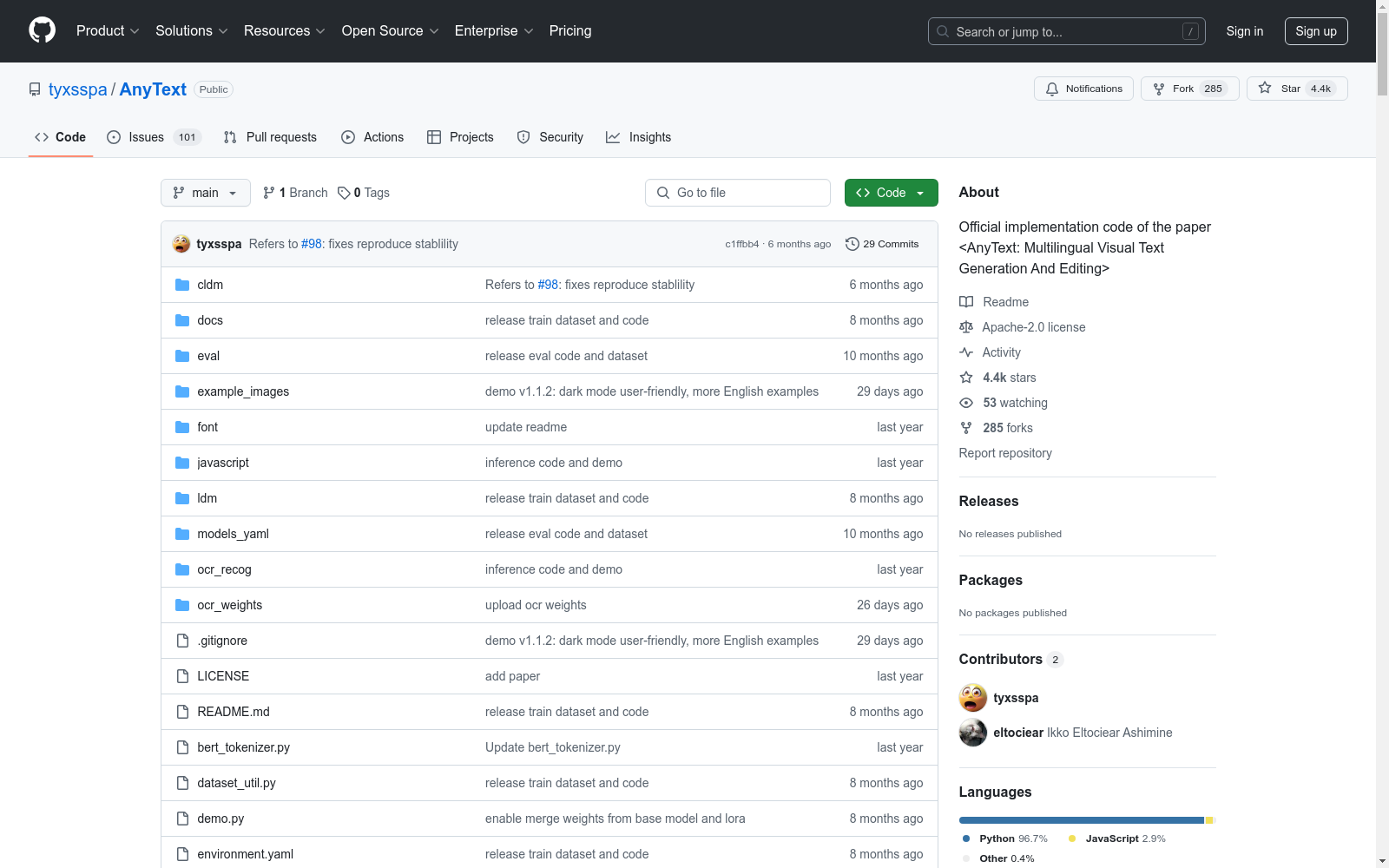

https://github.com/tyxsspa/AnyText

下载链接

链接失效反馈资源简介:

目前,针对文字生成任务的公开数据集尤其是涉及非拉丁语系语言的,还相对缺乏。因此,我们提出了一个大规模多语言数据集AnyWord-3M。数据集中的图片的来源包括Noah-Wukong、LAION-400M以及用于OCR识别任务的数据集,如ArT、COCO-Text、RCTW、LSVT、MLT、MTWI、ReCTS等。这些图片涵盖了包含文本的多种场景,包括街景、书籍封面、广告、海报、电影帧等。除了OCR数据集直接使用标注的信息外,所有其他图片都通过使用PP-OCR的检测和识别模型进行处理。然后,使用BLIP-2生成文本描述。通过严格的过滤规则和细致的后处理,我们共获得了3,034,486张图片,包含超过900万行文本和超过2000万个字符或拉丁文字。此外,我们从Wukong和LAION子集中随机抽取了1000张图片,创建了评估集AnyText-benchmark,专门用于评估中英文生成的准确性和质量。剩余的图片作为训练集AnyWord-3M,其中大约有160万张是中文,139万张是英文,另外还有1万张包含其他语言的图片,包括日语、韩语、阿拉伯语、孟加拉语和印地语。详细的统计分析和随机选取的示例图片,请参考我们的论文AnyText. (注:本次开源的数据集为V1.1版本)

Currently, publicly available datasets for text generation tasks, especially those involving non-Latin script languages, are relatively scarce. To address this gap, we have introduced a large-scale multilingual dataset named AnyWord-3M. The images in this dataset are sourced from Noah-Wukong, LAION-400M, and datasets used for OCR recognition tasks such as ArT, COCO-Text, RCTW, LSVT, MLT, MTWI, and ReCTS. These images cover a variety of scenes containing text, including street views, book covers, advertisements, posters, and movie frames. Apart from the OCR datasets, which utilize directly annotated information, all other images are processed using the detection and recognition models of PP-OCR. Subsequently, text descriptions are generated using BLIP-2. Through rigorous filtering rules and meticulous post-processing, we have obtained a total of 3,034,486 images, encompassing over 9 million lines of text and more than 20 million characters or Latin script. Additionally, we have randomly selected 1000 images from the Wukong and LAION subsets to create an evaluation set, AnyText-benchmark, specifically designed to assess the accuracy and quality of Chinese and English text generation. The remaining images constitute the training set, AnyWord-3M, which includes approximately 1.6 million Chinese images, 1.39 million English images, and an additional 10,000 images featuring other languages such as Japanese, Korean, Arabic, Bengali, and Hindi. For detailed statistical analysis and randomly selected sample images, please refer to our paper AnyText. (Note: The open-sourced dataset is version V1.1)

提供机构:

阿里巴巴

创建时间:

2024-04-18

原始信息汇总

AnyText: 多语言视觉文本生成与编辑数据集概述

数据集基本信息

- 名称: AnyText

- 类型: 多语言视觉文本生成与编辑

- 相关论文: AnyText: Multilingual Visual Text Generation And Editing

- 代码库: GitHub

- 演示平台: ModelScope, HuggingFace

- API服务: DashScope

数据集内容

- AnyWord-3M: 训练数据集,包含多语言文本图像对

- AnyText-benchmark: 评估数据集,包含中英文测试集

数据集特点

- 支持多语言文本生成与编辑

- 包含文本控制扩散损失和文本感知损失

- 提供预训练模型和推理代码

数据集获取

- AnyWord-3M: ModelScope

- AnyText-benchmark: ModelScope 或 GoogleDrive

评估指标

- Sen. ACC: 句子准确率

- NED: 归一化编辑距离

- FID: Fréchet Inception Distance

训练信息

- 硬件要求: 8xA100 (80GB) 或 8xV100 (32GB)

- 训练时间: 约312小时(完整数据集)或60小时(200k图像子集)

- 预训练模型: 基于SD1.5的AnyText预训练模型

引用

bibtex @article{tuo2023anytext, title={AnyText: Multilingual Visual Text Generation And Editing}, author={Yuxiang Tuo and Wangmeng Xiang and Jun-Yan He and Yifeng Geng and Xuansong Xie}, year={2023}, eprint={2311.03054}, archivePrefix={arXiv}, primaryClass={cs.CV} }

AI搜集汇总

数据集介绍

构建方式

AnyWord-3M数据集的构建基于多语言视觉文本生成与编辑的需求,通过整合多种语言的文本字形、位置信息以及掩码图像,生成潜在特征用于文本生成或编辑。该数据集采用了辅助潜在模块和文本嵌入模块相结合的方法,前者利用文本字形、位置和掩码图像生成潜在特征,后者则通过OCR模型将笔画数据编码为嵌入,并与图像标题嵌入融合,以生成与背景无缝融合的文本。训练过程中,采用了文本控制扩散损失和文本感知损失,以提升文本生成的准确性。

特点

AnyWord-3M数据集的主要特点在于其多语言支持和高精度的文本生成能力。该数据集不仅涵盖了多种语言的文本字形和位置信息,还通过先进的OCR技术和文本嵌入模块,实现了文本与背景图像的无缝融合。此外,数据集的构建过程中引入了文本控制扩散损失和文本感知损失,进一步提高了文本生成的准确性和自然度。这些特点使得AnyWord-3M在多语言视觉文本生成与编辑领域具有显著的优势。

使用方法

AnyWord-3M数据集的使用方法包括数据准备、图像生成和评估三个主要步骤。首先,用户需从ModelScope或GoogleDrive下载AnyText-benchmark数据集,并解压文件。接着,根据评估集生成相应的图像,可通过提供的脚本进行图像生成。最后,使用Sentence Accuracy和Normalized Edit Distance评估生成文本的准确性,并通过FID指标评估生成图像的质量。此外,数据集还提供了训练代码,用户可根据需要进行模型训练,以进一步优化文本生成效果。

背景与挑战

背景概述

AnyWord-3M数据集是由阿里巴巴集团的研究团队于2024年发布的,旨在支持多语言视觉文本生成与编辑的研究。该数据集的核心研究问题是如何在图像中生成或编辑多语言文本,使其与背景自然融合。AnyWord-3M的发布标志着在多语言文本生成领域的一次重要突破,为后续研究提供了丰富的资源和基准。主要研究人员包括Yuxiang Tuo、Wangmeng Xiang等,他们的工作在ICLR 2024上获得了Spotlight,展示了该数据集在学术界的影响力。

当前挑战

AnyWord-3M数据集在构建过程中面临了多重挑战。首先,多语言文本的生成与编辑需要处理不同语言的复杂性,包括字符集、字体和排版规则的多样性。其次,确保生成的文本与图像背景无缝融合,需要高精度的图像处理和文本嵌入技术。此外,数据集的构建还涉及大规模数据的收集、标注和验证,确保数据的质量和多样性。这些挑战不仅推动了数据集的开发,也为相关领域的研究提供了新的方向和方法。

常用场景

经典使用场景

在多语言视觉文本生成与编辑领域,AnyWord-3M数据集的经典使用场景主要体现在其对多语言文本生成和编辑任务的支持。该数据集通过丰富的文本和图像对,为研究者提供了一个强大的平台,用于训练和评估多语言文本生成模型。其核心应用包括但不限于:在图像中自动生成或编辑多语言文本,确保生成的文本与背景图像无缝融合,同时保持文本的准确性和视觉美感。

实际应用

在实际应用中,AnyWord-3M数据集的应用场景广泛,涵盖了广告设计、电影字幕生成、社交媒体内容创作等多个领域。例如,广告设计师可以利用该数据集训练的模型,快速生成符合品牌形象的多语言广告文本;电影制作团队则可以通过该数据集,自动生成或编辑电影中的多语言字幕,提升观众的观影体验。此外,社交媒体平台也可以利用该数据集,为用户提供更智能的多语言内容生成和编辑服务。

衍生相关工作

AnyWord-3M数据集的发布,催生了一系列相关经典工作。例如,基于该数据集,研究者们开发了多种多语言文本生成和编辑模型,显著提升了文本生成的质量和效率。同时,该数据集还推动了多语言OCR技术的发展,使得文本识别和生成更加精准。此外,AnyWord-3M还激发了关于文本生成与图像融合的新研究,为视觉文本生成领域带来了新的突破和创新。

以上内容由AI搜集并总结生成