Grounded conversation Generation (GCG)

收藏github2024-11-08 更新2024-11-28 收录

下载链接:

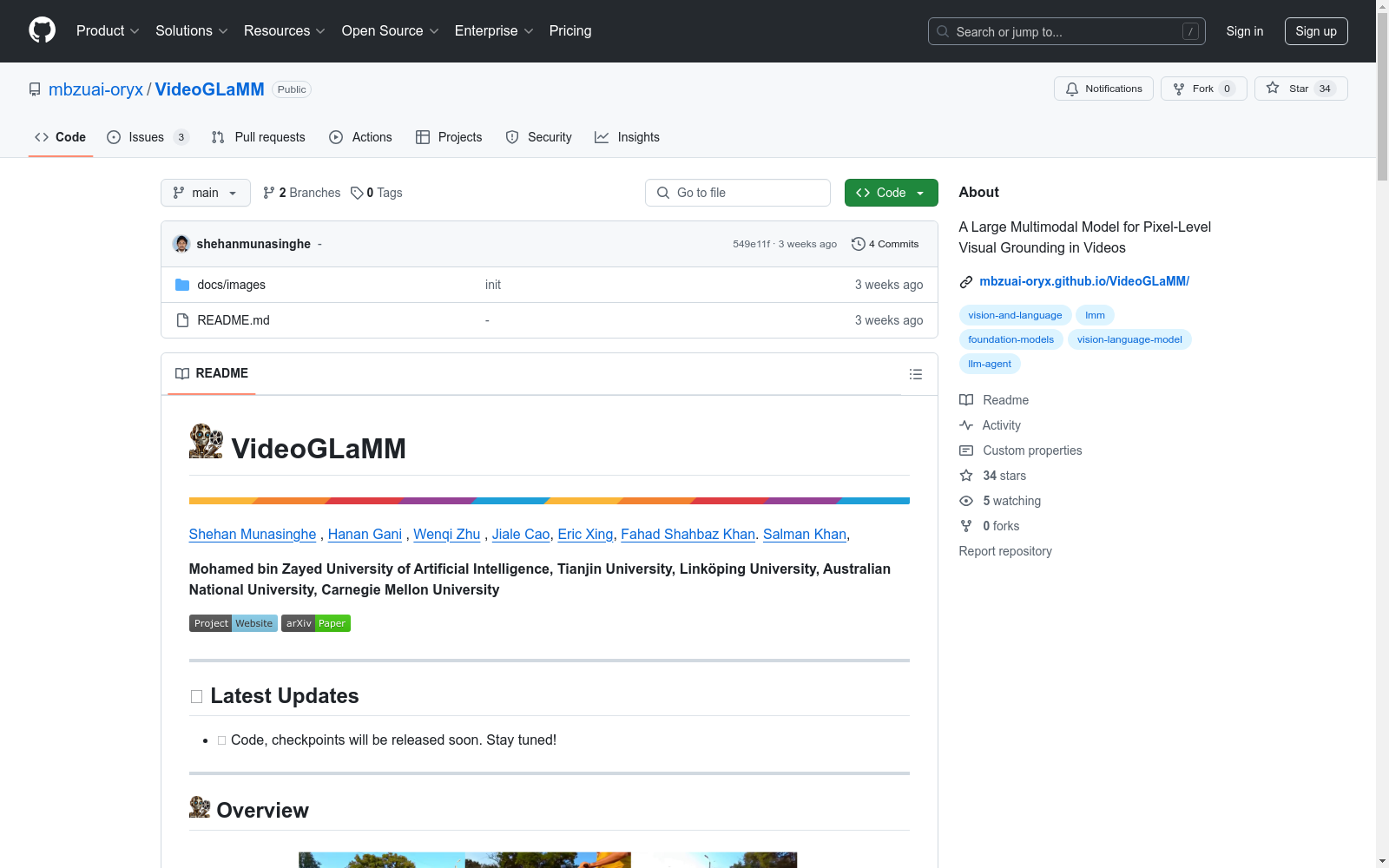

https://github.com/mbzuai-oryx/VideoGLaMM

下载链接

链接失效反馈资源简介:

一个用于视频视觉定位的基准数据集,包含38k个视频问答三元组、87k个对象和大约671k个细粒度的时空掩码。

创建时间:

2024-10-31

原始信息汇总

VideoGLaMM 数据集概述

数据集简介

VideoGLaMM 是一个大规模视频多模态模型,能够进行像素级视觉定位。该模型能够响应用户的自然语言查询,并在其生成的文本响应中交织时空对象掩码,以提供对视频内容的详细理解。VideoGLaMM 由三个关键组件组成:大型语言模型(LLM)、双视觉编码器和时空像素解码器。双视觉编码器分别提取空间和时间特征,这些特征共同传递给 LLM,以输出富含空间和时间线索的响应。

数据集亮点

- 引入了 Video Grounded Large Multi-modal Model (VideoGLaMM),这是一个视频大规模多模态模型,能够进行像素级视觉定位,具有端到端的对齐机制。

- 为了实现细粒度的时空对齐,引入了一个基准数据集 Grounded conversation Generation (GCG),包含 38k 个基于视频的 QA 三元组对、83k 个对象和大约 671k 个细粒度的时空掩码。

- 在基于对话生成、视觉定位和视频分割等多样化任务中评估了 VideoGLaMM 的性能,并取得了最先进的性能。

数据集架构

VideoGLaMM 由以下关键组件组成:

- 时空双编码器

- 双对齐 V-L 适配器,用于图像和视频特征

- 大型语言模型(LLM)

- L-V 适配器

- 可提示的像素解码器

数据集标注流程

提出了一个半自动标注流程,用于创建基于视频的 Grounded conversation Generation (GCG) 数据集。

数据集示例

在给定用户查询的情况下,VideoGLaMM 生成文本响应,并使用像素级掩码定位对象和短语,展示了其对视频内容的详细理解。

引用

bibtex @article{munasinghe2024videoglamm, title={VideoGLaMM: A Large Multimodal Model for Pixel-Level Visual Grounding in Videos}, author={Shehan Munasinghe and Hanan Gani and Wenqi Zhu and Jiale Cao and Eric Xing and Fahad Khan and Salman Khan}, journal={ArXiv}, year={2024}, url={https://arxiv.org/abs/2411.04923} }

AI搜集汇总

数据集介绍

构建方式

在构建Grounded conversation Generation (GCG)数据集时,研究团队采用了一种半自动化的标注流程,旨在生成基于视频的对话生成数据集。该流程结合了大规模视频数据和自然语言查询,通过双视觉编码器提取视频中的时空特征,并与大型语言模型(LLM)相结合,生成包含细粒度时空掩码的文本响应。最终,数据集包含了38,000个视频问答三元组,涉及87,000个对象和671,000个细粒度掩码,为视频内容的像素级视觉定位提供了丰富的数据支持。

特点

GCG数据集的显著特点在于其细粒度的时空对齐能力。通过结合双视觉编码器和大型语言模型,数据集不仅能够处理视频中的空间特征,还能捕捉时间维度上的动态变化。此外,数据集中的每个问答对都附有详细的像素级掩码,使得模型能够精确地定位视频中的对象和场景,从而生成更加准确和丰富的文本响应。这种细粒度的对齐机制使得GCG数据集在视觉定位和对话生成任务中表现出色。

使用方法

使用GCG数据集时,研究者可以利用其丰富的视频问答对和细粒度掩码进行多种任务的训练和评估,包括视觉定位、对话生成和视频分割等。数据集的结构设计使得模型能够同时处理视频的空间和时间特征,从而生成更加自然和准确的文本响应。此外,数据集的半自动化标注流程确保了数据的高质量和一致性,为模型的训练提供了可靠的基础。通过结合大型语言模型和视觉编码器,研究者可以探索更多创新的应用场景,推动视频理解和多模态学习的研究进展。

背景与挑战

背景概述

Grounded conversation Generation (GCG)数据集由Mohamed bin Zayed University of Artificial Intelligence、Tianjin University、Linköping University、Australian National University和Carnegie Mellon University的研究团队共同创建。该数据集旨在支持视频多模态模型VideoGLaMM的训练,该模型能够进行像素级的视觉定位。GCG数据集包含38,000个视频问答三元组,涵盖87,000个对象和671,000个细粒度掩码,为模型提供了丰富的时空对齐信息。这一数据集的开发不仅推动了视觉定位和视频分割等领域的研究,还为多模态对话生成提供了新的基准。

当前挑战

GCG数据集在构建过程中面临多项挑战。首先,生成高质量的细粒度时空掩码需要复杂的标注流程和计算资源。其次,确保视频问答三元组的一致性和准确性,以支持模型的有效训练,是一项艰巨的任务。此外,如何在多模态数据中实现有效的对齐,以提升模型的理解和生成能力,也是一大挑战。这些挑战不仅涉及技术层面的难题,还包括数据集的规模和多样性,以确保其在实际应用中的广泛适用性。

常用场景

经典使用场景

在视频理解和多模态交互领域,Grounded conversation Generation (GCG) 数据集的经典使用场景主要体现在其对视频内容的细粒度视觉定位能力。该数据集通过整合大规模视频数据与自然语言查询,使得模型能够生成包含时空对象掩码的文本响应,从而实现对视频内容的深度解析。这种能力在视频问答系统中尤为突出,模型能够根据用户的自然语言查询,精确地定位视频中的特定对象或事件,并生成与之相关的详细描述。

衍生相关工作

基于 GCG 数据集,研究者们开展了一系列相关工作,推动了视频理解和多模态交互领域的发展。例如,有研究利用该数据集训练了能够进行细粒度视觉定位的模型,这些模型在视频问答和视频分割任务中表现出色。此外,还有研究探索了如何将该数据集应用于跨模态检索,通过结合视觉和语言信息,提升了检索的准确性和效率。这些衍生工作不仅丰富了视频理解的研究内容,也为实际应用提供了强有力的技术支持。

数据集最近研究

最新研究方向

在视频理解和多模态交互领域,Grounded conversation Generation (GCG) 数据集的最新研究方向主要集中在开发能够进行像素级视觉定位的大型多模态视频模型。这类模型不仅能够响应自然语言查询,还能在生成的文本响应中嵌入时空对象掩码,从而提供对视频内容的详细理解。前沿研究致力于通过结合大型语言模型(LLM)、双视觉编码器和时空像素解码器,实现对视频数据的高效处理和精确解析。这些研究不仅推动了视觉基础对话生成、视觉定位和视频分割等任务的性能提升,还为多模态数据融合和交互提供了新的技术路径。

以上内容由AI搜集并总结生成