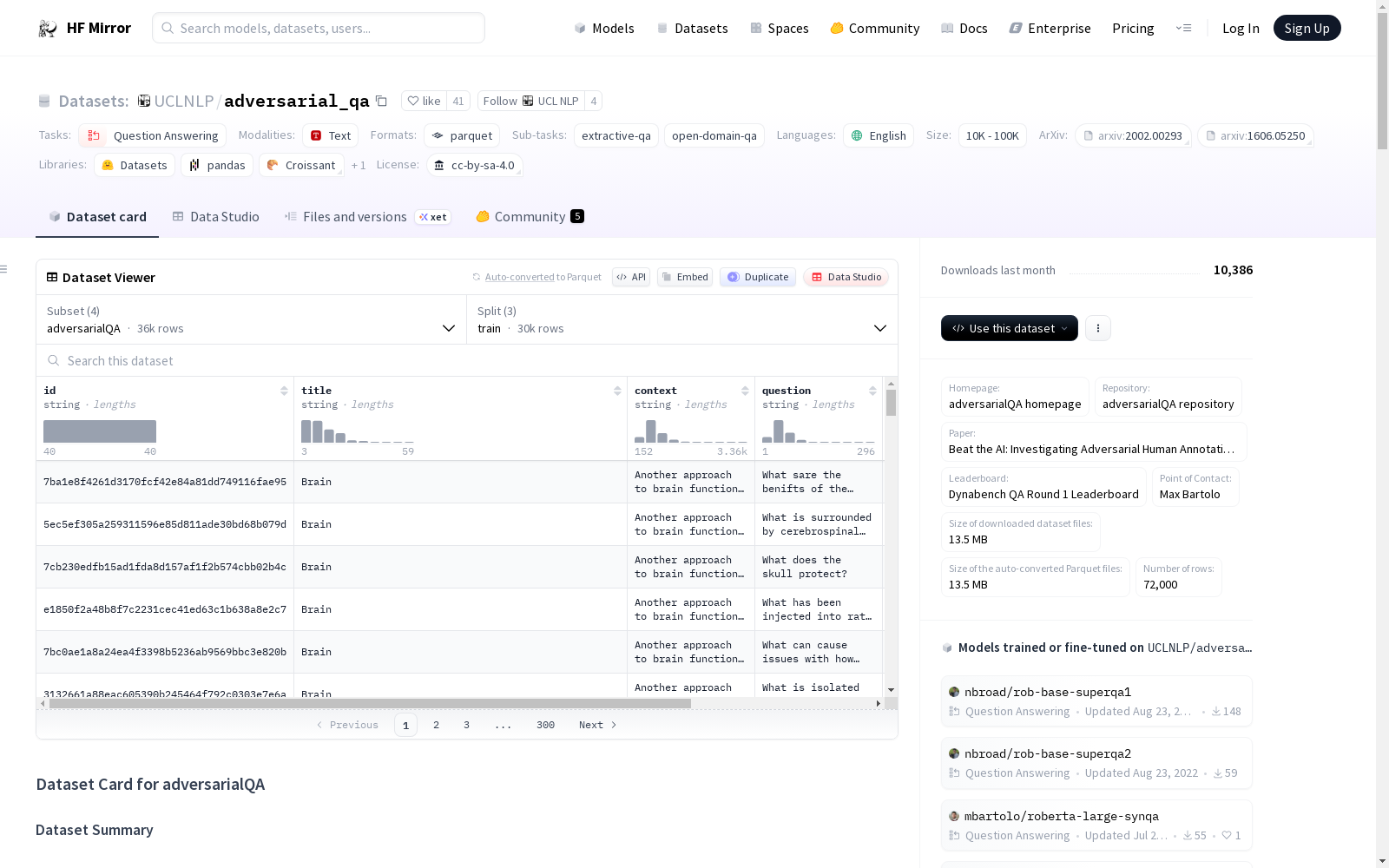

UCLNLP/adversarial_qa

收藏Hugging Face2023-12-21 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/UCLNLP/adversarial_qa

下载链接

链接失效反馈资源简介:

adversarialQA数据集是一个用于阅读理解任务的对抗性问答数据集,旨在挑战当前最先进的模型。数据集包含三个不同的子集,分别使用BiDAF、BERT-Large和RoBERTa-Large模型在注释循环中构建。每个子集包含10,000个训练样本、1,000个验证样本和1,000个测试样本。数据集的文本为英语,来源于Wikipedia,并由Amazon Mechanical Turk上的众包工作者进行注释。数据集的主要任务是从给定的段落中提取问题的答案,通常通过F1分数来衡量模型的性能。

提供机构:

UCLNLP

原始信息汇总

数据集概述

数据集总结

- 名称: adversarialQA

- 语言: 英语 (

en) - 许可证: CC-BY-SA-4.0

- 多语言性: 单语

- 大小: 10K<n<100K

- 来源: 原始数据

- 任务类别: 问答

- 任务ID: extractive-qa, open-domain-qa

- 论文代码ID: adversarialqa

- 预处理配置:

- adversarialQA:

- 特征:

- id: 字符串

- title: 字符串

- context: 字符串

- question: 字符串

- answers: 序列

- text: 字符串

- answer_start: int32

- metadata: 结构

- split: 字符串

- model_in_the_loop: 字符串

- 分割:

- train: 30000 样本, 27858686 字节

- validation: 3000 样本, 2757092 字节

- test: 3000 样本, 2919479 字节

- 下载大小: 5301049 字节

- 数据集大小: 33535257 字节

- 特征:

- dbert:

- 特征: 同上

- 分割:

- train: 10000 样本, 9345521 字节

- validation: 1000 样本, 918156 字节

- test: 1000 样本, 971290 字节

- 下载大小: 2689032 字节

- 数据集大小: 11234967 字节

- dbidaf:

- 特征: 同上

- 分割:

- train: 10000 样本, 9282482 字节

- validation: 1000 样本, 917907 字节

- test: 1000 样本, 946947 字节

- 下载大小: 2721341 字节

- 数据集大小: 11147336 字节

- droberta:

- 特征: 同上

- 分割:

- train: 10000 样本, 9270683 字节

- validation: 1000 样本, 925029 字节

- test: 1000 样本, 1005242 字节

- 下载大小: 2815452 字节

- 数据集大小: 11200954 字节

- adversarialQA:

支持的任务和排行榜

- 任务: 抽取式问答 (

extractive-qa) - 评估指标: F1 分数

- 当前最佳模型: RoBERTa-Large, 64.35% F1

- 排行榜: Dynabench QA Round 1 Leaderboard

数据集结构

- 数据实例: 遵循 SQuAD 1.1 格式

- 数据字段:

- title: 文章标题

- context: 文章内容

- id: 问题唯一标识

- answers: 答案列表,包含 text 和 answer_start

- 数据分割:

- 使用不同模型(BiDAF, BERT-Large, RoBERTa-Large)构建的三个数据集,每个数据集包含 10,000 训练样本,1,000 验证样本,1,000 测试样本

数据集创建

- 注释过程: 通过对抗性人类注释过程收集,人类注释者和阅读理解模型在交互设置中配对

- 注释者: 来自 Amazon Mechanical Turk,地理限制在美国、英国和加拿大,具有高 HIT 批准率

使用数据的考虑

- 社会影响: 旨在帮助开发更好的问答系统

- 偏见讨论: 数据集可能展示源文章选择、注释问题和答案以及算法偏见

附加信息

- 数据集创建者: Max Bartolo, Alastair Roberts, Johannes Welbl, Sebastian Riedel, Pontus Stenetorp

- 贡献者: @maxbartolo

搜集汇总

数据集介绍

构建方式

在机器阅读理解领域,对抗性数据集的构建旨在挑战现有模型的极限。AdversarialQA采用了一种创新的模型在环标注范式,通过将人类标注者与三种前沿模型——BiDAF、BERT-Large和RoBERTa-Large——置于交互式对抗环境中。标注者基于维基百科段落撰写问题并标注答案,若模型未能正确回答,则问题被采纳;否则标注者需修改问题直至模型失效。这一过程通过亚马逊众包平台实施,标注者需满足严格的资质要求,确保了数据质量与对抗性。

特点

AdversarialQA的核心特征在于其对抗性本质,所包含的问题均针对特定模型设计,旨在暴露模型在复杂推理与深层语义理解上的薄弱环节。数据集包含三个独立子集,分别对应不同模型在环标注的结果,每个子集提供一万条训练样本及千条验证与测试样本,总计三万六千条数据。数据格式与SQuAD 1.1兼容,涵盖标题、上下文、问题及答案起始位置与文本,且测试集答案未公开,以支持动态基准评估。

使用方法

该数据集主要用于抽取式问答任务的训练与评估,研究者可借助其对抗性样本提升模型的鲁棒性与泛化能力。使用时可加载特定配置(如dbert、dbidaf或droberta),按照标准分割进行训练与验证,并利用F1分数等指标衡量性能。数据集已集成于HuggingFace平台,支持便捷的API调用,同时可通过Dynabench平台提交测试集预测以参与公开排行榜竞争,推动模型在挑战性场景下的持续优化。

背景与挑战

背景概述

在机器阅读理解领域,随着深度学习模型的迅猛发展,传统数据集如SQuAD已难以充分评估模型的鲁棒性与深层理解能力。为此,伦敦大学学院自然语言处理团队于2020年推出了AdversarialQA数据集,其核心研究问题在于通过对抗性标注范式,构建能够挑战当时最先进模型的阅读理解样本。该数据集采用模型在环的人机协作标注策略,利用BiDAF、BERT-Large与RoBERTa-Large三种模型作为对抗方,引导标注者设计模型难以正确回答的问题。这一创新方法不仅推动了对抗性机器学习在自然语言处理中的应用,也为评估模型在复杂语义推理与上下文理解方面的极限提供了重要基准。

当前挑战

AdversarialQA数据集旨在解决机器阅读理解中模型鲁棒性不足的领域挑战,其问题设计刻意规避了模型的表面模式匹配能力,迫使模型进行更深层次的语义分析与逻辑推理。在构建过程中,主要挑战体现在对抗性标注流程的设计与实施:如何确保标注者与模型之间的有效互动,以生成既符合自然语言规范又能精准暴露模型弱点的样本;同时,需平衡标注效率与问题质量,避免因模型迭代过快导致标注成本激增。此外,数据集的多样性受限于初始文本来源(如维基百科),可能无法全面覆盖现实场景中的语言现象与领域知识。

常用场景

经典使用场景

在机器阅读理解领域,对抗性问答数据集被广泛用于评估和提升模型在复杂问题上的推理能力。该数据集通过对抗性标注机制构建,其经典使用场景在于训练模型应对那些经过精心设计、旨在挑战现有模型性能的问题。研究者通常利用该数据集对抽取式问答模型进行微调,以检验模型在理解上下文、处理语义歧义及进行多步推理方面的稳健性。这种对抗性训练范式有助于揭示模型在自然语言理解任务中的潜在弱点,并推动模型向更鲁棒的方向演进。

解决学术问题

该数据集主要解决了机器阅读理解研究中模型泛化能力不足及对对抗性样本脆弱性的问题。传统数据集如SQuAD中的问题往往与上下文存在较高的词汇重叠,导致模型可能依赖表面线索而非深层理解。对抗性QA通过引入模型在环的标注流程,生成了大量需要真正理解语义和逻辑关系才能正确回答的问题。这促使研究社区关注模型的内在推理机制,推动了针对对抗性攻击的防御方法、领域自适应以及零样本泛化等关键学术方向的发展,显著提升了问答系统的理论深度与应用边界。

衍生相关工作

该数据集催生了一系列围绕对抗性训练与模型鲁棒性提升的经典研究工作。例如,许多研究借鉴其对抗性标注思想,扩展到其他自然语言处理任务如文本分类和自然语言推理,创建了类似的对抗性基准。在模型架构方面,针对该数据集挑战而设计的增强型Transformer变体、融合外部知识的模型以及多任务学习框架相继涌现。同时,该数据集也是Dynabench动态基准平台的重要组成部分,激励社区持续开发能适应不断进化对抗性样本的下一代问答模型,形成了模型评估与迭代创新的良性循环。

以上内容由遇见数据集搜集并总结生成