L4NLP/LEval

收藏Hugging Face2023-10-11 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/L4NLP/LEval

下载链接

链接失效反馈资源简介:

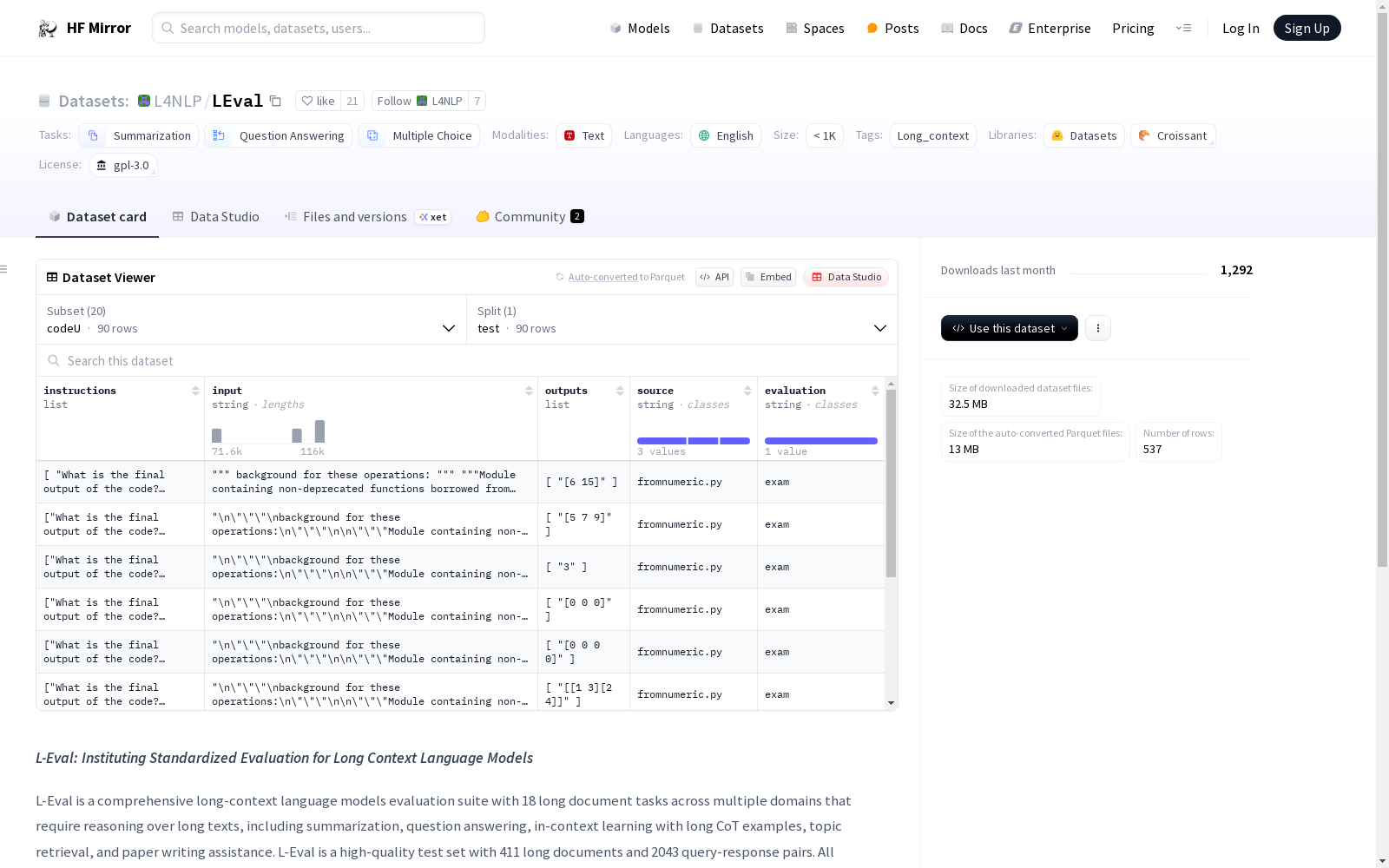

L-Eval是一个用于评估长上下文语言模型的综合测试套件,包含18个长文档任务,涵盖多个领域,需要对这些长文本进行推理。数据集包含411个长文档和2043个查询-响应对,所有样本都经过作者的手动注释和检查。L-Eval旨在帮助研究人员和开发者跟踪长上下文语言模型的进展,并理解不同方法的优缺点。

L-Eval is a comprehensive test suite for evaluating long-context language models. It includes 18 long-document tasks spanning multiple domains, which require reasoning over lengthy texts. The dataset consists of 411 long documents and 2043 query-response pairs, with all samples manually annotated and verified by the authors. L-Eval aims to assist researchers and developers in tracking the progress of long-context language models and understanding the strengths and weaknesses of different approaches.

提供机构:

L4NLP

原始信息汇总

数据集概述

基本信息

- 许可证: GPL-3.0

- 任务类别:

- 总结

- 问答

- 多选题

- 语言: 英语

- 数据集大小: 1K<n<10K

- 预览: 可用

- 标签: 长上下文

数据集详情

- 名称: L-Eval

- 描述: L-Eval是一个用于评估长上下文语言模型的综合测试集,包含18个跨多个领域的长文档任务,涉及总结、问答、上下文学习、主题检索和论文写作辅助等。该数据集包含411个长文档和2043个查询-响应对,所有样本均由作者手动标注和检查。

- 目的: 帮助研究人员和开发者追踪长上下文语言模型的进展,并理解不同方法的优缺点。

数据集列表

- coursera

- gsm100

- quality

- topic_retrieval_longchat

- tpo

- financial_qa

- gov_report_summ

- legal_contract_qa

- meeting_summ

- multidoc_qa

- narrative_qa

- natural_question

- news_summ

- paper_assistant

- patent_summ

- review_summ

- scientific_qa

- tv_show_summ

搜集汇总

数据集介绍

构建方式

L4NLP/LEval数据集的构建旨在评估长文本语境下的语言模型性能。该数据集涵盖了18个长文档任务,跨越多个领域,如总结、问答、长上下文学习等。数据集包含了411个长文档和2043个查询-响应对,所有样本均经过人工标注和审核,确保了数据的高质量。

特点

L4NLP/LEval数据集的特点在于其专注于长文本语境的语言模型评估,提供了丰富的任务类型,包括但不限于长文本总结、长文本问答等。其数据来源多样,涵盖了教育、金融、政府报告等多个领域,为研究者和开发者提供了全面的语言模型性能评估资源。

使用方法

使用L4NLP/LEval数据集时,用户可以从提供的详细描述和数据收集方式中获取指导。数据集支持多种任务类别,如摘要、问答等,用户可根据具体研究需求选择相应的任务数据。此外,数据集的开放性和标准化评估方法使得其易于集成到现有的语言模型评估框架中。

背景与挑战

背景概述

L4NLP/LEval数据集,作为一项旨在评估长文本语境下语言模型性能的研究成果,由L4NLP团队精心构建。该数据集诞生于近年来对长文本语境下推理能力的需求日益增长之际,涵盖了总结、问答、长文本上下文学习、主题检索以及论文写作辅助等18项任务,跨越多个领域。数据集包含了411篇长文档和2043个查询-响应对,全部经过人工标注与审核,确保了数据的高质量。LEval的创建,不仅为研究人员和开发者提供了一个跟踪长语境语言模型(LCLMs)进展的工具,也助力于理解不同方法的优势与不足,对自然语言处理领域产生了显著影响。

当前挑战

LEval数据集面临的挑战主要在于两个方面:一是评估长文本语境下语言模型在下游任务中的表现,这些任务需要模型具备较强的推理能力,对模型的性能提出了更高的要求;二是构建过程中,如何确保数据质量,特别是长文档的标注和查询-响应对的匹配,这要求研究人员在数据收集和预处理阶段投入大量的时间和精力。此外,随着长语境语言模型的不断进步,如何更新和扩展数据集,以适应新的模型性能,也是一项持续的挑战。

常用场景

经典使用场景

在当前自然语言处理领域,L4NLP/LEval数据集以其全面覆盖长文本推理任务的特点,成为评估长文本语言模型性能的重要资源。该数据集包含十八项任务,如长文本摘要、问题回答、长上下文学习等,均围绕长文档的推理进行。研究人员和开发者通过该数据集,可以精确地测试和比较不同模型在处理长文本时的性能差异,进而指导模型优化与改进。

解决学术问题

L4NLP/LEval数据集解决了传统数据集在长文本处理能力评估上的不足,为学术研究提供了标准化的评测手段。它使得研究者能够深入理解长文本语言模型在多个领域的表现,识别不同方法的优势与不足,从而推动长文本处理技术的发展。该数据集的引入,对于提升模型在真实世界任务中的适应性具有重大意义。

衍生相关工作

基于L4NLP/LEval数据集的研究成果,衍生出了众多经典工作。学者们通过该数据集开展了一系列关于长文本语言模型性能评估的研究,发表了多篇具有影响力的论文。此外,该数据集还促进了相关评测工具和模型的开发,为长文本处理领域的研究提供了丰富的资源和工具。

以上内容由遇见数据集搜集并总结生成