MBZUAI/LaMini-instruction

收藏Hugging Face2023-04-30 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/MBZUAI/LaMini-instruction

下载链接

链接失效反馈资源简介:

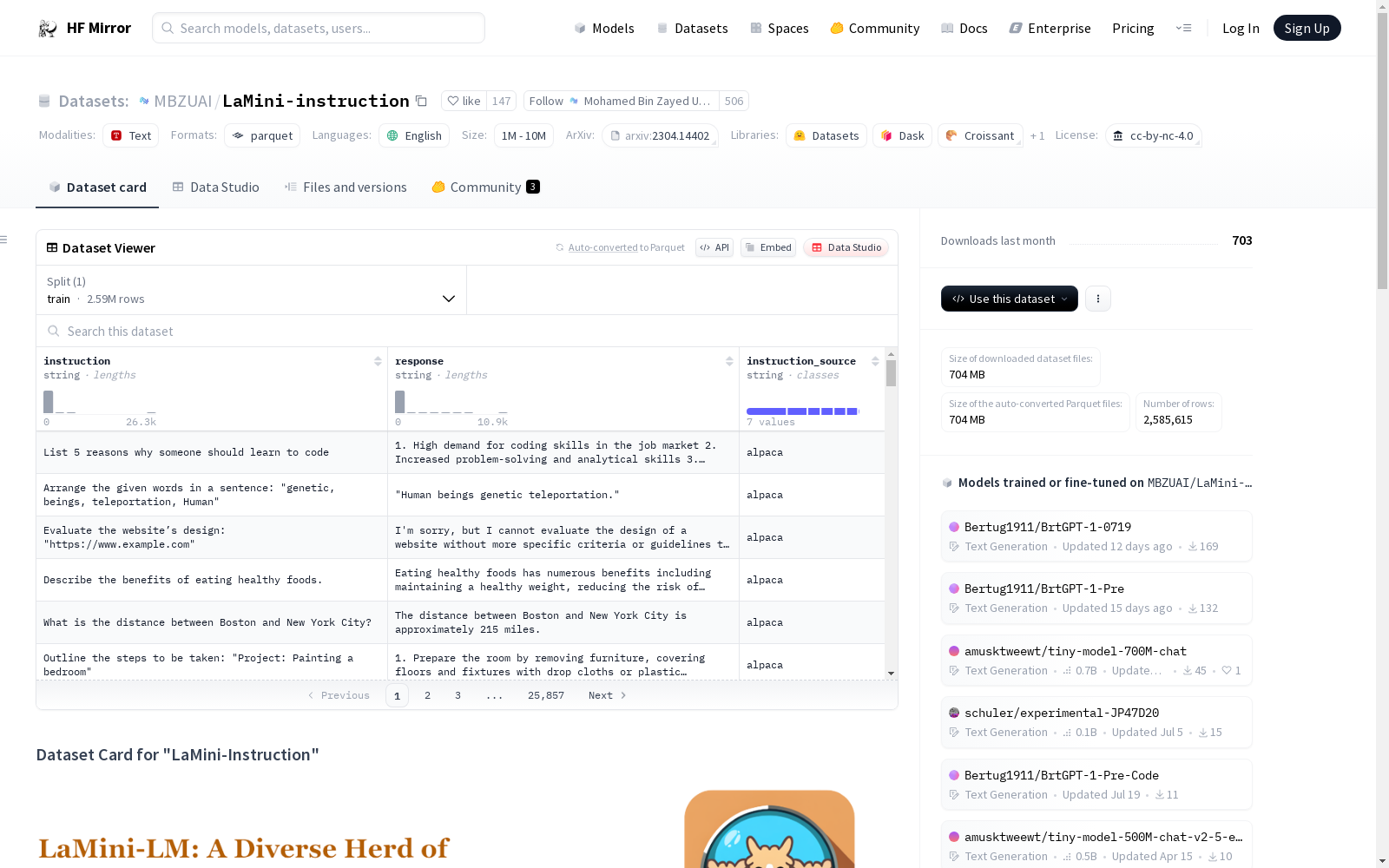

LaMini-Instruction数据集通过从大型语言模型中提取知识,使用gpt-3.5-turbo生成了258万对指令和响应。每个样本包含指令、响应和指令来源三个字段。指令字段描述了模型需要执行的任务,响应字段是gpt-3.5-turbo生成的响应,指令来源字段指示了指令的来源。数据集用于微调小型语言模型,并指出数据集中可能包含的错误和偏见。

提供机构:

MBZUAI

原始信息汇总

数据集概述

数据集名称: LaMini-Instruction

许可证: Creative Commons NonCommercial (CC BY-NC 4.0)

任务类别: text2text-generation

语言: English

数据集大小: 1M<n<10M

数据集结构

数据字段

- instruction: 字符串类型,描述模型预期执行的任务。

- response: 字符串类型,由

gpt-3.5-turbo生成的指令响应。 - instruction_source: 字符串类型,指令的来源,可能的值包括

{alpaca, generated_flan, generated_p3, original_flan, original_p3, self_instruct_with_topic, self_instruct_without_topic}。

数据分割

- 训练集: 包含2585615个实例,总字节数为1162632572。

数据集使用注意事项

- 数据集的输出是从ChatGPT中提炼的,因此包含ChatGPT产生的错误和偏见。使用此数据集训练的模型将继承这些错误和偏见。建议用户谨慎使用此数据,并提出新的方法来过滤或改进这些不完美之处。

数据集生成

- 数据集通过执行句子/离线提炼(Kim和Rush, 2016)生成,共生成2.58M对指令和响应,使用

gpt-3.5-turbo基于多个现有的提示资源。 - 用于微调各种小型语言模型,形成LaMini-LM模型系列。

搜集汇总

数据集介绍

构建方式

MBZUAI/LaMini-instruction数据集通过句级/离线蒸馏的方式,从大型语言模型中提炼知识。该数据集由2.58M对指令与响应组成,基于多个现有提示资源的指令,使用gpt-3.5-turbo生成响应。这些资源包括self-instruct、P3、FLAN和Alpaca等。数据集构建过程中,详细生成方式可参考相关论文。

特点

该数据集的特点在于,其指令与响应对是从先进的大型语言模型中蒸馏而得,具有多样化的来源,包括Alpaca、FLAN、P3等。每一条样本包含三个字段:指令、响应和指令来源。这使得数据集不仅适用于模型微调,也方便对模型在不同来源指令上的表现进行分析。

使用方法

使用该数据集时,用户需注意数据中可能存在的错误和偏见,这些是源自ChatGPT的输出。在训练模型时,应谨慎使用,并考虑采用新方法来过滤或改善这些不完美之处。数据集遵循Creative Commons NonCommercial (CC BY-NC 4.0)许可,使用时请遵循相关条款并正确引用。

背景与挑战

背景概述

MBZUAI/LaMini-instruction数据集是在自然语言处理领域,特别是在指令微调任务背景下创建的。该数据集由Minghao Wu、Abdul Waheed、Chiyu Zhang、Muhammad Abdul-Mageed和Alham Fikri Aji等研究人员于2023年开发,旨在通过句式/离线蒸馏方法从大型语言模型中提取知识。数据集包含2.58M对指令与响应,这些指令与响应是基于多个现有提示资源使用gpt-3.5-turbo生成的。该数据集的构建不仅丰富了指令微调任务的数据资源,而且推动了小型语言模型微调技术的发展,对自然语言处理领域产生了显著影响。

当前挑战

尽管MBZUAI/LaMini-instruction数据集为研究领域提供了宝贵的资源,但在使用过程中也面临一些挑战。首先,数据集的输出来源于ChatGPT,因此可能包含由ChatGPT产生的错误和偏见,这可能导致训练出的模型继承这些不完美之处。其次,构建过程中确保指令与响应的质量和相关性是一个挑战,尤其是在处理大量数据时。使用该数据集时,研究人员需谨慎对待,并探索新的方法来过滤或改进数据集中的不完善之处。

常用场景

经典使用场景

在自然语言处理领域,MBZUAI/LaMini-instruction数据集的应用可谓至关重要。该数据集通过提炼大规模语言模型的知识,形成了指令与响应的对,被广泛用于微调小型语言模型,进而提升其理解和生成能力。

衍生相关工作

MBZUAI/LaMini-instruction数据集衍生了包括LaMini-LM模型系列在内的一系列相关工作。这些工作不仅推动了小型语言模型的发展,也为自然语言处理领域的深入研究提供了新的视角和工具。

数据集最近研究

最新研究方向

在自然语言处理领域,MBZUAI/LaMini-instruction数据集的构建与运用,标志着对大规模语言模型知识的提炼与小型化模型微调的深入探索。该数据集通过句级/离线蒸馏方法从大型语言模型中提取知识,进而生成指令与响应对,以服务于多样化的小型语言模型微调任务。当前,该数据集正被广泛应用于提升小型语言模型在遵循指令方面的性能,其研究成果体现在LaMini-LM模型系列中。该数据集的推出,不仅促进了小型化、高效率的语言模型的发展,也为模型在遵循复杂指令时的准确性提供了新的研究方向,对于自然语言处理领域的模型压缩和性能优化具有重要意义。

以上内容由遇见数据集搜集并总结生成