HALoGEN

收藏github2025-01-30 更新2025-02-10 收录

下载链接:

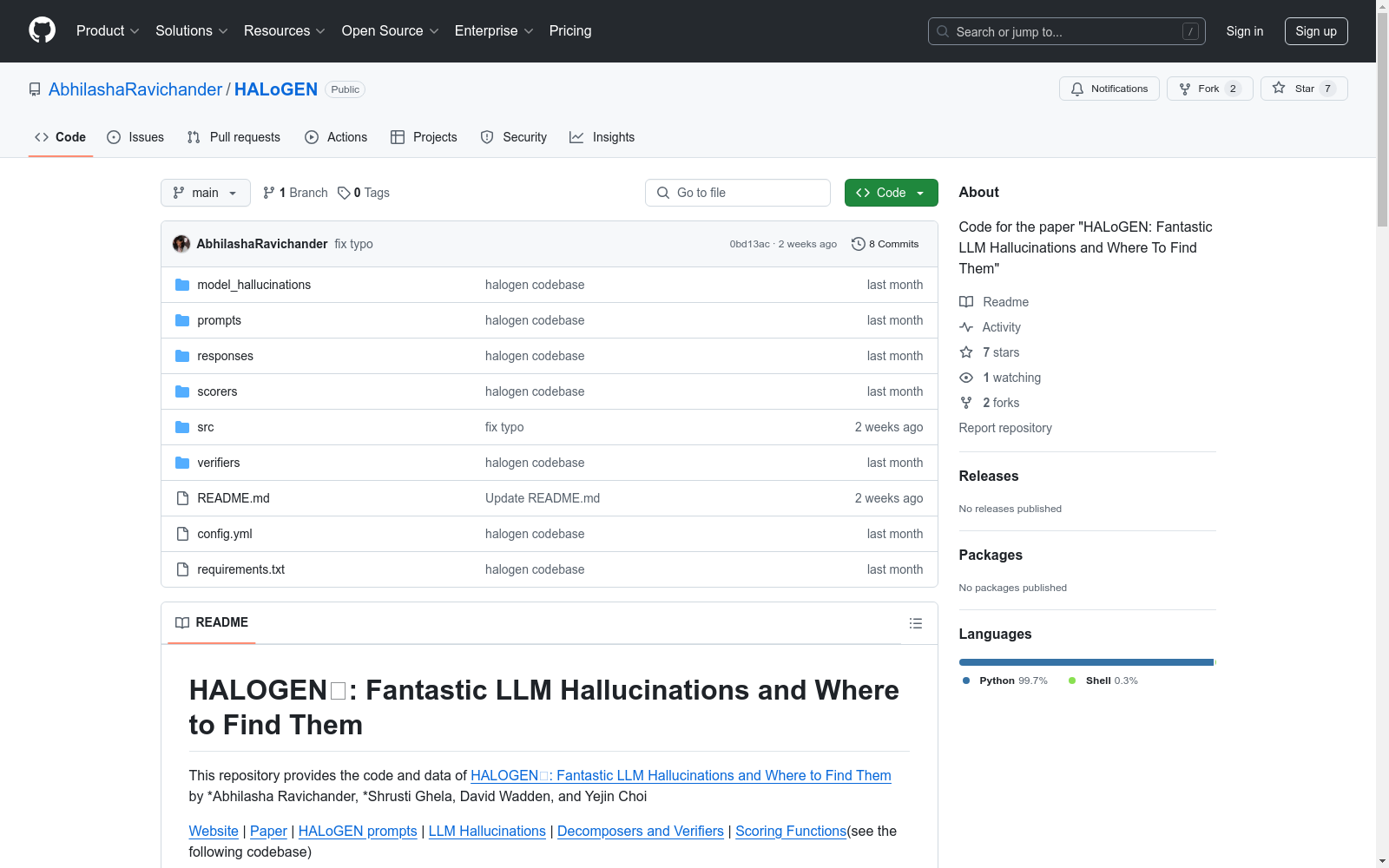

https://github.com/AbhilashaRavichander/HALoGEN

下载链接

链接失效反馈资源简介:

HALoGEN是一个多样化的多领域基准,用于测量大型语言模型(LLMs)的幻觉现象。幻觉是指生成的文本中包含虚假信息或偏离提供上下文的现象。该基准旨在帮助理解这些幻觉的发生频率及其原因,从而开发更可信的AI系统。

HALoGEN is a diverse, multi-domain benchmark designed to measure hallucination phenomena in large language models (LLMs). Hallucination refers to the phenomenon where generated text contains false information or deviates from the provided context. This benchmark aims to help understand the frequency and causes of these hallucinations, thereby facilitating the development of more trustworthy AI systems.

创建时间:

2025-01-16

原始信息汇总

HALoGEN数据集概述

数据集名称

HALOGEN🔦: Fantastic LLM Hallucinations and Where to Find Them

数据集简介

该数据集是一个多领域的基准测试,旨在测量生成大型语言模型(LLM)产生的虚构信息(即幻觉)的发生频率及其原因。

数据集构成

- Prompts: 包含不同任务下的提示信息。

- Responses: 包含模型对各个任务提示的响应。

- Model Hallucinations: 包含对模型响应中的原子单元进行真实性验证的结果,区分了真实和虚构的原子单元。

- Verifiers: 包含用于验证模型响应真实性的验证器。

- Scorers: 包含用于计算LLM幻觉程度、响应比例和响应实用性的评分函数。

使用指南

- 使用数据集、验证器或评估时,请引用相关论文。

- 若使用生物ographies评估,请额外引用FactScore论文。

- 使用种子数据构建提示时,如提及数据源,请引用相应来源。

安装与配置

- 需要设置环境变量并安装必要的Python包。

- 使用spacy下载英语模型。

数据集访问

相关论文

- HALoGEN: Fantastic LLM Hallucinations and Where to Find Them

- FactScore: Fine-grained Atomic Evaluation of Factual Precision in Long Form Text Generation

联系方式

如有问题,可通过邮箱aravicha[AT]cs.washington.edu和shrustighela1[AT]gmail.com联系作者。

其他信息

- 科学引用评估器使用内部Semantic Scholar API,公开版本稍后提供。

- 使用TogetherAI的LLama-2-70B实现验证器,需本地运行以匹配草案结果。

AI搜集汇总

数据集介绍

构建方式

HALoGEN数据集的构建采用了多样化的多领域基准,旨在测量大型生成语言模型(LLM)的虚构信息生成现象,即hallucinations。该数据集通过收集不同领域的种子数据,构建出相应的prompt,进而生成模型响应,并通过验证器(verifiers)来识别和标注虚构信息。

特点

HALoGEN数据集的特点在于其多样性、广泛性和精确性。它涵盖了多个领域,能够全面评估LLM在不同情境下的虚构信息生成情况。数据集不仅包含了模型的响应,还提供了详细的原子单元(atomic units)和虚构原子单元(hallucinated atomic units)的标注信息,以及用于评估的评分函数(scorers),确保了评估的全面性和准确性。

使用方法

使用HALoGEN数据集时,用户需要先安装必要的依赖,配置API密钥,然后运行提供的脚本以加载prompt、生成模型响应、运行验证器和计算评分指标。用户可以从数据集的GitHub仓库中获取详细的安装指南和示例代码,以及如何运行各种配置的验证器。

背景与挑战

背景概述

HALoGEN数据集,由Abhilasha Ravichander、Shrusti Ghela、David Wadden和Yejin Choi等研究人员创建,旨在评估生成式大型语言模型(LLM)产生的虚构陈述,即hallucinations。这类陈述包含错误信息或与给定上下文不符的内容。HALoGEN是一个多样化的多领域基准,用于衡量LLM的hallucinations现象,对于构建值得信赖的人工智能系统具有基础性的挑战意义。该数据集的创建,不仅为相关领域提供了重要的研究资源,也对理解LLM产生hallucinations的频率和原因产生了深远影响。

当前挑战

HALoGEN数据集面临的挑战主要在于:1)解决生成式大型语言模型在生成高质量、流畅文本的同时,如何准确识别并减少hallucinations的出现;2)构建过程中,如何高效地利用各种种子数据构建prompt,以及如何开发和优化用于验证和评分的算法和工具。此外,数据集还面临如何处理内部API和公开API之间的差异,以及如何确保evaluator的准确性和可靠性等问题。

常用场景

经典使用场景

HALoGEN数据集旨在评估大型生成语言模型(LLM)在生成文本时的虚构信息问题,即hallucinations。该数据集的经典使用场景是作为评估LLM生成文本真实性和准确性的基准,通过提供多样化的多领域任务和相应的验证器,研究者可以系统地分析LLM在不同上下文中产生虚构信息的情况。

衍生相关工作

HALoGEN数据集的发布促进了相关领域的研究,衍生出了一系列经典工作,如针对特定任务类型开发的新型验证器和评分函数。这些相关工作不仅扩展了HALoGEN的评估框架,还为理解和缓解LLM的hallucinations问题提供了新的方法和视角。

数据集最近研究

最新研究方向

HALoGEN数据集作为衡量大型生成语言模型(LLM)幻觉现象的多元化多领域基准,其最新研究方向聚焦于理解LLM产生幻觉的频率及其成因,旨在推动可靠AI系统的开发。该研究通过构建各类任务提示,结合分解器和验证器,对模型响应中的原子单位进行精确性验证,从而识别并评估LLM的幻觉现象。此外,研究还关注了评分函数的开发,以量化LLM幻觉的广度和影响,对AI生成文本的准确性和可信度评价具有重大意义。

以上内容由AI搜集并总结生成