shibing624/medical

收藏Hugging Face2024-06-16 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/shibing624/medical

下载链接

链接失效反馈官方服务:

资源简介:

medical是一个中文医疗数据集,包含预训练、微调和奖励三个部分,用于医疗领域大模型训练。预训练部分使用医疗百科和教材数据,微调部分使用医疗对话和问诊数据,奖励部分用于评估模型回答的质量。数据集支持中文医疗对话模型的训练,数据主要为中文。

medical是一个中文医疗数据集,包含预训练、微调和奖励三个部分,用于医疗领域大模型训练。预训练部分使用医疗百科和教材数据,微调部分使用医疗对话和问诊数据,奖励部分用于评估模型回答的质量。数据集支持中文医疗对话模型的训练,数据主要为中文。

提供机构:

shibing624

原始信息汇总

数据集概述

基本信息

- 名称: medical

- 语言: 中文、英文

- 标签: text-generation

- 任务类别: text-generation

- 大小: 1M<n<10M

- 许可证: Apache-2.0

数据集描述

- 用途: 医疗领域大模型训练

- 数据来源:

- 监督微调数据集来自中文医疗对话数据集和在线医疗百科。

- 二次预训练数据集来自医疗教材和医疗百科数据。

- 奖励模型数据集来自中文医疗对话数据集。

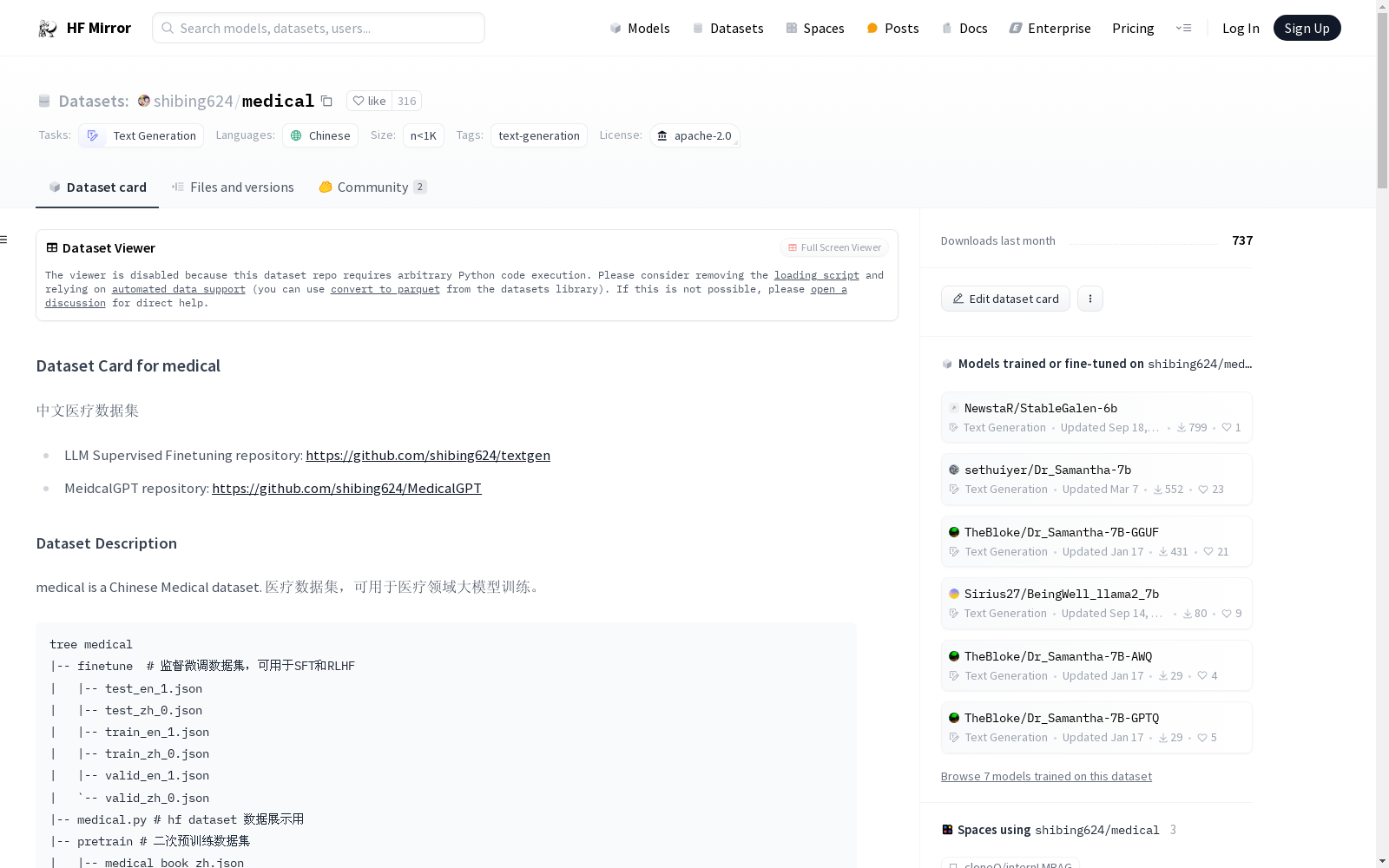

数据集结构

- 预训练数据集:

- 字段: text

- 指令微调数据集:

- 字段: instruction, input, output

- 奖励模型数据集:

- 字段: question, response_chosen, response_rejected

数据集细分

- 预训练数据集:

- train_encyclopedia.json: 361420条

- medical_book_zh.json: 8475条

- 指令微调数据集:

- train_zh_0.json: 1949972条

- train_en_1.json: 116617条

- 奖励模型数据集:

- train.json: 3800条

许可证信息

- 许可证: Apache 2.0

引用信息

- 主要参考来源包括医疗对话数据集和医疗百科数据集的GitHub和Hugging Face链接。

搜集汇总

数据集介绍

构建方式

该数据集通过整合多源医疗数据构建而成,包括医疗百科数据、医疗教材文本、中文医疗对话数据以及英文医疗问诊对话数据。预训练数据集包含36万条医疗百科问答数据和8475条医疗教材文本,经过处理后用于预训练模型。监督微调数据集则整合了195万条中文医疗对话数据和11万条英文医疗问诊对话数据,用于模型的微调和强化学习。奖励模型数据集包含4000条中文医疗对话数据,用于评估模型生成回答的质量。

使用方法

该数据集适用于医疗领域大模型的训练和微调,可用于预训练阶段注入医疗知识,监督微调阶段提升模型在医疗对话中的表现,以及奖励模型阶段评估和优化模型生成回答的质量。使用时,可根据具体任务需求选择相应的数据集子集,如预训练数据集用于初始模型训练,监督微调数据集用于模型微调,奖励模型数据集用于模型评估和优化。

背景与挑战

背景概述

中文医疗数据集(shibing624/medical)是由shibing624整理并上传的,旨在为医疗领域的大模型训练提供丰富的数据资源。该数据集包含了多个子集,如预训练数据集、指令微调数据集和奖励模型数据集,涵盖了从医疗百科、医疗对话到医疗教材等多种数据来源。这些数据不仅有助于提升医疗领域自然语言处理模型的性能,还为研究人员提供了一个标准化的数据集,以评估和改进医疗对话系统的质量。

当前挑战

尽管中文医疗数据集提供了丰富的数据资源,但在构建和应用过程中仍面临诸多挑战。首先,数据的质量和多样性是关键问题,尤其是在医疗对话数据中,确保信息的准确性和专业性至关重要。其次,数据集的规模和分布不均可能导致模型训练时的偏差,影响模型的泛化能力。此外,隐私保护和数据安全也是不可忽视的挑战,特别是在处理涉及个人健康信息的医疗数据时。

常用场景

经典使用场景

在医疗领域,shibing624/medical数据集的经典使用场景主要集中在医疗对话模型的训练与优化。该数据集通过丰富的中文医疗对话数据,为模型提供了大量的真实医疗问答样本,从而使得模型能够更准确地理解和生成医疗相关的对话内容。此外,数据集中的预训练数据和奖励模型数据也为模型的进一步微调和优化提供了坚实的基础。

解决学术问题

该数据集解决了医疗领域中对话生成模型训练数据稀缺的问题。通过整合多源的医疗对话数据,shibing624/medical数据集为学术界提供了一个高质量、大规模的训练资源,有助于推动医疗对话生成模型的研究进展。此外,数据集的多样性和丰富性也为研究者提供了探索不同医疗场景下模型表现的机会,从而推动了医疗对话系统的智能化发展。

实际应用

在实际应用中,shibing624/medical数据集主要用于开发和优化智能医疗助手、在线问诊系统等应用。通过使用该数据集训练的模型,可以显著提升医疗对话系统的准确性和用户满意度,从而在实际医疗场景中提供更为精准和高效的医疗服务。此外,数据集中的奖励模型数据也为模型的持续优化提供了方向,确保模型在实际应用中的表现不断提升。

数据集最近研究

最新研究方向

在医疗领域,shibing624/medical数据集的最新研究方向主要集中在利用大规模预训练语言模型(LLMs)进行医疗对话系统的微调和优化。通过整合多源医疗数据,包括中文医疗对话、医疗百科和知识图谱,该数据集为构建更为精准和智能的医疗问答系统提供了丰富的训练资源。研究者们正致力于通过监督微调(SFT)和强化学习从人类反馈(RLHF)等技术,提升模型的医疗知识注入能力和对话生成质量。此外,奖励模型的引入进一步优化了模型对医疗问题回答的准确性和专业性,推动了医疗AI在实际应用中的性能提升。

以上内容由遇见数据集搜集并总结生成