togethercomputer/RedPajama-Data-1T

收藏Hugging Face2024-06-17 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/togethercomputer/RedPajama-Data-1T

下载链接

链接失效反馈官方服务:

资源简介:

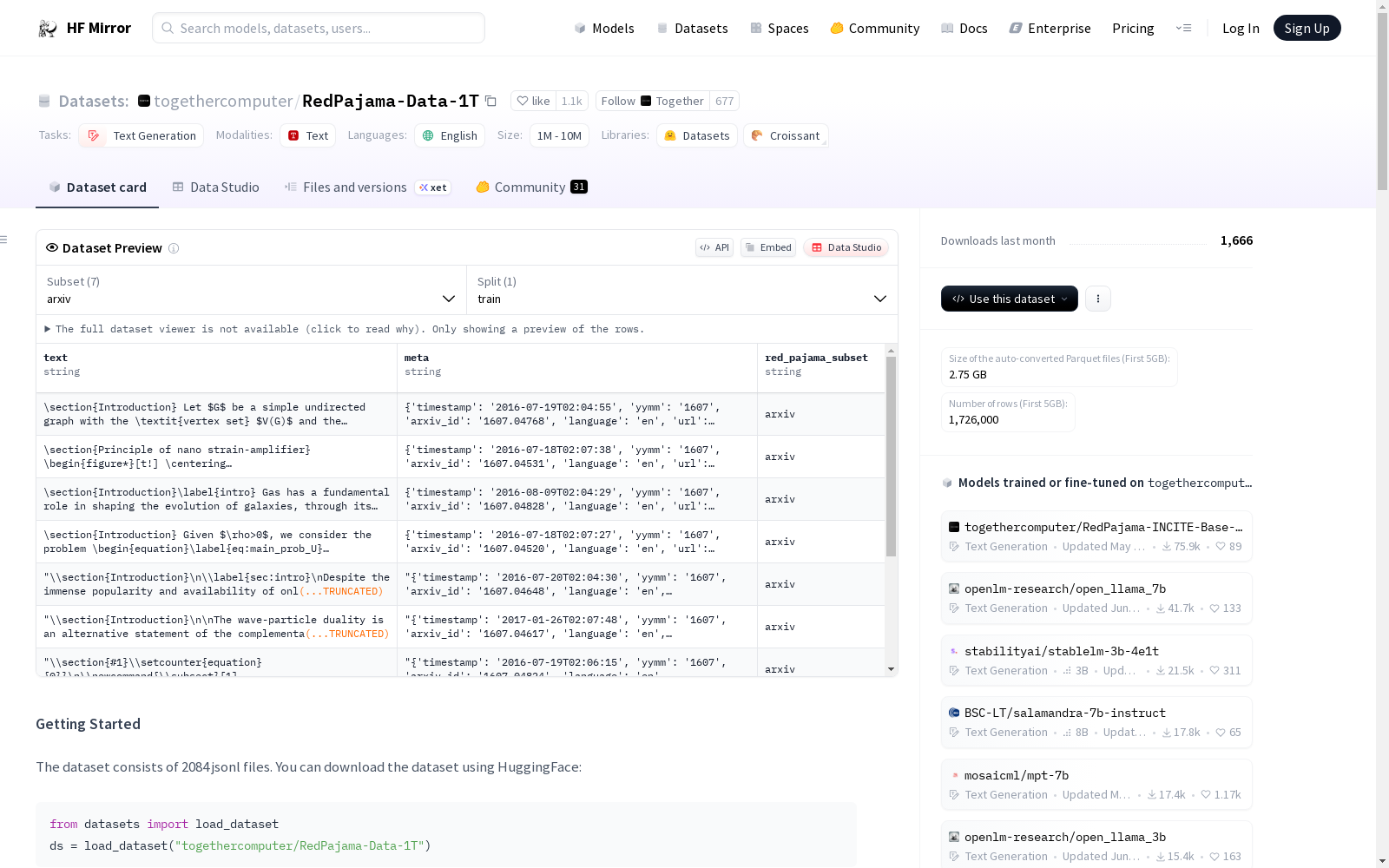

RedPajama是一个用于文本生成任务的大型数据集,包含2084个jsonl文件,总token数达到1.2万亿。数据集主要使用英语,但也包含多语言的Wikipedia部分。数据集结构包括文本内容、元数据(如URL、时间戳、来源和语言)以及标识数据子集的字段。创建过程涉及从多个源(如Commoncrawl、C4、GitHub等)下载和预处理数据,以尽可能接近LLaMa论文的描述。

RedPajama is a large-scale dataset designed for text generation tasks, comprising 2084 JSONL files with a total of 1.2 trillion tokens. The dataset is predominantly in English, but also includes multilingual Wikipedia subsets. Its structure encompasses text content, metadata (such as URLs, timestamps, sources, and language tags), as well as fields for identifying specific data subsets. The creation process involved downloading and preprocessing data from multiple sources (e.g., Common Crawl, C4, GitHub, etc.), with the goal of closely aligning with the descriptions outlined in the LLaMa paper.

提供机构:

togethercomputer

原始信息汇总

数据集概述

名称: RedPajama-Data-1T

任务类别: 文本生成

语言: 主要为英语,Wikipedia部分包含多语言

数据集结构: json { "text": ..., "meta": {"url": "...", "timestamp": "...", "source": "...", "language": "...", ...}, "red_pajama_subset": "common_crawl" | "c4" | "github" | "books" | "arxiv" | "wikipedia" | "stackexchange" }

数据集组成:

- 包含2084个jsonl文件

- 可通过HuggingFace或直接下载获取

数据集来源及处理:

- Commoncrawl: 下载自Commoncrawl,经过去重和质量过滤

- C4: 下载自Huggingface,格式转换

- GitHub: 下载自Google BigQuery,去重和质量过滤,仅保留特定开源许可项目

- Wikipedia: 下载自Huggingface,已预处理

- ArXiv: 下载自Amazon S3,仅保留LaTeX源文件并去除不必要部分

- StackExchange: 下载自Internet Archive,仅保留28个最大站点内容,去除HTML标签,组织为问答对

数据集大小:

- 总计1.2万亿token

- 各部分token数量如下:

- Commoncrawl: 878亿

- C4: 175亿

- GitHub: 59亿

- Books: 26亿

- ArXiv: 28亿

- Wikipedia: 24亿

- StackExchange: 20亿

许可证:

- 请参考各数据子集的许可证

引用信息:

@software{together2023redpajama, author = {Together Computer}, title = {RedPajama: An Open Source Recipe to Reproduce LLaMA training dataset}, month = April, year = 2023, url = {https://github.com/togethercomputer/RedPajama-Data} }

搜集汇总

数据集介绍

构建方式

RedPajama-Data-1T数据集旨在遵循LLaMa论文的步骤,尽可能重现其数据集构建方法。该数据集从多个来源收集数据,包括Commoncrawl、C4、GitHub、ArXiv、Wikipedia以及StackExchange等,通过一系列预处理步骤如去重、过滤低质量文本、格式转换等,最终形成了结构化的数据集。

特点

该数据集的主要特点是完全开源且不含版权争议内容,以英语为主,但也包含多种语言的数据。数据结构清晰,每个条目包含文本内容和元数据,详细记录了来源、时间戳、语言等信息。此外,数据集通过严格的预处理保证了文本质量,适用于文本生成等任务。

使用方法

用户可以通过HuggingFace的数据集库直接加载RedPajama-Data-1T数据集。此外,数据集也提供了SHA256校验和以确保数据完整性。用户可以根据需要,通过设置环境变量来从本地加载已下载数据,或者直接使用数据集提供的脚本从源头重建数据集。

背景与挑战

背景概述

RedPajama-Data-1T数据集,作为LLaMa数据集的开源实现,其构建宗旨在于尽可能接近LLaMa论文中的数据集构建方法。该数据集由Together Computer团队于2023年创建,包含了来自Commoncrawl、C4、GitHub、ArXiv、Wikipedia以及StackExchange等来源的文本数据,总计达到1.2万亿个token。数据集以英语为主,但也包含多语言维基百科的内容。该数据集旨在为文本生成任务提供高质量的数据支持,对于自然语言处理领域的研究具有重要的参考价值。

当前挑战

在构建RedPajama-Data-1T数据集的过程中,研究人员面临了多个挑战。首先,确保数据质量是关键,为此团队对Commoncrawl的数据进行了清洗和去重,同时对GitHub的数据进行了筛选,确保只保留符合特定许可证的项目。其次,对于不同来源的数据,如ArXiv的latex文件和StackExchange的帖子,需要特定的预处理步骤以适应数据集的格式。此外,数据集在构建过程中还需克服版权问题,例如原本包含的书籍数据因版权侵犯问题而被移除。这些挑战不仅要求高效率的数据处理技术,还涉及到法律合规性和数据伦理问题。

常用场景

经典使用场景

在自然语言处理领域,RedPajama-Data-1T数据集被广泛应用于文本生成任务中,如构建聊天机器人、自动摘要、内容创作等场景,其庞大的数据量为模型提供了丰富的语言理解和生成能力。

衍生相关工作

基于RedPajama-Data-1T数据集,学术界和工业界衍生出了大量相关的工作,包括但不限于构建更大规模的语料库、开发新的预训练模型、以及针对特定任务的模型微调等研究。

数据集最近研究

最新研究方向

在自然语言处理领域,togethercomputer/RedPajama-Data-1T数据集作为LLaMa数据集的开源实现,引起了广泛关注。该数据集的构建旨在为文本生成任务提供高质量的训练基础。近期研究集中于深入挖掘该数据集在文本生成模型训练中的应用,特别是在提高模型生成文本的多样性和准确性方面。通过精细化的数据预处理和子集划分,研究者在遵循开源协议的前提下,探索数据集在机器翻译、问答系统以及对话生成等领域的应用潜力,为人工智能技术的发展贡献了新的研究视角和实验资源。

以上内容由遇见数据集搜集并总结生成