Medical-CXR-VQA

收藏github2024-07-15 更新2024-08-28 收录

下载链接:

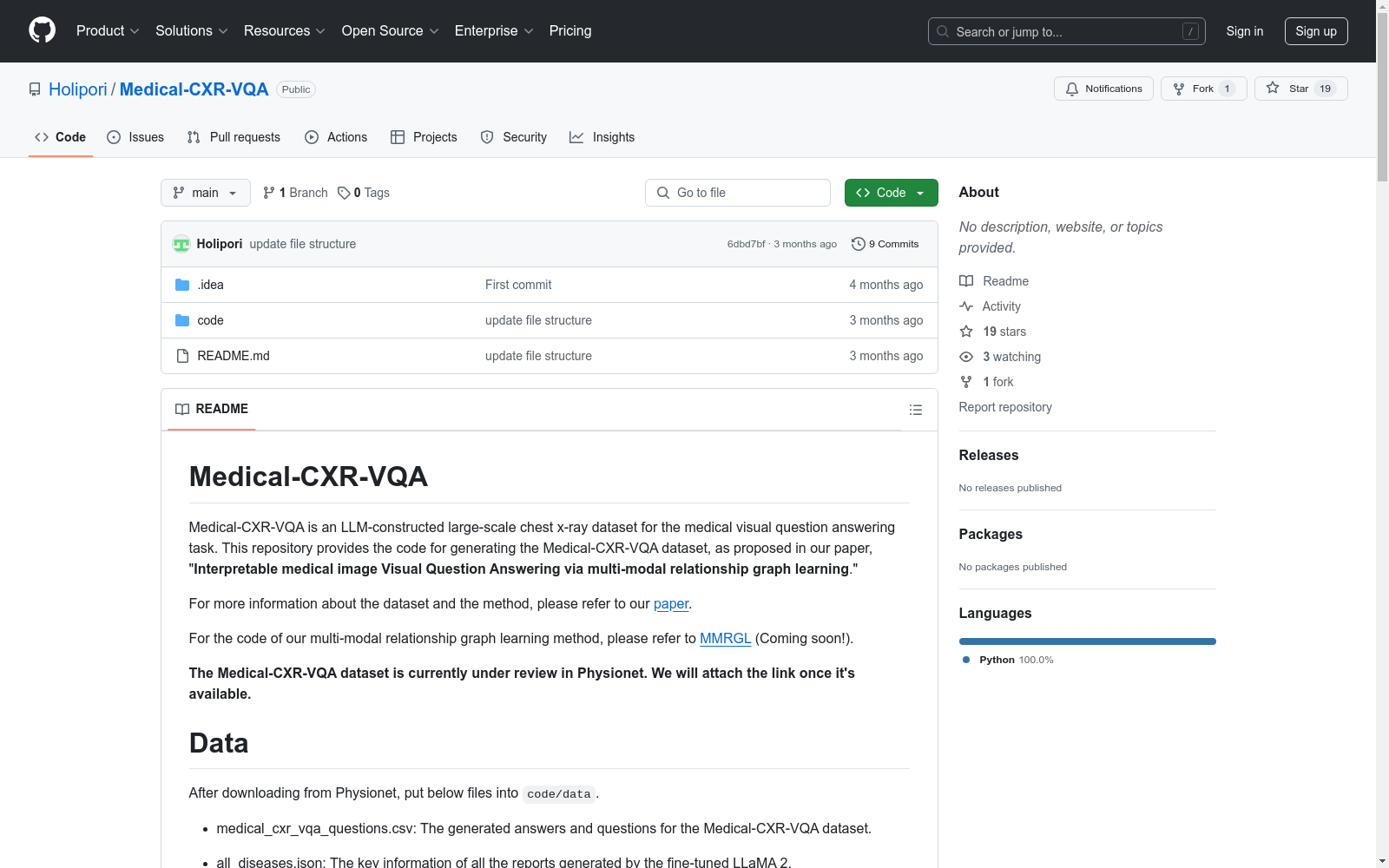

https://github.com/Holipori/Medical-CXR-VQA

下载链接

链接失效反馈资源简介:

Medical-CXR-VQA是一个大规模医学多模态数据集。其基于MIMIC-CXR数据集构建,该数据集包括在215,547张胸部X光片上的780,014个问题答案对,问题含盖异常,存在,位置,级别,拍摄角度和类型,共7种类型的问题。

Medical-CXR-VQA is a large-scale medical multimodal dataset developed based on the MIMIC-CXR dataset. It comprises 780,014 question-answer pairs associated with 215,547 chest X-ray images. The questions span 7 categories, including abnormality, presence, location, severity, projection angle, and type.

提供机构:

得克萨斯大学、理化学研究所、国立卫生研究院、日本癌症研究中心、东京大学

创建时间:

2024-07-15

原始信息汇总

Medical-CXR-VQA 数据集概述

数据集简介

Medical-CXR-VQA 是一个用于医学视觉问答任务的大型胸部X光数据集,由LLM构建。该数据集旨在通过多模态关系图学习方法进行可解释的医学图像视觉问答。

数据文件

数据集包含以下文件:

medical_cxr_vqa_questions.csv: 包含生成的问答对。all_diseases.json: 由微调后的LLaMA 2生成的报告关键信息。mimic_all.csv: 与CXR研究相关的所有元数据。all_diseases_gpt4_100.json: 由GPT-4生成的100个示例,用于微调LLaMA 2。

库文件

以下文件用于生成问答对:

disease_lib_llm.csv: 初始疾病名称库。level_lib.csv: 初始级别库。location_lib.csv: 初始位置库。type_lib.csv: 初始类型库。postlocation_lib.csv: 初始后置位置库。position_change.csv: 初始位置变化库。entity_dict.json: 疾病名称及其在KeyInfo集中的出现频率。type_dict.json: 疾病类型及其在KeyInfo集中的出现频率。level_dict.json: 疾病级别及其在KeyInfo集中的出现频率。location_dict.json: 疾病位置及其在KeyInfo集中的出现频率。

文件说明

以下文件位于code/data目录中:

"system_text.txt": ChatGPT的系统提示。"simple_system_text.txt": 用于微调LLaMA 2的简化系统提示。"user_text.txt": 用户输入,即输入报告,仅用于function_testing.py。"id100.pkl": 存储用于医生评估的100个示例的ID。

数据集生成步骤

-

准备100个训练数据(可选):

- 生成

all_diseases_gpt4_100.json。 - 需要Azure OpenAI Service访问权限。

- 从MIMIC-CXR数据库下载

mimic-cxr-report.zip。

- 生成

-

设置LlaMa-Factory:

- 下载Llama 2检查点并存储。

- 修改

dataset_info.json以添加新创建的微调数据集定义。

-

微调模型:

- 使用DeepSpeed进行模型微调。

-

合并微调模型与原始模型:

- 导出微调后的模型。

-

使用微调模型生成整个数据集:

- 生成

all_diseases_chatgptRaw.json。

- 生成

-

后续处理和生成后续问题:

- 进行后续处理和生成后续问题。

-

问题生成:

- 生成最终的问答对。

AI搜集汇总

数据集介绍

构建方式

Medical-CXR-VQA数据集的构建过程融合了先进的语言模型技术。首先,从MIMIC-CXR数据库中提取胸部X光报告,利用GPT-4生成初始训练数据。随后,通过LlaMa-Factory对Llama 2模型进行微调,以适应特定的医学图像问答任务。微调后的模型用于生成大规模的问答对,并通过后处理步骤确保数据质量。整个过程包括数据准备、模型微调、数据生成和后处理,确保了数据集的高质量和适用性。

使用方法

使用Medical-CXR-VQA数据集时,用户首先需要从Physionet下载相关文件并放置在指定目录中。接着,可以利用提供的代码进行数据集的生成和处理。用户可以通过运行main.py脚本,指定模型路径和输出文件名,生成问答对。此外,数据集还提供了详细的文档和示例代码,帮助用户理解和应用数据集,从而在医学图像分析和问答系统开发中取得更好的效果。

背景与挑战

背景概述

Medical-CXR-VQA数据集是由大型语言模型(LLM)构建的大规模胸部X光数据集,专门用于医学视觉问答任务。该数据集的核心研究问题是通过多模态关系图学习实现医学图像的可解释性视觉问答。主要研究人员和机构通过结合GPT-4和LLaMA 2模型,生成了包含大量胸部X光图像及其相关问答的数据集。该数据集的创建旨在推动医学图像分析领域的发展,特别是在提高诊断准确性和可解释性方面。目前,该数据集正在Physionet上进行评审,预计将对医学图像处理和人工智能辅助诊断领域产生深远影响。

当前挑战

Medical-CXR-VQA数据集在构建过程中面临多项挑战。首先,数据集的生成依赖于复杂的模型训练和微调过程,涉及GPT-4和LLaMA 2等先进模型的结合,这要求高计算资源和专业技术支持。其次,数据集的标注和验证需要高度专业化的医学知识,确保生成的问答对具有临床准确性和实用性。此外,数据集的隐私和安全问题也是一个重要挑战,特别是在处理敏感的医学图像数据时,必须严格遵守相关法律法规。最后,数据集的可扩展性和通用性问题也需要解决,以确保其在不同医疗场景和应用中的有效性。

常用场景

经典使用场景

Medical-CXR-VQA数据集在医疗视觉问答任务中展现了其经典应用场景。通过结合胸部X光图像与自然语言处理技术,该数据集能够生成针对医学影像的详细问题与答案,从而辅助医生进行诊断。这种多模态数据集的应用,不仅提升了医学影像的解释性,还增强了临床决策的支持能力。

解决学术问题

Medical-CXR-VQA数据集解决了医学影像分析中的多个学术研究问题。首先,它通过多模态关系图学习方法,提升了医学影像的解释性和诊断准确性。其次,该数据集促进了自然语言处理与医学影像分析的跨学科研究,为开发更智能的医疗辅助系统提供了数据支持。此外,它还推动了大规模医学数据集的标准化和可用性研究。

实际应用

在实际应用中,Medical-CXR-VQA数据集被广泛用于开发和验证医学影像分析工具。例如,医院和研究机构利用该数据集训练和测试自动诊断系统,以提高诊断效率和准确性。此外,该数据集还被用于医学教育和培训,帮助医学生和年轻医生更好地理解和分析医学影像。

数据集最近研究

最新研究方向

在医学影像分析领域,Medical-CXR-VQA数据集的最新研究方向主要集中在多模态关系图学习(Multi-modal Relationship Graph Learning)的应用上。该方法通过整合胸部X光片(CXR)图像与相关医学问答数据,旨在提升医学影像视觉问答任务的可解释性。这一研究不仅推动了医学影像分析技术的进步,还为临床诊断提供了更为精准和可靠的辅助工具。此外,结合GPT-4和LLaMA 2等先进语言模型的微调,进一步增强了数据集在生成高质量医学问答对方面的能力,这对于提升医疗AI系统的实用性和准确性具有重要意义。

以上内容由AI搜集并总结生成