TReB

收藏github2025-07-11 更新2025-07-12 收录

下载链接:

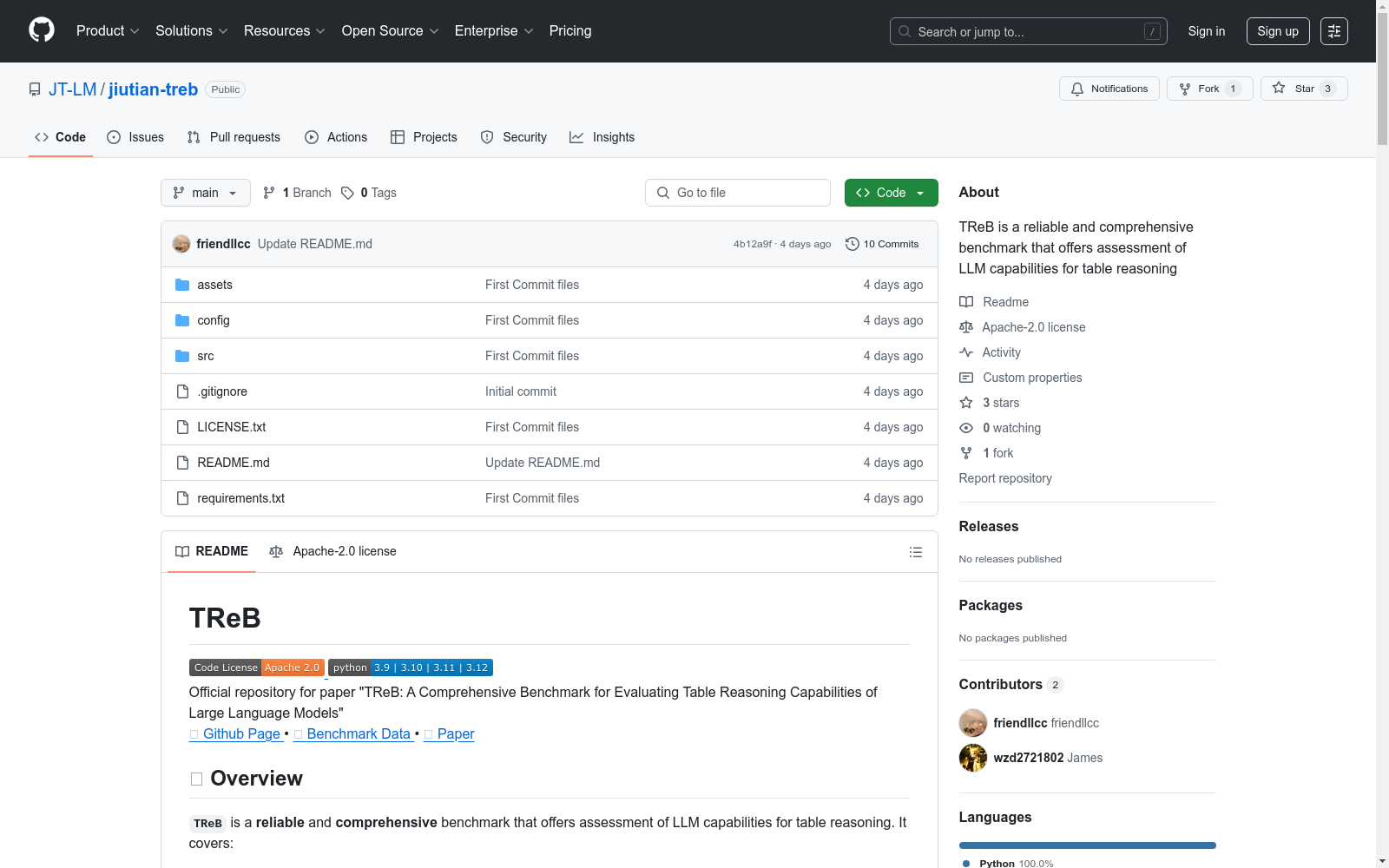

https://github.com/JT-LM/jiutian-treb

下载链接

链接失效反馈资源简介:

TReB是一个可靠且全面的基准测试,用于评估大型语言模型在表格推理方面的能力。它涵盖了从基本语言理解到高级数据分析的完整能力谱,包括六个核心技能和26个子任务。

创建时间:

2025-07-11

原始信息汇总

TReB 数据集概述

数据集简介

- 名称:TReB (Table Reasoning Benchmark)

- 类型:表格推理评估基准

- 许可证:Apache 2.0

- 官方论文:TReB: A Comprehensive Benchmark for Evaluating Table Reasoning Capabilities of Large Language Models

数据集特点

-

综合性:

- 整合了清洗过的公共基准数据集、真实网页表格和专有数据

- 覆盖6大核心能力和26项任务

-

核心能力:

- 自然语言理解:基础NLP能力评估

- 表格理解:表格结构与内容解析

- 表格基础操作:自然语言到结构化数据操作的转换

- 表格计算操作:复杂计算任务执行

- 数据分析:基础统计分析与模式识别

- 高级数据分析:高复杂度多步骤分析

评估框架

-

推理模式:

- TCoT (Textual Chain-of-Thought):纯文本逐步推理

- PoT (Program-of-Thought):生成可执行代码

- ICoT (Interleaved Chain-of-Thought):文本与程序交替推理

-

评估指标:

- 自然语言指标(BLEU、ROUGE-L)

- LLM-as-a-Judge(语义相似度评估)

- 精确匹配准确率(Exact Match)

使用指南

-

数据集获取:

-

配置要求:

- Python版本:3.9 | 3.10 | 3.11 | 3.12

- 需准备JSON配置文件指定模型参数和评估设置

-

评估流程:

- 执行模型推理

- 执行答案评估

- 结果存储在

eval_output目录下的JSONL文件中

注意事项

- 仅限学术研究使用

- 代码执行器仅配置了基本安全规则

- 部分任务输出可能不包含表格内容(正常现象)

引用格式

bibtext @misc{li2025trebcomprehensivebenchmarkevaluating, title={TReB: A Comprehensive Benchmark for Evaluating Table Reasoning Capabilities of Large Language Models}, author={Ce Li and Xiaofan Liu and Zhiyan Song and Ce Chi and Chen Zhao and Jingjing Yang and Zhendong Wang and Kexin Yang and Boshen Shi and Xing Wang and Chao Deng and Junlan Feng}, year={2025}, eprint={2506.18421}, archivePrefix={arXiv}, primaryClass={cs.CL}, url={https://arxiv.org/abs/2506.18421}, }

AI搜集汇总

数据集介绍

构建方式

TReB数据集通过整合清洗后的公开基准数据、真实网络表格及专有数据,构建了一个覆盖六项核心能力与26项任务的综合性评估体系。该数据集采用多源数据融合策略,确保样本的多样性与代表性,并通过严格的标注流程验证数据质量。其框架设计融合了三种推理模式(TCoT、PoT、ICoT),支持从基础语言理解到高级数据分析的全维度能力评估。

特点

TReB的突出特点在于其多维评估体系与任务复杂性。数据集涵盖自然语言理解、表格操作、计算分析等六大技能领域,每个领域细分为具有渐进难度的子任务。特别设计的ICoT模式允许模型交替使用文本推理与程序化输出,动态适应多步骤分析需求。评估指标整合传统自然语言度量与LLM-as-a-Judge等创新方法,确保结果的可解释性与可靠性。

使用方法

使用TReB需通过四步标准化流程:从Hugging Face下载数据集后,配置包含模型参数、推理模式及评估指标的JSON文件。运行评估脚本时,系统会依次执行模型推理与答案评判两个阶段,最终生成包含BLEU、ROUGE-L等指标的详细报告。用户可通过修改安全路径设置扩展文件访问权限,但需注意代码执行器的安全限制仅适用于研究环境。结果文件采用结构化JSONL格式存储,便于后续分析与可视化处理。

背景与挑战

背景概述

TReB数据集由JiuTian-AI团队于2025年推出,旨在全面评估大语言模型在表格推理任务中的表现能力。该数据集整合了公开基准测试、真实网页表格及专有数据,涵盖自然语言理解、表格理解、基础与计算操作、数据分析等六大核心能力,共包含26项子任务。作为表格推理领域首个综合性评估基准,TReB通过多模态推理框架(TCoT、PoT、ICoT)和三维度评价指标,为LLM在结构化数据处理能力的系统性测评提供了标准化解决方案,对推动智能数据分析和决策支持系统的发展具有重要学术价值。

当前挑战

构建TReB面临双重技术挑战:在领域问题层面,表格推理需突破传统NLP任务边界,解决结构化数据与自然语言间的语义鸿沟,特别是多步骤计算操作中符号推理与数值计算的协同问题;在构建过程层面,数据异构性导致标注一致性难以保障,真实网页表格的噪声清洗与逻辑关系标注消耗大量人工成本,而动态生成的代码评估(PoT模式)需建立安全的沙箱执行环境。评价体系设计上,如何平衡精确匹配(EM)与语义相似度(LLM-as-a-Judge)指标的矛盾性,成为确保评估结果可靠性的关键难题。

常用场景

经典使用场景

在自然语言处理与结构化数据分析的交叉领域,TReB数据集通过整合公开基准、真实网页表格与专有数据,为评估大语言模型在表格推理任务中的表现提供了标准化测试平台。其覆盖的六项核心能力与26个子任务,使得研究者能够系统性地考察模型从基础表格理解到多步骤高级数据分析的全方位表现。

实际应用

在金融报表解析、医疗数据分析等需要处理复杂表格的实际场景中,TReB的评估框架可帮助筛选最优模型方案。其支持的代码生成评估模式特别适用于需要将自然语言查询转化为可执行操作的商业智能系统,而多步骤推理评估则能验证模型在供应链优化等决策支持场景中的实用性。

衍生相关工作

基于TReB的评估范式,后续研究衍生出TableLlama等专精表格处理的模型架构改进工作。其提出的ICoT混合推理模式启发了多篇关于迭代式表格分析的顶会论文,而数据集中的程序生成评估模块则推动了如TabCoder等表格专用代码生成工具的研发。

以上内容由AI搜集并总结生成