AgentBench

收藏github2023-08-01 更新2025-02-07 收录

下载链接:

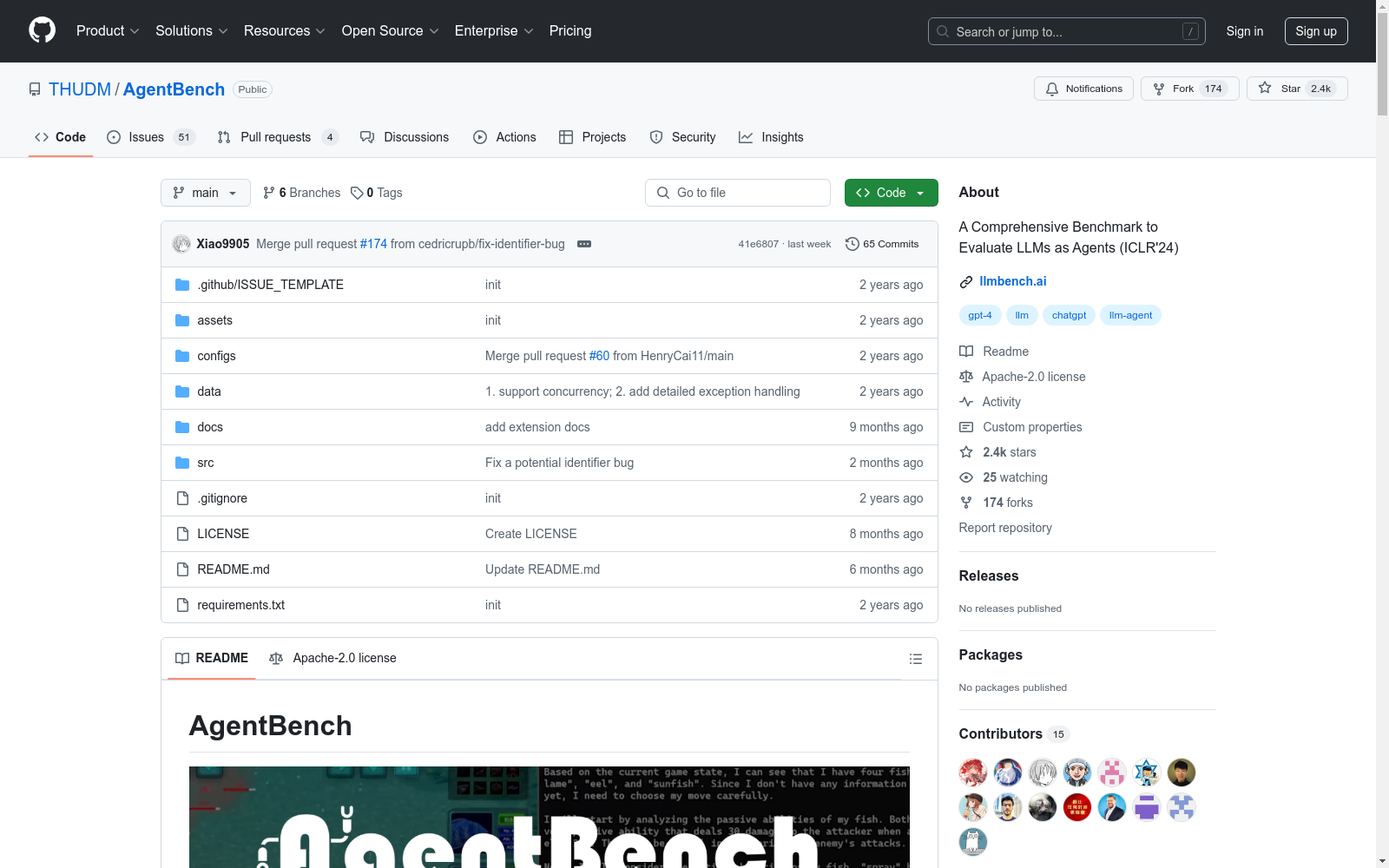

https://github.com/THUDM/AgentBench

下载链接

链接失效反馈资源简介:

AgentBench数据集包含1360个英文测试样本,是首个用于评估大型语言模型(LLMs)作为AI代理在各种环境中表现的基准测试。该数据集涵盖了八个不同的环境,包括五个新建立的领域:操作系统、数据库、知识图谱、数字卡牌游戏以及横向思维谜题,以及三个从公共数据集中改编而来的领域:家务管理、网络购物和网络浏览。

The AgentBench dataset encompasses 1360 English test samples and represents the first benchmark for evaluating the performance of large language models (LLMs) as AI agents across various environments. The dataset spans eight distinct domains, including five newly established fields: operating systems, databases, knowledge graphs, digital card games, and lateral thinking puzzles, as well as three adapted from public datasets: household management, online shopping, and web browsing.

提供机构:

清华大学

创建时间:

2023-08-01

原始信息汇总

AgentBench 数据集概述

数据集简介

- 名称:AgentBench

- 目的:评估大型语言模型(LLM)作为智能体在不同环境中的表现

- 特点:

- 首个针对LLM-as-Agent的综合性基准测试

- 包含8个不同的测试环境

- 提供开发和测试两个数据集分割

测试环境

-

新创建的环境:

- 操作系统(OS)

- 数据库(DB)

- 知识图谱(KG)

- 数字卡牌游戏(DCG)

- 横向思维谜题(LTP)

-

基于已发布数据集重新编译的环境:

- 家务处理(HH) - 来自ALFWorld

- 网络购物(WS) - 来自WebShop

- 网络浏览(WB) - 来自Mind2Web

数据集统计

- 交互次数:

- 开发集:约4,000次

- 测试集:约13,000次

扩展版本

- VisualAgentBench:

- 用于评估和训练基于大型多模态模型(LMM)的视觉基础智能体

- 包含5个环境:

- 实体环境:VAB-OmniGibson, VAB-Minecraft

- GUI环境:VAB-Mobile, VAB-WebArena-Lite

- 视觉设计:VAB-CSS

资源需求

| 任务名称 | 启动时间 | 内存消耗 |

|---|---|---|

| webshop | ~3分钟 | ~15GB |

| mind2web | ~5分钟 | ~1GB |

| db | ~20秒 | <500MB |

| alfworld | ~10秒 | <500MB |

| card_game | ~5秒 | <500MB |

| ltp | ~5秒 | <500MB |

| os | ~5秒 | <500MB |

| kg | ~5秒 | <500MB |

相关资源

- 论文:https://arxiv.org/abs/2308.03688

- 视觉扩展:https://github.com/THUDM/VisualAgentBench

- 旧版本:https://github.com/THUDM/AgentBench/tree/v0.1

搜集汇总

数据集介绍

构建方式

AgentBench数据集的构建基于对大型语言模型(LLMs)作为自主代理的多环境评估需求。该数据集涵盖了8个不同的环境,包括5个全新创建的领域(如操作系统、数据库、知识图谱等)以及3个从已有数据集中重新编译的环境(如家庭管理、网络购物等)。每个环境均设计了多轮交互任务,要求模型生成数千次响应,以确保评估的全面性和深度。

特点

AgentBench数据集的特点在于其多样性和系统性。它不仅涵盖了多个领域的任务,还通过多轮交互设计,模拟了真实世界中的复杂场景。此外,数据集提供了开发和测试两个分割,分别包含4k和13k次生成任务,确保了评估的广泛性和准确性。数据集还支持对多种LLMs的测试,包括开源和专有模型,为研究者和开发者提供了丰富的实验平台。

使用方法

使用AgentBench数据集时,首先需克隆代码库并安装依赖项,确保Docker环境配置正确。随后,通过配置OpenAI API密钥,用户可以启动任务服务器并运行指定的任务。数据集提供了详细的配置指南和程序入口指南,帮助用户快速上手。用户还可以根据需要扩展数据集,添加新的任务或模型,进一步丰富评估内容。

背景与挑战

背景概述

AgentBench数据集由清华大学的研究团队于2023年推出,旨在评估大型语言模型(LLMs)作为自主代理在不同环境中的表现。该数据集涵盖了八个不同的环境,包括操作系统、数据库、知识图谱、数字卡牌游戏和横向思维谜题等,旨在全面测试LLMs在多样化场景中的适应性和智能表现。AgentBench的推出为LLMs在自主代理领域的研究提供了重要的基准测试工具,推动了该领域的技术进步和应用探索。

当前挑战

AgentBench面临的挑战主要包括两个方面。首先,LLMs作为自主代理的评估需要涵盖多样化的复杂环境,这对模型的泛化能力和适应性提出了极高的要求。其次,数据集的构建过程中,如何确保不同环境之间的任务一致性和评估标准的公平性,是一个技术难题。此外,随着LLMs的快速发展,如何持续更新和扩展数据集以反映最新的技术进展,也是未来需要解决的关键问题。

常用场景

经典使用场景

AgentBench数据集广泛应用于评估大型语言模型(LLMs)作为自主代理的能力,特别是在多环境交互场景中。通过涵盖操作系统、数据库、知识图谱、数字卡牌游戏和横向思维谜题等多样化任务,AgentBench为研究者提供了一个全面的测试平台,以验证LLMs在不同复杂环境中的表现。

解决学术问题

AgentBench解决了如何系统评估LLMs在多样化任务中作为自主代理的学术问题。通过引入多个全新设计的任务环境以及重新编译的公开数据集,AgentBench填补了现有基准测试在全面性和多样性上的不足,为LLMs的自主代理能力提供了更为严谨的评估框架。

衍生相关工作

AgentBench的发布催生了一系列相关研究,特别是在多模态模型和视觉基础代理领域。例如,VisualAgentBench作为其衍生项目,专注于评估和训练基于大型多模态模型的视觉基础代理,进一步扩展了AgentBench的应用范围,并为视觉任务中的自主代理研究提供了新的方向。

以上内容由遇见数据集搜集并总结生成