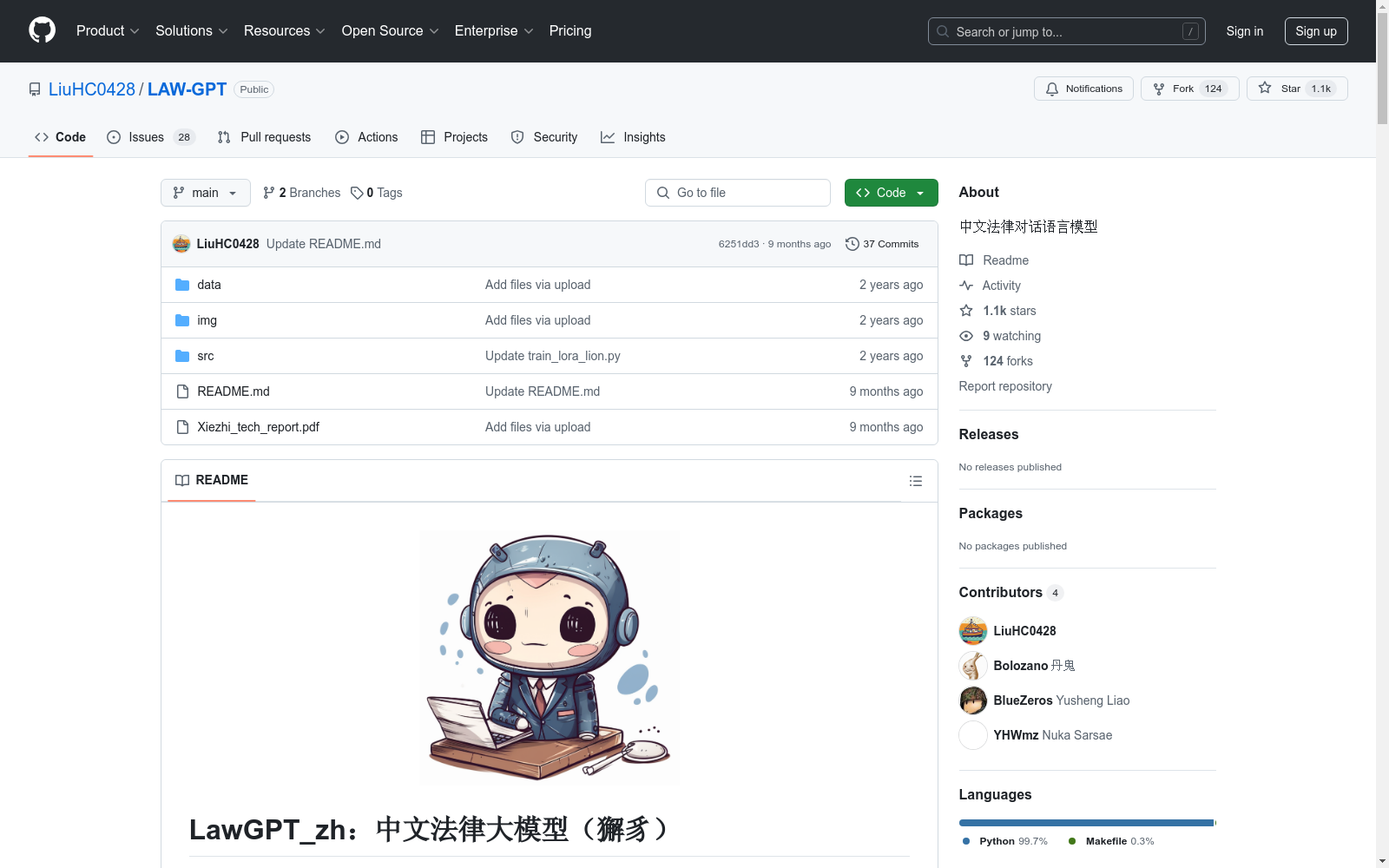

LawGPT_zh

收藏github2023-05-01 更新2025-02-07 收录

下载链接:

https://github.com/LiuHC0428/LAW-GPT

下载链接

链接失效反馈资源简介:

LawGPT zh数据集是一个中文法律指令数据集,主要分为两部分:场景对话和法律知识问答。场景对话部分包含20万条律师与用户之间的真实对话。通过模型对问答进行重新处理后,获得了5.2万条单轮问答和9.2万条带有法律依据的场景问答。另一部分则是通过自建的法律专业知识数据库生成的法律知识相关问答对,目前这部分尚未开源。

The LawGPT zh dataset is a Chinese legal instruction dataset, primarily divided into two parts: scenario dialogue and legal knowledge question-answering. The scenario dialogue section contains 200,000 real dialogues between lawyers and users. After reprocessing the questions and answers through the model, 52,000 single-round question-answering and 92,000 scenario question-answering with legal basis were obtained. The other part consists of question-answer pairs related to legal knowledge, generated through a self-built legal professional knowledge database, and this part has not yet been opened to the public.

提供机构:

上海交通大学

创建时间:

2023-05-01

原始信息汇总

LawGPT_zh:中文法律大模型(獬豸)

项目简介

- 目标:为公众提供专业可靠的法律问题解答,推动法律服务的普及和法治社会的构建。

- 模型基础:基于ChatGLM-6B LoRA 16-bit指令微调的中文法律通用模型。

- 数据集特点:结合法律问答数据集和基于法条及真实案例的self-Instruct高质量法律文本问答,提升模型在法律领域的专业性和可靠性。

数据集详情

数据构成

-

情景对话

- 来源:真实律师用户问答数据,来自CrimeKgAssitant收集的200k条情景对话。

- 处理:利用ChatGPT清洗得到52k单轮问答,语言更规范详细。

-

带有法律依据的情景问答

- 来源:基于《中华人民共和国法律手册》9k核心法条,通过ChatGPT生成92k条情景问答。

- 特点:每条问答包含具体法律依据,格式为JSON,含问题、答案和相关法条引用。

-

知识问答(计划中)

- 内容:法律教科书、经典案例等,构建法律专业知识数据库。

- 方法:基于特定知识的Reliable-Self-Instruction,确保回答准确性。

数据统计

| 数据类型 | 数量 | 占比(%) |

|---|---|---|

| 情景对话 | 200k | 100 |

| 知识问答 | Coming soon | 0 |

| 总计 | 200k | 100 |

模型特点

- 输出示例:模型回答包含法条依据,提高可靠性。

- 对比测试:与ChatGLM相比,LawGPT_zh在法律领域表现更专业,回答更具法律依据。

训练与使用

-

训练步骤:

- 下载数据集。

- 配置train_lora.py参数。

- 运行训练脚本(需4张3090显卡,模型并行算法)。

-

使用步骤:

- 配置环境,安装依赖。

- 下载模型参数(ChatGLM-6B、检索模型、text2vec-base-chinese)。

- 运行交互脚本(单卡显存>=15G)。

免责声明

- 模型可能存在偏差和错误,仅供研究参考,不保证准确性和可靠性,使用者需自行承担风险。

引用

latex @misc{LAWGPT-zh, author={Hongcheng Liu, Yusheng Liao, Yutong Meng, Yuhao Wang}, title = {XieZhi: Chinese Law Large Language Model}, year = {2023}, publisher = {GitHub}, journal = {GitHub repository}, howpublished = {url{https://github.com/LiuHC0428/LAW_GPT}}, }

搜集汇总

数据集介绍

构建方式

LawGPT_zh数据集的构建主要依赖于两个核心部分:情景对话与法律知识问答。情景对话数据来源于CrimeKgAssitant项目,包含了200k条真实的中文律师与用户之间的对话记录。此外,通过ChatGPT对原始数据进行清洗和重构,生成了52k条单轮问答数据,使得回答更加详细和规范。同时,基于中华人民共和国法律手册的核心法条,利用ChatGPT联想生成具体的情景问答,形成了92k条带有法律依据的问答数据,确保了数据的法律准确性和专业性。

使用方法

使用LawGPT_zh数据集时,首先需要配置项目依赖环境,并下载必要的模型参数。用户可以通过运行提供的demo.py或demo_r.py脚本,利用单卡显存大于15G的GPU进行交互式问答。数据集支持直接生成回答或加入检索功能的回答,用户可以根据需要选择不同的交互方式。此外,数据集还提供了详细的训练步骤和命令,支持用户进行模型的进一步微调和优化,以适应特定的法律应用场景。

背景与挑战

背景概述

LawGPT_zh是由上海交通大学的廖育生、刘泓呈、孟昱同、王宇昊四位研究人员在2023年开发的中文法律大模型,旨在通过人工智能技术为公众提供专业的法律咨询服务。该模型基于ChatGLM-6B LoRA 16-bit指令微调,结合了现有的法律问答数据集和基于法条及真实案例指导的self-Instruct构建的高质量法律文本问答。其目标是使法律知识更加普及,推动法治社会的建设。该项目的开发不仅提高了通用语言大模型在法律领域的表现,还增强了模型回答的可靠性和专业性。

当前挑战

LawGPT_zh面临的挑战主要包括两个方面。首先,在法律领域,模型需要准确理解和应用复杂的法律条文和案例,这对模型的语义理解和逻辑推理能力提出了高要求。其次,在数据集的构建过程中,如何确保数据的质量和代表性是一个重要挑战。尽管使用了ChatGPT清洗和生成数据,但如何保证生成的法律问答既符合法律条文,又能覆盖广泛的法律场景,仍需进一步优化和验证。此外,模型的训练和部署对计算资源的要求较高,如何在保证性能的同时降低资源消耗,也是未来需要解决的问题。

常用场景

经典使用场景

LawGPT_zh数据集在中文法律领域的自然语言处理研究中具有重要应用。该数据集通过结合ChatGLM-6B模型的LoRA 16-bit指令微调,显著提升了模型在法律文本问答中的表现。其经典使用场景包括法律咨询、法律知识问答以及法律文本生成等任务,尤其是在处理复杂的法律条文解释和案例分析时,能够提供专业且可靠的回答。

解决学术问题

LawGPT_zh数据集解决了中文法律领域大模型在专业性和准确性上的不足。通过引入基于法条和真实案例的高质量法律文本问答数据,该数据集显著提升了模型在法律知识理解和推理能力上的表现。其意义在于为法律领域的自然语言处理研究提供了高质量的训练数据,推动了法律智能化的发展,并为构建法治社会提供了技术支持。

实际应用

在实际应用中,LawGPT_zh数据集为法律咨询平台、智能法律助手以及法律教育工具的开发提供了重要支持。例如,用户可以通过该数据集训练的模型快速获取法律问题的专业解答,律师和法律从业者也能利用其进行案例分析和法律条文检索。此外,该数据集还可用于法律文本的自动生成和翻译,提升法律服务的效率和可及性。

数据集最近研究

最新研究方向

近年来,随着人工智能技术的迅猛发展,法律领域的智能化应用逐渐成为研究热点。LawGPT_zh作为中文法律大模型的代表,其研究方向主要集中在提升模型在法律问答中的专业性和可靠性。通过结合ChatGLM-6B LoRA 16-bit指令微调技术,LawGPT_zh不仅能够处理复杂的法律情景对话,还能提供基于法条和真实案例的详细解答。此外,该模型在数据集的构建上采用了self-Instruct方法,确保了数据的高质量和法律依据的准确性。这些技术的应用,不仅推动了法律智能化的进程,也为构建法治社会提供了强有力的技术支持。

以上内容由遇见数据集搜集并总结生成