WizardLMTeam/WizardLM_evol_instruct_70k

收藏Hugging Face2024-03-10 更新2024-06-25 收录

下载链接:

https://hf-mirror.com/datasets/WizardLMTeam/WizardLM_evol_instruct_70k

下载链接

链接失效反馈资源简介:

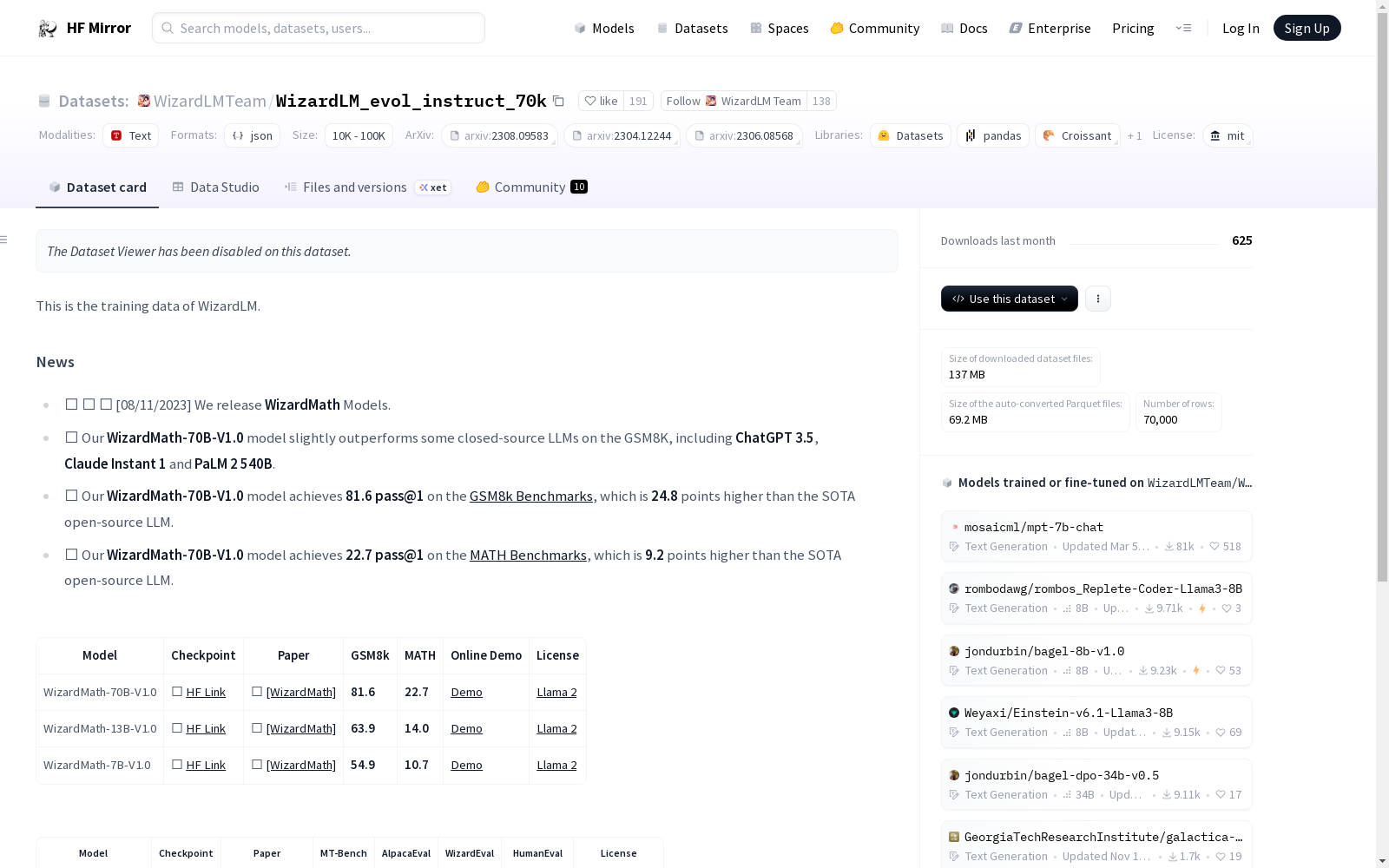

这是WizardLM的训练数据。WizardLM发布了多个版本的WizardMath模型,这些模型在GSM8k和MATH等基准测试中表现出色,尤其是在WizardMath-70B-V1.0模型上,其在GSM8k和MATH基准测试中的表现超过了多个闭源LLM模型,并显著优于现有的开源LLM模型。

这是WizardLM的训练数据。WizardLM发布了多个版本的WizardMath模型,这些模型在GSM8k和MATH等基准测试中表现出色,尤其是在WizardMath-70B-V1.0模型上,其在GSM8k和MATH基准测试中的表现超过了多个闭源LLM模型,并显著优于现有的开源LLM模型。

提供机构:

WizardLMTeam

原始信息汇总

数据集概述

WizardMath 模型

-

WizardMath-70B-V1.0

- GSM8k 成绩: 81.6 pass@1

- MATH 成绩: 22.7 pass@1

- 在线演示: Demo

- 许可证: Llama 2

-

WizardMath-13B-V1.0

- GSM8k 成绩: 63.9 pass@1

- MATH 成绩: 14.0 pass@1

- 在线演示: Demo

- 许可证: Llama 2

-

WizardMath-7B-V1.0

- GSM8k 成绩: 54.9 pass@1

- MATH 成绩: 10.7 pass@1

- 在线演示: Demo

- 许可证: Llama 2

WizardLM 模型

-

WizardLM-13B-V1.2

- MT-Bench 成绩: 7.06

- AlpacaEval 成绩: 89.17%

- WizardEval 成绩: 101.4%

- HumanEval 成绩: 36.6 pass@1

- 许可证: Llama 2 License

-

WizardLM-13B-V1.1

- MT-Bench 成绩: 6.76

- AlpacaEval 成绩: 86.32%

- WizardEval 成绩: 99.3%

- HumanEval 成绩: 25.0 pass@1

- 许可证: Non-commercial

-

WizardLM-30B-V1.0

- MT-Bench 成绩: 7.01

- WizardEval 成绩: 97.8%

- HumanEval 成绩: 37.8 pass@1

- 许可证: Non-commercial

-

WizardLM-13B-V1.0

- MT-Bench 成绩: 6.35

- AlpacaEval 成绩: 75.31%

- WizardEval 成绩: 89.1%

- HumanEval 成绩: 24.0 pass@1

- 许可证: Non-commercial

-

WizardLM-7B-V1.0

- WizardEval 成绩: 78.0%

- HumanEval 成绩: 19.1 pass@1

- 许可证: Non-commercial

-

WizardCoder-15B-V1.0

- HumanEval 成绩: 57.3 pass@1

- 许可证: OpenRAIL-M

搜集汇总

数据集介绍

构建方式

WizardLMTeam/WizardLM_evol_instruct_70k数据集的构建,是在深度学习领域中对大规模语言模型训练的积极探索。该数据集通过精心设计的前置指令学习和基于人类反馈的强化学习技术,对语言模型进行迭代训练,以提升模型在数学任务上的表现。

特点

该数据集的特点在于其专注于数学领域的任务,特别是对数学问题的理解和解决能力进行了强化。数据集包含了大量的数学问题及其解答,覆盖了从基础算术到复杂数学问题的多样性和难度,为模型提供了丰富的学习素材,有助于模型的数学推理能力得到显著提升。

使用方法

使用该数据集时,用户可以通过HuggingFace平台提供的链接直接访问模型。用户需要准备相应的训练环境,遵循数据集的许可协议,按照模型训练的标准流程进行数据加载、预处理和模型训练等步骤,以实现模型在数学任务上的优化和提升。

背景与挑战

背景概述

WizardLMTeam/WizardLM_evol_instruct_70k数据集是WizardLM模型训练的重要资源,由WizardLM团队开发。该数据集的创建旨在推动数学任务处理能力的大规模语言模型的研究,其研究成果于2023年8月11日发布,包括WizardMath模型,该模型在GSM8k和MATH两项基准测试中均取得了显著的性能提升。该数据集的构建,不仅展现了研究团队在数学任务处理领域的前沿探索,也为相关领域的研究提供了强有力的数据支持。

当前挑战

在构建WizardLM_evol_instruct_70k数据集的过程中,研究人员面临了诸多挑战。首先,如何确保数据集能够全面覆盖数学问题的多样性,从而训练出能够处理各种数学任务的模型,是一大挑战。其次,数据的质量控制也是关键,需要确保数据的准确性和可靠性。此外,大规模数据集的构建还需要解决数据收集、处理和存储的技术问题,以及如何高效利用资源进行模型训练的问题。

常用场景

经典使用场景

在自然语言处理领域,WizardLMTeam/WizardLM_evol_instruct_70k数据集以其独特的训练指令和进化学习策略,成为研究文本生成和理解任务的重要资源。该数据集支持模型在数学问题解决等复杂场景中表现出卓越的性能,其经典使用场景主要围绕数学公式理解和生成任务,如数学问题解答、数学公式解析等。

衍生相关工作

基于WizardLM_evol_instruct_70k数据集,学术界衍生出了一系列相关工作,如WizardMath模型的开发,其在数学问题解决方面的性能超过了多个现有模型,为数学教育领域的智能化研究提供了新的视角和工具。此外,该数据集也促进了相关算法和模型的优化,推动了自然语言处理技术的进步。

数据集最近研究

最新研究方向

在自然语言处理领域,数学推理能力是衡量大型语言模型智能水平的重要指标。近期,WizardLM团队发布的WizardLM_evol_instruct_70k数据集,为训练具有卓越数学问题解决能力的模型提供了重要资源。该数据集支持了 WizardMath 模型的开发,其中 WizardMath-70B-V1.0 模型在 GSM8k 和 MATH 基准测试中取得了显著成绩,超过了包括 ChatGPT 3.5 在内的一些闭源大型语言模型。这一成果不仅推动了数学推理任务上的模型性能提升,也为开放源代码模型树立了新的性能标杆,对促进学术界的公平竞争及模型研究的深入发展具有重要意义。

以上内容由遇见数据集搜集并总结生成