SegTrack v2|视频分割数据集|算法评估数据集

收藏

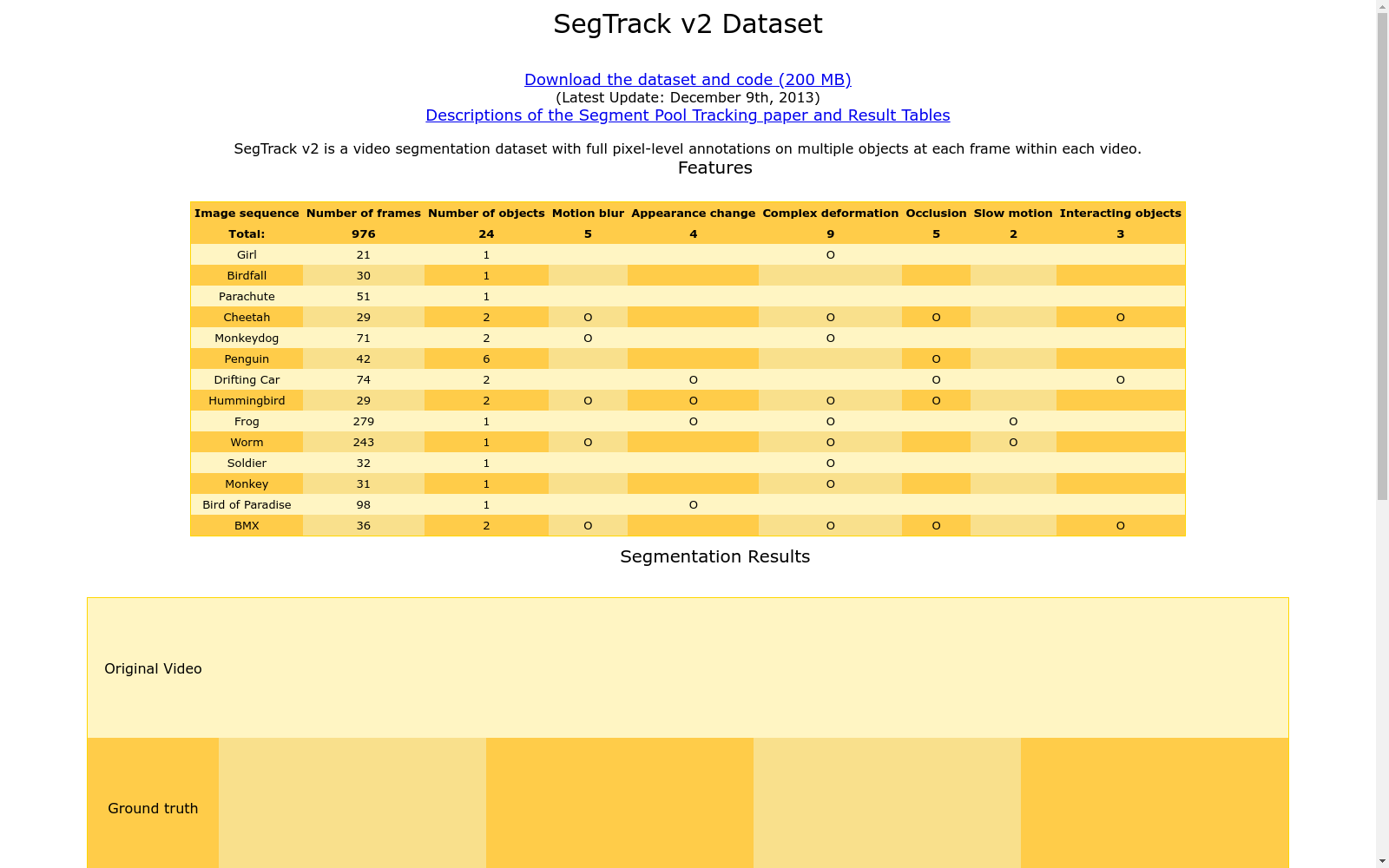

- SegTrack v2数据集首次发表,作为视频分割领域的基准数据集,旨在评估和比较不同视频分割算法的性能。

- SegTrack v2数据集首次应用于多个视频分割算法的研究和实验中,成为该领域的重要参考数据集。

- SegTrack v2数据集被广泛应用于国际计算机视觉会议(CVPR)和欧洲计算机视觉会议(ECCV)等顶级会议的论文中,进一步巩固了其在视频分割研究中的地位。

- SegTrack v2数据集的扩展版本发布,增加了更多的视频样本和标注,以适应日益复杂的视频分割任务需求。

- SegTrack v2数据集被用于深度学习模型的训练和评估,特别是在卷积神经网络(CNN)和循环神经网络(RNN)在视频分割中的应用研究中。

- 1SegTrack v2: Evolution and Extension of the SegTrack FrameworkUniversity of California, Los Angeles · 2013年

- 2Video Object Segmentation with Joint Re-identification and Attention-Aware Mask PropagationTsinghua University · 2019年

- 3Fast Video Object Segmentation by Reference-Guided Mask PropagationSeoul National University · 2018年

- 4Video Object Segmentation with Language-Guided Graph NetworksUniversity of California, Berkeley · 2020年

- 5Learning to Segment Moving Objects in VideosUniversity of Adelaide · 2019年

LFW

人脸数据集;LFW数据集共有13233张人脸图像,每张图像均给出对应的人名,共有5749人,且绝大部分人仅有一张图片。每张图片的尺寸为250X250,绝大部分为彩色图像,但也存在少许黑白人脸图片。 URL: http://vis-www.cs.umass.edu/lfw/index.html#download

AI_Studio 收录

FER2013

FER2013数据集是一个广泛用于面部表情识别领域的数据集,包含28,709个训练样本和7,178个测试样本。图像属性为48x48像素,标签包括愤怒、厌恶、恐惧、快乐、悲伤、惊讶和中性。

github 收录

VoxBox

VoxBox是一个大规模语音语料库,由多样化的开源数据集构建而成,用于训练文本到语音(TTS)系统。

github 收录

CE-CSL

CE-CSL数据集是由哈尔滨工程大学智能科学与工程学院创建的中文连续手语数据集,旨在解决现有数据集在复杂环境下的局限性。该数据集包含5,988个从日常生活场景中收集的连续手语视频片段,涵盖超过70种不同的复杂背景,确保了数据集的代表性和泛化能力。数据集的创建过程严格遵循实际应用导向,通过收集大量真实场景下的手语视频材料,覆盖了广泛的情境变化和环境复杂性。CE-CSL数据集主要应用于连续手语识别领域,旨在提高手语识别技术在复杂环境中的准确性和效率,促进聋人与听人社区之间的无障碍沟通。

arXiv 收录

AgiBot World

为了进一步推动通用具身智能领域研究进展,让高质量机器人数据触手可及,作为上海模塑申城语料普惠计划中的一份子,智元机器人携手上海人工智能实验室、国家地方共建人形机器人创新中心以及上海库帕思,重磅发布全球首个基于全域真实场景、全能硬件平台、全程质量把控的百万真机数据集开源项目 AgiBot World。这一里程碑式的开源项目,旨在构建国际领先的开源技术底座,标志着具身智能领域 「ImageNet 时刻」已到来。AgiBot World 是全球首个基于全域真实场景、全能硬件平台、全程质量把控的大规模机器人数据集。相比于 Google 开源的 Open X-Embodiment 数据集,AgiBot World 的长程数据规模高出 10 倍,场景范围覆盖面扩大 100 倍,数据质量从实验室级上升到工业级标准。AgiBot World 数据集收录了八十余种日常生活中的多样化技能,从抓取、放置、推、拉等基础操作,到搅拌、折叠、熨烫等精细长程、双臂协同复杂交互,几乎涵盖了日常生活所需的绝大多数动作需求。

github 收录