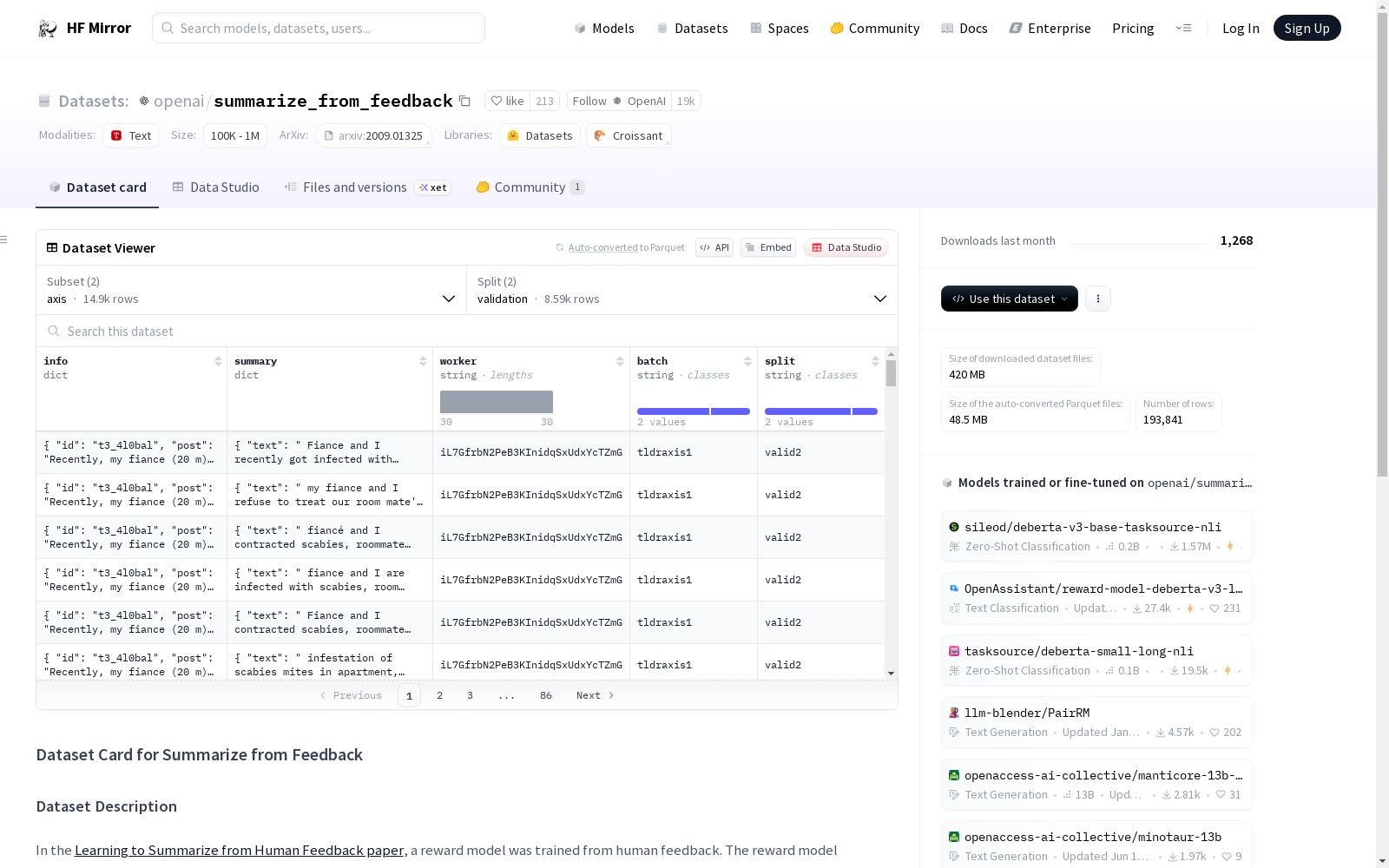

openai/summarize_from_feedback

收藏Hugging Face2023-01-03 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/openai/summarize_from_feedback

下载链接

链接失效反馈资源简介:

在《Learning to Summarize from Human Feedback》论文中,研究人员从人类反馈中训练了一个奖励模型,该模型随后用于训练摘要模型以符合人类偏好。此数据集是为此奖励模型发布的人类反馈数据。数据集分为两部分:comparisons和axis。在comparisons部分,人类注释者被要求从两个摘要中选择最佳摘要。在axis部分,人类注释者对摘要的质量进行了评分。comparisons部分仅包含训练和验证分割,而axis部分仅包含测试和验证分割。用于训练奖励模型的摘要来自TL;DR数据集,额外的验证和测试数据来自TL;DR数据集、CNN文章和Daily Mail文章。

提供机构:

openai

原始信息汇总

数据集概述

数据集名称

- pretty_name: Summarize from Feedback

数据集描述

- 来源与目的: 该数据集源自论文《Learning to Summarize from Human Feedback》,用于训练奖励模型,进而训练出符合人类偏好的摘要模型。

- 数据集组成:

- comparisons: 人类标注者从两个摘要中选择最佳的一个。

- axis: 人类标注者对摘要的质量进行Likert量表评分。

- 数据集分割:

comparisons部分包含训练集和验证集。axis部分包含测试集和验证集。

- 数据来源: 训练奖励模型的摘要数据来自TL;DR数据集,额外的验证和测试数据来自TL;DR数据集、CNN文章和Daily Mail文章。

引用信息

- 论文: Learning to Summarize from Human Feedback

- 作者: Nisan Stiennon, Long Ouyang, Jeff Wu, Daniel M. Ziegler, Ryan Lowe, Chelsea Voss, Alec Radford, Dario Amodei, Paul Christiano

- 发表年份: 2020

- 会议: NeurIPS

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,特别是在文本摘要任务中,本数据集的构建采取了一种基于人类反馈的奖励模型训练方式。该模型首先通过人类标注者的反馈进行训练,进而用于指导摘要模型的训练,以使其与人类偏好保持一致。数据集分为两部分:`comparisons`与`axis`。在`comparisons`部分,标注者需要在两个摘要中选择一个更优的;而在`axis`部分,则是对一个摘要的质量进行李克特量表评分。训练奖励模型所使用的摘要源自TL;DR数据集,而额外的验证和测试数据则来自TL;DR数据集、CNN文章以及Daily Mail文章。

特点

本数据集的特点在于,它提供了直接的人类偏好反馈,这对于训练与人类偏好相符的模型至关重要。`comparisons`部分的数据通过人类标注者的直接选择,为模型训练提供了明确的偏好指示;`axis`部分的数据则通过量化评分,为模型提供了质量评估的细致维度。此外,数据集的来源多样性,使其具有较好的泛化能力,能够适应不同领域的文本摘要任务。

使用方法

使用本数据集时,研究者可以将其分为训练集和验证集,针对`comparisons`和`axis`两部分分别进行不同的训练策略。对于`comparisons`部分,模型需学习如何根据人类偏好选择更优的摘要;对于`axis`部分,模型则需学习如何根据李克特量表评分提升摘要质量。通过这样的训练方式,可以有效地提升模型在文本摘要任务上的表现,尤其是在符合人类偏好方面。

背景与挑战

背景概述

在自然语言处理领域,自动文摘是研究的热点之一,它旨在自动生成文档的简洁摘要。Summarize from Feedback数据集,源自于2020年Nisan Stiennon等研究人员在NeurIPS上发表的论文《Learning to Summarize from Human Feedback》,该数据集的构建旨在通过人类的反馈训练奖励模型,进而训练出与人类偏好相一致的文章摘要模型。该数据集包含了人类反馈的两部分:比较(comparisons)和评分(axis),为研究者在文摘生成领域的探索提供了宝贵的资源,对相关技术的发展产生了重要影响。

当前挑战

Summarize from Feedback数据集在构建过程中面临的挑战主要包括:如何精确捕捉并量化人类对摘要质量的偏好,以及如何利用这些反馈有效地训练模型。在所解决的领域问题上,该数据集的挑战在于如何实现高度自动化且符合人类主观评价标准的摘要生成。此外,构建过程中还需克服数据标注的一致性和质量控制的难题,确保模型训练的可靠性和有效性。

常用场景

经典使用场景

在自然语言处理领域,摘要生成模型的研究与应用至关重要。'Summarize from Feedback'数据集为此提供了有力支撑,其经典使用场景在于,通过人类反馈训练出的奖励模型,进一步指导摘要模型的训练,使其能够生成更符合人类偏好的摘要。

实际应用

在实际应用中,该数据集可被用于改进新闻摘要、文献综述、内容提炼等场景,使得信息获取更为高效精准。它对于提升机器生成的文本质量,满足用户个性化信息需求,具有显著的应用价值。

衍生相关工作

基于此数据集,研究者们开展了多项衍生工作,如进一步探索更复杂的奖励模型、设计更加精细化的评价体系等,这些研究为自然语言处理领域的发展提供了新的视角和方法论。

以上内容由遇见数据集搜集并总结生成