keval-testset

收藏Hugging Face2025-03-12 更新2025-03-13 收录

下载链接:

https://huggingface.co/datasets/davidkim205/keval-testset

下载链接

链接失效反馈官方服务:

资源简介:

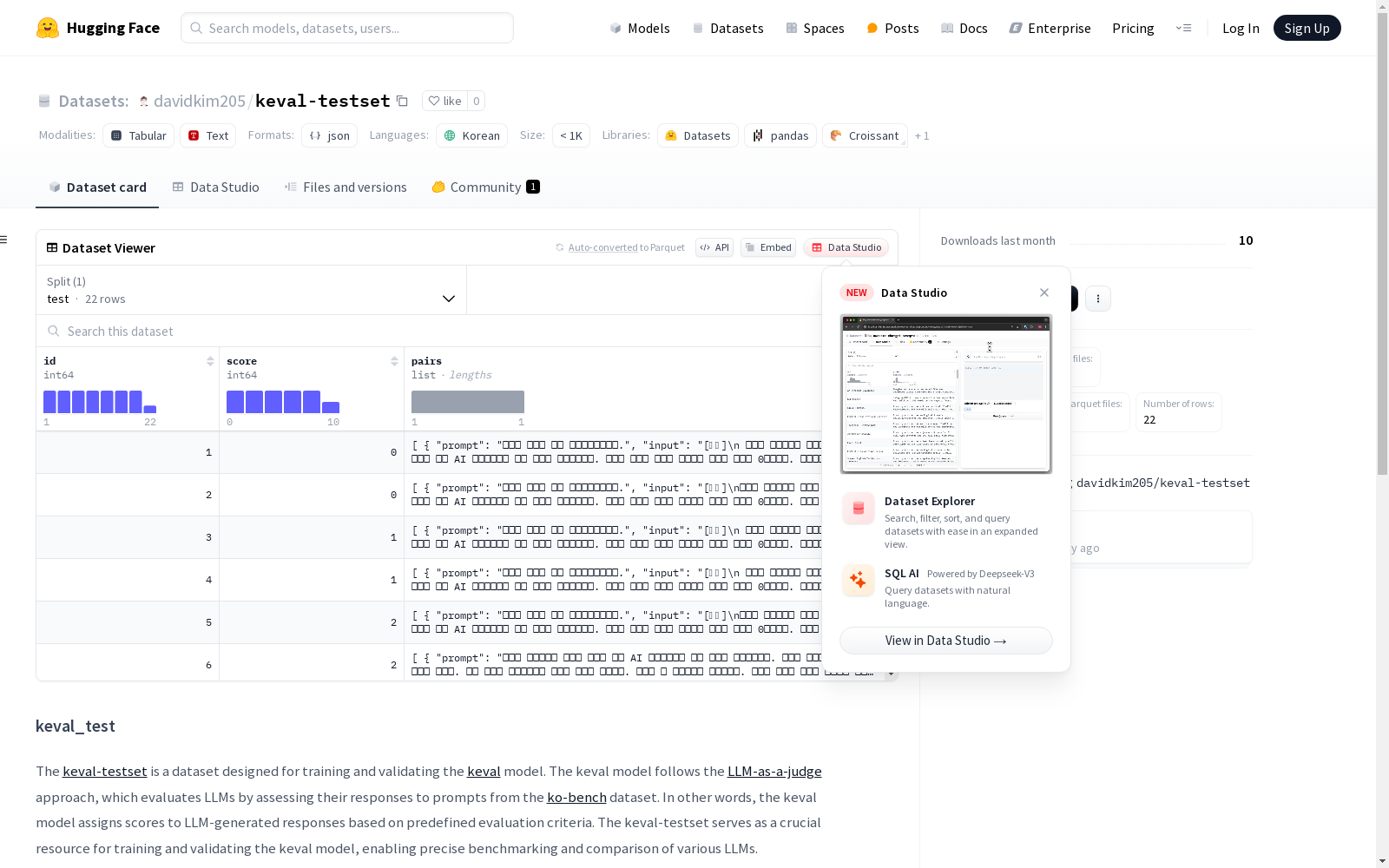

keval-testset是一个用于训练和验证keval模型的数据集,包含22个JSON对象,每个对象包含一个唯一标识符、一个评分以及用于生成和评估LLM响应的元素集合。评分是一个从0到10的整数,作为训练keval模型的标签。

创建时间:

2025-03-11

搜集汇总

数据集介绍

构建方式

keval-testset数据集的构建旨在为keval模型的训练与验证提供基准资源。该数据集依照LLM-as-a-judge的方法论,通过评估LLM对ko-bench数据集提示的回答来评价其性能。数据集以JSONL格式存储,包含22个JSON对象,每个对象由唯一的标识符、评分以及用于生成和评估LLM响应的元素对组成。

使用方法

使用keval-testset数据集时,用户可以依据数据集中的提示和问题向LLM模型请求回答,并根据提供的评分标准对回答进行打分。该数据集适合于模型的训练和验证阶段,以实现对不同LLM模型的精确基准测试和比较。

背景与挑战

背景概述

keval-testset数据集是在语言模型评估领域的一项重要成果,由David Kim等研究人员创建于模型keval的研制过程中。该数据集的主要目的是为了训练和验证keval模型,该模型采用LLM-as-a-judge方法,通过评估LLM对ko-bench数据集提示的回答来评价LLM的性能。keval-testset数据集的构建,为精确地校准和比较不同的大型语言模型提供了关键资源,自发布以来在自然语言处理领域产生了显著影响。

当前挑战

keval-testset数据集在构建和应用过程中面临的主要挑战包括:如何确保评价标准的客观性和一致性,以及如何处理不同语言之间回答的差异性。此外,在构建过程中,数据集的小规模(仅包含22个JSON对象)可能限制了模型的泛化能力,这对于模型的实际应用来说是一个需要解决的难题。同时,该数据集的评价标准依赖于人工设定,这可能会引入主观偏差,影响评估结果的准确性。

常用场景

经典使用场景

keval-testset数据集主要被用于训练及验证keval模型。该模型采纳LLM-as-a-judge的方法,通过评估LLM对ko-bench数据集中的提示作出的反应,为LLM生成的回应赋予分数,从而实现对大型语言模型性能的精确评价。该数据集通过提供预定义的评价标准,使得keval模型能够对不同的LLM进行细致的基准测试和比较。

解决学术问题

keval-testset数据集解决了如何评价大型语言模型(LLM)响应质量的问题。它通过为LLM的回应提供具体的评分标准和基准,使得研究者能够客观、量化地评估LLM的性能,从而推动了自然语言处理领域在模型评估方法上的进步。

实际应用

在实际应用中,keval-testset数据集的应用有助于提升自然语言处理系统的评估准确性,对于开发高效、可靠的AI助手具有重要作用。它使得开发者能够依据模型在实际任务中的表现进行优化,进而提高AI系统的整体性能和用户体验。

数据集最近研究

最新研究方向

keval-testset数据集作为训练及验证keval模型的关键资源,其最新研究方向聚焦于通过精确的基准测试和比较,评估各种大型语言模型(LLM)的生成响应质量。该数据集遵循LLM-as-a-judge方法,不仅促进了keval模型对LLM生成的回答进行评分的能力,而且在自然语言处理领域,特别是在机器学习模型评估标准的制定与优化方面,具有显著影响。当前研究正致力于提高模型对响应的准确性、相关性、深度和创造性的评估能力,从而推动评价体系的发展,为人工智能领域的进步贡献力量。

以上内容由遇见数据集搜集并总结生成