ANetQA

收藏arXiv2023-05-04 更新2024-06-21 收录

下载链接:

https://milvlg.github.io/anetqa

下载链接

链接失效反馈官方服务:

资源简介:

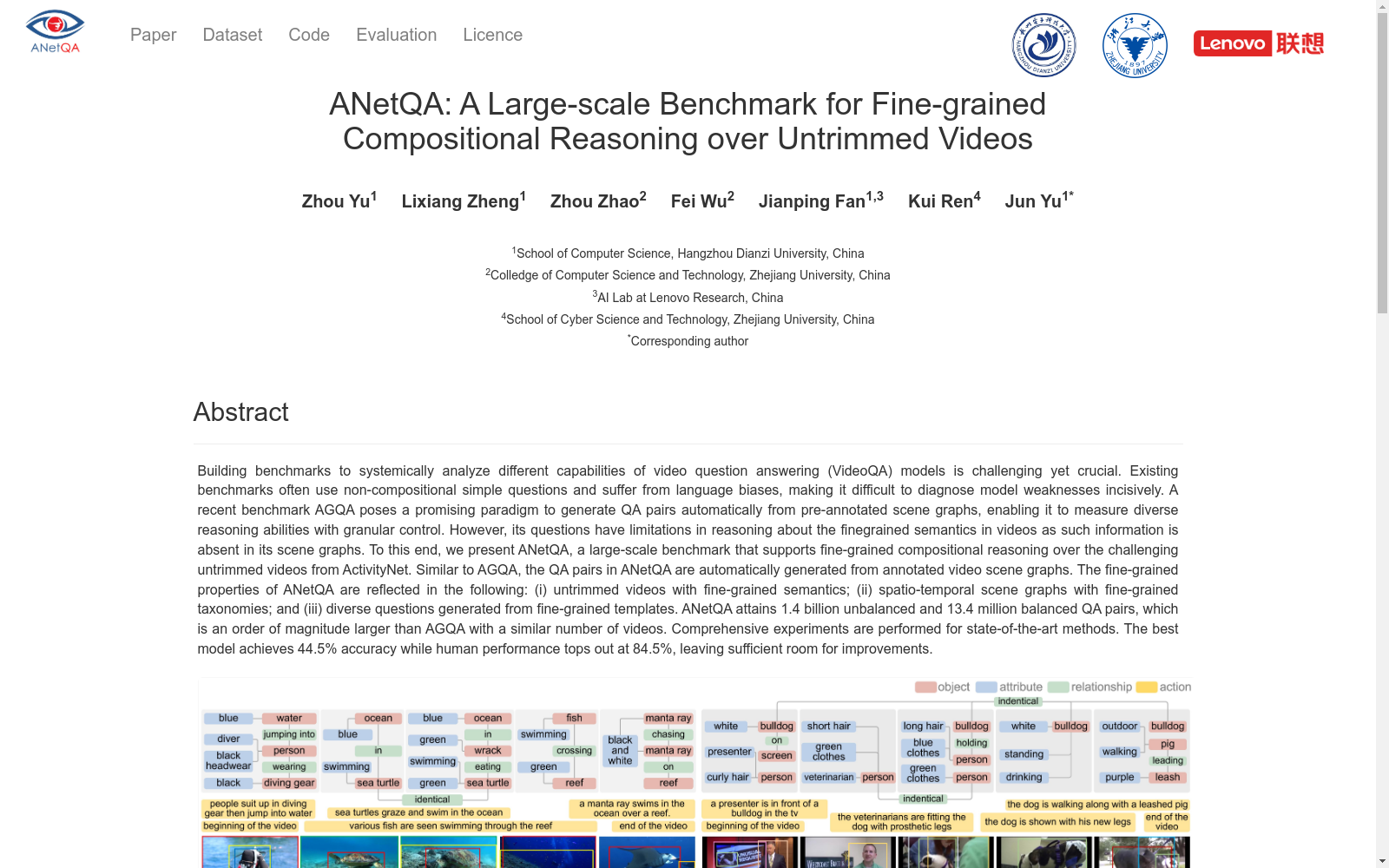

ANetQA是一个大规模的视频问答基准数据集,旨在支持对未剪辑视频的细粒度组合推理。该数据集由杭州电子科技大学计算机学院创建,包含1340万个平衡的问答对。数据集中的问答对自动从标注的视频场景图中生成,反映了视频的细粒度语义、时空场景图和多样化的问答模板。ANetQA适用于评估视频问答模型的多种推理能力,如对象识别、关系理解和属性分析,旨在推动视频与语言学习领域的研究。

ANetQA is a large-scale video question answering (QA) benchmark dataset designed to support fine-grained compositional reasoning over untrimmed videos. Developed by the School of Computer Science, Hangzhou Dianzi University, this dataset includes 13.4 million balanced question-answer pairs. All QA pairs within the dataset are automatically generated from annotated video scene graphs, which capture the fine-grained semantic information, spatiotemporal scene graphs, and diverse QA templates of the corresponding videos. ANetQA can be utilized to evaluate diverse reasoning abilities of video QA models, including object recognition, relational understanding, and attribute analysis, with the objective of advancing research in the video-and-language learning domain.

提供机构:

杭州电子科技大学计算机学院

创建时间:

2023-05-04

搜集汇总

数据集介绍

构建方式

ANetQA 数据集的构建基于 ActivityNet 数据集,通过自动生成问答对的方式构建。首先,利用 ActivityNet 中的视频场景图进行标注,这些场景图包含了细粒度的对象、关系、属性和动作信息。随后,通过手工设计的多样化模板,结合场景图中的元素生成问答对。整个过程确保了问答对的多样性和细粒度推理需求,最终生成了 1.4 亿个不平衡问答对和 1340 万个平衡问答对。

特点

ANetQA 数据集的主要特点在于其细粒度的视频场景图和多样化的问答生成方式。数据集中的视频为未剪辑的长视频,包含丰富的细粒度语义信息。场景图不仅包含对象和关系,还引入了细粒度的属性标注,使得生成的问答对能够涵盖更复杂的推理需求。此外,ANetQA 的问答对数量远超现有基准,提供了更大的挑战性和多样性。

使用方法

ANetQA 数据集适用于视频问答任务,尤其是需要细粒度推理和多模态理解的任务。研究者可以使用该数据集训练和评估视频问答模型,探索其在细粒度推理、时空关系理解等方面的能力。数据集提供了平衡和不平衡的问答对,研究者可以根据需求选择合适的子集进行实验。此外,数据集还提供了详细的场景图和问答生成模板,便于研究者深入分析模型的表现。

背景与挑战

背景概述

ANetQA是由杭州电子科技大学、浙江大学和联想研究院的研究人员共同开发的一个大规模视频问答基准数据集,旨在支持对未剪辑视频的细粒度组合推理。该数据集于2023年发布,基于ActivityNet数据集,通过自动生成从标注的视频场景图中提取的问答对,涵盖了1.4亿个不平衡和1340万个平衡的问答对。ANetQA的核心研究问题是如何在复杂的未剪辑视频中进行细粒度的时空推理,其细粒度特性体现在视频的语义、时空场景图的分类以及多样化的问答模板设计。该数据集的发布对视频问答领域的研究具有重要影响,尤其是对现有模型的细粒度推理能力提出了更高的要求。

当前挑战

ANetQA数据集面临的挑战主要体现在两个方面:首先,其解决的领域问题是视频问答中的细粒度组合推理,这要求模型具备对视频内容的深度理解和复杂的时空推理能力。其次,在构建过程中,数据集的标注和问答对的生成面临诸多挑战,包括如何从复杂的未剪辑视频中提取细粒度的语义信息,如何设计多样化的问答模板以覆盖不同的推理能力,以及如何避免语言偏见和答案分布的简单化。此外,ANetQA的问答对数量庞大,且问题复杂度较高,导致现有模型的表现与人类水平仍有较大差距,这为未来的研究提供了广阔的改进空间。

常用场景

经典使用场景

ANetQA 数据集的经典使用场景在于其支持对未修剪视频进行细粒度的组合推理。通过自动生成的问答对,研究者可以评估模型在复杂视频场景中的时空推理能力。例如,模型需要回答关于视频中物体颜色、动作关系等细粒度问题,这些问题要求模型不仅理解视频内容,还需进行复杂的时空推理。

解决学术问题

ANetQA 数据集解决了现有视频问答基准中存在的语言偏差和简单问题表达的问题。通过引入细粒度的时空场景图和多样化的问答模板,ANetQA 能够更准确地诊断模型在细粒度语义推理上的弱点,推动视频问答模型在复杂场景中的表现提升。

衍生相关工作

ANetQA 数据集的发布催生了一系列相关研究,特别是在视频问答和多模态学习领域。例如,基于 ANetQA 的研究者们开发了新的模型架构,如 HCRN、ClipBERT 和 All-in-One,这些模型在细粒度视频理解任务中表现出色。此外,ANetQA 还启发了对视频问答基准的进一步优化,推动了视频与语言结合的研究进展。

以上内容由遇见数据集搜集并总结生成