dMelodies

收藏arXiv2020-07-30 更新2024-06-21 收录

下载链接:

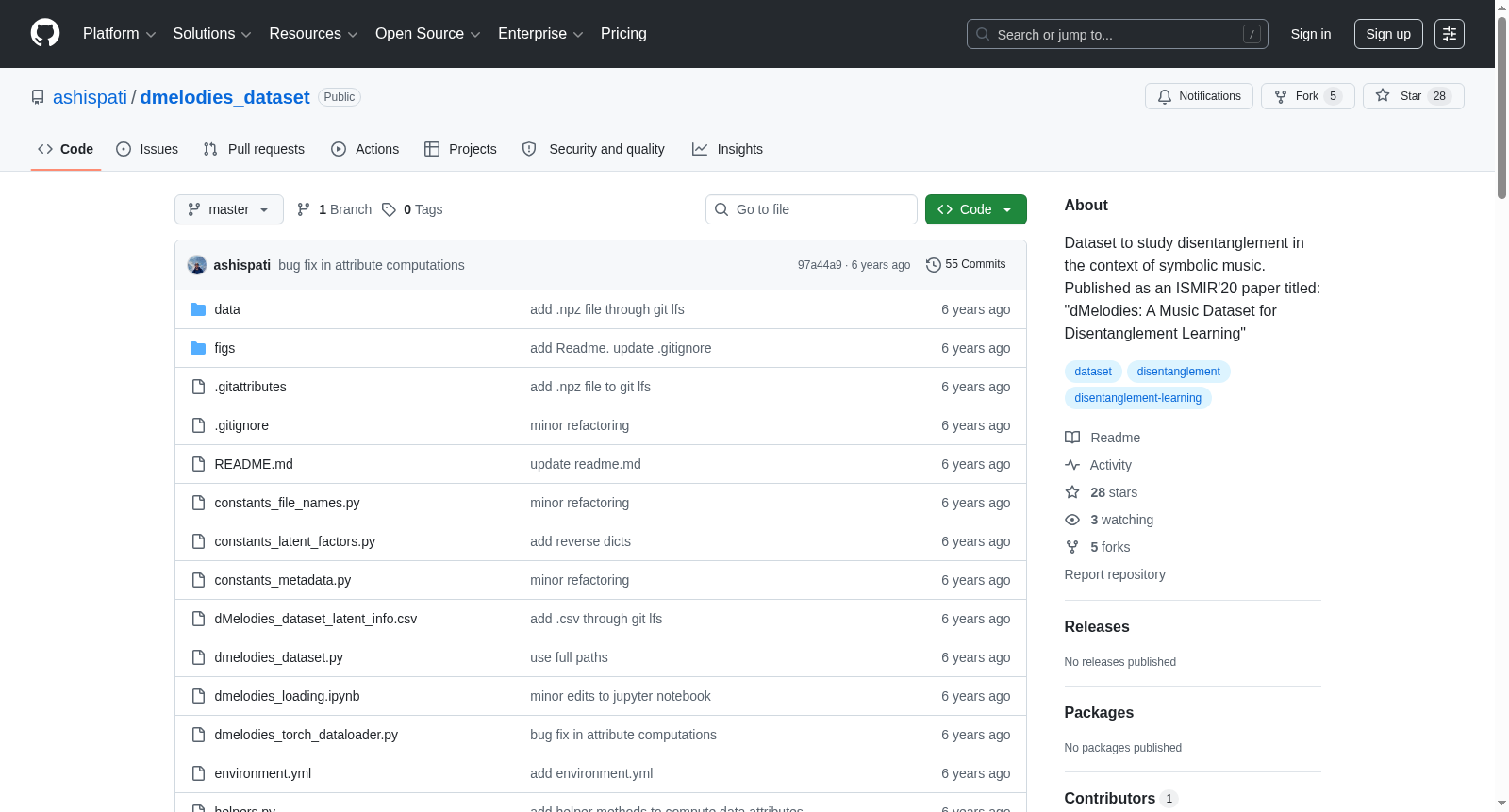

https://github.com/ashispati/dmelodies_dataset

下载链接

链接失效反馈资源简介:

dMelodies是一个专为解耦学习设计的音乐数据集,由佐治亚理工学院音乐技术中心创建。该数据集包含约135万条2小节的单音旋律,每条旋律由九个潜在因素的独特组合生成,涵盖序数、类别和二进制类型。数据集的创建过程遵循简单而多样的独立潜在因素设计原则,确保了数据点的独立性和可区分性。dMelodies数据集主要应用于音乐信息检索和生成音乐模型领域,旨在通过解耦学习提高音乐生成工具的实用性和控制性,解决音乐领域中的解耦表示学习问题。

提供机构:

佐治亚理工学院音乐技术中心

创建时间:

2020-07-30

搜集汇总

数据集介绍

构建方式

在音乐信息检索领域,为促进解耦学习研究,dMelodies数据集通过算法化方式构建。该数据集基于九个独立潜在因子,涵盖序数、类别和二元类型,生成了约130万条两小节单音旋律。每条旋律均以I-IV-V-I和弦进行为基础,采用琶音模式,并固定为12个音符序列。通过音乐21工具包生成,确保了数据点的唯一性与因子间的独立性,从而为解耦算法提供了结构清晰且规模充足的训练与测试资源。

使用方法

该数据集适用于解耦表示学习的算法评估与比较研究。用户可通过加载数据集,利用变分自编码器等模型进行无监督或半监督训练,以探索因子分离效果。数据集提供标准化的数据表示,如符号化编码,便于输入神经网络架构。研究者可进一步结合解耦度量指标,如互信息间隙与模块性,分析算法在音乐属性上的表现,从而推动跨领域解耦方法的通用性验证与优化。

背景与挑战

背景概述

在表征学习领域,解耦学习旨在从数据中分离出潜在的变化因素,以提升生成模型的解释性与可控性。然而,该领域的研究长期依赖计算机视觉数据集,缺乏针对音乐领域的标准化基准。为填补这一空白,乔治亚理工学院音乐技术中心的Ashis Pati、Siddharth Gururani与Alexander Lerch于2020年共同创建了dMelodies数据集。该数据集专注于符号音乐领域,包含约130万条两小节单音旋律,每条旋律由九个独立潜在因子组合生成,涵盖序数、类别与二元类型。其核心研究问题在于为音乐解耦学习提供统一评估基准,推动跨领域算法的泛化能力研究,并对音乐信息检索与生成模型的系统性发展产生深远影响。

当前挑战

dMelodies数据集面临的挑战主要体现在两方面:其一,在领域问题层面,音乐解耦学习需处理复杂语义属性(如调性、节奏与轮廓)的分离,而现有基于图像的方法难以直接迁移至音乐域,导致解耦性能与重建精度之间存在显著权衡;其二,在构建过程中,为确保因子独立性与数据规模,设计者必须平衡音乐真实性与算法需求,例如采用简化和弦进行与受限节奏模式,这虽保证了数据集的规范性,却可能削弱其反映真实音乐复杂性的能力。

常用场景

经典使用场景

在音乐信息检索与生成模型的研究中,dMelodies数据集被广泛应用于解耦表示学习的算法评估与验证。该数据集通过算法生成超过130万条两小节单音旋律,每条旋律由九个独立潜在因子组合而成,涵盖音调、音阶、节奏等音乐属性。研究者利用这一数据集,能够系统测试无监督或半监督解耦方法在音乐领域的泛化能力,为跨域表示学习提供标准化基准。

解决学术问题

dMelodies数据集主要解决了音乐领域缺乏标准化解耦学习基准的问题。以往研究多依赖计算机视觉数据集,导致算法在音乐域的泛化能力难以评估。该数据集通过明确定义的潜在因子,如音调类别、节奏模式等,使研究者能够客观衡量解耦算法对音乐语义属性的分离效果,推动了跨域表示学习理论的发展,并为音乐生成、风格迁移等任务提供了可解释的潜在空间建模基础。

实际应用

在实际应用中,dMelodies数据集为交互式音乐生成工具的开发提供了关键支持。基于解耦表示的学习模型能够独立控制旋律的特定属性,例如调整节奏模式或变换音阶,从而增强音乐创作的可控性与多样性。该数据集还可用于音乐教育软件,通过可视化潜在因子帮助学生理解音乐结构,或辅助自动化作曲系统生成符合特定风格要求的旋律片段。

数据集最近研究

最新研究方向

在音乐信息检索领域,dMelodies数据集作为首个专为解耦学习设计的符号音乐数据集,正推动着跨领域表示学习的前沿探索。该数据集通过算法生成包含九种独立潜在因素的旋律,为研究者提供了评估解耦算法在音乐域泛化能力的标准化基准。当前研究热点聚焦于如何将图像域中成熟的解耦方法(如β-VAE、Annealed-VAE和FactorVAE)适配至音乐数据结构,同时探索半监督或监督学习范式以提升对节奏、调性等音乐属性的可控生成。这些进展不仅深化了对跨域解耦算法敏感性的理解,也为交互式音乐生成、风格迁移等应用奠定了可解释、可操控的表示基础,标志着音乐人工智能向细粒度语义控制迈出了关键一步。

相关研究论文

- 1dMelodies: A Music Dataset for Disentanglement Learning佐治亚理工学院音乐技术中心 · 2020年

以上内容由遇见数据集搜集并总结生成