多模态情感聊天翻译数据集(MSCTD)

收藏arXiv2022-02-28 更新2024-06-21 收录

下载链接:

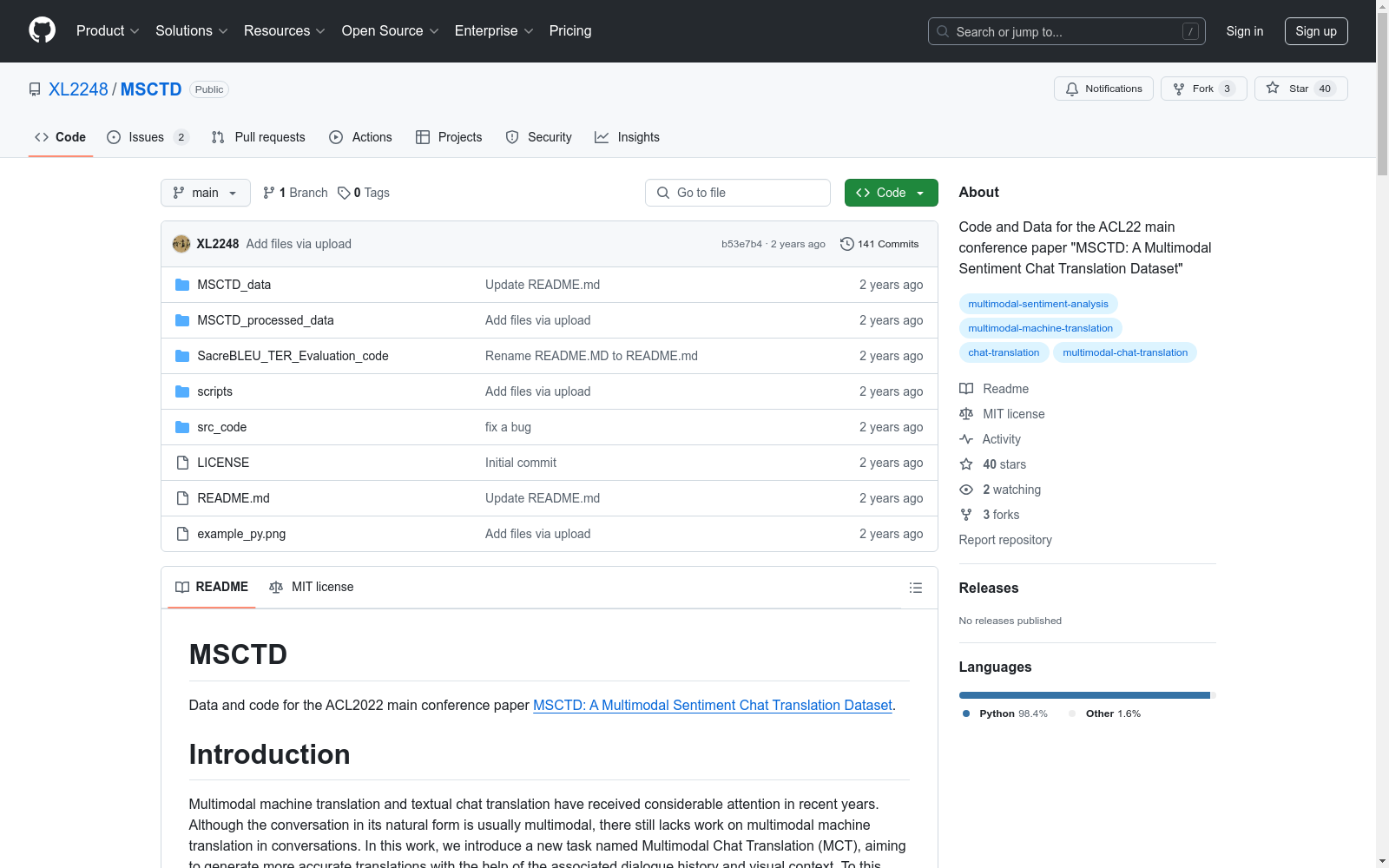

https://github.com/XL2248/MSCTD

下载链接

链接失效反馈资源简介:

多模态情感聊天翻译数据集(MSCTD)由北京交通大学和腾讯微信AI模式识别中心共同创建,包含17,841个多模态双语对话,总计173,240个<英语语句, 中文/德语语句, 图像, 情感>四元组。数据集通过自动和人工标注两个步骤构建,确保了数据的质量和多样性。每个语句对都与反映当前对话场景的视觉上下文相对应,并标注有情感标签。MSCTD不仅用于多模态聊天翻译研究,还为多模态对话情感分析提供了新的基准,旨在通过整合对话历史和视觉上下文,生成更准确的翻译,并解决多模态机器翻译在对话中的挑战。

Multimodal Sentiment Chat Translation Dataset (MSCTD) was jointly created by Beijing Jiaotong University and Tencent WeChat AI Pattern Recognition Center. It contains 17,841 multimodal bilingual dialogues, totaling 173,240 quadruples in the format of <English utterance, Chinese/German utterance, image, sentiment>. The dataset is constructed via two stages: automatic annotation and manual annotation to ensure its quality and diversity. Each utterance pair is paired with a visual context corresponding to the current dialogue scenario, and is annotated with a sentiment label. MSCTD can be used not only for research on multimodal chat translation, but also provides a new benchmark for multimodal dialogue sentiment analysis. It aims to generate more accurate translations by integrating dialogue history and visual context, and address the challenges of multimodal machine translation in dialogue scenarios.

提供机构:

北京交通大学北京交通数据分析与挖掘重点实验室

创建时间:

2022-02-28

AI搜集汇总

数据集介绍

构建方式

多模态情感聊天翻译数据集(MSCTD)的构建基于OpenViDial数据集,该数据集包含与图像对应的单语(英语)话语。为了构建MSCTD,研究团队首先对OpenViDial中的英语话语进行了校正,并为其标注了相应的中文和德语翻译以及情感标签。具体步骤包括自动标注和人工标注两个阶段。自动标注阶段利用构建的双语字幕数据库,通过完美匹配英语字幕来选择中文翻译,约有78.57%的原始英语话语被成功配对。人工标注阶段则由三位精通英语的中国研究生根据标注规则进行,确保翻译和情感标签的准确性。

特点

MSCTD数据集的显著特点在于其多模态性和情感标注的细致性。该数据集包含了142,871对英语-中文话语和30,370对英语-德语话语,每对话语均附有反映当前对话场景的视觉上下文,并标注了情感标签(积极、中性、消极)。此外,MSCTD还提供了两个新的多模态对话情感分析基准,进一步丰富了数据集的应用场景。

使用方法

MSCTD数据集可广泛应用于多模态机器翻译和对话情感分析研究。研究者可以利用该数据集训练和评估多模态翻译模型,通过融合对话历史和视觉上下文信息,提升翻译的准确性。同时,MSCTD的情感标注特性使其成为对话情感分析任务的理想数据集,研究者可以探索视觉信息和对话历史对情感分类的影响,推动多模态对话情感分析领域的发展。

背景与挑战

背景概述

多模态情感聊天翻译数据集(MSCTD)由北京交通大学和腾讯微信人工智能中心的研究团队共同创建,旨在解决多模态机器翻译在对话中的应用问题。该数据集包含了142,871对英汉对话和30,370对英德对话,每对对话都附有情感标签和视觉上下文信息。MSCTD的构建标志着多模态对话翻译研究的一个重要里程碑,为研究者提供了一个丰富的资源来探索对话历史和视觉信息在翻译中的作用。

当前挑战

MSCTD在构建过程中面临多项挑战。首先,多模态对话翻译本身就是一个复杂的问题,需要同时处理文本和视觉信息,这增加了模型的复杂性和计算需求。其次,数据集的标注工作涉及多语言和多模态的精确对齐,确保情感标签和视觉上下文的一致性是一个技术难题。此外,如何有效地融合多模态信息以提高翻译的准确性和情感识别的精度,也是当前研究面临的主要挑战。

常用场景

经典使用场景

多模态情感聊天翻译数据集(MSCTD)在多模态机器翻译和文本聊天翻译领域中具有经典应用场景。该数据集通过整合对话历史和视觉上下文,旨在生成更准确的翻译。具体应用包括在多语言对话中,利用视觉信息和对话历史来辅助翻译,特别是在处理多义词、代词指代和情感表达时,视觉上下文提供了关键的补充信息。

解决学术问题

MSCTD解决了多模态机器翻译在对话场景中的缺失问题,填补了多模态双语对话数据集的空白。通过提供包含视觉上下文和情感标签的大规模对话数据,该数据集促进了多模态聊天翻译和多模态对话情感分析的研究。其意义在于推动了多模态信息融合技术的发展,提升了翻译系统的准确性和情感理解能力。

衍生相关工作

基于MSCTD,研究者们开发了多种多模态聊天翻译和对话情感分析模型。例如,多任务学习模型CA-MCT通过整合视觉特征和情感特征,显著提升了翻译质量。此外,MSCTD还促进了多模态对话情感分析的研究,推动了如DialogueRNN和BERT等先进模型在该领域的应用。这些衍生工作不仅提升了翻译和情感分析的准确性,还为多模态信息处理技术的发展提供了新的方向。

以上内容由AI搜集并总结生成