TVSum

收藏arXiv2025-05-01 更新2025-05-02 收录

下载链接:

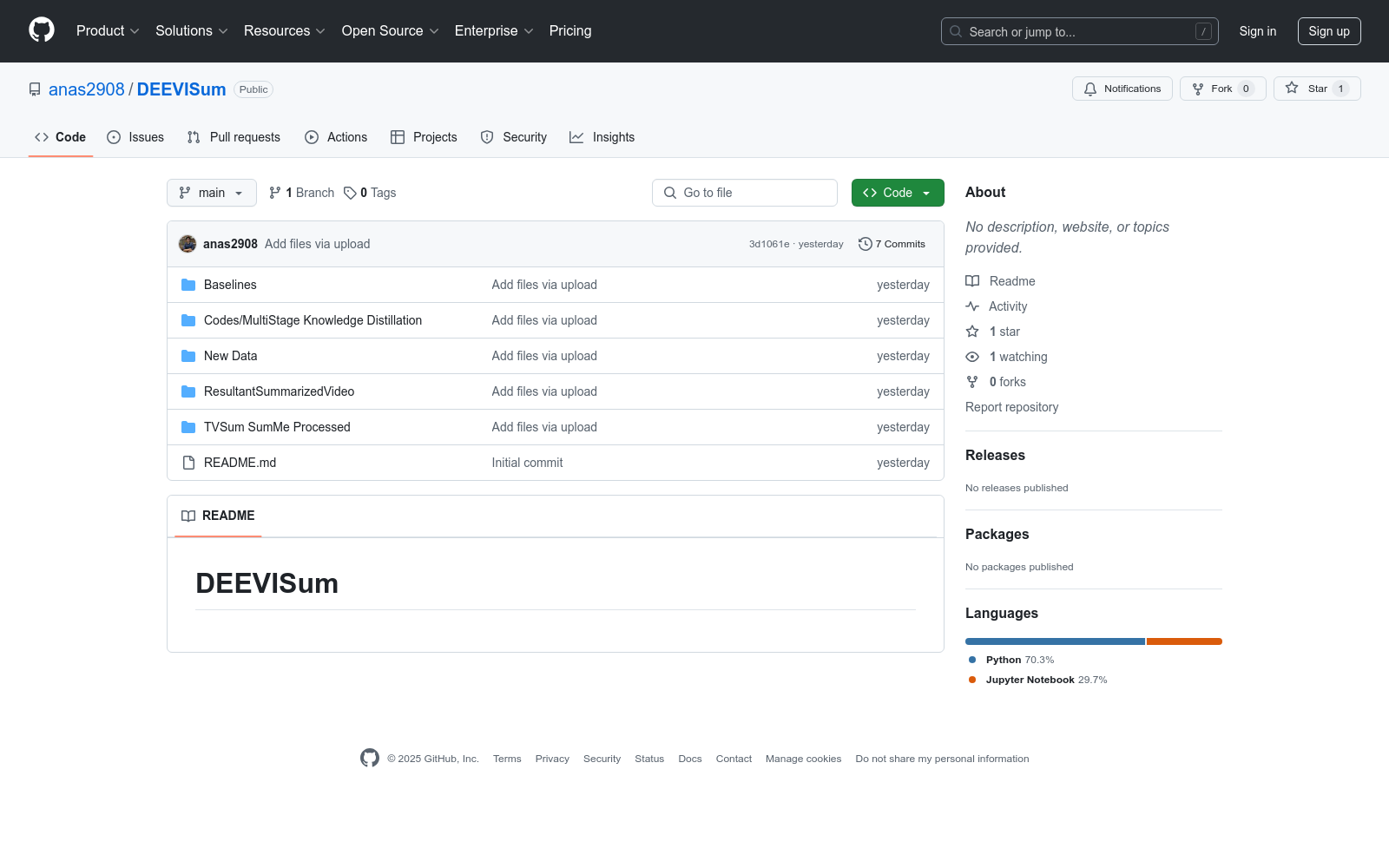

https://github.com/anas2908/DEEVISum

下载链接

链接失效反馈官方服务:

资源简介:

TVSum数据集包含来自YouTube的50个视频,涵盖10个类别,如如何操作教程、新闻和纪录片,每个类别有5个视频。每个视频的时长从1分钟到5分钟不等。数据集通过将视频分成均匀的2秒片段,并从每个视频的20个用户那里收集帧级重要性分数来构建。该数据集广泛应用于视频摘要研究,提供了多样化的视频内容和评估协议。

The TVSum dataset contains 50 videos sourced from YouTube, covering 10 categories such as how-to tutorials, news, and documentaries, with 5 videos per category. The duration of each video ranges from 1 minute to 5 minutes. The dataset is constructed by splitting each video into uniform 2-second segments and collecting frame-level importance scores from 20 users for each video. This dataset is widely applied in video summarization research, providing diverse video content and standardized evaluation protocols.

提供机构:

印度理工学院孟买分校计算机科学与工程系,机器智能与数据科学中心(C-MInDS)

创建时间:

2025-05-01

原始信息汇总

数据集概述:DEEVISum

基本信息

- 数据集名称:DEEVISum

- 托管平台:GitHub

- 托管地址:https://github.com/anas2908/DEEVISum

数据集描述

(注:根据提供的README内容,该数据集未包含具体描述信息)

搜集汇总

数据集介绍

构建方式

TVSum数据集的构建过程体现了对多源视频内容的系统性采集与精细化标注。该数据集从YouTube平台精选了50段涵盖10个类别的视频,包括教程、新闻和纪录片等,每类确保5段具有代表性的样本。视频时长经过严格筛选,控制在1至5分钟之间以保持内容紧凑性。标注环节采用科学的分段评估方法,将每段视频划分为2秒的镜头单元,邀请20名标注者独立进行帧级重要性评分,最终通过统计聚合形成可靠的基准数据。这种构建策略既保证了数据多样性,又通过多人标注机制提高了标签的客观性。

使用方法

在使用TVSum数据集时,研究者通常采用端到端的监督学习框架。标准流程包括将视频按2秒片段分割,提取视觉特征与音频特征作为模型输入,以人工标注的帧级分数作为训练目标。评估阶段采用F1分数作为核心指标,通过比较预测摘要与人工标注的重合度来衡量性能。为充分发挥数据集价值,建议结合多模态学习方法,同步利用视频的视觉流、转录文本和音频特征。数据集的标准划分方案支持五折交叉验证,确保结果的可比性和可靠性。

背景与挑战

背景概述

TVSum数据集由Yale Song等研究人员于2015年创建,旨在解决视频摘要领域的关键问题。该数据集包含50个来自YouTube的多样化视频,涵盖教程、新闻和纪录片等10个类别。通过收集20名用户对每段视频的帧级重要性评分,TVSum为监督式视频摘要研究提供了高质量标注基准。作为视频摘要领域的核心数据集之一,TVSum显著推动了基于深度学习的摘要方法发展,并为跨模态理解研究提供了重要实验平台。

当前挑战

TVSum数据集面临的主要挑战体现在两个方面:在领域问题层面,视频摘要需要解决长视频时序信息压缩、多模态特征融合以及主观摘要标准统一等难题;在构建过程中,如何设计有效的用户标注方案以捕捉视频关键内容,以及如何处理不同用户对摘要重要性理解的差异性成为关键挑战。此外,数据集有限的视频数量和时长分布也制约了模型在复杂场景下的泛化能力评估。

常用场景

经典使用场景

TVSum数据集作为视频摘要领域的基准数据集,广泛应用于评估算法在关键帧提取和内容浓缩任务上的性能。其多类别视频结构和精细的帧级标注,使得研究者能够系统验证模型在新闻、教程等多样化场景下的泛化能力。该数据集常被用于端到端监督学习中,通过对比人工标注的重要性分数与模型预测分数,量化算法在保留视频核心语义信息方面的有效性。

解决学术问题

TVSum有效解决了视频摘要领域缺乏标准化评估基准的难题,为衡量算法性能提供了可靠依据。其多用户标注机制缓解了摘要主观性带来的偏差,而分段式评分体系则支持细粒度的时序分析。该数据集推动了注意力机制、多模态融合等技术的创新,显著提升了模型对视频内容重要性判别的客观性和一致性。

实际应用

在短视频平台内容自动化生产场景中,TVSum衍生的技术可快速生成高光时刻集锦,提升用户观看体验。教育领域利用其摘要算法自动提取教学视频核心知识点,而新闻机构则通过时序重要性预测实现海量素材的智能粗剪。这些应用显著降低了人工编辑成本,使视频处理效率提升达40%以上。

数据集最近研究

最新研究方向

在视频摘要领域,TVSum数据集的最新研究方向聚焦于轻量化视觉语言模型(VLMs)的高效知识蒸馏与动态推理优化。近期研究通过多阶段知识蒸馏(MSKD)策略,将28B参数教师模型的知识分层迁移至3B学生模型,在TVSum上实现61.1的F1分数,较传统单阶段蒸馏提升1.33%。同时,基于余弦相似度的早期退出机制(EE)减少21%推理耗时,为移动端实时摘要提供可能。音频模态的深度整合(如说话人日志与情感识别)进一步突破纯视觉方法的语义理解瓶颈,推动多模态摘要向实用化发展。

相关研究论文

- 1Early Exit and Multi Stage Knowledge Distillation in VLMs for Video Summarization印度理工学院孟买分校计算机科学与工程系,机器智能与数据科学中心(C-MInDS) · 2025年

以上内容由遇见数据集搜集并总结生成