CMRC 2019

收藏arXiv2020-11-02 更新2024-06-21 收录

下载链接:

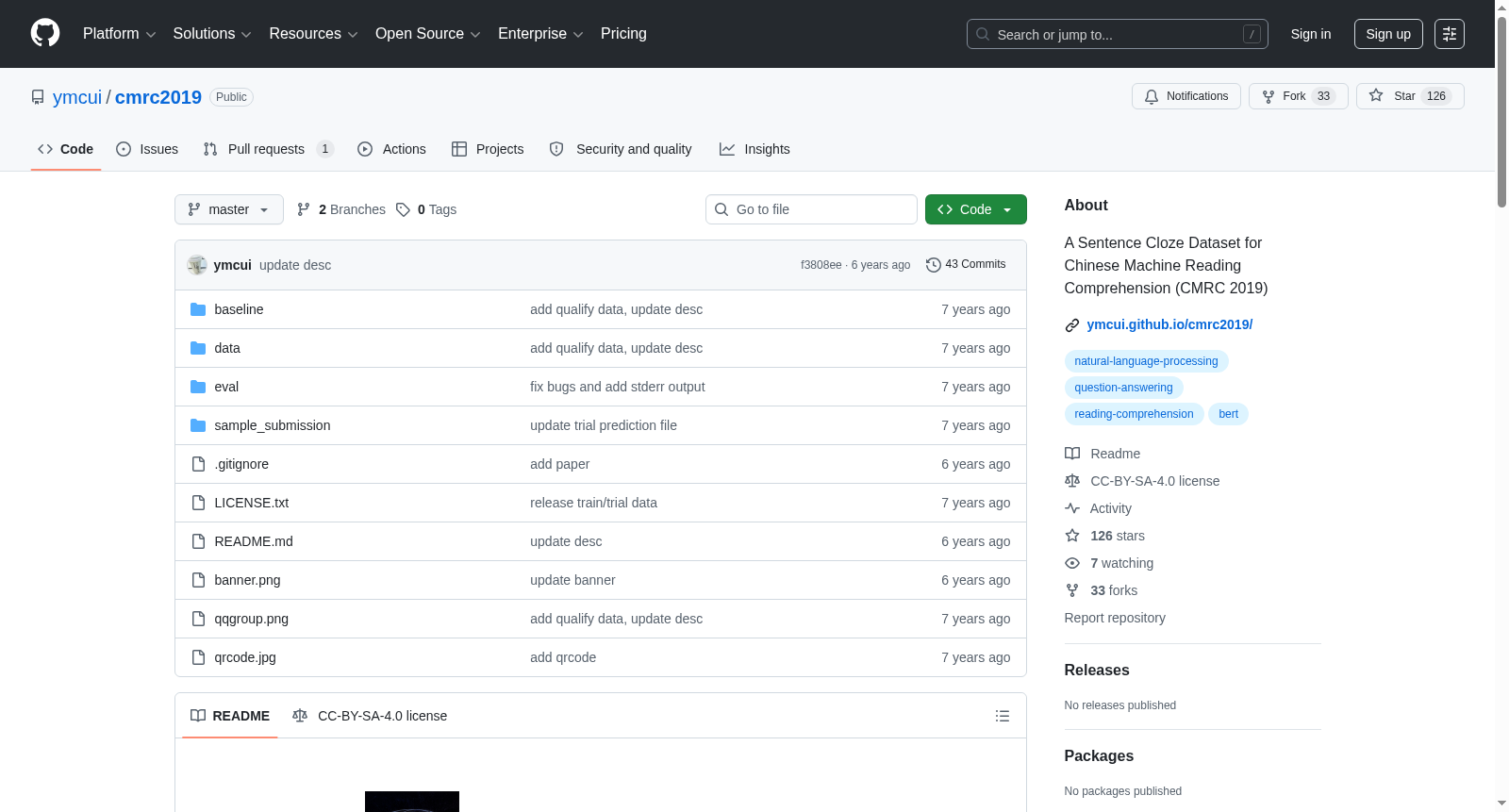

https://github.com/ymcui/cmrc2019

下载链接

链接失效反馈资源简介:

CMRC 2019是由哈尔滨工业大学社会计算与信息检索研究中心和科大讯飞认知智能国家重点实验室联合创建的中文机器阅读理解数据集,包含超过10万个空白(问题)分布在1万多篇源自中文叙事故事的文本中。数据集通过精心设计,引入了假候选句子以增加难度,要求机器在填充空白时进行句子级别的推理并识别真假句子。该数据集主要用于评估和提升机器在处理复杂语言理解任务时的能力,特别是在需要综合多线索进行推理的场景中。

提供机构:

哈尔滨工业大学社会计算与信息检索研究中心

创建时间:

2020-04-07

搜集汇总

数据集介绍

构建方式

在机器阅读理解领域,为探索句子层面的推理能力,CMRC 2019数据集采用了一种创新的构建方法。该数据集以中文叙事故事为原始素材,从中筛选出字符长度在500至750之间的段落,确保内容既不过于简短也不过于冗长。通过语言技术平台进行句子分割,并依据逗号或句号标记选取10至30个字符的句子作为空白处的候选句。构建过程中,首句通常被保留以维持主题连贯性,同时避免选择过长的连续空白。此外,为了增加任务难度,数据集引入了来自同一故事但未被选入段落的自然句子作为虚假候选,这些句子在主题和命名实体上与原文保持一致,从而有效测试模型对真实信息的辨识能力。

特点

CMRC 2019数据集在中文机器阅读理解领域展现出独特的特点。其核心在于句子完形填空任务,要求模型不仅进行词汇或片段级别的推断,还需执行句子层级的推理,以恢复故事的逻辑顺序。数据集包含超过10,000个段落和100,000个空白,规模庞大且覆盖广泛。一个显著特征是引入了虚假候选句,这些句子源自同一故事的其他部分,与真实候选在语义和实体上高度相似,从而提升了任务的挑战性,迫使模型进行更深入的上下文理解。数据集的评估指标包括问题级准确率和段落级准确率,后者强调对整个段落连贯性的把握,反映了对长距离推理能力的高要求。

使用方法

CMRC 2019数据集的使用方法侧重于句子完形填空任务的实现与评估。研究人员通常将段落中的空白处替换为特殊标记,并将候选句与段落拼接作为输入序列。基于预训练语言模型如BERT或RoBERTa,系统学习预测每个候选句填入空白的概率,并通过交叉熵损失进行优化。解码时,模型为每个空白选择概率最高的候选句作为答案,同时需区分虚假候选。评估过程采用问题级准确率和段落级准确率双重指标,后者要求所有空白均被正确填充,以全面衡量模型的句子推理和整体连贯性能力。数据集的训练集不包含虚假候选,旨在测试模型的泛化性能,而开发集和测试集则包含虚假候选以模拟真实挑战。

背景与挑战

背景概述

在自然语言处理领域,机器阅读理解作为评估人工智能理解文本能力的关键任务,其发展历程中涌现了多种数据集以推动模型进步。CMRC 2019数据集由哈尔滨工业大学社会计算与信息检索研究中心与科大讯飞认知智能国家重点实验室联合研发,于2020年正式发布,旨在填补中文句子级推理阅读理解的空白。该数据集聚焦于句子完形填空式机器阅读理解任务,通过从中文叙事故事中选取超过一万个段落并生成十万余个空白问题,要求模型依据上下文逻辑选择正确句子填入空白,从而深化对长距离推理与篇章连贯性的考察。CMRC 2019的推出不仅丰富了中文阅读理解数据集的多样性,更为预训练模型在复杂语境下的性能评估提供了重要基准,促进了中文自然语言处理技术在深层语义理解方向的发展。

当前挑战

CMRC 2019数据集所应对的核心挑战在于提升机器在句子级推理与篇章连贯性理解方面的能力。传统阅读理解任务多集中于词语或片段层面的抽取,而该任务要求模型在多个空白处选择合适句子,需综合把握叙事逻辑、时序关系及语义衔接,这对机器的长距离推理与上下文整合提出了更高要求。在数据集构建过程中,研究人员面临如何确保空白生成的合理性与挑战性的难题,包括避免选取首句等关键信息、控制句子长度以平衡难度,并设计具有干扰性的虚假候选句。虚假候选句需与原文主题一致且包含相同命名实体,同时保持自然语言特征以增加判别难度,这要求构建策略在自动化生成与人工校验间取得平衡,以保障数据质量与评估效度。

常用场景

经典使用场景

在自然语言处理领域,机器阅读理解任务旨在评估模型对文本的深层理解能力。CMRC 2019数据集作为中文句子完形填空任务的代表性资源,其经典使用场景聚焦于评估模型在叙事性文本中进行句子级推理的能力。该数据集通过从儿童故事中选取段落并构建多个空白,要求模型从候选句子中选择正确选项以恢复原文连贯性,从而检验模型对上下文逻辑关系和语义连贯性的把握。

衍生相关工作

基于CMRC 2019数据集,研究者们衍生出一系列经典工作,主要集中在模型优化与任务拓展方面。例如,多项研究利用该数据集验证了BERT、RoBERTa等预训练模型在中文句子级推理任务上的性能边界,并提出了针对性的改进策略,如伪数据生成、数据增强及模型集成方法。这些工作不仅推动了中文机器阅读理解技术的发展,也为后续多语言句子完形填空数据集的构建提供了方法论参考。

数据集最近研究

最新研究方向

在自然语言处理领域,机器阅读理解任务正逐步从词级或片段级推理向更复杂的句子级推理演进。CMRC 2019数据集的推出,填补了中文句子完形填空任务的空白,其核心在于要求模型在叙事性文本中完成句子级别的逻辑排序与真伪候选句的判别。当前前沿研究聚焦于利用预训练语言模型,如BERT及其变体,通过整体篇章连贯性优化来提升模型在篇章级准确率的表现。该数据集不仅推动了中文自然语言处理在长距离推理能力上的探索,也为多线索综合推理任务提供了新的评估基准,促进了机器在深层语义理解方面的进步。

相关研究论文

- 1A Sentence Cloze Dataset for Chinese Machine Reading Comprehension哈尔滨工业大学社会计算与信息检索研究中心 · 2020年

以上内容由遇见数据集搜集并总结生成