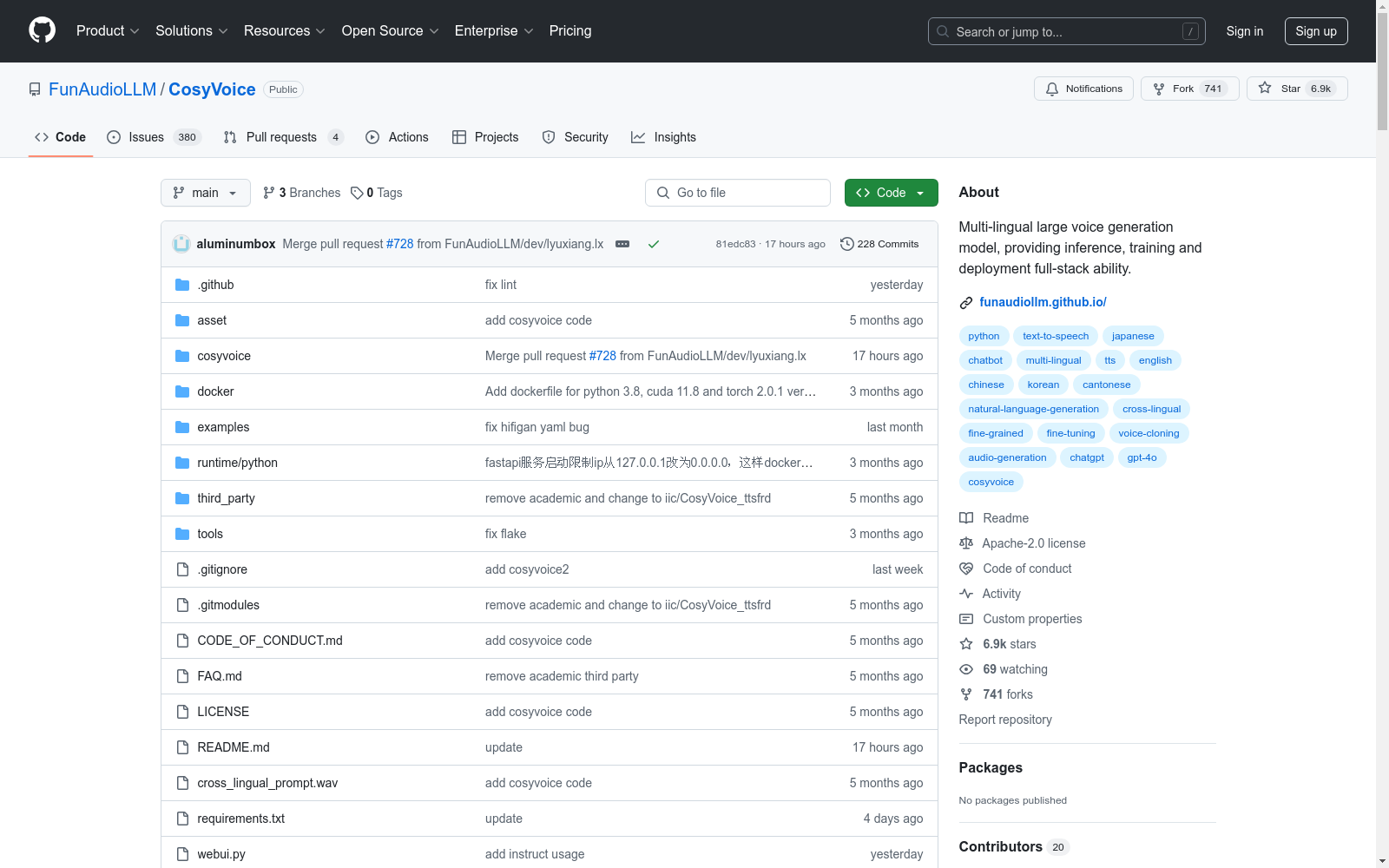

CosyVoice 2|语音合成数据集|多语言数据集

收藏CosyVoice 数据集概述

版本信息

- CosyVoice 2.0:

- CosyVoice 1.0:

主要特点

多语言支持

- 支持语言: 中文、英语、日语、韩语、中国方言(粤语、四川话、上海话、天津话、武汉话等)

- 跨语言与混合语言: 支持跨语言和代码转换场景的零样本语音克隆。

超低延迟

- 双向流支持: 集成离线和流式建模技术。

- 快速首包合成: 在保持高质量音频输出的同时,延迟低至150ms。

高准确性

- 发音改进: 与CosyVoice 1.0相比,发音错误减少30%至50%。

- 基准测试成绩: 在Seed-TTS评估集的硬测试集上达到最低的字符错误率。

强稳定性

- 音色一致性: 确保零样本和跨语言语音合成的可靠语音一致性。

- 跨语言合成: 与版本1.0相比有显著改进。

自然体验

- 韵律和音质增强: 合成音频的对齐得到改善,MOS评估分数从5.4提升至5.53。

- 情感和方言灵活性: 支持更细粒度的情感控制和口音调整。

安装与使用

安装步骤

-

克隆仓库: sh git clone --recursive https://github.com/FunAudioLLM/CosyVoice.git cd CosyVoice git submodule update --init --recursive

-

创建Conda环境: sh conda create -n cosyvoice python=3.10 conda activate cosyvoice conda install -y -c conda-forge pynini==2.1.5 pip install -r requirements.txt -i https://mirrors.aliyun.com/pypi/simple/ --trusted-host=mirrors.aliyun.com

模型下载

- 推荐下载预训练模型: python from modelscope import snapshot_download snapshot_download(iic/CosyVoice2-0.5B, local_dir=pretrained_models/CosyVoice2-0.5B) snapshot_download(iic/CosyVoice-300M, local_dir=pretrained_models/CosyVoice-300M) snapshot_download(iic/CosyVoice-300M-25Hz, local_dir=pretrained_models/CosyVoice-300M-25Hz) snapshot_download(iic/CosyVoice-300M-SFT, local_dir=pretrained_models/CosyVoice-300M-SFT) snapshot_download(iic/CosyVoice-300M-Instruct, local_dir=pretrained_models/CosyVoice-300M-Instruct) snapshot_download(iic/CosyVoice-ttsfrd, local_dir=pretrained_models/CosyVoice-ttsfrd)

基本使用

-

CosyVoice2 使用: python cosyvoice = CosyVoice2(pretrained_models/CosyVoice2-0.5B, load_jit=True, load_onnx=False, load_trt=False)

-

CosyVoice 使用: python cosyvoice = CosyVoice(pretrained_models/CosyVoice-300M-SFT, load_jit=True, load_onnx=False, fp16=True)

讨论与交流

- Github Issues: 讨论

致谢

- 代码参考自 FunASR、FunCodec、Matcha-TTS、AcademiCodec、WeNet。

免责声明

- 本内容仅供学术用途,旨在展示技术能力。部分示例来源于网络,如涉及侵权,请联系我们删除。

- 1CosyVoice 2: Scalable Streaming Speech Synthesis with Large Language Models阿里巴巴集团 · 2024年

poi

本项目收集国内POI兴趣点,当前版本数据来自于openstreetmap。

github 收录

中国气象数据

本数据集包含了中国2023年1月至11月的气象数据,包括日照时间、降雨量、温度、风速等关键数据。通过这些数据,可以深入了解气象现象对不同地区的影响,并通过可视化工具揭示中国的气温分布、降水情况、风速趋势等。

github 收录

OMIM (Online Mendelian Inheritance in Man)

OMIM是一个包含人类基因和遗传疾病信息的在线数据库。它提供了详细的遗传疾病描述、基因定位、相关文献和临床信息。数据集内容包括疾病名称、基因名称、基因定位、遗传模式、临床特征、相关文献引用等。

www.omim.org 收录

flames-and-smoke-datasets

该仓库总结了多个公开的火焰和烟雾数据集,包括DFS、D-Fire dataset、FASDD、FLAME、BoWFire、VisiFire、fire-smoke-detect-yolov4、Forest Fire等数据集。每个数据集都有详细的描述,包括数据来源、图像数量、标注信息等。

github 收录

OpenSonarDatasets

OpenSonarDatasets是一个致力于整合开放源代码声纳数据集的仓库,旨在为水下研究和开发提供便利。该仓库鼓励研究人员扩展当前的数据集集合,以增加开放源代码声纳数据集的可见性,并提供一个更容易查找和比较数据集的方式。

github 收录