URO-Bench

收藏github2025-03-22 更新2025-03-03 收录

下载链接:

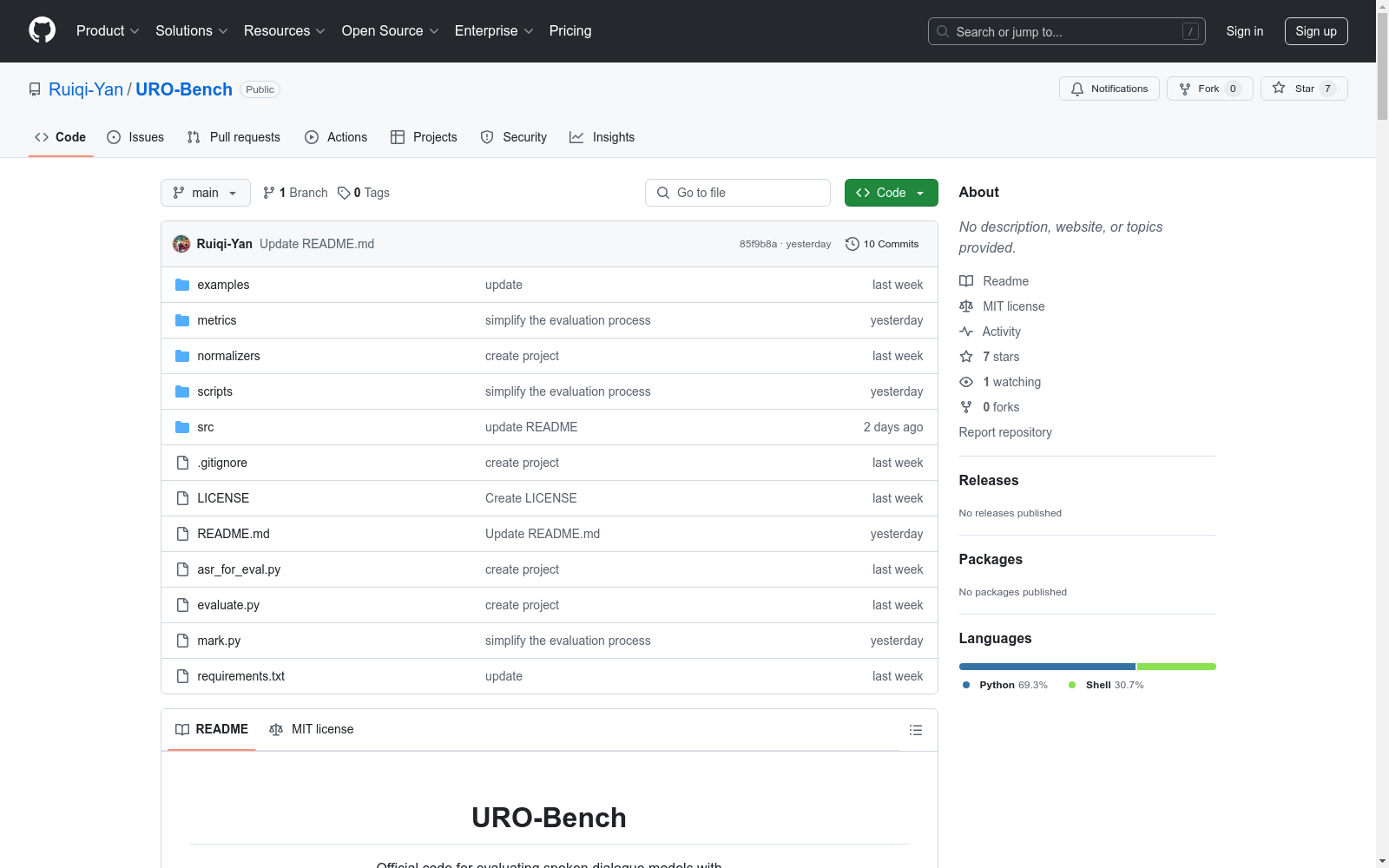

https://github.com/Ruiqi-Yan/URO-Bench

下载链接

链接失效反馈资源简介:

URO-Bench是一个用于评估端到端口语对话模型的综合基准,涵盖了多语言、多轮对话和副语言学的评估。基准分为基础轨道和专业轨道,分别包含16和20个数据集,用于评估模型在理解、推理和口语对话方面的能力。

URO-Bench is a comprehensive benchmark for evaluating end-to-end spoken dialogue models, covering evaluations across multilingual, multi-turn dialogue and paralinguistic dimensions. The benchmark is divided into a basic track and a specialized track, which respectively contain 16 and 20 datasets, aiming to assess models' capabilities in comprehension, reasoning and spoken dialogue.

创建时间:

2025-02-25

原始信息汇总

数据集概述

URO-Bench是一个全面的端到端口语对话模型评估基准,旨在评估模型在语音到语音(S2S)场景下的理解、推理和口语对话能力。该基准包括两个难度级别:基础赛道和专业赛道,分别包含16个和20个数据集。URO-Bench是首个涵盖多语言、多轮对话和副语言学的S2S基准。

数据集内容

目前,URO-Bench支持36个数据集,涵盖20个不同的任务,可在Hugging Face数据页面获取。测试集分为基础和专业两个赛道。

评估方法

URO-Bench提供了四个简单步骤来获取所有测试结果,包括环境设置、修改推理代码、修改脚本和运行自动评估流程。

排行榜

URO-Bench提供了基础赛道和专业赛道的排行榜,包括英文和中文模型的得分,以及Whisper-large-v3 + LLMs的参考分数。

致谢

URO-Bench借用了来自Voicebench、Whisper、F5-TTS、emotion2vec和Fairseq的一些代码。

引用

如果您在研究中使用URO-Bench,请引用以下论文:

@article{yan2025uro, title={URO-Bench: A Comprehensive Benchmark for End-to-End Spoken Dialogue Models}, author={Yan, Ruiqi and Li, Xiquan and Chen, Wenxi and Niu, Zhikang and Yang, Chen and Ma, Ziyang and Yu, Kai and Chen, Xie}, journal={arXiv preprint arXiv:2502.17810}, year={2025} }

AI搜集汇总

数据集介绍

构建方式

URO-Bench是一个全面的端到端语音对话模型评估基准,旨在解决当前语音到语音(S2S)场景下SDM评估的不足。它包括了多语言、多轮对话和副语言等方面的评估,并分为基础和专业两个难度级别,包含16个和20个数据集,分别评估模型在理解、推理和口头对话方面的能力。

使用方法

使用URO-Bench进行评估的步骤简单明了,包括设置环境、修改推理代码和脚本,以及运行自动评估流程。用户可以参考提供的示例和脚本,根据需要调整代码以适应不同的SDM模型。评估结果将帮助研究人员了解模型在不同任务和难度级别上的表现,从而推动语音对话模型的发展。

背景与挑战

背景概述

在语音交互领域,端到端的语音对话模型(SDMs)近年来取得了显著进展。相较于基于文本的大型语言模型(LLMs),SDMs的评价需要考虑语音相关的方面,如副语言信息和语音质量。然而,在语音到语音(S2S)场景下,SDMs的综合性评价仍显不足。为了填补这一空白,研究者们提出了URO-Bench,这是一个涵盖多语言、多轮对话和副语言等方面的SDMs综合性基准。URO-Bench由两个难度级别组成,分别为基础赛道和专业赛道,包含16个和20个数据集,旨在评估模型在理解、推理和口语对话方面的能力。该数据集的提出对于推动SDMs的发展具有重要意义,它提供了一个多方面的评价框架,有助于跟踪该领域的发展进度。

当前挑战

URO-Bench面临的挑战主要在于两个方面。首先,在所解决的领域问题方面,如何准确地评估SDMs在语音相关的副语言信息和语音质量方面的表现是一个挑战。其次,在构建过程中,如何有效地收集和整理多语言、多轮对话和副语言等方面的数据也是一个挑战。此外,如何确保评估的公正性和客观性,以及如何处理数据隐私和安全问题,也是需要考虑的重要挑战。

常用场景

经典使用场景

URO-Bench 是一个专为端到端语音对话模型设计的综合基准测试平台,涵盖了语音相关方面的评估,如副语言信息和语音质量。该数据集被分为基础和高级两个难度级别,分别包含16和20个数据集,旨在评估模型在理解、推理和口语对话方面的能力。URO-Bench 的经典使用场景包括但不限于:1)研究者在开发新的语音对话模型时,可以使用 URO-Bench 来全面评估模型在多个任务上的性能;2)研究者可以通过 URO-Bench 跟踪和比较不同模型在语音对话领域的进展;3)开发者可以利用 URO-Bench 的多语言和多媒体特性来训练和优化其语音对话系统。

解决学术问题

URO-Bench 解决了语音对话模型评估中存在的不足,即缺乏全面评估语音对话模型在语音到语音(S2S)场景下的性能的基准测试平台。URO-Bench 作为一个全面的基准测试平台,首次涵盖了多语言、多轮对话和副语言信息等方面的评估,有助于推动语音对话领域的研究进展。该数据集的意义和影响在于为研究者提供了一个全面的评估框架,使得研究者可以更全面地评估和比较不同语音对话模型在多个任务上的性能,从而推动语音对话领域的创新和发展。

实际应用

URO-Bench 在实际应用场景中具有广泛的应用潜力。例如,语音助手和聊天机器人等语音交互系统可以利用 URO-Bench 来评估其模型的性能,并通过与 URO-Bench 上的其他模型进行比较,找到性能的瓶颈并加以改进。此外,语音合成和语音识别等语音处理技术也可以利用 URO-Bench 来评估其模型的鲁棒性和泛化能力。URO-Bench 还可以用于语音对话模型的训练和优化,通过在 URO-Bench 上进行实验,开发者可以找到提高模型性能的关键因素,从而构建更高质量的语音对话系统。

数据集最近研究

最新研究方向

在语音对话模型(SDM)领域,URO-Bench 数据集的最新研究方向主要集中在构建一个全面的基准测试平台,以评估 SDM 在语音到语音(S2S)场景下的性能。URO-Bench 是首个涵盖多语言、多轮对话和非言语信息评估的 S2S 基准测试平台,旨在通过提供多方面的模型评估来促进语音对话模型的发展。此外,URO-Bench 还被用于跟踪该领域的研究进展。

以上内容由AI搜集并总结生成