【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

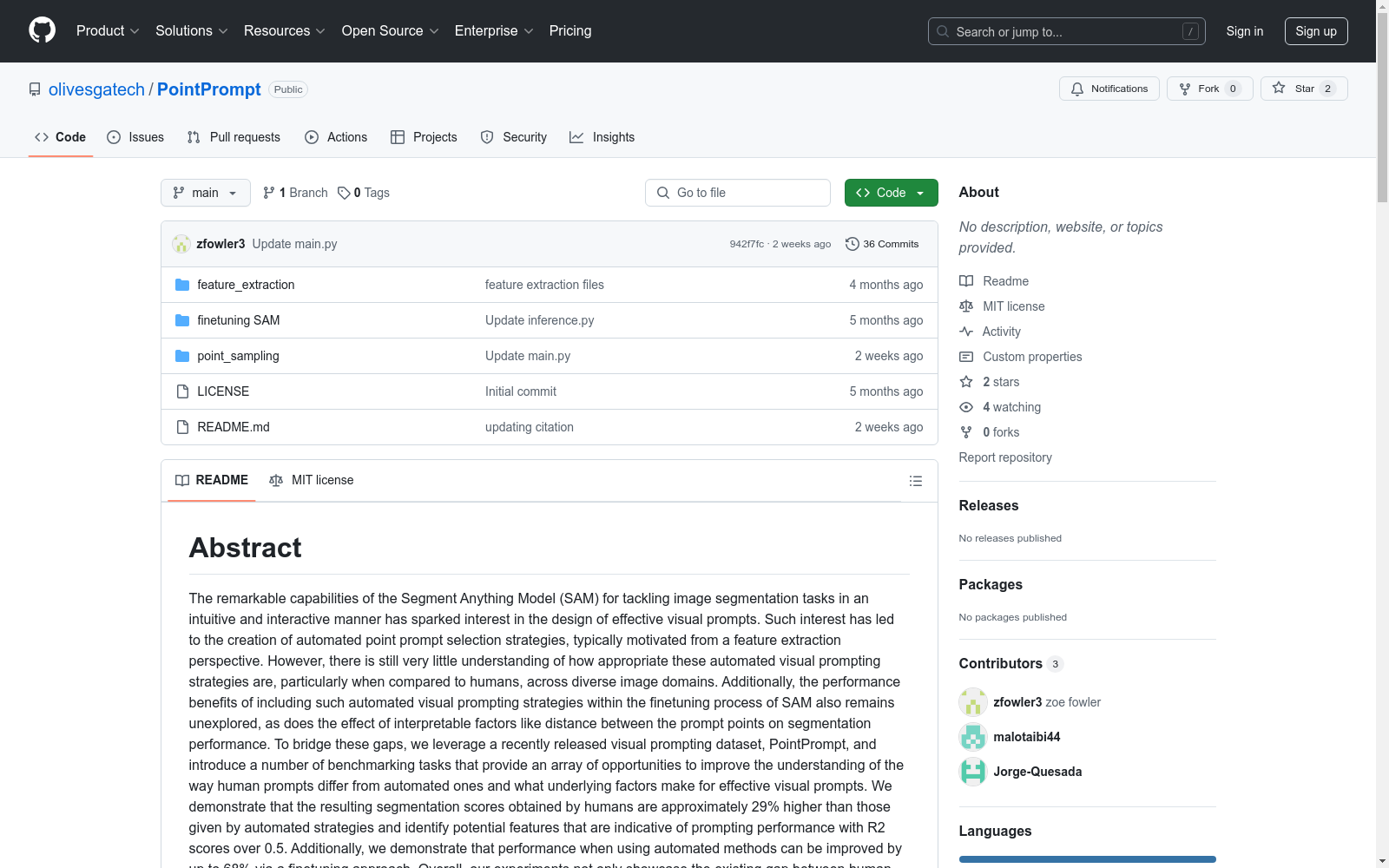

PointPrompt

收藏PointPrompt 数据集概述

数据集描述

PointPrompt 是一个视觉提示数据集,基于 Segment Anything Model (SAM) 设计,旨在研究自动化视觉提示选择策略与人类提示之间的差异及其对分割性能的影响。

数据集结构

数据集包含两个主要部分:

-

Image datasets.zip:

- 包含所有图像数据集及其对应的地面真值标签。

- 每个图像数据集包含 400 对图像和地面真值掩码,格式为 .npy 数组。

-

Prompting data.zip:

-

包含从人类注释者收集的提示数据。

-

结构如下:

Prompting Results ├── Baseball bat # 图像数据集 ├── st1 # 人类注释者 # 1 ├── eachround # 长度为 t 的列表,指示每个时间步属于哪一轮 ├── masks # 包含每个图像的二进制掩码,格式为 a_b_mask.png ├── points # 包含包含和排除点,格式为 a_green.npy 和 a_red.npy ├── scores # 包含每个时间步的分数 (mIoU) ├── sorts # 包含按分数从高到低排序的时间步索引 ├── st2 # 人类注释者 # 2 (结构与 st1 相同) ├── st3 # 人类注释者 # 3 (结构与 st1 相同)

-

数据集使用

代码使用

-

点采样策略实验:

- 进入

point_sampling目录。 - 阅读

Instructions.md文件。 - 运行

main.py脚本,需指定--img_dir、--results_dir和--home_dir参数。 - 通过

--query_strategy参数指定要运行的策略。

- 进入

-

微调:

- 数据集结构需调整为特定格式。

- 安装依赖:

pip install -r requirements.txt。 - 运行

train.py进行微调,保存权重。 - 运行

inference.py测试模型并保存结果。

-

特征提取:

- 安装依赖:

pip install -r requirements.txt。 - 运行

gather_statistics.py提取图像、提示和一般级别特征。

- 安装依赖:

引用

J. Quesada∗, Z. Fowler∗, M. Alotaibi, M. Prabhushankar, and G. AlRegib, ”Benchmarking Human and Automated Prompting in the Segment Anything Model”, In IEEE International Conference on Big Data 2024, Washington DC, USA.

- 1Benchmarking Human and Automated Prompting in the Segment Anything Model乔治亚理工学院 · 2024年