FewCLUE

收藏arXiv2021-09-30 更新2024-06-21 收录

下载链接:

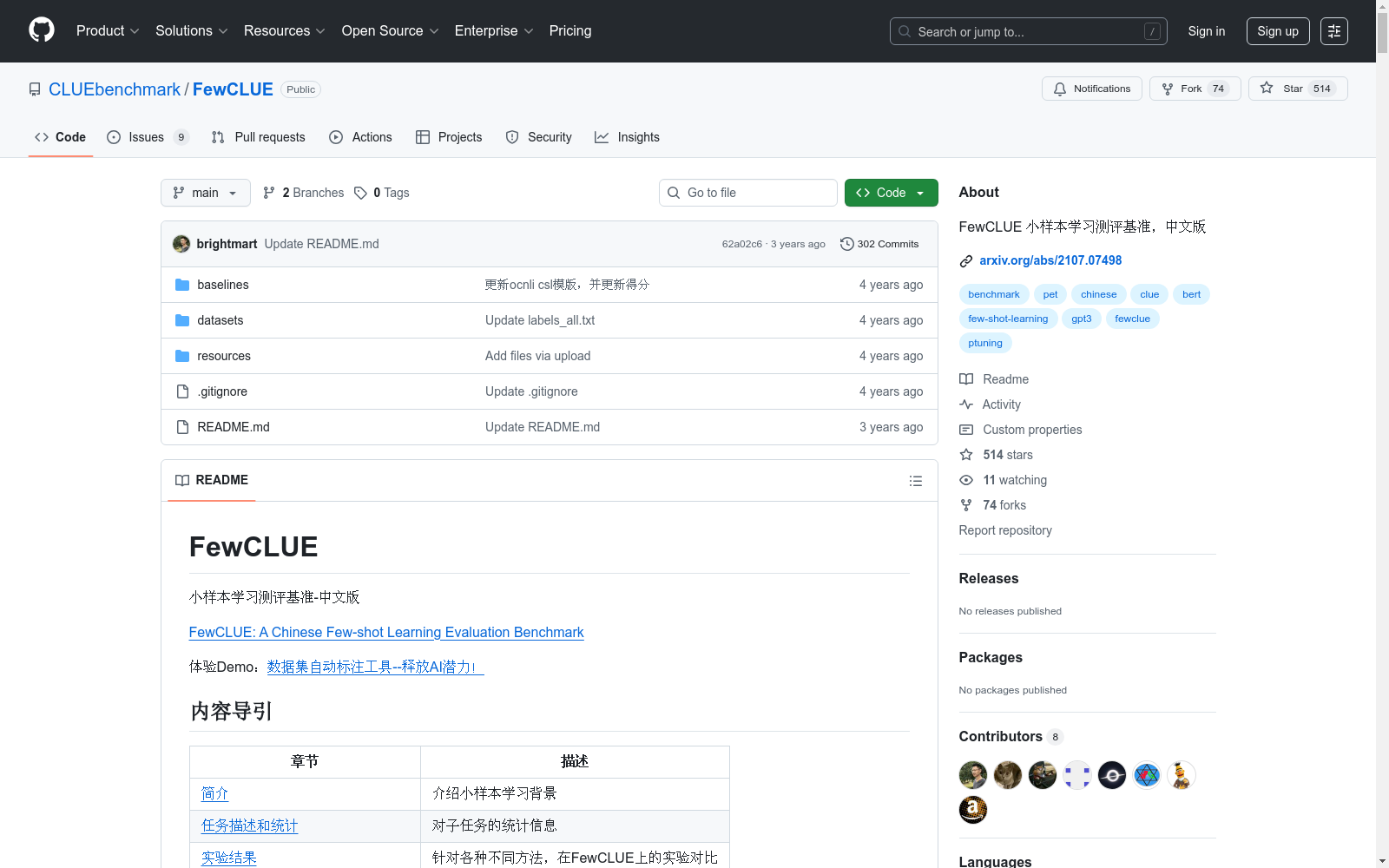

https://github.com/CLUEbenchmark/FewCLUE

下载链接

链接失效反馈官方服务:

资源简介:

FewCLUE是首个系统全面的中文小样本学习评测基准,由中文自然语言处理评测团队创建。该数据集包含九个任务,涵盖单句分类、句子对分类及机器阅读理解等多种自然语言理解任务。数据集通过精心设计,旨在以少量标注数据评估模型性能,支持零样本和半监督学习研究。FewCLUE的应用领域广泛,旨在推动中文小样本学习技术的发展,解决实际场景中标注数据稀缺的问题。

FewCLUE is the first systematic and comprehensive Chinese few-shot learning evaluation benchmark, created by the Chinese natural language processing evaluation team. This dataset includes nine tasks, covering a variety of natural language understanding tasks such as single-sentence classification, sentence-pair classification, and machine reading comprehension. It is meticulously designed to evaluate model performance with a small amount of labeled data, supporting zero-shot and semi-supervised learning research. FewCLUE has broad application scenarios, aiming to promote the development of Chinese few-shot learning technologies and address the problem of scarce labeled data in real-world scenarios.

提供机构:

中文自然语言处理评测团队

创建时间:

2021-07-16

搜集汇总

数据集介绍

构建方式

FewCLUE数据集的构建旨在为中文少样本学习提供一套全面的评估基准。该数据集包含九个任务,涵盖单句分类、句对分类和机器阅读理解等自然语言理解任务。为了确保数据集的质量和多样性,研究人员从CLUE基准中选择了六个任务,并新增了三个任务。每个任务都采用了不同的采样策略,以确保样本的真实性和少样本特性。此外,每个任务都提供了多个训练和验证集,以及一个公开测试集,以便研究人员进行实验和发布结果。最后,为了支持无监督和半监督学习,每个任务还提供了大量的未标记样本。

特点

FewCLUE数据集的特点在于其全面性和系统性。首先,它是第一个中文少样本学习评估基准,为中文少样本学习研究提供了坚实的基础。其次,FewCLUE包含了九个不同的自然语言理解任务,涵盖了单句分类、句对分类和机器阅读理解等方面,能够全面评估模型在少样本学习场景下的表现。此外,FewCLUE提供了多个训练和验证集,以及大量的未标记样本,为无监督和半监督学习研究提供了便利。

使用方法

使用FewCLUE数据集的方法如下:首先,研究人员需要根据FewCLUE提供的任务描述和样本格式,选择合适的少样本学习模型进行实验。其次,研究人员可以使用FewCLUE提供的训练和验证集进行模型训练和评估,并提交结果到公开测试集上。最后,研究人员可以利用FewCLUE提供的未标记样本进行无监督和半监督学习研究。此外,FewCLUE还提供了一个用户友好的工具包和一个在线排行榜,以便研究人员方便地复现实验结果和比较不同模型的性能。

背景与挑战

背景概述

随着预训练语言模型(PLMs)在自然语言理解任务中取得巨大成功,不同的学习方案——微调、零样本学习和少样本学习——在英语等语言中得到了广泛探索和比较。然而,在中文领域,对于这些方法的公平和全面评估和比较的工作相对较少,这阻碍了累积的进步。为了解决这一问题,本文介绍了首个中文少样本学习评估基准(FewCLUE),该基准包括九项任务,从单句和句对分类任务到机器阅读理解任务。本文系统地评估了五种最先进的少样本学习方法(包括PET、ADAPET、LM-BFF、P-tuning和EFL),并将它们在FewCLUE基准上的性能与微调和零样本学习方案进行了比较。实验结果表明:1)不同的少样本学习方法对应用于预训练模型的效果敏感;2)在RoBERTa和ERNIE上,PET和P-tuning分别取得了最佳的整体性能。我们的基准被用于NLPCC 2021的少样本学习竞赛。此外,我们还提供了一个用户友好的工具包,以及一个在线排行榜,以帮助促进中文少样本学习的研究。我们还提供了不同学习方法的基准性能,供未来研究参考。

当前挑战

FewCLUE数据集的主要挑战包括:1)不同的少样本学习方法对预训练模型的效果敏感;2)在少样本学习中,单句和句对任务与人类相比难度较大,而阅读理解任务则相对较小;3)少样本学习模型的稳定性有待提高,因为训练和验证集可能太小,无法代表整个数据集的总体分布。此外,在构建数据集的过程中,选择具有代表性的、具有挑战性和区分度的任务,并确保结果的一致性,也是一大挑战。

常用场景

经典使用场景

FewCLUE数据集作为首个全面的中文少样本学习评估基准,为研究者在中文自然语言处理(NLP)领域提供了宝贵的资源。它涵盖了从单句分类、句子对分类到机器阅读理解等多种任务,旨在系统地评估和比较少样本学习方法。在FewCLUE上进行的实验揭示了不同少样本学习方法对预训练模型的选择敏感性,并指出了PET和P-tuning在特定预训练模型上表现优异。该数据集不仅用于评估模型的性能,还用于促进少样本学习在中文NLP领域的进展,为研究者提供了强大的基线和人工评估结果。

实际应用

FewCLUE数据集的实际应用场景包括自然语言理解的各种任务,如文本分类、自然语言推理、文本相似度比较和阅读理解等。该数据集可以帮助开发者在有限的标注数据情况下,训练出性能良好的模型。此外,FewCLUE还包含大量的未标注数据,可用于无监督和半监督学习的研究。通过提供用户友好的工具包和在线排行榜,FewCLUE促进了中文少样本学习研究的进一步发展。

衍生相关工作

FewCLUE数据集的推出,为中文少样本学习研究提供了新的方向。基于FewCLUE的实验结果,研究者可以进一步探索不同少样本学习方法在不同任务和预训练模型上的性能差异。此外,FewCLUE的构建方式和数据集设计也为其他语言的少样本学习基准的构建提供了参考。随着FewCLUE的不断完善和更新,它将推动中文少样本学习领域的研究进展,并为相关技术的实际应用提供支持。

以上内容由遇见数据集搜集并总结生成