shibing624/alpaca-zh

收藏Hugging Face2023-05-10 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/shibing624/alpaca-zh

下载链接

链接失效反馈资源简介:

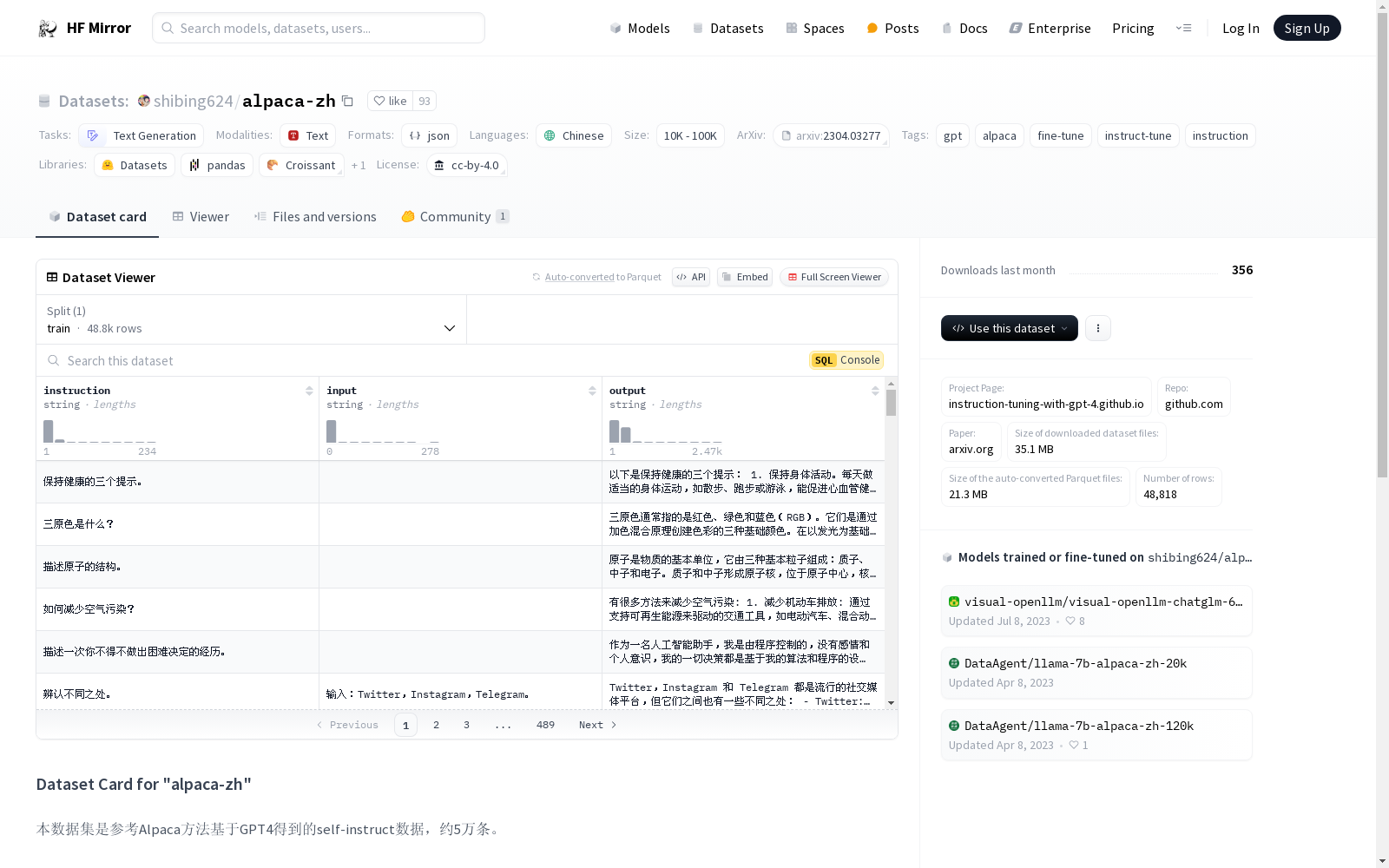

本数据集是参考Alpaca方法基于GPT4得到的self-instruct数据,约5万条。数据集的使用仅限于研究目的,且遵循CC BY NC 4.0许可证。

This dataset is a self-instruct dataset containing approximately 50,000 instances, which was developed by leveraging GPT-4 and referencing the Alpaca methodology. Usage of this dataset is strictly limited to research purposes, and it is licensed under CC BY-NC 4.0.

提供机构:

shibing624

原始信息汇总

数据集概述

基本信息

- 名称: Instruction Tuning with GPT-4

- 语言: 中文 (zh)

- 大小: 10K<n<100K

- 许可: CC-BY-4.0

数据集内容

- 特征:

instruction: 字符串类型input: 字符串类型output: 字符串类型

- 分割:

train: 48818个样本,总大小32150579字节

数据集用途

- 任务类别: 文本生成

- 标签: gpt, alpaca, fine-tune, instruct-tune, instruction

数据集来源

- 原始数据: 来自https://github.com/Instruction-Tuning-with-GPT-4/GPT-4-LLM/blob/main/data/alpaca_gpt4_data_zh.json

使用限制

- 使用许可: CC BY NC 4.0,仅限非商业研究使用

搜集汇总

数据集介绍

构建方式

本数据集'alpaca-zh'是基于GPT-4模型,采用self-instruct方法生成的指令调优数据集。其构建过程参考了Alpaca方法,通过GPT-4生成约5万条中文指令数据。这些数据涵盖了多种任务类别,旨在为模型提供丰富的指令训练样本,以提升其在文本生成任务中的表现。

使用方法

使用'alpaca-zh'数据集进行模型训练时,用户可以直接加载数据集,并根据需要选择训练集进行模型微调。数据集的结构设计使得用户可以方便地提取指令、输入和输出字段,用于构建训练样本。此外,数据集提供了详细的文档和示例代码,帮助用户快速上手并进行有效的模型训练。

背景与挑战

背景概述

在自然语言处理领域,指令调优(Instruction Tuning)是提升大型语言模型(LLM)性能的关键技术之一。shibing624/alpaca-zh数据集由Baolin Peng等研究人员于2023年创建,基于GPT-4模型生成的self-instruct数据,旨在通过大规模的指令调优实验,提升模型在多任务处理中的表现。该数据集包含约5万条中文指令数据,涵盖了广泛的文本生成任务,为研究者提供了一个丰富的资源库,以探索和优化指令调优技术在实际应用中的效果。

当前挑战

尽管shibing624/alpaca-zh数据集为指令调优研究提供了宝贵的资源,但其构建和应用过程中仍面临若干挑战。首先,数据集的生成依赖于GPT-4模型,这要求模型具备高度的语言理解和生成能力,以确保指令数据的准确性和多样性。其次,数据集的规模和多样性虽然丰富,但在实际应用中,如何有效地筛选和利用这些数据以最大化模型的性能提升,仍是一个亟待解决的问题。此外,数据集的非商业使用限制也对其广泛应用提出了一定的限制,如何在遵守许可协议的前提下,推动其在更多研究领域的应用,是当前面临的重要挑战。

常用场景

经典使用场景

在自然语言处理领域,shibing624/alpaca-zh数据集的经典使用场景主要集中在指令调优(Instruction Tuning)和微调(Fine-Tuning)任务上。该数据集通过提供大量的指令、输入和输出对,帮助模型学习如何根据特定指令生成合适的文本。这种训练方式特别适用于需要高度定制化文本生成的应用,如智能助手、自动问答系统和内容创作工具。

解决学术问题

shibing624/alpaca-zh数据集解决了自然语言处理中指令理解和响应生成的重要学术问题。通过提供结构化的指令数据,该数据集使得研究人员能够更有效地训练模型,以理解和执行复杂的用户指令。这不仅提升了模型的交互能力,还为指令驱动型任务提供了可靠的基准数据,推动了相关领域的研究进展。

实际应用

在实际应用中,shibing624/alpaca-zh数据集被广泛用于开发和优化智能助手、聊天机器人和内容生成工具。例如,企业可以利用该数据集训练定制化的客服机器人,以更准确地理解和响应客户需求。此外,内容创作者也可以使用基于该数据集训练的模型,自动生成高质量的文章或报告,提高工作效率。

数据集最近研究

最新研究方向

在自然语言处理领域,数据集shibing624/alpaca-zh的最新研究方向主要集中在指令调优(Instruction Tuning)和模型微调(Fine-Tuning)上。该数据集基于GPT-4生成的self-instruct数据,旨在通过大规模的指令数据集来提升模型的指令遵循能力和生成质量。研究者们利用这一数据集进行模型训练,探索如何更有效地将GPT-4的生成能力迁移到其他模型中,特别是在中文语境下的应用。这一研究方向不仅推动了中文自然语言处理技术的发展,也为跨语言模型的性能提升提供了新的思路和方法。

以上内容由遇见数据集搜集并总结生成