Faces in Things

收藏github2024-09-25 更新2024-10-03 收录

下载链接:

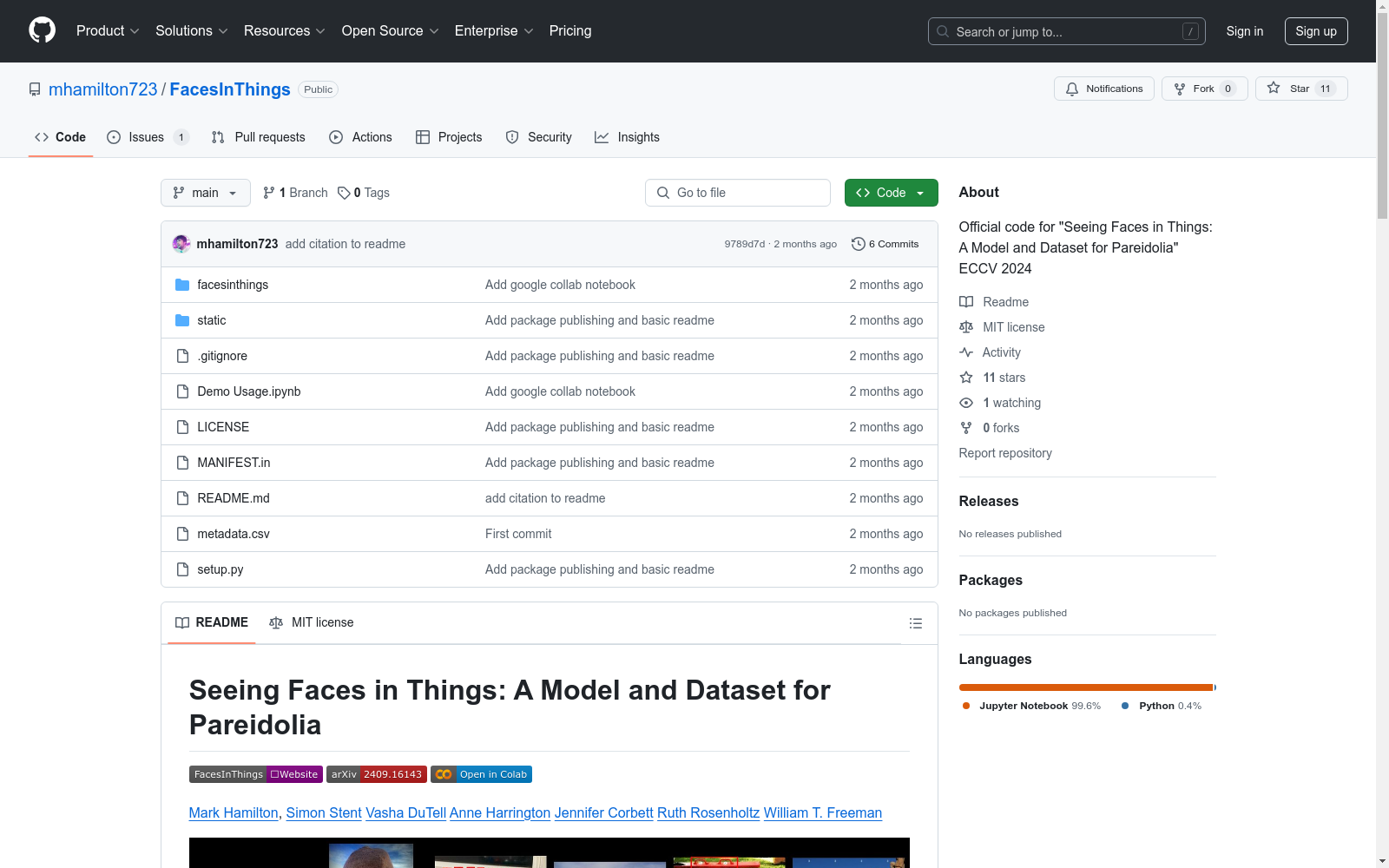

https://github.com/mhamilton723/FacesInThings

下载链接

链接失效反馈资源简介:

我们引入了一个由五千张人类标注的幻觉人脸图像组成的数据集,称为Faces in Things。该数据集源自LAION-5B数据集,并标注了关键的人脸属性和边界框。

创建时间:

2024-09-19

原始信息汇总

FacesInThings 数据集概述

数据集简介

- 名称: FacesInThings

- 描述: 一个包含超过5000张人类标注的幻视人脸图像的数据集,用于研究幻视现象。数据集从LAION-5B数据集中提取,并标注了关键的人脸属性及边界框。

数据集结构

-

文件结构:

FacesInThings.zip │ ├── images/ │ ├── 000000009.jpg │ ├── 000000027.jpg │ ├── ... │ └── metadata.csv

-

metadata.csv 字段:

file: 图像文件名url: 图像的直接URLboxes: 检测到的幻视人脸的边界框,格式为[x1, y1, w, h]is_primary: 边界框是否为主人脸Is there a face?: 是否存在人脸(Yes/No/Several)Hard to spot?: 识别人脸的难度(Easy/Medium/Hard)Accident or design?: 人脸是偶然出现还是设计出来的Emotion?: 感知到的情绪(Neutral, Happy, Sad等)Person or creature?: 人脸类型(Human, Animal, Alien等)Gender?: 感知到的性别(Neutral, Female, Male)Amusing?: 人脸是否有趣(Yes/No/Somewhat)Common?:这种幻视现象的常见程度Flags: 任何附加标志(例如,‘Interesting’, ‘NSFW’)num_boxes: 边界框的数量train: 图像是否属于训练集

数据集统计

- 平均人脸: 展示了从FacesInThings、WIDER FACE和Animal Web数据集中计算的平均人脸图像。

安装与使用

-

安装:

- 通过Pypi安装:

pip install facesinthings - 本地克隆安装: bash git clone https://github.com/mhamilton723/FacesInThings.git cd FacesInThings pip install -e .

- 通过Pypi安装:

-

使用: 数据集在本地不可用时会自动下载。提供了Demo Usage Notebook用于快速示例。

引用

@misc{hamilton2024seeingfacesthingsmodel, title={Seeing Faces in Things: A Model and Dataset for Pareidolia}, author={Mark Hamilton and Simon Stent and Vasha DuTell and Anne Harrington and Jennifer Corbett and Ruth Rosenholtz and William T. Freeman}, year={2024}, eprint={2409.16143}, archivePrefix={arXiv}, primaryClass={cs.CV}, url={https://arxiv.org/abs/2409.16143}, }

AI搜集汇总

数据集介绍

构建方式

在视觉认知领域,Faces in Things数据集的构建基于LAION-5B数据集,经过精心筛选和人工标注,形成了包含五千张标注有面孔属性和边界框的图像集合。这一过程不仅确保了数据的高质量,还通过详细的人工标注,捕捉了每张图像中面孔的细微特征,如情感、性别和识别难度等。

特点

Faces in Things数据集的显著特点在于其高度的人工标注精度和多样性。每张图像不仅标注了面孔的边界框,还详细记录了面孔的情感、性别、识别难度以及是否为设计元素等信息。这种细致的标注使得该数据集在研究面孔识别和帕雷多利亚现象(Pareidolia)时具有极高的实用价值。

使用方法

使用Faces in Things数据集时,用户可以通过pip安装或本地克隆的方式获取数据。数据集的结构清晰,包含图像文件夹和metadata.csv文件,后者详细记录了每张图像的标注信息。通过提供的Demo Usage Notebook,用户可以快速上手,进行数据集的加载和处理,从而开展面孔识别和帕雷多利亚现象的相关研究。

背景与挑战

背景概述

Faces in Things数据集由Mark Hamilton、Simon Stent等研究人员于2024年创建,专注于研究面孔错觉(Pareidolia)现象。该数据集包含超过5000张经过人工标注的面孔错觉图像,源自LAION-5B数据集,并详细标注了关键面部属性和边界框。这一数据集的创建旨在探索算法中面孔错觉的检测与识别,特别是与动物面部检测学习过程的关联。Faces in Things不仅为面孔错觉研究提供了丰富的数据资源,还为计算机视觉领域提供了新的研究方向,推动了面孔识别技术的进一步发展。

当前挑战

Faces in Things数据集在构建过程中面临多重挑战。首先,面孔错觉现象本身具有主观性和不确定性,导致图像标注的复杂性和多样性。其次,数据集的规模和多样性要求高效的标注和处理方法,以确保数据的准确性和一致性。此外,面孔错觉的检测与识别在算法层面仍存在技术瓶颈,尤其是在处理复杂背景和模糊图像时。这些挑战不仅影响了数据集的质量,也制约了相关算法的研究进展。

常用场景

经典使用场景

在计算机视觉领域,Faces in Things数据集的经典使用场景主要集中在面部识别与检测任务中。该数据集通过提供超过5000张经过人工标注的帕雷多利亚图像,为研究人员提供了一个独特的资源,用于训练和评估模型在非典型面部环境中的表现。这些图像不仅包含常见的面部特征,还涵盖了在自然界和人工制品中发现的隐含面部结构,从而扩展了传统面部识别技术的应用边界。

衍生相关工作

Faces in Things数据集的发布激发了一系列相关研究工作,特别是在面部识别和帕雷多利亚现象的研究领域。例如,有研究者利用该数据集开发了新的面部检测算法,这些算法在处理模糊或隐含面部特征时表现出色。此外,该数据集还被用于探索人类视觉系统的认知偏差,以及这些偏差如何影响机器学习模型的训练和性能。这些衍生工作不仅丰富了计算机视觉的理论基础,也为实际应用提供了新的工具和方法。

数据集最近研究

最新研究方向

在视觉认知领域,Faces in Things数据集的最新研究方向聚焦于探索算法如何模拟人类对非面部物体中面部特征的识别,即帕雷多利亚现象(Pareidolia)。该数据集不仅提供了超过5000张经过人工标注的帕雷多利亚图像,还详细记录了面部属性及边界框信息,为研究者提供了丰富的实验材料。当前的研究热点在于如何通过深度学习模型,特别是卷积神经网络,来准确识别和分类这些非典型面部图像,从而提升算法在复杂视觉环境中的鲁棒性和准确性。此外,该数据集的应用还扩展到了心理学和神经科学领域,研究者们试图通过分析算法的表现,揭示人类大脑在识别面部特征时的神经机制。

以上内容由AI搜集并总结生成