MIntRec2.0

收藏arXiv2024-03-20 更新2024-06-21 收录

下载链接:

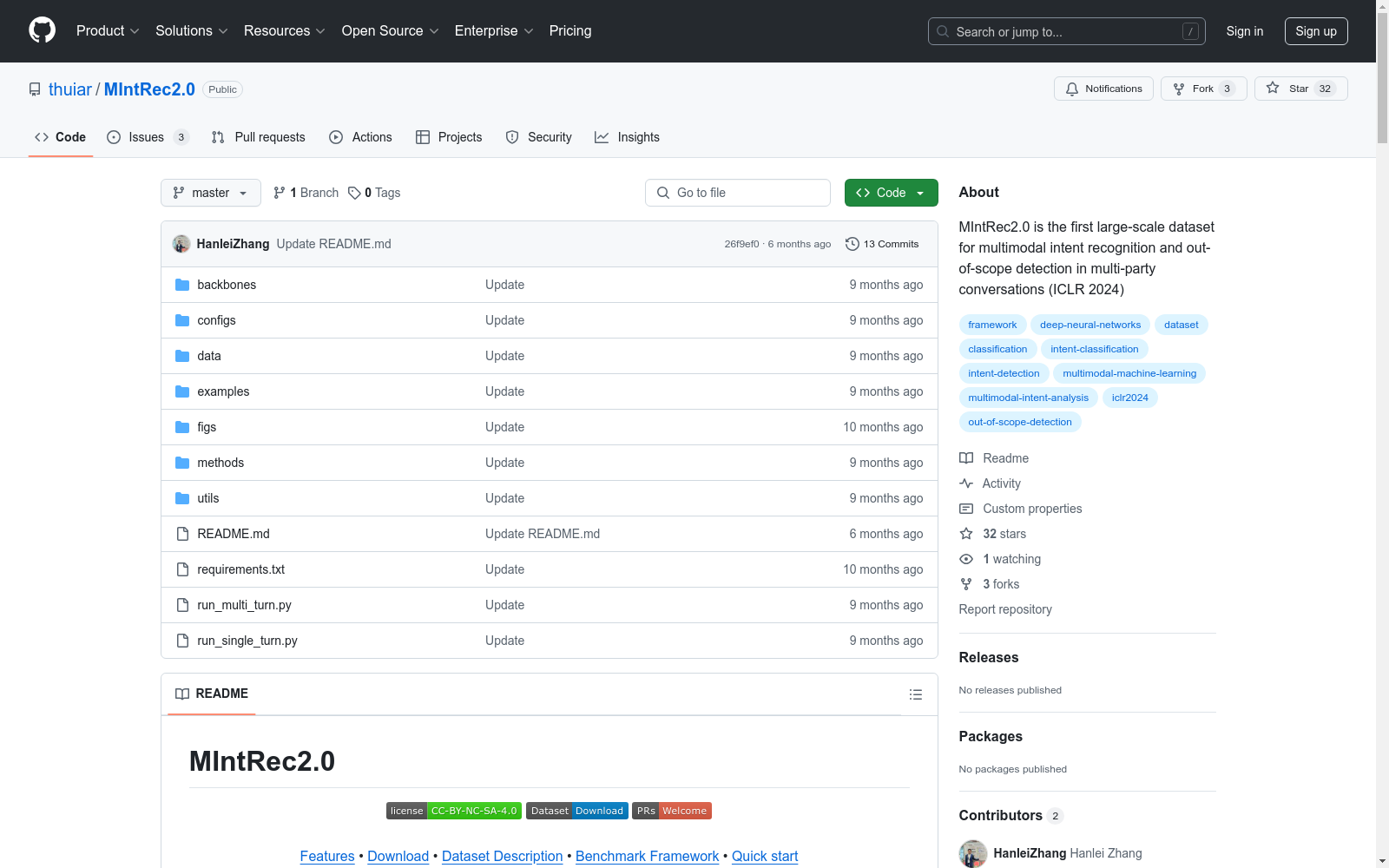

https://github.com/thuiar/MIntRec2.0

下载链接

链接失效反馈官方服务:

资源简介:

MIntRec2.0是由清华大学创建的大规模多模态意图识别基准数据集,包含1,245个高质量对话,总计15,040个样本,涵盖文本、视频和音频模态。数据集不仅包含超过9,300个范围内样本,还包括超过5,700个多轮对话中自然出现的范围外样本,增强了其实际应用性。数据集创建过程中,首先收集了三个电视剧的原始视频,并根据时间戳分割成话语级别的片段,然后手动将这些片段分组成对话,以匹配对话场景和事件。随后,为每个话语标注了说话者身份信息,以便利用特定的上下文信息。数据集的应用领域包括人机对话交互,旨在解决高级认知意图理解任务,显著促进了相关研究。

MIntRec2.0 is a large-scale multimodal intent recognition benchmark dataset developed by Tsinghua University. It comprises 1,245 high-quality dialogues, totaling 15,040 samples across text, video and audio modalities. The dataset includes over 9,300 in-scope samples, as well as more than 5,700 out-of-scope samples that naturally emerge in multi-turn dialogues, which substantially enhances its practical applicability. For dataset curation, raw videos from three television series were first collected and segmented into utterance-level clips based on timestamps. These clips were then manually grouped into dialogues to align with conversational scenarios and events. Next, speaker identity annotations were added for each utterance to support the utilization of contextual information. The dataset targets applications in human-machine dialogue interaction, aiming to tackle advanced cognitive intent understanding tasks, and it has significantly promoted related research in this field.

提供机构:

清华大学

创建时间:

2024-03-16

搜集汇总

数据集介绍

构建方式

MIntRec2.0数据集的构建过程包括四个主要步骤。首先,从三部电视剧中收集原始视频,并根据时间戳将其分割成话语级别的片段。接着,这些片段被手动分组为对话,以确保与对话场景和事件的一致性。随后,为每个话语标注说话者身份信息,以利用特定的上下文信息。最后,提出了一种新的意图分类法,包含30个细粒度的意图类别,并添加了OOS标签以识别不属于任何已知类别的话语。整个数据集由六名经验丰富的标注人员使用文本、视频和音频信息进行标注,最终包含9,304个在范围内和5,736个超出范围的样本。

特点

MIntRec2.0数据集的主要特点在于其大规模和多模态性质。该数据集包含1,245个高质量对话,总计15,040个样本,涵盖文本、视频和音频三种模态。此外,数据集引入了30个细粒度的意图类别,并特别标注了5,736个超出范围的样本,这些样本在多轮对话中自然出现,增强了数据集在实际应用中的适用性。数据集还提供了每个话语的说话者信息,丰富了其在多方对话研究中的应用价值。

使用方法

MIntRec2.0数据集的使用方法包括数据组织、多模态特征提取、多模态融合以及训练和评估。在单轮对话中,可以直接提取文本、视频和音频模态的特征。在多轮对话中,通过拼接当前话语和上下文信息来利用上下文信息。多模态融合阶段采用两种强融合方法(MAG-BERT和MulT)来捕捉跨模态交互。训练阶段结合多模态融合损失和交叉熵损失进行监督学习。推理阶段采用基于阈值的开集分类方法来识别高置信度的在范围内样本和检测低置信度的超出范围样本。

背景与挑战

背景概述

在多模态意图识别领域,理解人类意图在多模态场景中的重要性日益凸显,其应用涵盖人机交互、智能交通系统和医疗诊断等多个领域。然而,现有的大多数多模态意图基准数据集规模有限,且在处理多轮对话中的超出范围样本时存在困难。为此,清华大学等机构的研究人员于2024年推出了MIntRec2.0数据集,该数据集包含1,245个高质量对话和15,040个样本,每个样本在30个细粒度类别的新意图分类法中进行了标注,涵盖文本、视频和音频模态。MIntRec2.0不仅包含9,300多个在范围样本,还包含5,700多个在多轮对话中自然出现的超出范围样本,增强了其在实际应用中的适用性。该数据集的推出为研究人机对话交互提供了开创性的基础,并显著促进了相关应用的发展。

当前挑战

MIntRec2.0数据集在构建和应用过程中面临多项挑战。首先,多模态意图识别需要整合来自真实世界情境的非语言模态,以增强对人类意图的理解,这要求在数据收集和处理过程中进行精细的模态融合。其次,数据集在处理多轮对话中的超出范围样本时存在困难,这些样本在实际开放场景中自然出现,对系统的鲁棒性提出了高要求。此外,尽管现有方法在整合非语言信息方面取得了改进,但有效利用上下文信息和检测超出范围样本仍然是一个重大挑战。特别是,强大的大型语言模型在高级认知意图理解任务中与人类表现存在显著差距,这凸显了机器学习方法在该领域的局限性。

常用场景

经典使用场景

MIntRec2.0数据集在多模态意图识别和超出范围检测中展现了其经典应用场景。该数据集通过整合文本、视频和音频等多模态信息,能够有效提升对人类意图的理解,特别是在多轮对话中识别细微的意图变化和检测超出预定义类别的样本。这种能力在智能客服系统、智能交通系统和医疗诊断等领域具有广泛的应用前景。

衍生相关工作

MIntRec2.0数据集的发布催生了一系列相关研究工作。研究者们基于该数据集开发了多种多模态融合方法,如MAG-BERT和MulT,这些方法在多模态意图识别任务中表现出色。此外,数据集中的超出范围样本检测问题也引发了新的研究方向,推动了开放世界分类和异常检测技术的发展。这些研究不仅提升了多模态意图识别的性能,也为其他多模态任务提供了新的思路和方法。

数据集最近研究

最新研究方向

在多模态意图识别领域,MIntRec2.0数据集的最新研究方向主要集中在多模态融合和超出范围样本检测上。该数据集通过整合文本、视频和音频等多模态信息,旨在提升对人类意图的理解,特别是在多轮对话中的应用。研究者们正在探索如何更有效地利用上下文信息和多模态特征,以提高意图分类的准确性和超出范围样本的检测能力。此外,研究还关注于如何通过先进的机器学习模型,如大型语言模型,来缩小与人类在高级认知意图理解任务中的性能差距。这些研究不仅推动了人机交互技术的发展,也为智能交通系统和医疗诊断等领域的应用提供了新的可能性。

相关研究论文

- 1MIntRec2.0: A Large-scale Benchmark Dataset for Multimodal Intent Recognition and Out-of-scope Detection in Conversations清华大学 · 2024年

以上内容由遇见数据集搜集并总结生成