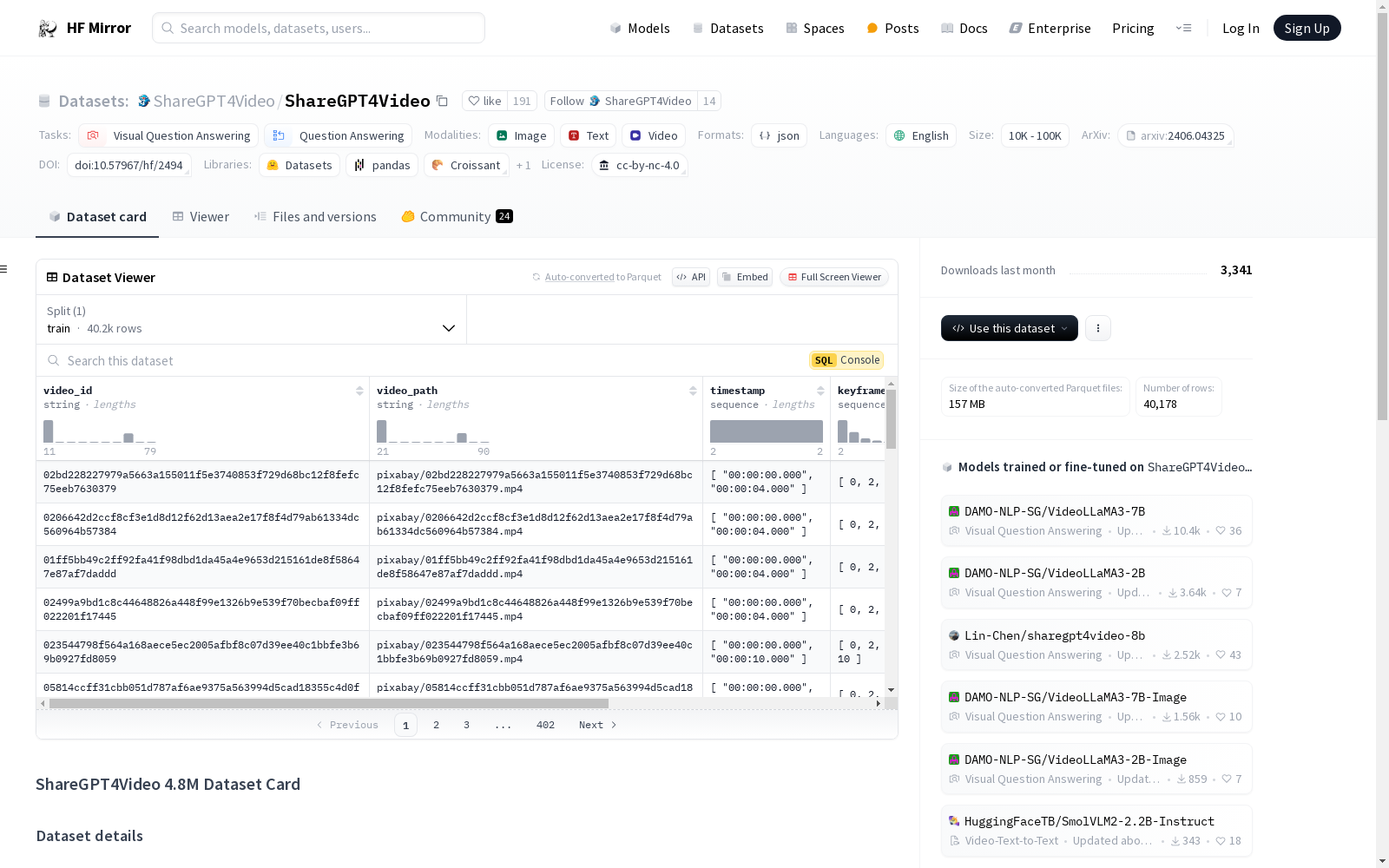

ShareGPT4Video/ShareGPT4Video

收藏Hugging Face2025-03-07 更新2024-06-15 收录

下载链接:

https://hf-mirror.com/datasets/ShareGPT4Video/ShareGPT4Video

下载链接

链接失效反馈资源简介:

ShareGPT4Video Captions 4.8M是一个由GPT4-Vision驱动的多模态视频字幕数据集,旨在增强大型视频语言模型(LVLMs)和文本到视频模型(T2VMs)的模态对齐和细粒度视觉概念感知能力。该数据集包含多个文件,分别由GPT4-Vision生成、基于GPT4-Vision生成的视频字幕对训练的ShareCaptioner-Video生成,以及用于LVLMs监督微调阶段的数据。数据集于2024年4月17日收集,主要用于多模态模型和文本到视频模型的研究。

ShareGPT4Video Captions 4.8M is a multi-modal video caption dataset powered by GPT4-Vision, designed to enhance the modal alignment and fine-grained visual concept perception capabilities of large video language models (LVLMs) and text-to-video models (T2VMs). This dataset contains multiple file sets: one generated directly by GPT4-Vision, another generated by ShareCaptioner-Video trained on GPT4-Vision-generated video caption pairs, and a third used for the supervised fine-tuning phase of LVLMs. The dataset was collected on April 17, 2024, and is primarily intended for research on multi-modal models and text-to-video models.

提供机构:

ShareGPT4Video

原始信息汇总

ShareGPT4Video 4.8M 数据集卡片

数据集详情

数据集类型: ShareGPT4Video Captions 4.8M 是一组由 GPT4-Vision 驱动的多模态视频字幕数据。

该数据集旨在增强大型视频-语言模型(LVLMs)和文本到视频模型(T2VMs)的模态对齐和细粒度视觉概念感知能力。这一进步旨在使 LVLMs 和 T2VMs 具备 GPT4V 和 Sora 的能力。

sharegpt4video_40k.jsonl由 GPT4-Vision(ShareGPT4Video)生成。share-captioner-video_mixkit-pexels-pixabay_4814k_0417.json由我们基于 GPT4-Vision 生成的视频-字幕对训练的 ShareCaptioner-Video(ShareGPT4Video-Asthetic)生成。sharegpt4video_mix181k_vqa-153k_share-cap-28k.json从sharegpt4video_instruct_gpt4-vision_cap40k.json中筛选,用于 LVLMs 的监督微调阶段。

数据集日期:

ShareGPT4Video Captions 4.8M 于 2024 年 4 月 17 日收集。

许可证: Attribution-NonCommercial 4.0 International 应遵守 OpenAI 的政策:https://openai.com/policies/terms-of-use

预期用途

主要预期用途: ShareGPT4Video Captions 4.8M 的主要用途是针对大型多模态模型和文本到视频模型的研究。 主要预期用户: 该数据集的主要用户是计算机视觉、自然语言处理、机器学习、AIGC 和人工智能领域的研究人员和爱好者。

AI搜集汇总

数据集介绍

构建方式

ShareGPT4Video Captions 4.8M数据集通过融合GPT4-Vision技术,构建了一套多模态视频字幕数据。该数据集旨在促进大型视频-语言模型与文本-视频模型在模态对齐与细粒度视觉概念感知方面的能力提升,进而向GPT4V与Sora模型的能力靠拢。数据集包括由GPT4-Vision生成的sharegpt4video_40k.jsonl文件,以及通过ShareCaptioner-Video训练得到的share-captioner-video_mixkit-pexels-pixabay_4814k_0417.json文件等,体现了数据集构建的多元化与综合性。

特点

该数据集具有4.8M的规模,收集于2024年4月17日,包含了丰富的多模态信息,能够有效支持大型多模态模型与文本-视频模型的研究。其独特的构建方式使得数据集在模态对齐与细粒度视觉概念感知方面具有显著优势,为研究人员提供了高质量的视频字幕资源。此外,数据集遵循知识共享署名-非商业4.0国际许可协议,保证了数据的合法合规使用。

使用方法

研究人员与爱好者可依据该数据集进行大型多模态模型与文本-视频模型的研究。数据集的使用需遵守OpenAI的使用政策,确保在非商业研究的前提下,合理利用数据集资源。用户可以通过访问数据集的GitHub代码库以及相关的项目与论文链接,获取更详细的操作指南与使用案例,以便更好地发挥数据集的价值。

背景与挑战

背景概述

ShareGPT4Video Captions 4.8M数据集,是在2024年4月17日由相关研究人员和机构精心构建的多模态视频字幕数据集。该数据集旨在提升大型视频语言模型(LVLMs)和文本到视频模型(T2VMs)的模态对齐以及细粒度视觉概念感知能力,以期达到GPT4V和Sora模型的水平。数据集的构建不仅体现了研究团队在多模态学习领域的深入探索,而且为相关领域的研究提供了宝贵的资源,对推动大型多模态模型的发展具有重要的学术价值。

当前挑战

该数据集在构建过程中面临的挑战主要包括:如何确保多模态数据的一致性和准确性,以及如何在大量数据中保持高质量的视频字幕对齐。此外,数据集在解决视觉问答和文本问答等领域的挑战时,还需克服模型对细粒度视觉概念的识别和描述难题。在应用层面,如何有效利用这些高质量字幕数据进行模型的监督微调,以及如何在不同的模型框架下验证这些字幕的有效性,也是当前研究的重要课题。

常用场景

经典使用场景

在视觉问答与文本到视频模型的研究领域,ShareGPT4Video 4.8M数据集凭借其丰富的多模态视频字幕信息,成为促进大型视频语言模型与文本到视频模型精细视觉概念感知能力提升的重要资源。研究者们利用该数据集,通过增强模态对齐,推动LVLMs和T2VMs向GPT4V和Sora的能效靠拢,进而提升模型在视频内容理解与生成方面的表现。

解决学术问题

该数据集针对大型视频语言模型训练中的模态对齐和细粒度视觉概念感知两大难题提供了有效的解决方案。通过精心构建的数据集,不仅为模型训练提供了高质量的标注数据,而且有助于解决视频内容理解不深入、多模态交互不自然等学术研究问题,对提升模型在实际应用中的泛化能力和准确度具有重要意义。

衍生相关工作

基于ShareGPT4Video 4.8M数据集,学术界已经衍生出一系列相关研究工作。这些工作不仅涉及对数据集本身的深入分析,还包括利用该数据集进行模型 fine-tuning 的研究,以及探索其在不同模态任务中的应用,如VideoLLaVA和LLaMA-VID模型的验证等,为多模态学习领域贡献了宝贵的研究成果。

以上内容由AI搜集并总结生成