CREAK

收藏github2021-09-01 更新2025-02-08 收录

下载链接:

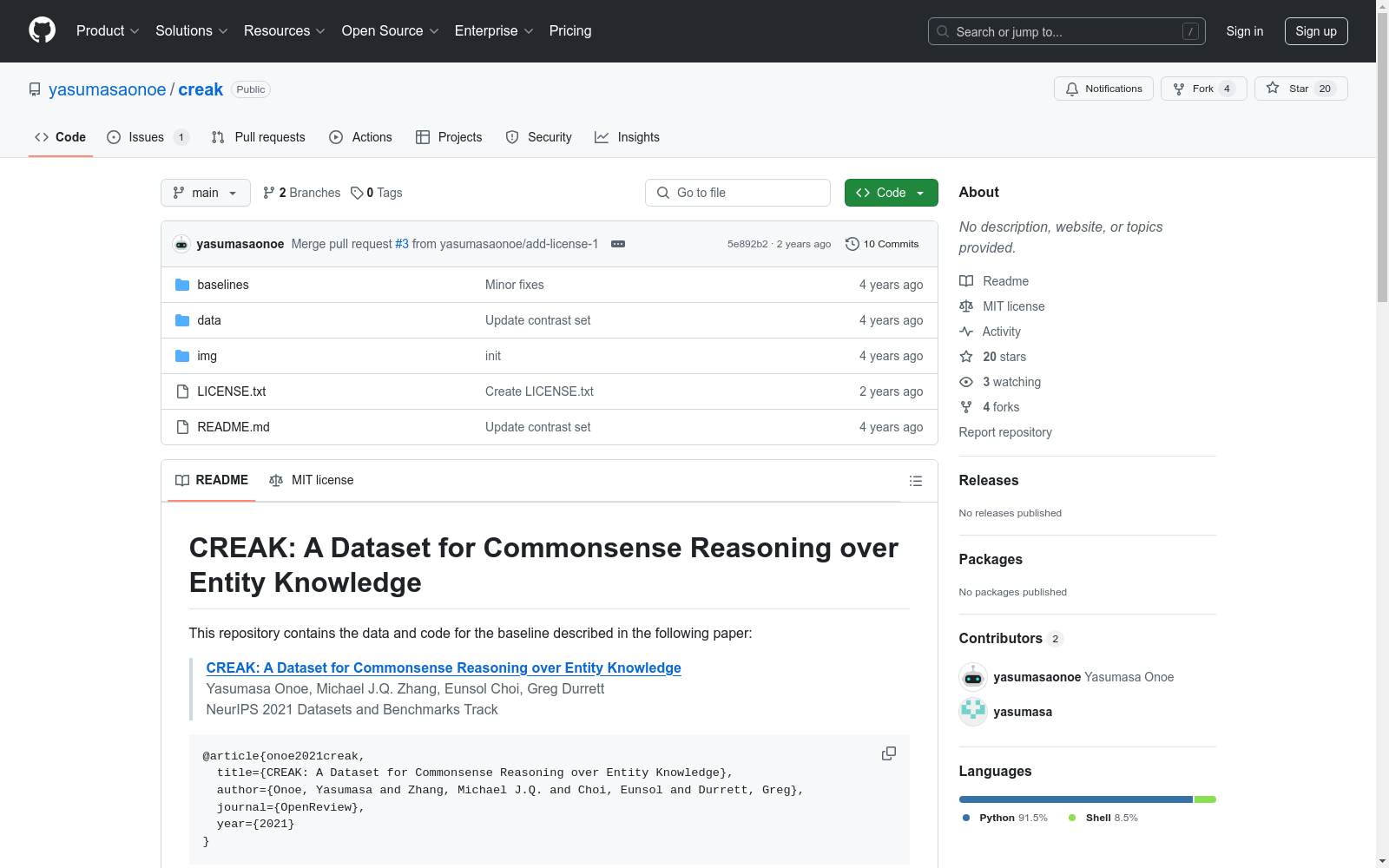

https://github.com/yasumasaonoe/creak

下载链接

链接失效反馈资源简介:

为了探索模型将实体知识与常识推理相结合的能力,引入了CREAK数据集。它建立了关于实体的事实细节(例如,像哈利·波特这样的巫师擅长骑扫帚飞行)与常识推理原则(例如,擅长某项技能就可以教别人)之间的联系。这一过程产生了推理查询(例如,哈利·波特是否能够教授骑扫帚飞行)。

To explore the model's ability to integrate entity knowledge with common-sense reasoning, the CREAK dataset was introduced. It establishes connections between factual details about entities (e.g., wizards like Harry Potter are skilled at broomstick flying) and common-sense reasoning principles (e.g., proficiency in a skill allows one to teach others). This process generates reasoning queries (e.g., whether Harry Potter can teach broomstick flying).

提供机构:

The University of Texas at Austin

创建时间:

2021-09-01

原始信息汇总

CREAK 数据集概述

基本信息

- 数据集名称:CREAK: A Dataset for Commonsense Reasoning over Entity Knowledge

- 论文信息:

- 标题:CREAK: A Dataset for Commonsense Reasoning over Entity Knowledge

- 作者:Yasumasa Onoe, Michael J.Q. Zhang, Eunsol Choi, Greg Durrett

- 会议:NeurIPS 2021 Datasets and Benchmarks Track

- 论文链接:https://openreview.net/pdf?id=mbW_GT3ZN-

- 年份:2021

数据集内容

- 数据文件:

train.json:10,176 个训练示例dev.json:1,371 个开发示例test_without_labels.json:1,371 个测试示例(无标签)contrast_set.json:500 个对比示例

- 数据格式:jsonlines

- 示例字段说明:

字段 描述 ex_id示例 ID sentence声明 explanation注释者提供的解释,说明声明为 TRUE/FALSE 的原因 label标签:true 或 false entity种子实体 en_wiki_pageid种子实体的英文维基百科页面 ID entity_mention_loc种子实体在声明中的位置

更新信息

- 更新时间:2021年11月8日

- 更新内容:对比集增加到500个示例

基准与排行榜

- 基准:详见

baselines/README.md - 排行榜:https://www.cs.utexas.edu/~yasumasa/creak/leaderboard.html

- 提交要求:仅接受基于闭卷方法且在域内数据上微调的结果

- 提交方式:发送系统名称及开发集、测试集和对比集的预测文件至

yasumasa@utexas.edu

联系方式

- 联系人:

yasumasa@utexas.edu

搜集汇总

数据集介绍

构建方式

CREAK数据集旨在支持基于实体知识的常识推理研究,其构建过程依托于人工标注与自动化工具的结合。数据集的构建首先从维基百科中选取实体作为种子,随后通过人工标注生成与这些实体相关的陈述句,并对其真实性进行判断。每个陈述句均附有详细的解释,说明其真实或虚假的原因。此外,数据集还包含一个对比集,用于评估模型在对抗性样本上的表现。整个构建过程严格遵循质量控制流程,以确保数据的准确性和多样性。

特点

CREAK数据集以其丰富的实体知识和常识推理任务为核心特点。数据集包含超过10,000条训练样本和1,371条开发样本,每条样本均包含一个陈述句、其真实性标签以及详细的解释。数据集特别注重实体知识的多样性,涵盖了广泛的实体类别和常识场景。此外,CREAK还提供了一个包含500条样本的对比集,用于测试模型在对抗性样本上的鲁棒性。这种设计使得CREAK成为评估和提升常识推理模型性能的理想选择。

使用方法

CREAK数据集的使用方法灵活多样,适用于多种自然语言处理任务。用户可通过加载JSON格式的数据文件,获取训练、开发和测试样本。每条样本包含陈述句、标签、解释及实体信息,便于模型训练和评估。数据集特别适用于闭卷式常识推理任务,用户可通过微调模型在训练集上进行学习,并在开发集和测试集上验证性能。此外,对比集可用于进一步测试模型的鲁棒性。用户还可通过提交预测结果参与官方排行榜,以评估模型在领域内的表现。

背景与挑战

背景概述

CREAK数据集由Yasumasa Onoe、Michael J.Q. Zhang、Eunsol Choi和Greg Durrett等研究人员于2021年提出,并在NeurIPS 2021的数据集与基准测试轨道上发表。该数据集专注于常识推理领域,特别是针对实体知识的推理任务。CREAK旨在通过提供包含真实与虚假声明的句子,以及相应的解释和实体信息,推动自然语言处理领域中对常识推理能力的深入研究。其数据来源于维基百科,涵盖了广泛的实体和情境,为研究者提供了一个丰富的资源,以探索模型在处理复杂常识推理任务时的表现。

当前挑战

CREAK数据集面临的挑战主要体现在两个方面。首先,常识推理本身具有高度的复杂性和模糊性,模型需要理解隐含的背景知识和上下文关系,才能准确判断声明的真实性。其次,在数据集的构建过程中,如何确保标注的一致性和准确性是一个关键问题。由于常识推理涉及主观判断,不同标注者可能对同一声明有不同的理解,因此需要设计严格的标注流程和质量控制机制。此外,数据集中包含的实体多样性也增加了模型泛化的难度,要求模型具备较强的跨领域推理能力。

常用场景

经典使用场景

CREAK数据集专为常识推理任务设计,广泛应用于自然语言处理领域,特别是在实体知识的推理和验证方面。研究者利用该数据集训练和评估模型,以提升模型在理解复杂实体关系及常识推理方面的能力。通过提供丰富的实体信息和详细的解释,CREAK为模型提供了深入学习和推理的基础。

解决学术问题

CREAK数据集解决了自然语言处理中常识推理的挑战,特别是在实体知识的验证和推理方面。通过提供大量标注数据,该数据集帮助研究者开发出能够准确判断陈述真实性的模型,从而推动了常识推理领域的研究进展。其独特的对比集设计进一步增强了模型的鲁棒性和泛化能力。

衍生相关工作

基于CREAK数据集,研究者们开发了多种先进的自然语言处理模型,如基于Transformer的预训练模型和对比学习框架。这些模型在常识推理任务中表现出色,进一步推动了该领域的技术发展。CREAK数据集还激发了更多关于实体知识和常识推理的研究,为后续工作提供了宝贵的数据和基准。

以上内容由遇见数据集搜集并总结生成