MINT

收藏github2023-09-01 更新2025-02-08 收录

下载链接:

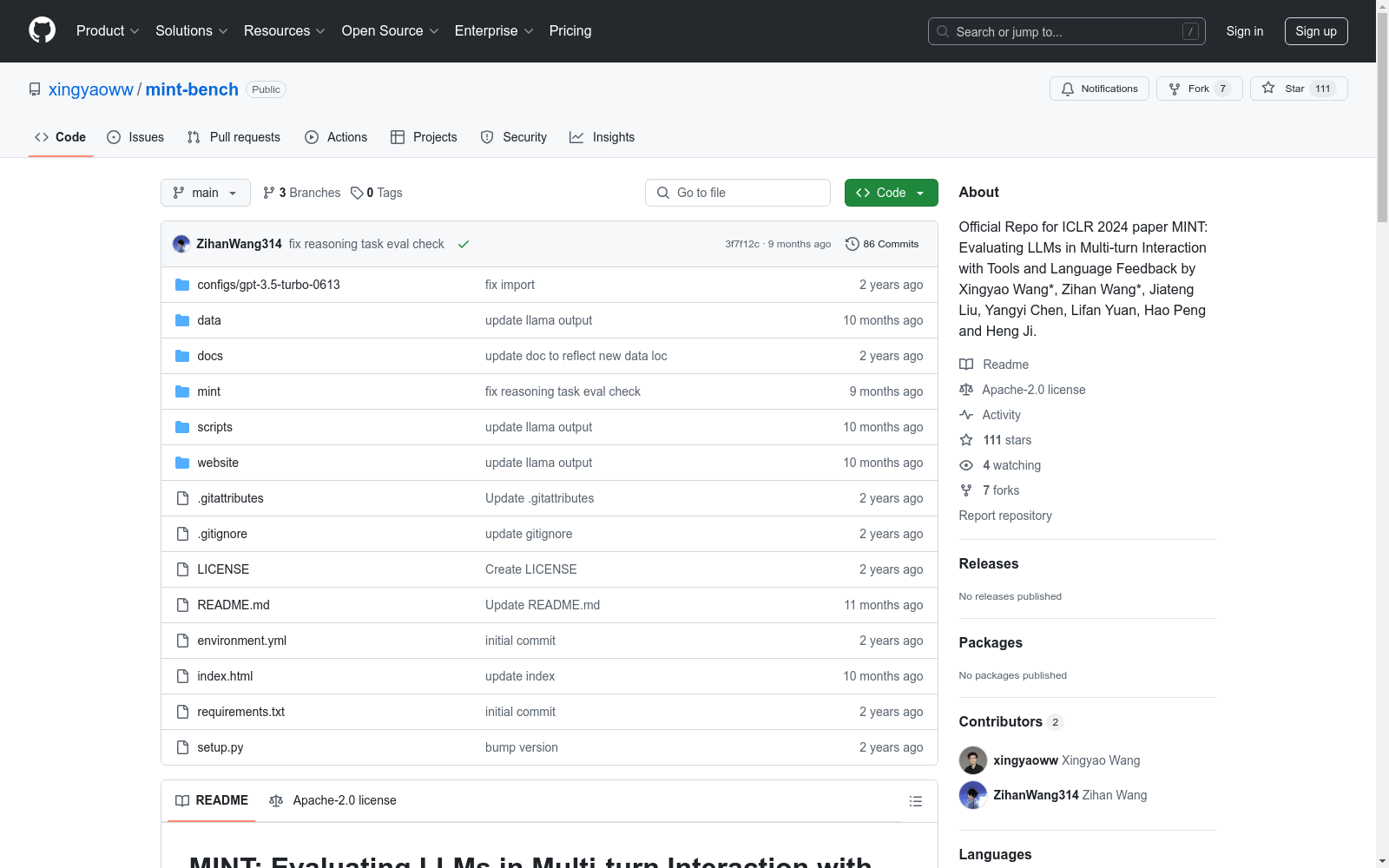

https://github.com/xingyaoww/mint-bench

下载链接

链接失效反馈资源简介:

大型语言模型(LLMs)通常会与用户进行多轮交互,然而,现有的评估通常只关注单轮交互,忽视了它们的交互能力。因此,MINT数据集(Wang等人,2023e)被设计用于评估大型语言模型在涉及多轮交互的任务中的表现,包括使用工具或利用自然语言反馈。在这个评估框架中,被测试的模型可以通过执行Python代码来访问工具,并接收由GPT-4模拟的反馈,以促进多轮交互评估。

Large Language Models (LLMs) often engage in multi-turn interactions with users; however, existing evaluations typically focus on single-turn interactions, neglecting their interaction capabilities. Therefore, the MINT dataset (Wang et al., 2023e) has been designed to assess the performance of large language models in tasks involving multi-turn interactions, including the use of tools or leveraging natural language feedback. Within this evaluation framework, the tested models can access tools by executing Python code and receive feedback simulated by GPT-4 to facilitate multi-turn interaction evaluations.

提供机构:

University of Illinois Urbana-Champaign et al.

创建时间:

2023-09-01

原始信息汇总

MINT 数据集概述

数据集简介

- 名称: MINT (Multi-turn Interaction with Tools and Language Feedback)

- 目的: 评估大型语言模型(LLMs)在以下两方面的能力:

- 使用工具

- 利用自然语言反馈

- 特点: 专注于多轮交互任务解决

- 论文: MINT: Evaluating LLMs in Multi-turn Interaction with Tools and Language Feedback

- 作者: Xingyao Wang*, Zihan Wang*, Jiateng Liu, Yangyi Chen, Lifan Yuan, Hao Peng, Heng Ji

数据集使用

环境设置

- 推荐方式: Docker 容器

- 替代方式: 本地 Conda 环境

- 依赖文件:

environment.yml - 安装命令:

pip install -e .

- 依赖文件:

模型评估

- 支持模型类型:

- HuggingFace 兼容的开源模型

- API 基础的闭源模型 (需提供 API Key)

- 支持的 API: OpenAI, Bard, Claude

配置生成

- 配置文件生成脚本:

mint/configs/generate_config.py - 默认输出目录:

- 配置文件:

configs/ - 模型输出:

data/outputs

- 配置文件:

结果分析

- 分析工具:

- Jupyter Notebook:

scripts/notebook/analyze_output.ipynb - Python 脚本:

scripts/convert_outputs.py

- Jupyter Notebook:

- 可视化工具:

- Streamlit 应用:

scripts/visualizer.py

- Streamlit 应用:

贡献指南

- 接受贡献类型:

- 模型输出

- 工具

- 数据

- 贡献方式: 通过 PR 提交到

data/outputs目录

引用信息

bibtex @misc{wang2023mint, title={MINT: Evaluating LLMs in Multi-turn Interaction with Tools and Language Feedback}, author={Xingyao Wang and Zihan Wang and Jiateng Liu and Yangyi Chen and Lifan Yuan and Hao Peng and Heng Ji}, year={2023}, eprint={2309.10691}, archivePrefix={arXiv}, primaryClass={cs.CL} }

搜集汇总

数据集介绍

构建方式

MINT数据集的构建旨在评估大型语言模型(LLMs)在多轮交互中解决任务的能力,特别是通过使用工具和自然语言反馈。该数据集通过设计一系列多轮交互任务,结合工具使用和语言反馈机制,构建了一个全面的评估框架。数据集的构建过程包括任务设计、工具集成、反馈生成以及模型输出的自动化评估,确保了对LLMs在多轮交互中的表现进行全面且系统的评估。

特点

MINT数据集的特点在于其专注于多轮交互场景下的模型评估,涵盖了工具使用和自然语言反馈两个关键维度。数据集提供了多样化的任务类型,能够全面测试模型在不同情境下的表现。此外,MINT支持对开源模型和闭源API模型的评估,具有高度的灵活性和扩展性。数据集还提供了详细的配置文件和自动化脚本,便于用户快速进行实验设置和结果分析。

使用方法

使用MINT数据集进行模型评估时,用户首先需要设置环境,推荐使用Docker进行隔离执行以确保安全性。通过配置文件和脚本,用户可以指定实验设置,如模型选择、数据集选择等。运行实验后,用户可以通过提供的分析工具和可视化界面对模型输出进行详细分析。MINT还支持用户贡献自己的模型输出,进一步丰富数据集的多样性和实用性。

背景与挑战

背景概述

MINT数据集由Xingyao Wang、Zihan Wang等研究人员于2023年提出,旨在评估大型语言模型(LLMs)在多轮交互任务中的表现,特别是在使用工具和自然语言反馈方面的能力。该数据集的提出源于对LLMs在实际应用场景中表现的需求,尤其是在需要复杂交互和反馈的领域。MINT的创建标志着对LLMs评估标准的进一步细化,推动了相关领域的研究进展。通过提供多轮交互任务,MINT为研究人员提供了一个标准化的评估平台,有助于深入理解LLMs在复杂任务中的潜力与局限。

当前挑战

MINT数据集面临的挑战主要体现在两个方面。首先,多轮交互任务的复杂性要求模型不仅具备强大的语言理解能力,还需能够有效利用工具和反馈信息。这种复杂性增加了模型在任务执行中的难度,尤其是在需要动态调整策略的场景中。其次,数据集的构建过程中,研究人员需要确保任务设计的多样性和真实性,以覆盖广泛的交互场景。此外,由于涉及模型生成的代码执行,安全性问题也成为一大挑战,研究人员必须确保代码执行环境的安全隔离,避免潜在的风险。这些挑战共同构成了MINT数据集在推动LLMs评估领域发展中的关键障碍。

常用场景

经典使用场景

MINT数据集主要用于评估大型语言模型(LLMs)在多轮交互任务中的表现,特别是在使用工具和处理自然语言反馈方面的能力。该数据集通过模拟复杂的用户交互场景,帮助研究者深入理解模型在实际应用中的表现和局限性。

实际应用

在实际应用中,MINT数据集可用于开发和测试智能助手、客服机器人等需要多轮交互的系统。通过评估模型在处理复杂用户请求时的表现,开发者能够优化系统设计,提升用户体验。

衍生相关工作

MINT数据集衍生了一系列相关研究,包括改进多轮对话系统的模型架构、优化工具使用策略以及开发更高效的语言反馈机制。这些工作进一步推动了LLMs在实际应用中的性能提升和广泛应用。

以上内容由遇见数据集搜集并总结生成