【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

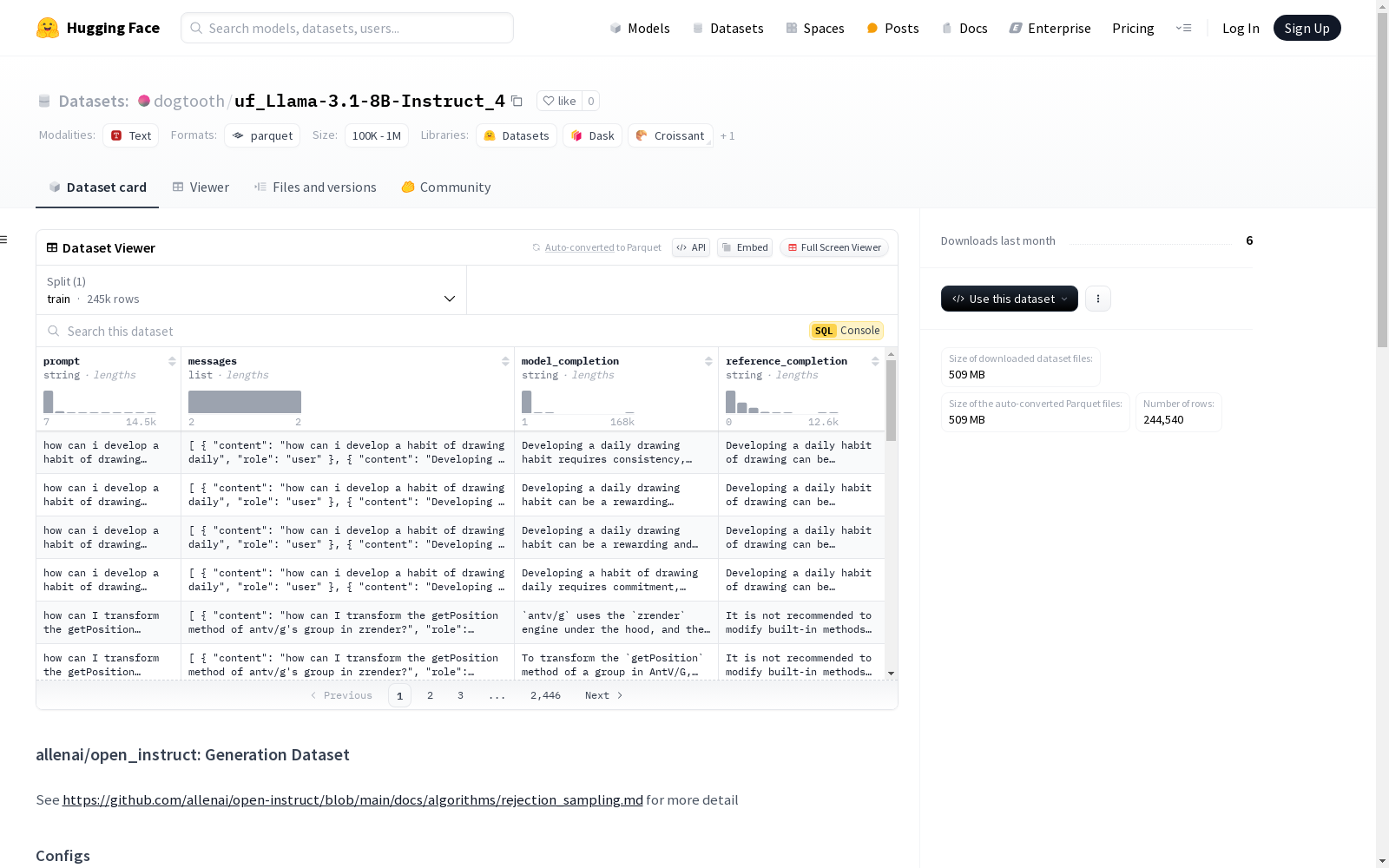

uf_Llama-3.1-8B-Instruct_4

收藏Hugging Face2025-01-05 更新2025-01-06 收录

下载链接:

https://huggingface.co/datasets/dogtooth/uf_Llama-3.1-8B-Instruct_4

下载链接

链接失效反馈官方服务:

资源简介:

该数据集是一个生成型数据集,主要用于训练和评估生成模型。数据集配置中使用了HuggingFaceH4/ultrafeedback_binarized数据集的一部分,并指定了模型的路径为meta-llama/Llama-3.1-8B-Instruct。生成过程中,模型生成了多个响应,并使用了特定的温度参数和top_p参数来控制生成的质量和多样性。数据集的目标是用于聊天技能的生成任务。

创建时间:

2024-12-28

搜集汇总

数据集介绍

构建方式

uf_Llama-3.1-8B-Instruct_4数据集的构建基于HuggingFaceH4/ultrafeedback_binarized数据集,通过混合数据集的方式进行生成。具体而言,该数据集采用了生成模式,利用meta-llama/Llama-3.1-8B-Instruct模型进行指令生成,并通过拒绝采样算法优化生成结果。生成过程中,模型生成了四个不同的响应,每个响应的长度限制在2048个token以内,温度参数设置为0.7,以确保生成结果的多样性与可控性。最终生成的数据以JSONL格式保存,并推送到Hugging Face平台。

使用方法

使用该数据集时,用户需首先从Hugging Face平台下载生成脚本与数据文件。随后,通过运行生成脚本,用户可以复现数据集的生成过程,或基于现有数据进行进一步的分析与模型训练。生成脚本支持多种参数配置,用户可根据需求调整生成响应的数量、长度及温度等参数。生成结果可直接用于模型训练,或通过Hugging Face平台进行共享与协作。该数据集的使用方法灵活多样,适用于研究人员与开发者在自然语言生成领域进行实验与创新。

背景与挑战

背景概述

uf_Llama-3.1-8B-Instruct_4数据集是由AllenAI团队开发的一个生成式数据集,旨在推动大规模语言模型在指令生成任务中的应用。该数据集基于HuggingFaceH4/ultrafeedback_binarized数据集进行构建,并采用了Llama-3.1-8B-Instruct模型作为生成工具。数据集的核心研究问题在于如何通过高质量的指令生成数据来提升模型的对话能力和任务执行效果。该数据集的创建标志着在自然语言处理领域中对生成式模型的进一步探索,尤其是在多轮对话和复杂指令理解方面,具有重要的研究价值和应用潜力。

当前挑战

uf_Llama-3.1-8B-Instruct_4数据集在构建过程中面临多重挑战。首先,生成式任务本身对数据的多样性和质量要求极高,如何确保生成指令的准确性和实用性是一个关键问题。其次,数据集的构建依赖于大规模计算资源和高性能模型,这对硬件和算法优化提出了较高要求。此外,数据集的标注和筛选过程需要大量人工干预,以确保生成内容符合预期目标。最后,如何在生成过程中平衡模型的创造性与可控性,避免生成无关或低质量内容,也是该数据集面临的主要技术挑战。

常用场景

经典使用场景

在自然语言处理领域,uf_Llama-3.1-8B-Instruct_4数据集广泛应用于生成式任务,尤其是在对话系统和指令生成任务中。该数据集通过结合HuggingFaceH4/ultrafeedback_binarized数据集,生成了高质量的对话数据,适用于训练和评估大规模语言模型的生成能力。其经典使用场景包括生成多样化的对话回复、指令理解和执行任务,以及基于用户反馈的模型优化。

解决学术问题

uf_Llama-3.1-8B-Instruct_4数据集解决了生成式任务中数据质量不足和多样性有限的问题。通过引入高质量的偏好数据,该数据集为模型提供了更丰富的上下文和反馈信息,从而提升了生成结果的准确性和多样性。此外,该数据集还为研究模型在复杂指令理解和执行任务中的表现提供了重要支持,推动了生成式模型在学术研究中的进一步发展。

实际应用

在实际应用中,uf_Llama-3.1-8B-Instruct_4数据集被广泛用于开发智能客服系统、虚拟助手和自动化指令执行工具。通过利用该数据集训练的语言模型,企业能够提供更自然、更高效的客户服务体验,同时减少人工干预的需求。此外,该数据集还被用于教育领域,帮助开发智能辅导系统,为学生提供个性化的学习指导。

数据集最近研究

最新研究方向

在自然语言处理领域,uf_Llama-3.1-8B-Instruct_4数据集的最新研究方向聚焦于生成模型的优化与评估。该数据集结合了HuggingFaceH4/ultrafeedback_binarized数据,通过多轮对话生成任务,探索了模型在复杂指令理解与生成任务中的表现。研究重点包括如何通过拒绝采样技术提升生成质量,以及如何利用大规模预训练模型如Llama-3.1-8B-Instruct进行高效微调。这些研究不仅推动了生成模型在实际应用中的性能提升,也为对话系统的智能化发展提供了新的技术路径。

以上内容由遇见数据集搜集并总结生成