MMLONGBENCH-DOC

收藏arXiv2024-07-02 更新2024-07-04 收录

下载链接:

https://mayubo2333.github.io/MMLongBench-Doc

下载链接

链接失效反馈官方服务:

资源简介:

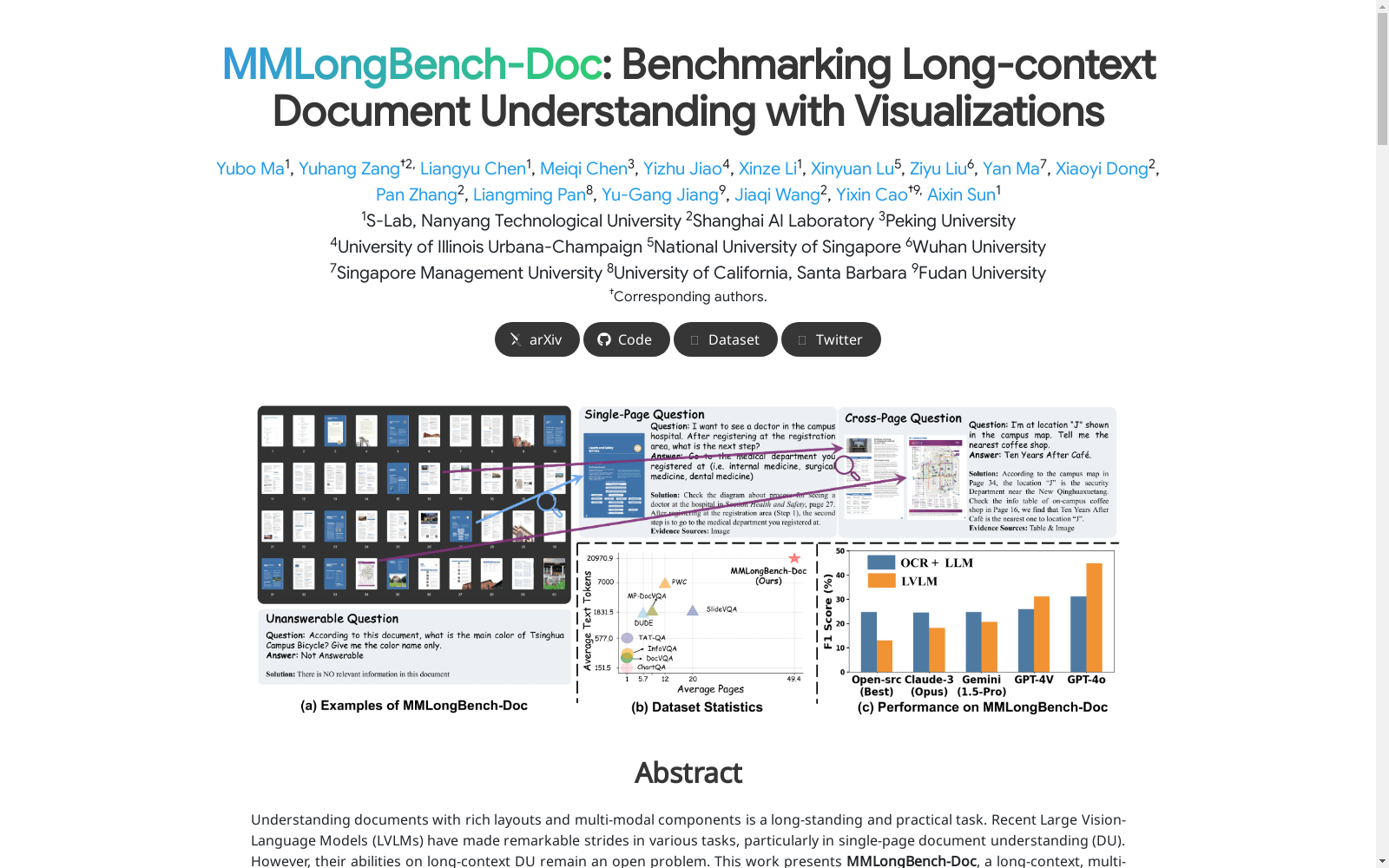

MMLONGBENCH-DOC数据集由南洋理工大学S-Lab等机构创建,旨在评估大型视觉-语言模型在长篇文档理解方面的能力。该数据集包含130个PDF格式的长篇文档,平均每篇文档49.4页,共20,971个文本标记。数据集的创建过程包括文档收集、问题与答案收集和质量控制三个阶段。MMLONGBENCH-DOC主要应用于评估模型在长篇文档中的信息定位和跨页理解能力,旨在解决当前模型在处理长篇文档时面临的挑战。

The MMLONGBENCH-DOC dataset was developed by S-Lab at Nanyang Technological University and other institutions, with the goal of evaluating the long-form document understanding capabilities of large vision-language models. This dataset comprises 130 long-form documents in PDF format, averaging 49.4 pages per document and totaling 20,971 text tokens. The dataset construction process includes three stages: document collection, question-answer pair collection, and quality control. MMLONGBENCH-DOC is primarily applied to assess models' abilities in information localization and cross-page comprehension within long-form documents, aiming to tackle the challenges encountered by current models when processing lengthy documents.

提供机构:

南洋理工大学S-Lab, 上海人工智能实验室, 北京大学, 伊利诺伊大学厄巴纳-香槟分校, 新加坡国立大学, 武汉大学, 新加坡管理大学, 加州大学圣巴巴拉分校, 复旦大学

创建时间:

2024-07-02

原始信息汇总

数据集概述

数据集名称

MMLongBench-Doc

数据集描述

MMLongBench-Doc 是一个用于评估长上下文文档理解的多模态基准数据集。该数据集包含 1,091 个专家标注的问题,基于 135 个长篇 PDF 格式的文档构建,每个文档平均有 47.5 页和 21,214 个文本标记。

数据集特点

- 多模态性:所有选定的文档都是 PDF 格式,包含丰富的布局和多模态组件,包括文本、表格、图表和图像。问题从这些多模态证据中仔细标注。

- 长上下文:每个文档平均有 47.5 页和 21,214 个标记。此外,33.0% 的问题是跨页问题,需要收集和推理多个页面的信息。

- 挑战性:在 14 个 LVLMs 上的实验表明,长上下文文档理解对当前模型提出了极大的挑战。即使表现最好的 LVLM,GPT-4o,其总体 F1 分数也仅为 44.9%。

数据集结构

- 文档数量:135 个文档

- 问题数量:1,091 个问题

- 平均页数:47.5 页

- 平均文本标记数:21,214 个

- 领域覆盖:7 个不同领域

数据集目标

该数据集旨在为长上下文文档理解任务提供一个统一且量化的评估基准,以推动未来更强大的长上下文 LVLMs 的研究。

搜集汇总

数据集介绍

构建方式

MMLONGBENCH-DOC数据集的构建采用了严谨的三阶段流程,包括文档收集、问答收集和质量控制。文档收集阶段从四个现有数据集和多种资源中选取了130份平均49.4页、20,971文本标记的PDF格式长文档。问答收集阶段由十位专家级标注者对现有问题进行编辑,并为所有收集的文档创建新问题。质量控制阶段采用半自动的三轮审查过程,结合人类标注者和LVLMs的评估,以确保数据集的标注质量。

特点

MMLONGBENCH-DOC数据集的特点在于其长语境、多模态和综合性。它包含1,062个专家标注的问题,这些问题依赖于来自文档中的文本、图像、图表、表格和布局结构等不同来源的证据,以及不同的位置(即页码)。此外,33.2%的问题是跨页问题,需要跨多页的证据。22.8%的问题是设计为无法回答的,用于检测潜在的幻觉。该数据集旨在全面评估LVLMs在长语境文档理解方面的能力。

使用方法

使用MMLONGBENCH-DOC数据集的方法包括三个步骤:响应生成、答案提取和分数计算。首先,LVLMs被指示以自由风格生成长响应。然后,使用统一的LLM-based答案提取器将长响应转换为短答案。最后,使用基于规则的分数计算器评估转换后的短答案。该数据集适用于评估LVLMs在处理长文档时的定位能力和跨页理解能力,以及检测模型的幻觉倾向。

背景与挑战

背景概述

文档理解是人工智能领域中的一个关键任务,特别是在处理包含丰富布局和多模态组件的文档时。MMLONGBENCH-DOC数据集的创建旨在评估大型视觉语言模型(LVLMs)在理解长上下文文档方面的能力。该数据集由130篇长篇PDF格式的文档组成,每篇文档平均49.4页,包含20,971个文本标记。MMLONGBENCH-DOC数据集于2024年7月由来自南洋理工大学、上海人工智能实验室、北京大学、伊利诺伊大学香槟分校、新加坡国立大学、武汉大学、新加坡管理大学、加州大学圣巴巴拉分校和复旦大学的研究人员共同创建。该数据集的核心研究问题是评估LVLMs在长上下文文档理解任务上的性能,并对相关领域产生了深远影响,为LVLMs的长上下文文档理解能力提供了新的评估标准和挑战。

当前挑战

MMLONGBENCH-DOC数据集面临的挑战包括:1) 定位挑战:从大量异构信息中识别和检索信息,类似于“大海捞针”的任务;2) 跨页理解挑战:收集和推理不同页面上的多源信息。这些挑战超出了上述单页文档理解数据集的评价范围。此外,构建过程中遇到的挑战包括如何确保注释质量,以及如何平衡现有问题和新增问题的数量和分布,以保持数据集的多样性和挑战性。

常用场景

经典使用场景

MMLONGBENCH-DOC数据集被设计用来评估大型视觉语言模型(LVLMs)在处理长文本文档方面的理解能力。该数据集包含了130份平均49.4页的PDF文档,涵盖了丰富的布局和多媒体元素。其最经典的使用场景是作为模型训练和评估的平台,特别是对于需要理解跨页和多模态信息的应用,如法律文件、技术手册、学术论文等。

实际应用

MMLONGBENCH-DOC数据集的实际应用场景包括但不限于法律文件分析、技术文档理解、学术论文摘要生成等。例如,在法律文件分析中,该数据集可以帮助模型理解复杂的法律条文和案例,从而为法律专业人士提供辅助决策。在技术文档理解中,该数据集可以帮助模型理解设备的操作说明和维护指南,从而提高用户的使用体验。

衍生相关工作

MMLONGBENCH-DOC数据集的发布推动了LVLMs在长文本文档理解方面的发展,并衍生出许多相关研究。例如,一些研究试图通过改进模型架构或训练策略来提高LVLMs在MMLONGBENCH-DOC上的表现。此外,一些研究也试图探索LVLMs在处理其他类型的长文本文档(如网页、电子邮件等)时的能力。

以上内容由遇见数据集搜集并总结生成