FairEval

收藏github2023-05-01 更新2025-02-07 收录

下载链接:

https://github.com/i-Eval/FairEval

下载链接

链接失效反馈资源简介:

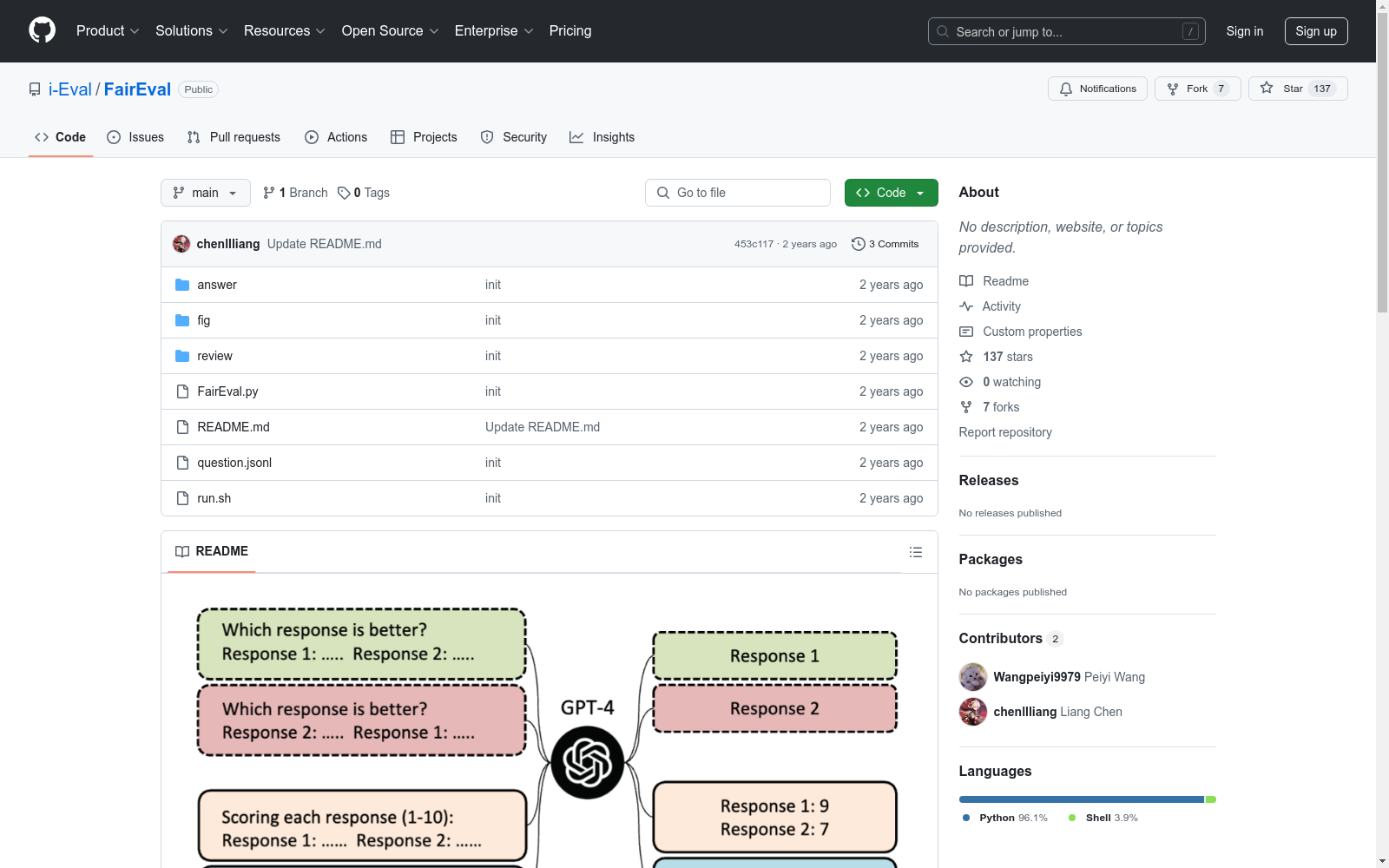

FairEval 数据集中的所有80条指令均来源于Vicuna评估数据集。创建者在多种模型(包括ChatGPT、Vicuna-13B和Alpaca-13B)上生成了相应的回答。随后,使用ChatGPT、GPT-4等模型对这些不同的回答进行了评估。此次评估突显了在使用大型语言模型(LLMs)作为评估者时需要格外谨慎,因为所获得的结果可能具有一定的局限性。

All 80 instructions in the FairEval dataset are sourced from the Vicuna evaluation dataset. The creators generated corresponding answers on multiple models, including ChatGPT, Vicuna-13B, and Alpaca-13B. Subsequently, these diverse answers were evaluated using models such as ChatGPT and GPT-4. This evaluation highlights the necessity for extra caution when using large language models (LLMs) as evaluators, as the results obtained may exhibit certain limitations.

提供机构:

北京大学等

创建时间:

2023-05-01

原始信息汇总

数据集概述

基本信息

- 标题: Large Language Models are not Fair Evaluators

- 研究背景: 探讨大型语言模型(如ChatGPT和GPT-4)作为评估者的可靠性,揭示其存在的位置偏见问题。

- 研究内容:

- 揭示大型语言模型存在严重的位置偏见,影响其作为评估者的公平性。

- 提出两种校准策略:Multiple Evidence Calibration (MEC) 和 Balanced Position Calibration (BPC)。

- 通过实验结果证明所提方法的有效性,显示更接近人类判断。

数据集内容

- 包含文件:

question.jsonl: 问题文件。answer/answer_$m1.jsonl和answer/answer_$m2.jsonl: 模型回答文件。review/review_${m1}_${m2}_${eval_model}_mec${k}_bpc${bpc}.json: 评估结果文件。review/review_gpt35_vicuna-13b_human.txt: 人类判断结果文件。

使用方法

-

运行命令: bash python3 FairEval.py -q question.jsonl -a answer/answer_$m1.jsonl answer/answer_$m2.jsonl -o review/review_${m1}${m2}${eval_model}_mec${k}_bpc${bpc}.json -m $eval_model --bpc $bpc -k $k

-

参数说明:

m1和m2: 模型名称。eval_model: 评估模型(如gpt-3.5-turbo-0301或gpt-4)。bpc: 是否使用BPC策略(0或1)。k: MEC策略的证据数量。

参考文献

- 引用文献: bib @article{Wang2023LargeLM, title={Large Language Models are not Fair Evaluators}, author={Peiyi Wang and Lei Li and Liang Chen and Dawei Zhu and Binghuai Lin and Yunbo Cao and Qi Liu and Tianyu Liu and Zhifang Sui}, journal={ArXiv}, year={2023}, volume={abs/2305.17926}, }

搜集汇总

数据集介绍

构建方式

FairEval数据集的构建旨在评估大型语言模型(LLMs)作为评估者的公平性。研究团队通过揭示LLMs在评估过程中表现出的严重位置偏差,开发了两种校准策略:多重证据校准(MEC)和平衡位置校准(BPC)。这些策略通过实验验证,能够有效减少LLMs的偏差,使其评估结果更接近人类判断。数据集的构建过程包括生成问题、收集模型回答,并利用MEC和BPC策略进行校准评估。

使用方法

使用FairEval数据集时,研究者需首先准备问题文件和模型生成的回答文件。通过运行提供的Python脚本,可以选择使用MEC和BPC策略进行评估。脚本支持多种评估模型,如GPT-3.5和GPT-4,并允许用户自定义证据数量和是否启用BPC策略。评估结果将生成详细的评审文件,研究者可以将其与人类判断结果进行对比,以验证模型的公平性和准确性。

背景与挑战

背景概述

随着ChatGPT和GPT-4等大型语言模型(LLMs)在多种任务中展现出卓越性能,它们被广泛用作人类注释者和评估者。然而,LLMs作为评估者的可靠性尚未得到充分验证,尤其是在面对文本指令和输入时的敏感性。2023年,由Peiyi Wang等人提出的FairEval数据集,旨在揭示LLMs在评估过程中存在的位置偏差问题,并提出多种证据校准(MEC)和平衡位置校准(BPC)策略以提升其公平性。该数据集通过实验验证了这些策略的有效性,展示了与人类判断更接近的结果,为LLMs在评估任务中的应用提供了新的视角。

当前挑战

FairEval数据集的核心挑战在于解决LLMs作为评估者时的公平性问题。首先,LLMs在评估过程中表现出显著的位置偏差,这影响了其评估结果的公正性。其次,构建该数据集时,研究人员需要设计有效的校准策略(如MEC和BPC),以减轻LLMs的偏差并提升其与人类判断的一致性。此外,如何在大规模实验中验证这些策略的普适性和鲁棒性,也是该数据集面临的重要挑战。这些挑战不仅涉及技术层面的创新,还需要在实验设计和数据分析中保持严谨性,以确保研究结果的科学性和可靠性。

常用场景

经典使用场景

在自然语言处理领域,FairEval数据集被广泛应用于评估大型语言模型(LLMs)的公平性和可靠性。通过引入Multiple Evidence Calibration (MEC)和Balanced Position Calibration (BPC)策略,该数据集能够有效校准LLMs在评估任务中的位置偏差,从而提升其作为评估工具的公正性。

解决学术问题

FairEval数据集解决了LLMs在作为评估工具时存在的位置偏差问题。通过实验验证,该数据集展示了其校准策略能够显著减少LLMs的评估偏差,使其结果更接近人类判断。这一成果不仅揭示了LLMs作为评估工具的局限性,还为未来研究提供了改进方向。

实际应用

在实际应用中,FairEval数据集被用于优化LLMs在自动评估任务中的表现。例如,在自动问答系统和文本生成任务中,使用该数据集校准后的LLMs能够提供更为公正和准确的评估结果,从而提升系统的整体性能和用户体验。

数据集最近研究

最新研究方向

在自然语言处理领域,大型语言模型(LLMs)如ChatGPT和GPT-4的评估能力日益受到关注。然而,这些模型在作为评估者时存在显著的位置偏差,影响了其评估的公正性。近期研究通过引入多重证据校准(MEC)和平衡位置校准(BPC)策略,有效缓解了这一问题。这些策略不仅提升了模型评估的准确性,还使其更接近人类判断,为LLMs在自动评估任务中的应用开辟了新路径。这一进展对于提升模型评估的可靠性和公正性具有重要意义,推动了自然语言处理技术的进一步发展。

以上内容由遇见数据集搜集并总结生成