Multi-modal Stance Detection|多模态立场检测数据集|社交媒体分析数据集

收藏数据集概述

数据集名称

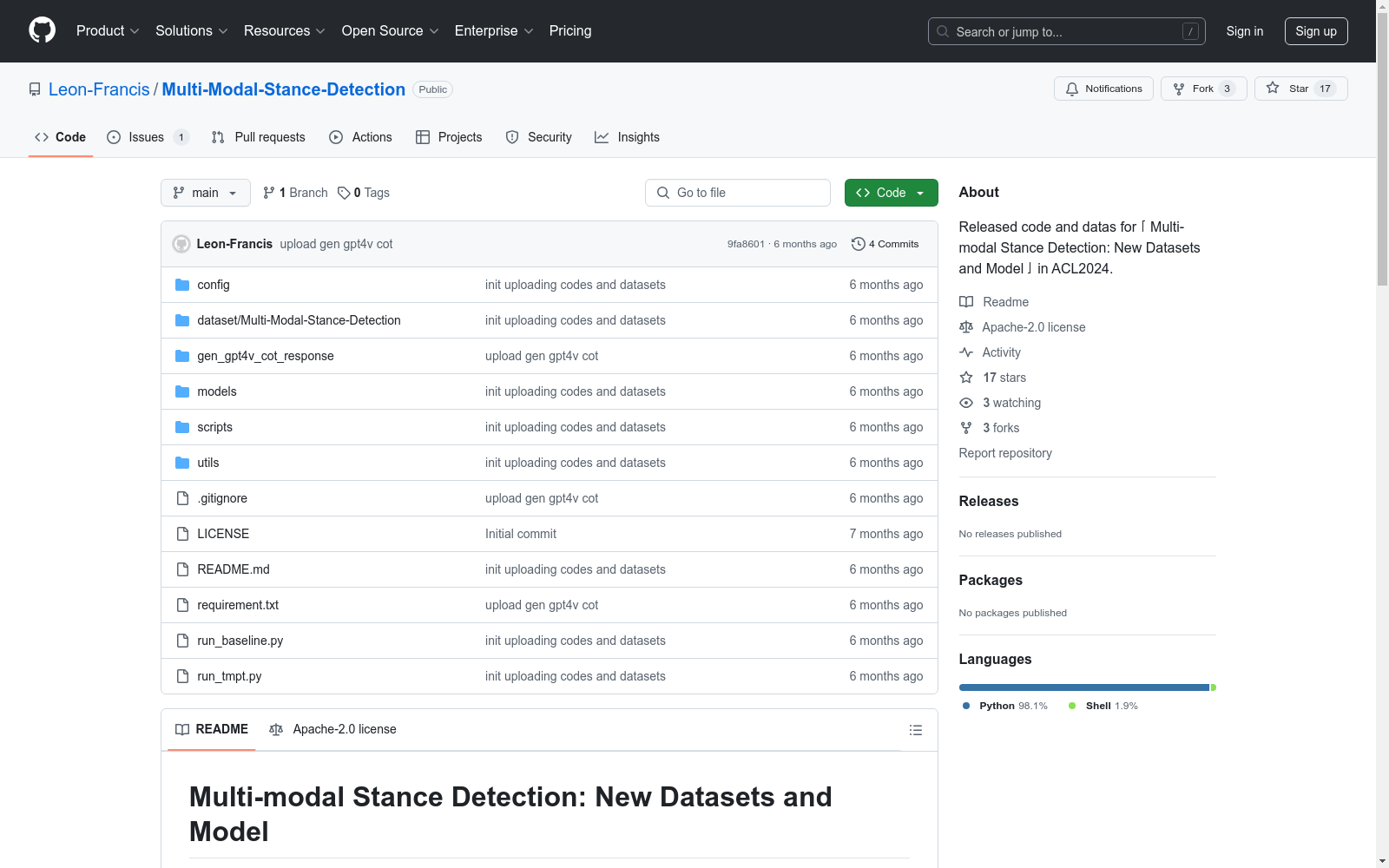

Multi-modal Stance Detection

数据集来源

本数据集来源于ACL2024的论文「Multi-modal Stance Detection: New Datasets and Model」。

数据集内容

由于Twitter的开发者协议和隐私政策限制,本数据集仅公开了Post IDs和用户ID,以及相应的标注结果。数据集主要包含Twitter的Post IDs和相关的标注信息。

数据集使用

数据集仅供非商业研究使用。

数据集补充内容

用户需申请Twitter开发者账号,并使用如Tweepy或twarc等工具,根据Post IDs补充具体内容。

数据集详细描述

更多数据集详情,请参阅数据描述。

数据集引用

bibtex @misc{liang2024multimodal, title={Multi-modal Stance Detection: New Datasets and Model}, author={Bin Liang and Ang Li and Jingqian Zhao and Lin Gui and Min Yang and Yue Yu and Kam-Fai Wong and Ruifeng Xu}, year={2024}, eprint={2402.14298}, archivePrefix={arXiv}, primaryClass={cs.CL} }

数据集联系方式

angli@stu.hit.edu.cn

中国区域交通网络数据集

该数据集包含中国各区域的交通网络信息,包括道路、铁路、航空和水路等多种交通方式的网络结构和连接关系。数据集详细记录了各交通节点的位置、交通线路的类型、长度、容量以及相关的交通流量信息。

data.stats.gov.cn 收录

学生课堂行为数据集 (SCB-dataset3)

学生课堂行为数据集(SCB-dataset3)由成都东软学院创建,包含5686张图像和45578个标签,重点关注六种行为:举手、阅读、写作、使用手机、低头和趴桌。数据集覆盖从幼儿园到大学的不同场景,通过YOLOv5、YOLOv7和YOLOv8算法评估,平均精度达到80.3%。该数据集旨在为学生行为检测研究提供坚实基础,解决教育领域中学生行为数据集的缺乏问题。

arXiv 收录

FER2013

FER2013数据集是一个广泛用于面部表情识别领域的数据集,包含28,709个训练样本和7,178个测试样本。图像属性为48x48像素,标签包括愤怒、厌恶、恐惧、快乐、悲伤、惊讶和中性。

github 收录

Breast Cancer Dataset

该项目专注于清理和转换一个乳腺癌数据集,该数据集最初由卢布尔雅那大学医学中心肿瘤研究所获得。目标是通过应用各种数据转换技术(如分类、编码和二值化)来创建一个可以由数据科学团队用于未来分析的精炼数据集。

github 收录

Breast-Caner-Detection Dataset

该数据集包含约5000张用于训练和验证的标记乳房X光图像,以及约1800张未标记的测试图像。所有图像均为(224,224,3)格式,标签从Density1到Density4,表示乳房密度的增加,并分为良性或恶性。

github 收录