Emo100DB

收藏arXiv2025-11-07 更新2025-11-11 收录

下载链接:

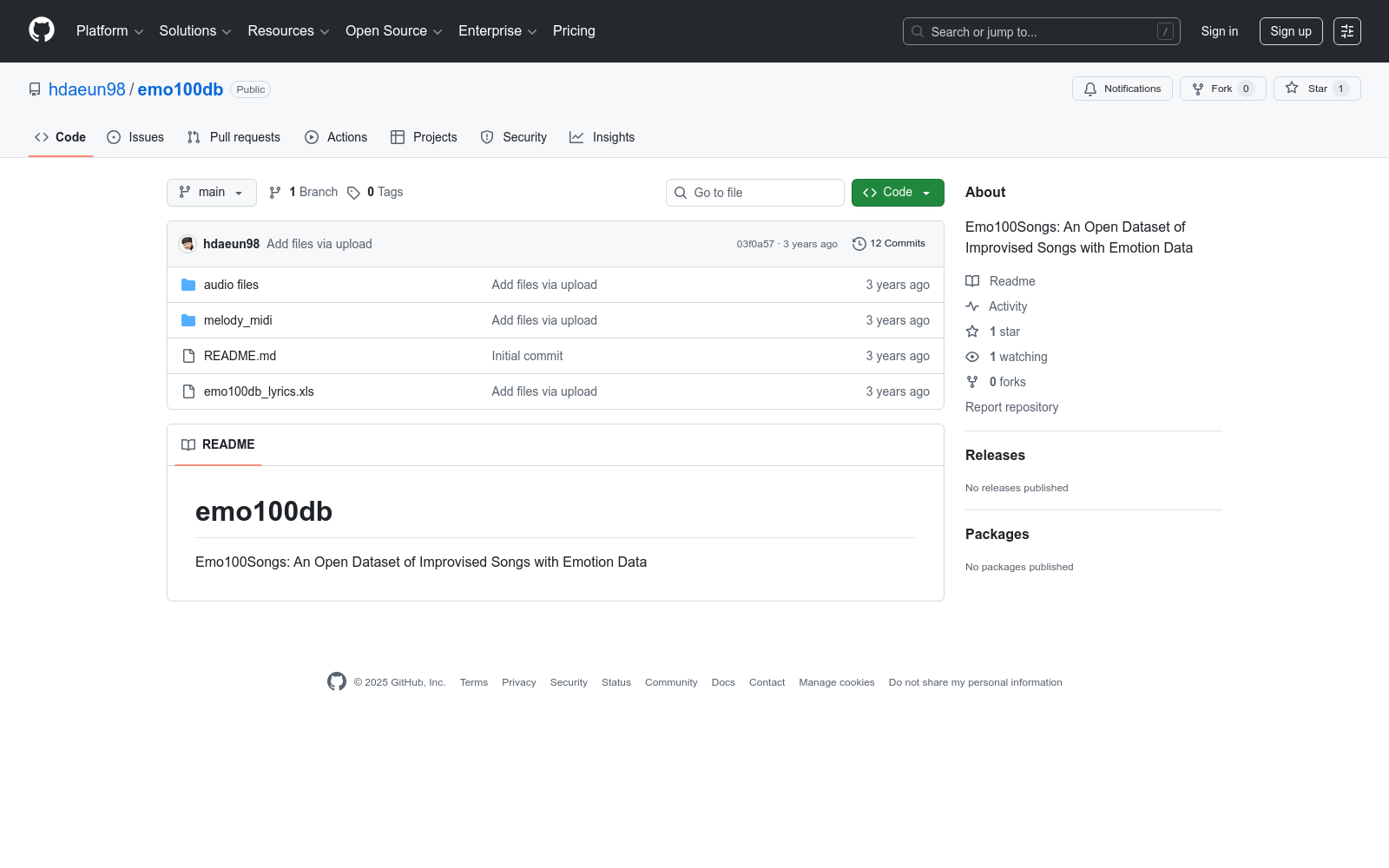

https://github.com/hdaeun98/emo100db

下载链接

链接失效反馈资源简介:

Emo100DB是一个包含100首即兴歌曲的数据集,这些歌曲被录音和转录,并基于Russell的情绪环模型进行了情绪数据标注。数据集由20名年轻人演奏、演唱和录音的旋律、歌词和乐器伴奏组成。在录音前,参与者需报告他们的情绪状态,情绪轴代表基于Russell的情绪环模型的情绪唤醒和效价。数据集被组织成四个情绪象限,包括从参与者录音中提取的歌词文本和旋律的MIDI文件,以及原始的WAV格式音频。该数据集旨在为音乐和情绪之间的多样探索提供全面的资源。

提供机构:

韩国延世大学

创建时间:

2025-11-07

原始信息汇总

Emo100Songs 数据集概述

数据集名称

Emo100Songs

数据集描述

Emo100Songs 是一个开放数据集,包含即兴创作的歌曲及其情感数据。

AI搜集汇总

数据集介绍

构建方式

在音乐情感计算研究领域,Emo100DB数据集的构建采用了系统性采集方法。研究团队招募了20名具备乐器演奏基础的青年参与者,要求他们在三周内选择五天即兴创作包含旋律、歌词和器乐伴奏的歌曲。每次录制前,参与者需基于Russell的情感环状模型,在唤醒度和效价维度上标注当前情感状态。最终收集的100首作品经过标准化处理,包含原始音频、MIDI格式旋律数据及文本歌词,并按情感象限进行分类存储。

特点

该数据集的核心价值体现在其多模态情感表征能力。不同于传统仅含音频标注的数据集,Emo100DB同步提供WAV格式音频、MIDI符号化旋律、文本歌词及创作者自评情感标签的四维数据。特别值得注意的是,所有情感标注均源自创作者第一视角,有效规避了听众标注的主观偏差。数据分布覆盖情感环状模型的四个象限,其中第四象限(低唤醒低效价)样本最为丰富,为研究青年群体情感表达偏好提供了独特视角。

使用方法

研究者可基于该数据集开展跨模态音乐情感分析。旋律数据可通过Word2Vec模型进行音程向量化,结合t-SNE降维可视化探索不同情感象限的聚类特征;歌词文本可利用Transformer库进行情感强度计算,辅以词云技术解析情感语义模式。实际应用中,建议将15秒标准化音频与对应MIDI符号数据联合建模,通过多模态融合技术构建情感识别系统,亦可结合问卷数据深入探讨创作背景与情感表达的关联机制。

背景与挑战

背景概述

音乐情感计算领域长期致力于探索音乐与人类情感的复杂关联。Emo100DB数据集由延世大学研究人员Daeun Hwang与Saebyul Park于2023年构建,该资源收录了20位青年音乐创作者基于罗素环状情感模型即兴创作的100首歌曲,完整包含旋律MIDI文件、歌词文本及原始音频数据。该数据集通过创作者第一视角的情感标注机制,突破了传统音乐情感识别数据集中听众标注的局限性,为多模态音乐情感分析提供了珍贵的研究样本。

当前挑战

在音乐情感识别领域,现有数据集普遍面临情感标注主观性强、多模态数据融合困难等核心问题。Emo100DB构建过程中需克服三重挑战:其一是确保即兴创作过程中情感标注的实时性与真实性,要求参与者在演唱前准确记录当前情感状态;其二是处理异构数据整合难题,需同步协调音频波形、符号化旋律与文本歌词的三维对应关系;其三是样本分布均衡性控制,最终数据在情感四象限呈现29:15:20:36的不均匀分布,反映了真实情感表达的自然偏差。

常用场景

经典使用场景

在音乐情感识别研究领域,Emo100DB数据集为探索即兴创作音乐与情感表达的关联提供了独特视角。该数据集通过整合旋律MIDI数据、歌词文本和原始音频,使研究者能够深入分析不同情感状态下音乐创作的特征模式。基于罗素环形情感模型的四象限分类,为跨模态情感分析建立了标准化框架,特别适用于研究创作者视角下的音乐情感表达机制。

解决学术问题

该数据集有效解决了音乐情感识别领域长期存在的多模态数据整合难题。通过提供创作者自我标注的情感数据,突破了传统基于听众标注的数据局限,为研究音乐创作过程中的情感表达真实性提供了新范式。其包含的符号化旋律数据与歌词文本的对应关系,为探索音乐语言与情感表达的深层关联开辟了创新路径,显著推进了音乐计算领域的发展。

衍生相关工作

基于Emo100DB的多模态特性,衍生出多项创新性研究。研究者利用其MIDI旋律数据开发了基于Word2Vec的情感特征提取方法,实现了音乐符号数据的语义化表示。在歌词分析方面,结合transformer架构的情感分析技术,揭示了不同情感象限下语言表达的统计规律。这些工作推动了音乐情感计算与自然语言处理技术的交叉融合,为多模态情感计算研究奠定了重要基础。

以上内容由AI搜集并总结生成