PandaLM测试数据集

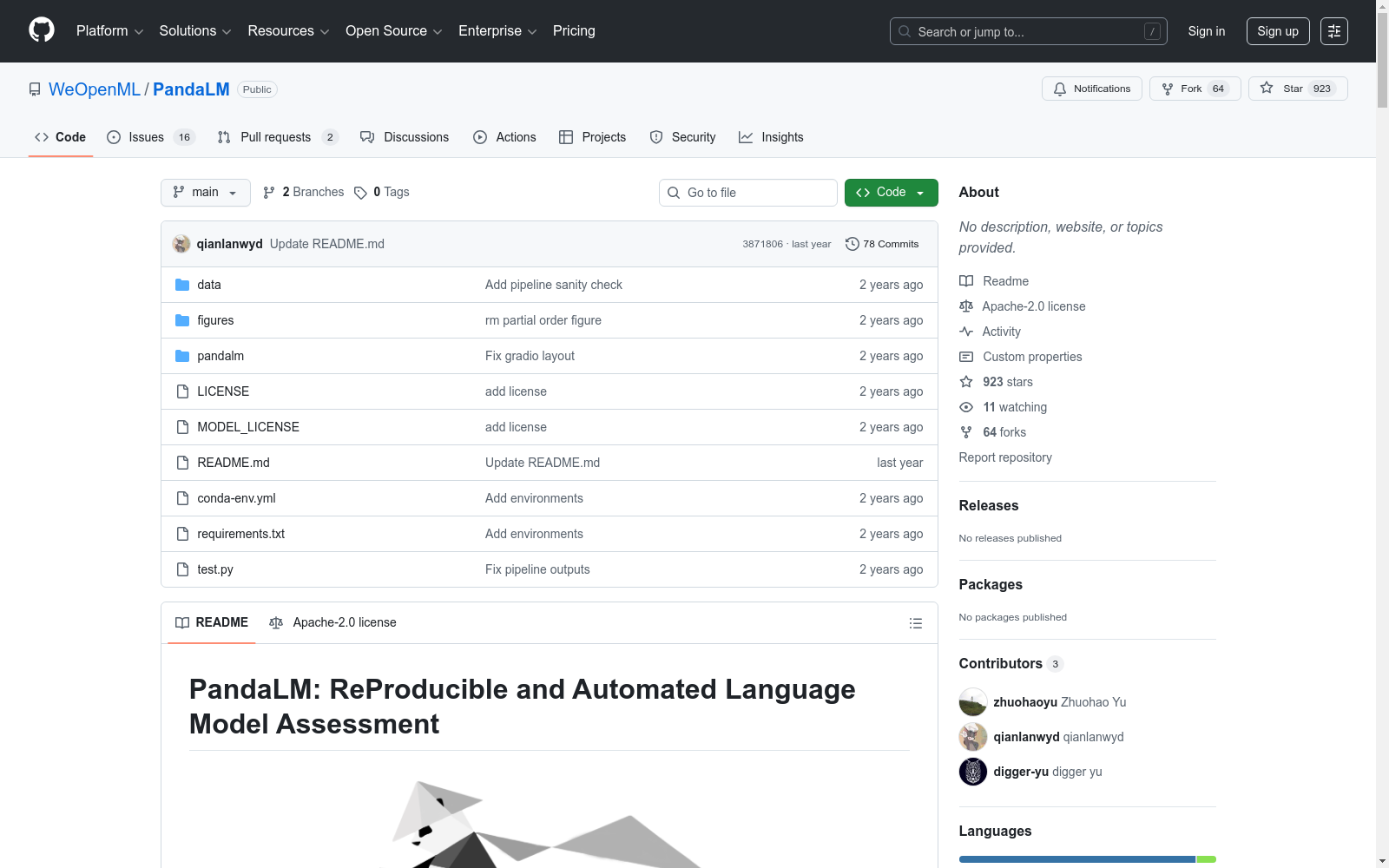

收藏PandaLM: ReProducible and Automated Language Model Assessment

概述

PandaLM 是一个旨在提供可重复和自动化的大型语言模型(LLM)比较评估的工具。通过给定相同的上下文,PandaLM 可以比较不同 LLM 的响应并提供决策理由和参考答案。目标用户包括拥有保密数据且寻求可重复性的组织和研究实验室。PandaLM 允许这些组织在不损害数据安全或产生高成本的情况下进行评估,并获得可重复的结果。

数据集

训练数据

训练数据旨在使模型不仅能够评估给定上下文的不同响应,还能生成参考响应。每个实例包含一个输入元组(指令、输入、响应1、响应2)和一个输出元组(评估结果、评估理由、参考响应)。输入元组的指令和输入来自 Alpaca 52K 数据,响应对由 LLaMA-7B、Bloom-7B、Cerebras-GPT-6.7B、OPT-7B 和 Pythia-6.9B 提供。输出元组包括评估结果、简要解释和参考响应。训练数据包含 300K 样本,原始未过滤数据有 1M 样本。

测试数据

测试数据是一个人工标注的数据集,用于验证 PandaLM 的评估能力。每个实例包含一个指令和输入,两个由不同指令调整的 LLM 生成的响应。任务是比较两个响应的质量。测试数据从 self-instruct 的人类评估数据中生成和采样,包含多样化的任务和内容。标注由三个不同的人类评估者独立完成。测试数据包含 1K 样本,原始未过滤数据有 2.5K 样本。

实验结果

PandaLM-7B 在测试数据集上的 F1 分数达到了 GPT-3.5 的 93.75% 和 GPT-4 的 88.28%。

贡献

欢迎对 PandaLM 进行贡献。请遵循以下步骤:

- 分叉仓库。

- 创建一个包含您更改的新分支。

- 提交一个包含清晰描述的更改的拉取请求。

引用

Plain @article{pandalm2024, title={PandaLM: An Automatic Evaluation Benchmark for LLM Instruction Tuning Optimization}, author={Wang, Yidong and Yu, Zhuohao and Zeng, Zhengran and Yang, Linyi and Wang, Cunxiang and Chen, Hao and Jiang, Chaoya and Xie, Rui and Wang, Jindong and Xie, Xing and Ye, Wei and Zhang, Shikun and Zhang, Yue}, booktitle={International Conference on Learning Representations (ICLR)}, year={2024} }

许可证

PandaLM 的模型权重遵循 LLaMA 许可证。训练数据许可证将在上传训练数据时添加。其余部分遵循 Apache License 2.0。