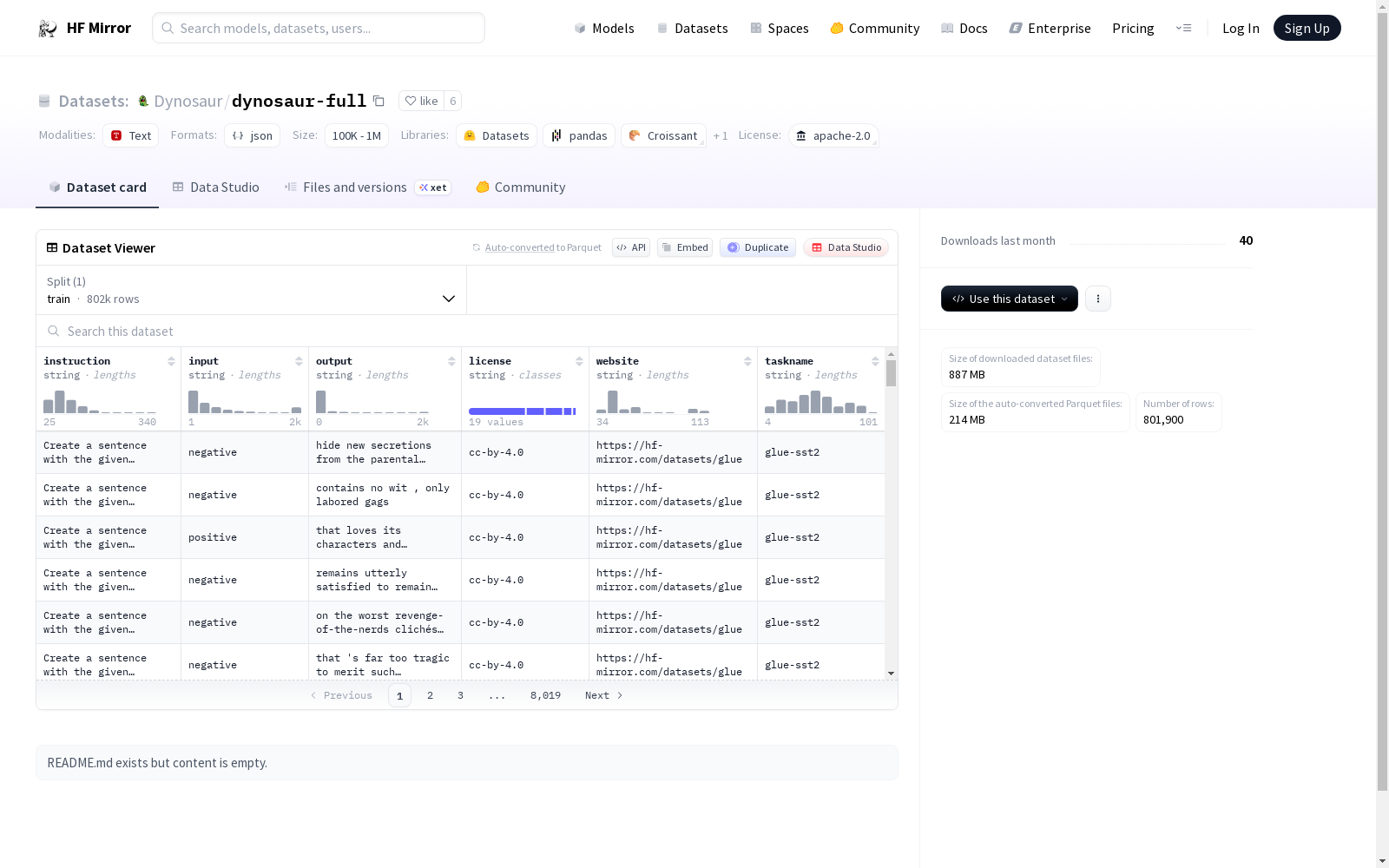

Dynosaur/dynosaur-full

收藏Hugging Face2023-07-06 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/Dynosaur/dynosaur-full

下载链接

链接失效反馈资源简介:

---

license: apache-2.0

viewer: true

---

提供机构:

Dynosaur

原始信息汇总

数据集概述

许可证信息

- 许可证类型: Apache-2.0

查看权限

- 查看权限: 允许查看

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,大规模预训练模型的兴起催生了多样化指令数据集的需求。Dynosaur/dynosaur-full数据集通过自动化流水线构建,其核心方法是从现有自然语言处理任务数据集中提取指令模板,并利用语言模型生成多样化的指令变体。该过程整合了多个来源的标注数据,通过结构化转换与语义增强,形成了覆盖广泛任务类型的指令集合,确保了数据在任务分布与语言表达上的丰富性。

使用方法

研究人员可利用该数据集进行指令调优或评估模型的指令遵循性能。典型使用方式包括加载数据集至训练框架,如Hugging Face Transformers库,通过预处理将指令与输入文本结合,进而微调预训练语言模型。数据集支持灵活的任务过滤与分割,便于针对特定领域或任务开展实验,同时其标准化格式确保了与主流工具链的无缝集成,助力于高效模型开发与比较分析。

背景与挑战

背景概述

在自然语言处理领域,动态任务指令数据集Dynosaur由斯坦福大学的研究团队于2023年创建,旨在应对传统静态指令数据集在泛化性和多样性上的局限。该数据集整合了多个现有指令数据集,通过自动化流程构建了一个覆盖广泛任务类型和领域的统一指令集合,其核心研究问题聚焦于提升模型在未见任务上的零样本泛化能力。Dynosaur的出现推动了指令微调技术的发展,为构建更强大、更通用的语言模型提供了关键数据支撑,显著影响了对话系统、任务导向型AI等研究方向。

当前挑战

Dynosaur数据集致力于解决指令学习中的泛化性挑战,即如何使模型在未经过显式训练的任务上也能有效执行指令。这一领域问题的难点在于指令的多样性和任务间的语义差异,要求数据集具备高度的覆盖范围和结构一致性。在构建过程中,研究团队面临数据整合的复杂性,包括不同来源数据格式的统一、任务去重与分类的自动化处理,以及确保指令质量与多样性的平衡。这些挑战使得数据集的构建需依赖精密的算法设计和人工验证,以维持其科学严谨性与实用性。

常用场景

经典使用场景

在自然语言处理领域,Dynosaur/dynosaur-full数据集以其动态和多样化的指令-任务对结构,为指令调优研究提供了经典范例。该数据集整合了多个现有指令数据集,通过统一的格式和丰富的任务类型,支持模型在单一框架下进行跨任务学习与泛化能力评估。研究者常利用其构建基准测试,以探索模型在复杂、多变指令下的响应性能,从而推动指令跟随技术的演进。

解决学术问题

Dynosaur/dynosaur-full数据集有效应对了指令调优中任务覆盖不足与数据异构的挑战。它通过系统化整合多源指令数据,解决了以往研究因数据集分散而导致的模型泛化能力受限问题,为统一评估框架的建立提供了数据基础。这一贡献显著促进了模型在零样本和少样本场景下的适应性研究,提升了指令驱动AI系统的鲁棒性与可扩展性。

实际应用

在实际应用中,Dynosaur/dynosaur-full数据集为开发通用型对话助手和任务导向系统提供了关键训练资源。企业与研究机构可借助其丰富的指令-任务对,训练模型处理用户多样化的自然语言请求,如信息检索、内容生成或复杂决策支持。这加速了智能客服、教育工具及自动化办公等场景的落地,增强了AI系统与人类交互的自然性与效率。

数据集最近研究

最新研究方向

在动态多任务学习领域,Dynosaur数据集凭借其涵盖广泛任务和指令的丰富结构,正成为推动模型泛化与适应能力研究的关键资源。当前前沿探索聚焦于如何利用其多模态与多语言特性,构建能够无缝切换不同任务指令的智能系统,以应对现实世界中复杂多变的交互场景。相关研究已与大规模语言模型的高效微调、零样本迁移学习等热点紧密结合,显著提升了模型在未知任务上的表现,为通用人工智能的发展提供了坚实的实验基础。

以上内容由遇见数据集搜集并总结生成