ColorSwap|多模态学习数据集|颜色识别数据集

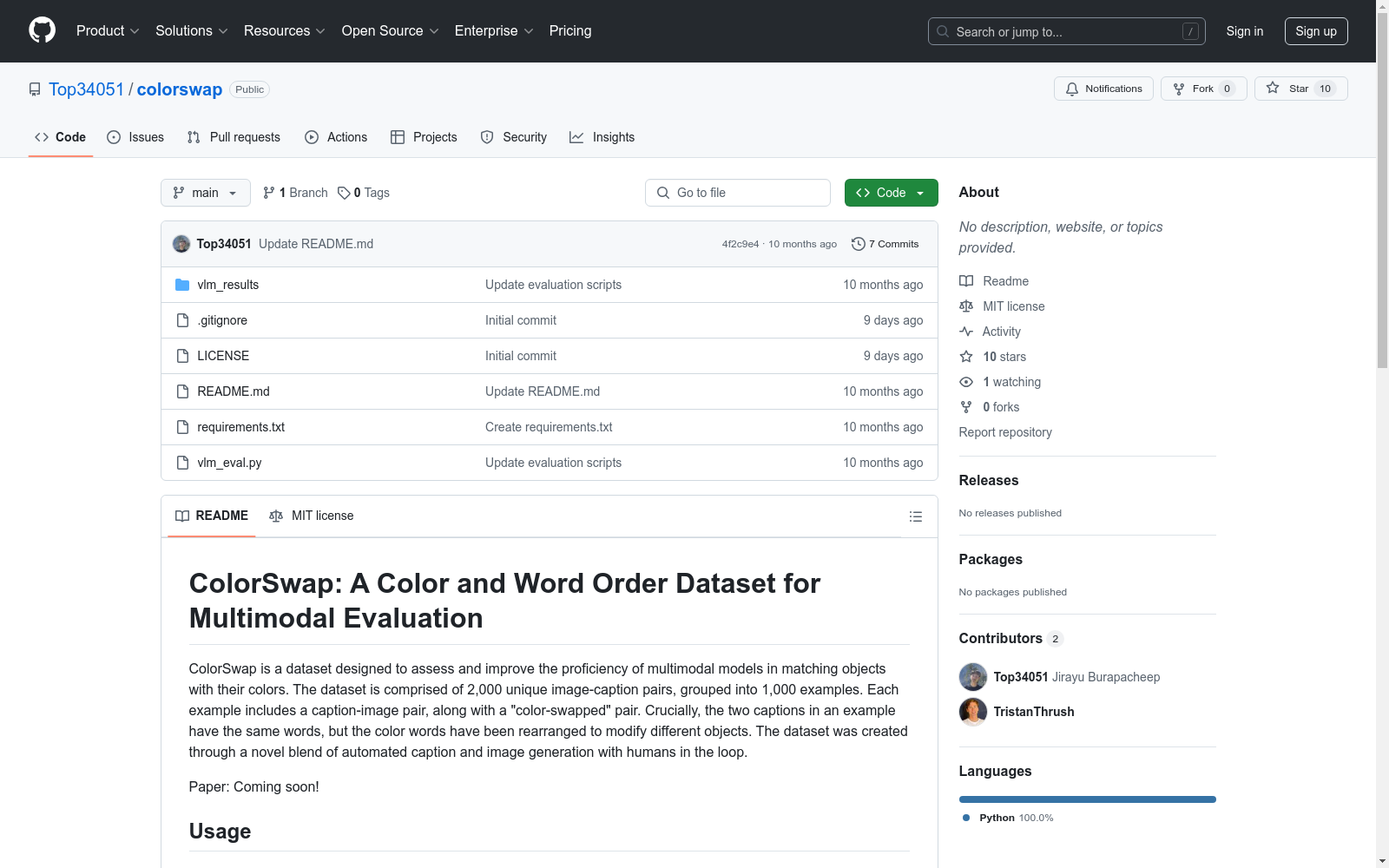

收藏ColorSwap: A Color and Word Order Dataset for Multimodal Evaluation

数据集概述

ColorSwap 是一个用于评估和提升多模态模型在匹配物体与其颜色方面能力的专用数据集。该数据集包含 2,000 个独特的图像-标题对,分为 1,000 个示例。每个示例包括一对标题-图像,以及一对“颜色交换”的标题-图像。关键在于,示例中的两个标题包含相同的词汇,但颜色词汇被重新排列以修改不同的物体。数据集通过自动化标题和图像生成与人工参与相结合的方式创建。

数据结构

数据集包括以下文件:

data/{train, test}.json:包含标题和图像信息。data/images.zip:包含图像文件。

数据集示例如下: python [ { "id": 0, "caption_1": "someone holding a yellow umbrella wearing a white dress", "caption_2": "someone holding a white umbrella wearing a yellow dress", "image_1": "images/img_0_1.png", "image_2": "images/img_0_2.png", "image_source": "midjourney", "caption_source": "human" }, ... ]

使用方法

数据集可以通过以下方式下载和使用:

- 从 Google Drive 下载并解压到

data文件夹。 - 使用 Hugging Face API 直接下载: python from datasets import load_dataset dataset = load_dataset("stanfordnlp/colorswap", use_auth_token=True)

评估

数据集支持以下评估:

- 图像-文本匹配模型:参考 Colab 演示。

- 视觉语言模型:结果包含在

vlm_results文件夹中,可通过运行python vlm_eval.py提取分数。

引用

如果使用该数据集,请引用以下论文:

@article{burapacheep2024colorswap, author = {Jirayu Burapacheep and Ishan Gaur and Agam Bhatia and Tristan Thrush}, title = {ColorSwap: A Color and Word Order Dataset for Multimodal Evaluation}, journal = {arXiv}, year = {2024}, }

YOLO Drone Detection Dataset

为了促进无人机检测模型的开发和评估,我们引入了一个新颖且全面的数据集,专门为训练和测试无人机检测算法而设计。该数据集来源于Kaggle上的公开数据集,包含在各种环境和摄像机视角下捕获的多样化的带注释图像。数据集包括无人机实例以及其他常见对象,以实现强大的检测和分类。

github 收录

Figshare

Figshare是一个在线数据共享平台,允许研究人员上传和共享各种类型的研究成果,包括数据集、论文、图像、视频等。它旨在促进科学研究的开放性和可重复性。

figshare.com 收录

中国行政区划数据

本项目为中国行政区划数据,包括省级、地级、县级、乡级和村级五级行政区划数据。数据来源于国家统计局,存储格式为sqlite3 db文件,支持直接使用数据库连接工具打开。

github 收录

VisDrone2019

VisDrone2019数据集由AISKYEYE团队在天津大学机器学习和数据挖掘实验室收集,包含288个视频片段共261,908帧和10,209张静态图像。数据集覆盖了中国14个不同城市的城市和乡村环境,包括行人、车辆、自行车等多种目标,以及稀疏和拥挤场景。数据集使用不同型号的无人机在各种天气和光照条件下收集,手动标注了超过260万个目标边界框,并提供了场景可见性、对象类别和遮挡等重要属性。

github 收录

Nexdata/chinese_dialect

该数据集包含25,000小时的中文方言语音数据,收集自多个方言区域的本地方言使用者,涵盖闽南语、粤语、四川话、河南话、东北话、上海话、维吾尔语和藏语等。数据格式为16kHz、16bit、未压缩的wav文件,单声道。句子准确率超过95%。数据集支持的任务包括自动语音识别(ASR)和音频说话人识别。

hugging_face 收录