【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

LRS3-TED

收藏arXiv2018-10-28 更新2024-06-21 收录

下载链接:

http://www.robots.ox.ac.uk/~vgg/data/lip_reading

下载链接

链接失效反馈官方服务:

资源简介:

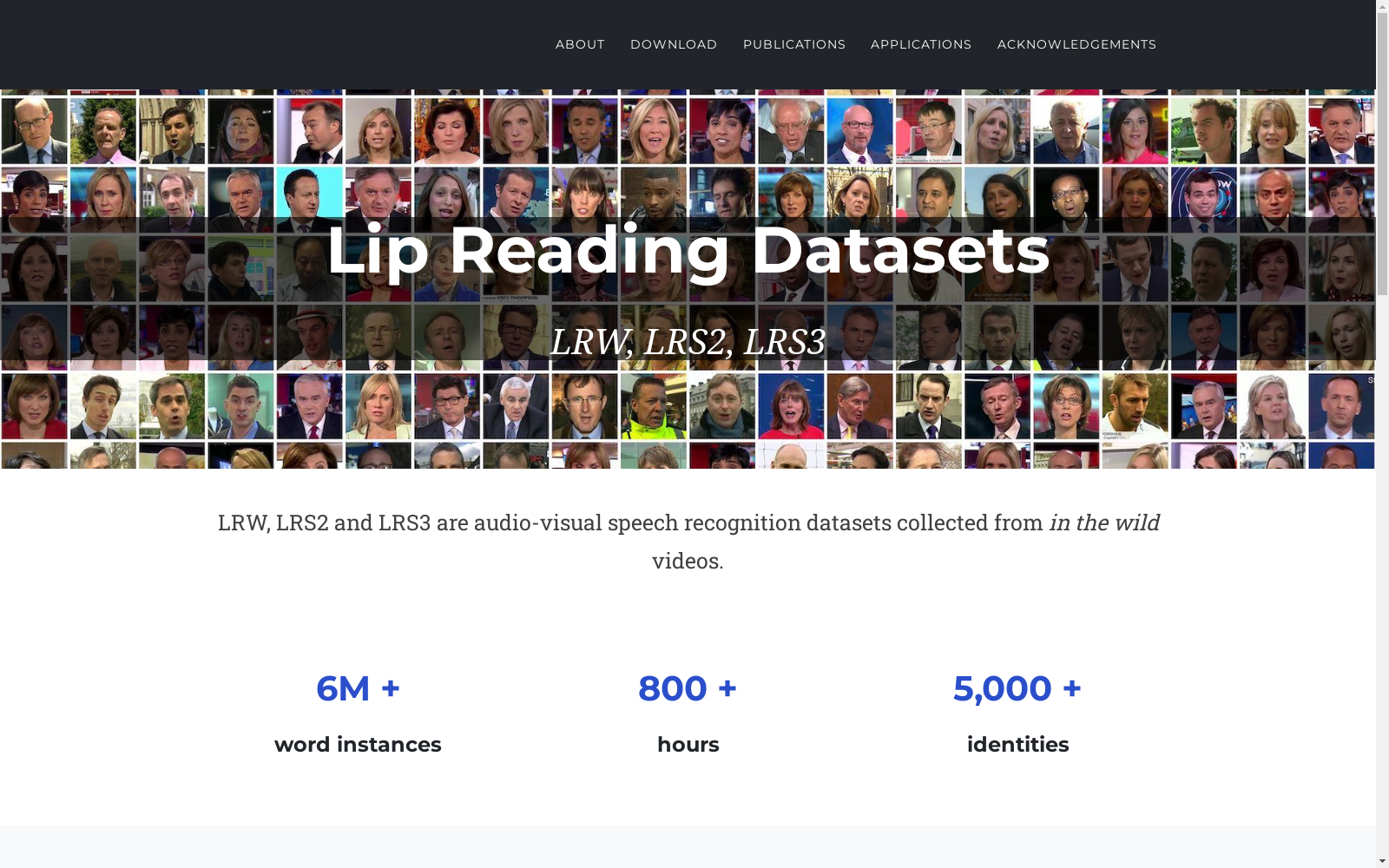

LRS3-TED数据集是由牛津大学视觉几何组创建的大规模多模态数据集,主要用于视觉和音频-视觉语音识别。该数据集包含超过400小时的TED和TEDx视频中的面部轨迹,以及相应的字幕和单词对齐边界。数据集内容丰富,包含5594个视频,每个视频的面部轨迹以224×224分辨率和25 fps帧率提供。数据集的创建过程涉及多阶段自动化管道,用于生成大规模的音频-视觉语音识别数据。LRS3-TED数据集广泛应用于唇读、音频-视觉语音识别等领域,旨在解决缺乏大规模公共基准数据集的问题。

The LRS3-TED dataset is a large-scale multimodal dataset developed by the Visual Geometry Group at the University of Oxford, primarily designed for visual and audio-visual speech recognition tasks. It encompasses facial trajectories extracted from more than 400 hours of TED and TEDx videos, along with paired subtitles and word-aligned boundaries. The dataset consists of 5,594 videos in total, with facial trajectories for each video offered at a resolution of 224×224 and a frame rate of 25 fps, boasting rich and diverse content. The development of this dataset employs a multi-stage automated pipeline to generate large-scale audio-visual speech recognition data. Widely applied in domains such as lip reading, audio-visual speech recognition and other relevant fields, the LRS3-TED dataset is intended to address the shortage of large-scale public benchmark datasets.

提供机构:

牛津大学工程科学系视觉几何组

创建时间:

2018-09-03

搜集汇总

数据集介绍

构建方式

LRS3-TED数据集通过多阶段自动化流程构建,从YouTube上获取了5594个TED和TEDx演讲视频,总时长超过400小时。视频经过处理,提取出224×224分辨率、25帧每秒的面部跟踪视频,并使用h264编码。音频部分被转换为单通道16位16kHz格式,同时提供了与视频同步的英文文本字幕及其单词级别的对齐信息。数据集被划分为pre-train、train-val和test三个子集,其中train-val和test集来自互不重叠的原始视频。

特点

LRS3-TED数据集的主要特点在于其大规模和多样性。它包含了超过400小时的视频数据,远超其他公开的视觉语音识别数据集。数据集中的视频来自多样化的演讲者,减少了镜头切换频率,提供了连续的面部跟踪和完整的句子。此外,数据集提供了精确的音频与视频同步以及单词级别的对齐信息,为音频-视觉语音识别任务提供了丰富的资源。

使用方法

LRS3-TED数据集适用于多种音频-视觉语音识别任务,包括唇读、音频-视觉语音识别和视频驱动的语音增强等。用户可以利用数据集中的面部跟踪视频、音频和文本对齐信息来训练和验证模型。数据集的划分(pre-train、train-val和test)允许用户进行系统的模型评估。通过访问数据集的官方网站,用户可以下载数据并开始使用这些资源进行研究和开发。

背景与挑战

背景概述

视觉语音识别(或唇读)是一项极具挑战性的任务,近年来由于深度神经网络模型的应用和大规模数据集的可用性,自动化唇读技术取得了显著进展。LRS3-TED数据集由牛津大学视觉几何组的研究人员Triantafyllos Afouras、Joon Son Chung和Andrew Zisserman于2018年创建,旨在为视觉和视听语音识别提供一个大规模的基准数据集。该数据集包含从超过400小时的TED和TEDx视频中提取的面部轨迹,以及相应的字幕和单词对齐边界。LRS3-TED数据集的规模显著大于其他公开的同类数据集,为研究者提供了一个统一的评估平台,促进了唇读系统的性能比较和进一步研究。

当前挑战

LRS3-TED数据集在构建过程中面临多项挑战。首先,数据集的构建需要处理从YouTube下载的大量视频,确保视频和音频的同步性,以及准确提取和标注面部轨迹和语音对齐信息。其次,由于视频中的音频和视频流可能存在时间偏差,需要使用先进的同步技术来校正。此外,数据集的多样性和规模要求高效的自动化处理流程,以确保数据的质量和一致性。最后,确保训练集和测试集的独立性,避免同一说话者在不同数据集中的重复出现,以保证模型评估的公正性。这些挑战共同推动了数据集构建技术的进步,并为未来的研究提供了宝贵的资源。

常用场景

经典使用场景

LRS3-TED数据集的经典使用场景主要集中在视觉语音识别(Visual Speech Recognition, VSR)领域,尤其是在唇读任务中。该数据集通过提供超过400小时的TED和TEDx视频,包含面部跟踪、音频轨道以及对应的字幕和单词对齐边界,为研究者提供了一个大规模的多模态数据集。研究者可以利用这些数据训练和评估唇读模型,探索视觉和音频信息如何协同工作以提高语音识别的准确性。

实际应用

LRS3-TED数据集在实际应用中具有广泛的前景,特别是在需要高精度语音识别的场景中。例如,在嘈杂环境下的语音识别系统中,结合视觉信息可以显著提高识别准确率。此外,该数据集还可用于开发辅助听力设备,帮助听力障碍者通过观察说话者的唇部动作来理解语言。在安全监控领域,唇读技术可以用于识别可疑的对话内容,增强公共安全。

衍生相关工作

LRS3-TED数据集的发布激发了许多相关研究工作。例如,基于该数据集的深度学习模型在唇读任务中取得了显著进展,如Chung等人提出的多流网络模型,能够有效同步音频和视频流,并识别与音频匹配的唇部动作。此外,该数据集还促进了音频-视觉语音识别领域的研究,推动了视频驱动语音增强技术的发展。这些衍生工作不仅提升了唇读技术的性能,还为多模态学习提供了新的研究方向。

以上内容由遇见数据集搜集并总结生成