lmsys/mt_bench_human_judgments

收藏Hugging Face2023-07-20 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/lmsys/mt_bench_human_judgments

下载链接

链接失效反馈资源简介:

---

dataset_info:

features:

- name: question_id

dtype: int64

- name: model_a

dtype: string

- name: model_b

dtype: string

- name: winner

dtype: string

- name: judge

dtype: string

- name: conversation_a

list:

- name: content

dtype: string

- name: role

dtype: string

- name: conversation_b

list:

- name: content

dtype: string

- name: role

dtype: string

- name: turn

dtype: int64

splits:

- name: human

num_bytes: 15003469

num_examples: 3355

- name: gpt4_pair

num_bytes: 10679650

num_examples: 2400

download_size: 1388888

dataset_size: 25683119

license: cc-by-4.0

task_categories:

- conversational

- question-answering

language:

- en

size_categories:

- 1K<n<10K

---

## Content

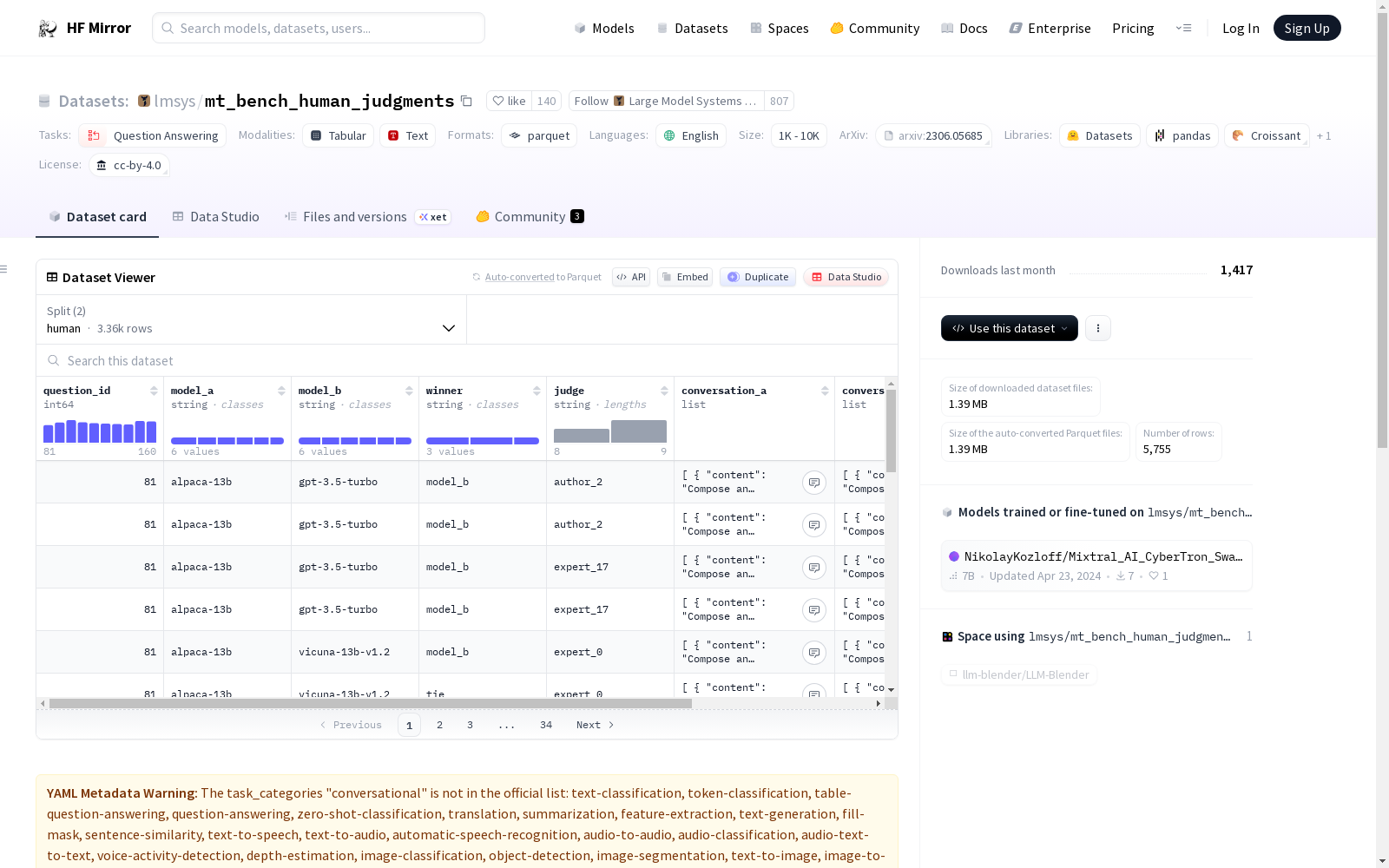

This dataset contains 3.3K expert-level pairwise human preferences for model responses generated by 6 models in response to 80 MT-bench questions.

The 6 models are GPT-4, GPT-3.5, Claud-v1, Vicuna-13B, Alpaca-13B, and LLaMA-13B. The annotators are mostly graduate students with expertise in the topic areas of each of the questions. The details of data collection can be found in our [paper](https://arxiv.org/abs/2306.05685).

## Agreement Calculation

This Colab [notebook](https://colab.research.google.com/drive/1ctgygDRJhVGUJTQy8-bRZCl1WNcT8De6?usp=sharing) shows how to compute the agreement between humans and GPT-4 judge with the dataset. Our results show that humans and GPT-4 judge achieve over 80\% agreement, the same level of agreement between humans.

## Citation

```

@misc{zheng2023judging,

title={Judging LLM-as-a-judge with MT-Bench and Chatbot Arena},

author={Lianmin Zheng and Wei-Lin Chiang and Ying Sheng and Siyuan Zhuang and Zhanghao Wu and Yonghao Zhuang and Zi Lin and Zhuohan Li and Dacheng Li and Eric. P Xing and Hao Zhang and Joseph E. Gonzalez and Ion Stoica},

year={2023},

eprint={2306.05685},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

```

提供机构:

lmsys

原始信息汇总

数据集概述

数据集信息

-

特征(Features):

question_id: 数据类型为int64model_a: 数据类型为stringmodel_b: 数据类型为stringwinner: 数据类型为stringjudge: 数据类型为stringconversation_a: 包含两个子特征content: 数据类型为stringrole: 数据类型为string

conversation_b: 包含两个子特征content: 数据类型为stringrole: 数据类型为string

turn: 数据类型为int64

-

数据分割(Splits):

human: 大小为 15003469 字节,包含 3355 个样本gpt4_pair: 大小为 10679650 字节,包含 2400 个样本

-

下载大小(Download Size): 1388888 字节

-

数据集大小(Dataset Size): 25683119 字节

-

许可证(License): cc-by-4.0

-

任务类别(Task Categories):

- 对话(conversational)

- 问答(question-answering)

-

语言(Language): 英语(en)

-

大小类别(Size Categories): 1K<n<10K

数据集内容

- 包含 3.3K 专家级的人类偏好数据,用于评估 6 个模型对 80 个 MT-bench 问题的响应。

- 涉及的模型包括 GPT-4, GPT-3.5, Claud-v1, Vicuna-13B, Alpaca-13B, 和 LLaMA-13B。

- 注释者主要是具有相关问题领域专业知识的研究生。

数据集用途

- 用于计算人类与 GPT-4 判断者之间的协议,显示两者之间的协议度超过 80%。

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,评估大型语言模型生成内容的质量常依赖于人类专家的主观判断。本数据集通过精心设计的流程构建,首先选取了涵盖多领域的80个MT-bench问题,并邀请六种前沿模型生成回答,包括GPT-4、GPT-3.5等。随后,招募具备相关学科背景的研究生作为标注者,对模型生成的成对回答进行偏好标注,最终收集了超过3300条专家级的人类偏好数据,确保了评估的专业性和可靠性。

特点

该数据集的核心特点在于其高质量的人类标注与广泛的模型覆盖。数据集中包含了六种不同架构与规模的模型生成内容,涵盖了从通用对话到专业问答的多样场景。每个数据点均记录了标注者的选择及其依据,提供了丰富的元信息,如对话轮次与角色分配。此外,数据集还附带了基于GPT-4的自动评估结果,便于研究者对比人类与机器判断的一致性,为模型评估研究提供了多维度的参考基准。

使用方法

研究者可利用本数据集进行大型语言模型的性能评估与比较分析。典型应用包括计算不同模型在人类偏好上的胜率,或分析标注者与自动评估工具之间的一致性。数据集中的对话记录可直接用于训练或微调评估模型,提升其与人类判断的吻合度。同时,附带的代码示例展示了如何计算人类与GPT-4评估者之间的协议水平,为复现研究结果提供了便利,推动对话系统评估方法的标准化进程。

背景与挑战

背景概述

随着大规模语言模型的迅猛发展,如何客观评估其对话能力成为自然语言处理领域的关键议题。2023年,由LMSYS组织的研究团队发布了mt_bench_human_judgments数据集,旨在通过专家级的人类偏好标注,系统比较包括GPT-4、Claude-v1、Vicuna等在内的六种前沿模型的响应质量。该数据集围绕80个多轮对话问题构建,收录了超过3300条精细的成对偏好判断,为对话系统的评估提供了宝贵的基准数据,推动了基于人类反馈的模型优化研究。

当前挑战

该数据集致力于解决对话系统评估中主观性强、标准模糊的核心挑战,其构建需确保人类标注者具备足够的领域专业知识以做出可靠判断。在数据收集过程中,协调多位标注者达成一致偏好面临显著困难,涉及标注指南设计、个体偏差控制以及计算标注者间一致性等复杂环节。此外,将人类偏好与自动化评估方法(如GPT-4作为评判者)进行对齐,同样对评估框架的稳健性与泛化能力提出了严格要求。

常用场景

经典使用场景

在大型语言模型评估领域,lmsys/mt_bench_human_judgments数据集为研究者提供了一个基准平台,用于系统性地比较不同模型在开放域对话任务中的表现。该数据集通过收集专家级的人工偏好判断,涵盖了GPT-4、GPT-3.5、Claude-v1等六种前沿模型对80个多轮问题的响应,从而支持对模型回答质量进行精细化的横向对比分析。

实际应用

在实际应用中,该数据集被广泛用于指导模型选型和部署决策。企业及研究机构可依据其标注结果,筛选在特定对话场景下表现更优的模型,从而提升智能客服、教育辅助或内容生成等系统的用户体验。同时,它也为自动化评估工具的开发提供了训练数据,助力构建更高效、低成本的模型评估流程。

衍生相关工作

基于该数据集衍生的经典工作包括自动化评估框架的构建,如利用GPT-4作为评判员模拟人类偏好的研究,验证了AI评判与人类标注的高一致性。此外,该数据支撑了多篇关于模型对齐、偏好学习及评估方法优化的学术论文,为后续如Chatbot Arena等大规模评估平台的演进奠定了数据基础。

以上内容由遇见数据集搜集并总结生成