BBH

收藏BIG-Bench Hard (BBH) 数据集概述

数据集简介

- BIG-Bench Hard (BBH) 是一个包含23个挑战性任务的评估套件,这些任务来自BIG-Bench基准测试。

- 这些任务是当前语言模型在未使用思维链(CoT)提示时表现不及人类平均水平的任务。

数据集特点

- 任务类型:多步推理任务。

- 评估重点:语言模型在复杂任务上的表现。

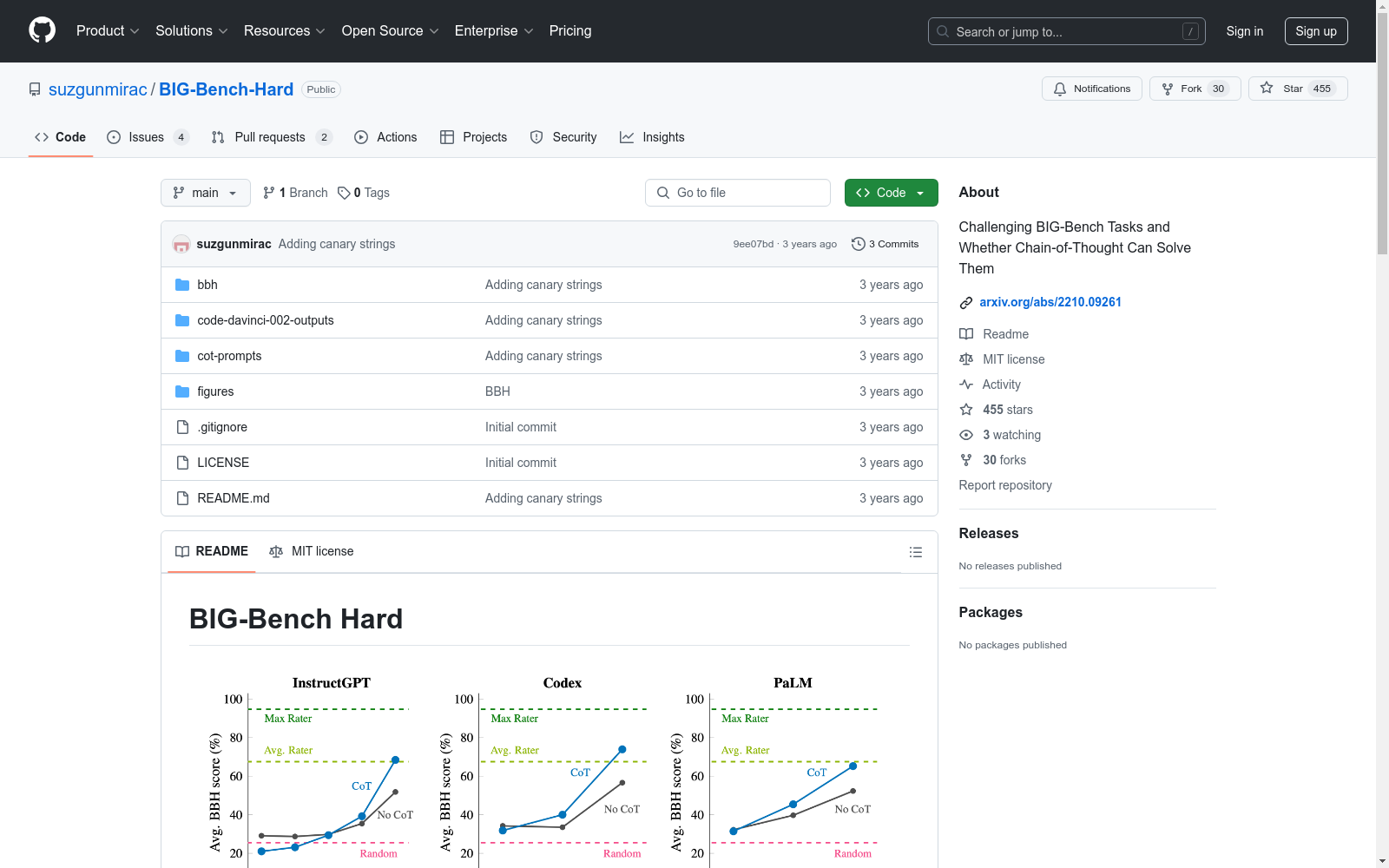

- 关键发现:

- 使用思维链(CoT)提示后,PaLM模型在23个任务中的10个上超越人类平均水平。

- Codex (code-davinci-002) 模型在23个任务中的17个上超越人类平均水平。

数据集内容

- 任务文件:位于

/bbh目录下。 - 思维链提示:位于

/cot-prompts目录下。 - Codex模型输出:位于

/code-davinci-002-outputs目录下。

相关论文

- BIG Bench:Beyond the Imitation Game: Quantifying and Extrapolating the Capabilities of Language Models (Srivastava et al., 2022)

- BIG-Bench Hard:Challenging BIG-Bench Tasks and Whether Chain-of-Thought Can Solve Them (Suzgun et al., 2022)

引用格式

bibtex @article{srivastava2022beyond, title={Beyond the Imitation Game: Quantifying and extrapolating the capabilities of language models}, author={Srivastava, Aarohi and Rastogi, Abhinav and Rao, Abhishek and Shoeb, Abu Awal Md and Abid, Abubakar and Fisch, Adam and Brown, Adam R and Santoro, Adam and Gupta, Aditya and Garriga-Alonso, Adri{`a} and others}, journal={arXiv preprint arXiv:2206.04615}, year={2022} }

@article{suzgun2022challenging, title={Challenging BIG-Bench Tasks and Whether Chain-of-Thought Can Solve Them}, author={Suzgun, Mirac and Scales, Nathan and Sch{"a}rli, Nathanael and Gehrmann, Sebastian and Tay, Yi and Chung, Hyung Won and Chowdhery, Aakanksha and Le, Quoc V and Chi, Ed H and Zhou, Denny and and Wei, Jason}, journal={arXiv preprint arXiv:2210.09261}, year={2022} }