MusicTM-Dataset

收藏arXiv2021-05-07 更新2024-06-21 收录

下载链接:

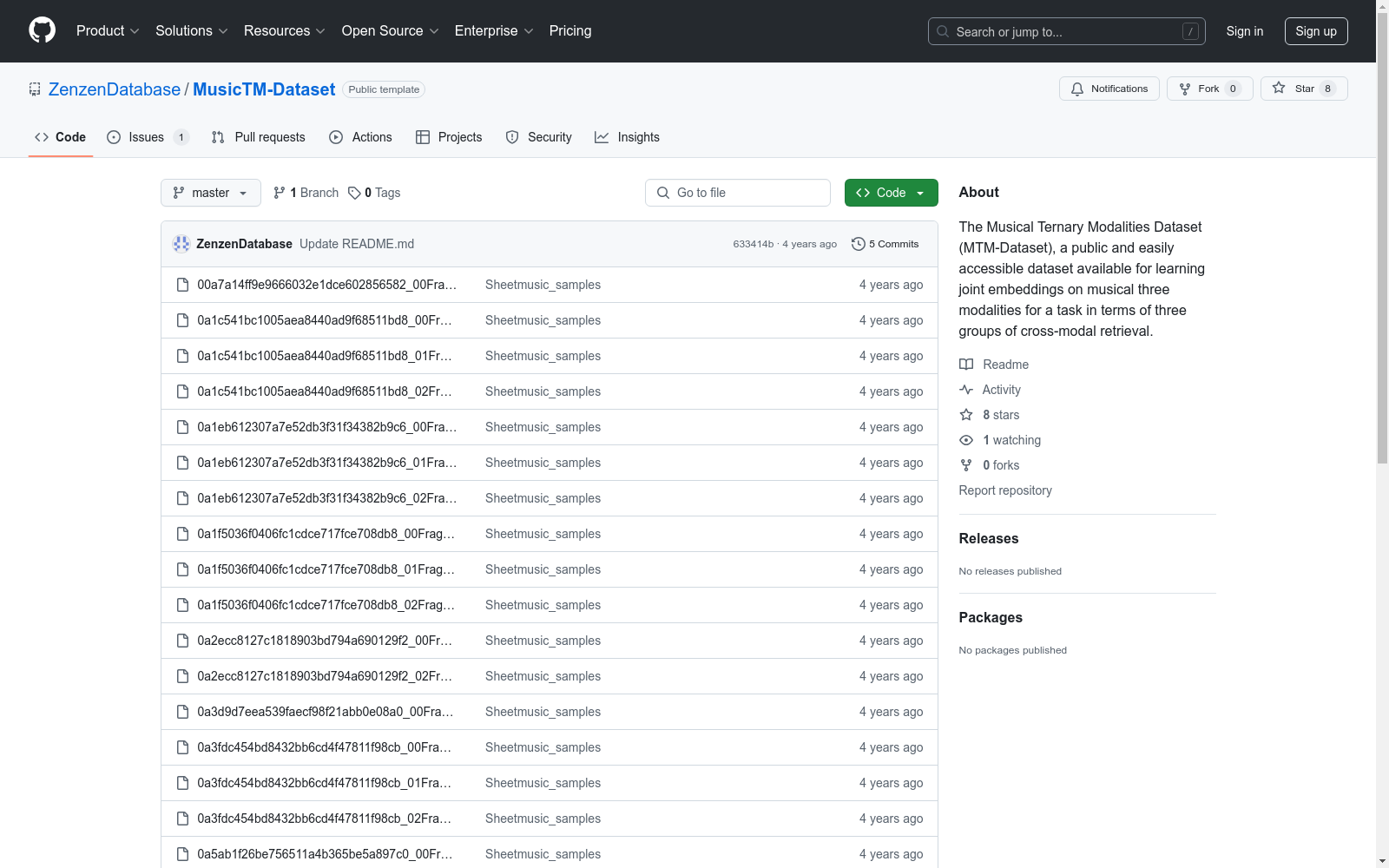

https://github.com/dddzeng/MusicTM-Dataset

下载链接

链接失效反馈官方服务:

资源简介:

MusicTM-Dataset是由日本国立情报学研究所和东京大学创建的多模态音乐数据集,包含乐谱图像、歌词文本和合成音频三种模态。数据集通过音乐生成工具从音乐笔记扩展而来,实现了音节级歌词与音乐笔记的精细对齐。该数据集旨在通过高级模型提取的表示,支持跨模态检索任务,特别是在音乐信息检索领域,解决从音频检索乐谱和歌词的问题。

MusicTM-Dataset is a multimodal music dataset developed by the National Institute of Informatics (Japan) and the University of Tokyo. It includes three modalities: sheet music images, lyric texts, and synthesized audio. This dataset is expanded from musical scores via music generation tools, achieving fine-grained alignment between syllable-level lyrics and musical notes. It aims to support cross-modal retrieval tasks using representations extracted by advanced models, particularly in the field of Music Information Retrieval (MIR), addressing the problem of retrieving sheet music and lyrics from audio.

提供机构:

日本国立情报学研究所,东京大学

创建时间:

2020-12-01

搜集汇总

数据集介绍

构建方式

MusicTM-Dataset的构建过程融合了音乐符号、歌词和合成音频的多模态数据。首先,通过扩展原始的音乐符号,利用音乐生成工具合成音频并生成乐谱图像。随后,构建了基于音乐符号的乐谱图像、音频片段和音节标注文本的细粒度对齐,确保了数据集在多模态数据点之间的共享表示。这一过程不仅丰富了数据集的多样性,还为跨模态检索任务提供了坚实的基础。

特点

MusicTM-Dataset的显著特点在于其包含了三种模态的数据:乐谱图像、歌词文本和合成音频。这些模态通过细粒度的对齐方式紧密结合,使得数据集在跨模态检索任务中表现出色。此外,数据集的构建过程中采用了先进的模型来提取各模态的表示,确保了数据的高质量和一致性。

使用方法

MusicTM-Dataset适用于多种跨模态检索任务,如音频与乐谱、音频与歌词之间的检索。用户可以通过访问数据集的GitHub仓库获取数据,并利用提供的特征提取模型进行预处理。数据集的细粒度对齐特性使得其在无监督表示学习方法中尤为有效,能够帮助用户在没有用户信息的情况下,通过一种数据模态检索到其他两种模态的数据。

背景与挑战

背景概述

MusicTM-Dataset,由日本国立情报学研究所(National Institute of Informatics)的Donghuo Zeng、Yi Yu和Keizo Oyama于2021年创建,旨在提升跨模态检索(CMR)中的联合表示学习能力。该数据集包含三种模态:乐谱图像、歌词文本和合成音频,通过精细对齐实现多模态数据点的高级特征提取。MusicTM-Dataset的开发填补了音乐信息检索领域中多模态数据集的空白,为研究者提供了新的工具,以探索音频、乐谱和歌词之间的复杂关系,推动了音乐信息检索技术的发展。

当前挑战

MusicTM-Dataset在构建过程中面临多重挑战。首先,跨模态检索任务中的模态差距问题,即如何有效地在不同模态间建立关联,是一个核心难题。其次,数据集的构建涉及复杂的音乐生成和合成技术,确保乐谱、音频和歌词之间的精细对齐。此外,特征提取过程中需要处理音频信号的时序信息和乐谱图像的视觉特征,这对模型的设计和训练提出了高要求。最后,评估跨模态检索性能时,如何准确衡量不同模态间的关联性,也是一个重要的研究课题。

常用场景

经典使用场景

MusicTM-Dataset在音乐信息检索(MIR)领域中被广泛用于跨模态表示学习,特别是音频、乐谱和歌词之间的联合表示学习。该数据集通过精细的对齐技术,使得音频片段、乐谱图像和歌词文本能够在共享的潜在子空间中进行表示学习,从而实现高效的跨模态检索。例如,当用户提供一段音频时,系统能够准确地检索出对应的乐谱和歌词,反之亦然。

衍生相关工作

基于MusicTM-Dataset,研究者们开发了多种跨模态表示学习方法,如深度神经网络(DNN)和广义典型相关分析(GCCA)。这些方法不仅提升了音频与乐谱、音频与歌词之间的检索性能,还推动了音乐信息检索领域的技术进步。此外,该数据集还激发了相关领域的研究,如音乐生成、歌词创作和音乐情感分析,为音乐科技的发展提供了新的思路和方向。

数据集最近研究

最新研究方向

在音乐信息检索(MIR)领域,MusicTM-Dataset的最新研究方向主要集中在多模态联合表示学习上。该数据集整合了乐谱图像、歌词文本和合成音频三种模态,旨在通过跨模态检索(CMR)任务提升多模态数据的表示学习能力。前沿研究聚焦于如何有效地弥合不同模态间的差距,通过深度神经网络(DNN)和注意力机制等先进技术,探索音频与乐谱、音频与歌词之间的复杂关系。这些研究不仅提升了音乐信息检索的准确性,还为自动音乐生成和歌词与旋律的同步提供了新的可能性,进一步推动了音乐信息处理技术的发展。

相关研究论文

- 1MusicTM-Dataset for Joint Representation Learning among Sheet Music, Lyrics, and Musical Audio日本国立情报学研究所,东京大学 · 2021年

以上内容由遇见数据集搜集并总结生成