LongForm

收藏LongForm 数据集概述

数据集简介

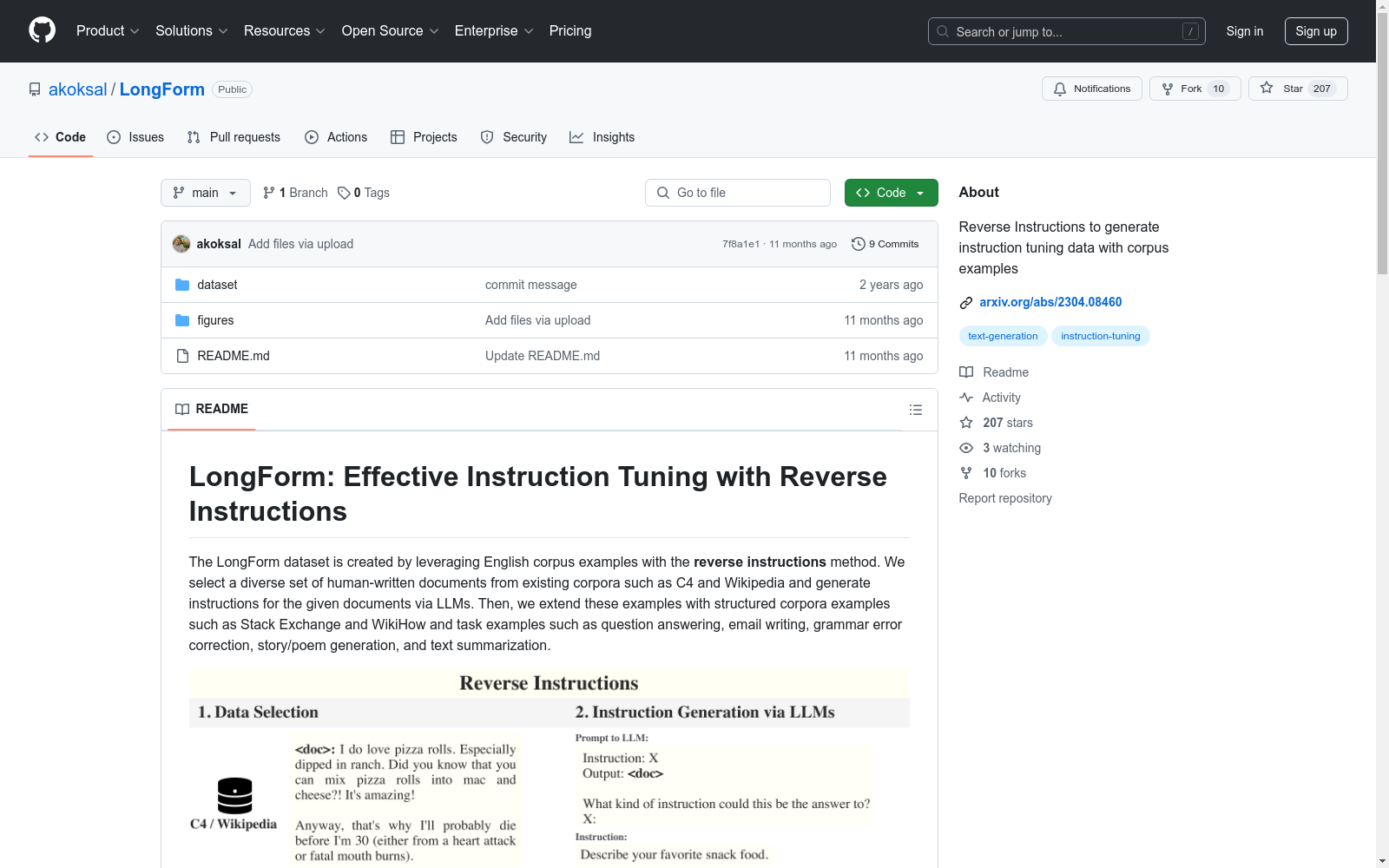

LongForm 数据集是通过反向指令方法利用英文语料库创建的。该数据集从现有的语料库(如 C4 和 Wikipedia)中选择多样化的、人类撰写的文档,并通过大型语言模型(LLMs)为这些文档生成指令。此外,数据集还扩展了结构化语料库(如 Stack Exchange 和 WikiHow)以及任务示例(如问答、邮件写作、语法纠错、故事/诗歌生成和文本摘要)。

数据集与模型

- LongForm-C 数据集:发布在 Github 和 HuggingFace 上。

- LongForm 模型:发布在 HuggingFace 的模型中心。由于 LLaMA 模型的限制,LongForm-LLaMA-7B 无法公开发布。

- LongForm-LLaMA-7B-diff: https://huggingface.co/akoksal/LongForm-LLaMA-7B-diff

- LongForm-T5-XL: https://huggingface.co/akoksal/LongForm-T5-XL

- LongForm-OPT-125M: https://huggingface.co/akoksal/LongForm-OPT-125M

- LongForm-OPT-350M: https://huggingface.co/akoksal/LongForm-OPT-350M

- LongForm-OPT-1.3B: https://huggingface.co/akoksal/LongForm-OPT-1.3B

- LongForm-OPT-2.7B: https://huggingface.co/akoksal/LongForm-OPT-2.7B

- LongForm-OPT-6.7B: https://huggingface.co/akoksal/LongForm-OPT-6.7B

评估

LongForm 模型在多个任务中表现优异,特别是在食谱生成(Recipe Generation)、长文本问答(ELI5)和短篇故事生成(WritingPrompts/WP)任务中,超越了之前的指令调优模型。

模型性能对比

| 模型 | 所有任务 | 食谱生成 | ELI5 | 写作提示 |

|---|---|---|---|---|

| T0++ | 10.9 | 18.7 | 3.8 | 10.2 |

| Tk-Instruct | 6.3 | 12.9* | 3.6 | 2.4 |

| Flan-T5 | 10.6 | 20.9* | 3.5 | 7.4 |

| Alpaca-LLaMA-7B | 14.6 | 19.5 | 12.5 | 11.8 |

| OPT-30B | 11.1 | 18.6 | 12.2 | 2.6 |

| LongForm-T5-XL | 16.3 | 20.2 | 18.3 | 10.6 |

| LongForm-OPT-6.7B | 17.7 | 16.9 | 17.2 | 19.0 |

| LongForm-LLaMA-7B | 19.7 | 21.7 | 18.6 | 18.9 |

语言理解与生成

LongForm-C 数据集在自然语言生成(NLG)和自然语言理解(NLU)任务中表现出色,特别是在与 FLAN 数据集结合使用时,NLU 任务的表现显著提升。

| 模型 | 数据集 | NLG | NLU (5-shot MMLU) |

|---|---|---|---|

| LLaMA-7B | FLAN | 9.1 | 36.6 |

| LLaMA-7B | LongForm-C | 19.7 | 35.2 |

| LLaMA-7B | FLAN+LongForm-C | 16.5 | 38.9 |

局限性

LongForm 数据集和模型主要关注长文本生成,在结构化预测任务中存在局限性。此外,LongForm 模型可能会出现与大型语言模型类似的幻觉问题。

许可证

LongForm 项目采用 MIT 许可证,但受到 OpenAI 指令生成部分的限制以及语言模型(OPT、LLaMA 和 T5)许可证的限制。LongForm-C 的 WikiHow 子集受 WikiHow 的许可证约束。

引用

bibtex @misc{koksal2023longform, title={LongForm: Effective Instruction Tuning with Reverse Instructions}, author={Abdullatif Köksal and Timo Schick and Anna Korhonen and Hinrich Schütze}, year={2023}, eprint={2304.08460}, archivePrefix={arXiv}, primaryClass={cs.CL} }