MUSAN

收藏arXiv2015-10-29 更新2024-07-25 收录

下载链接:

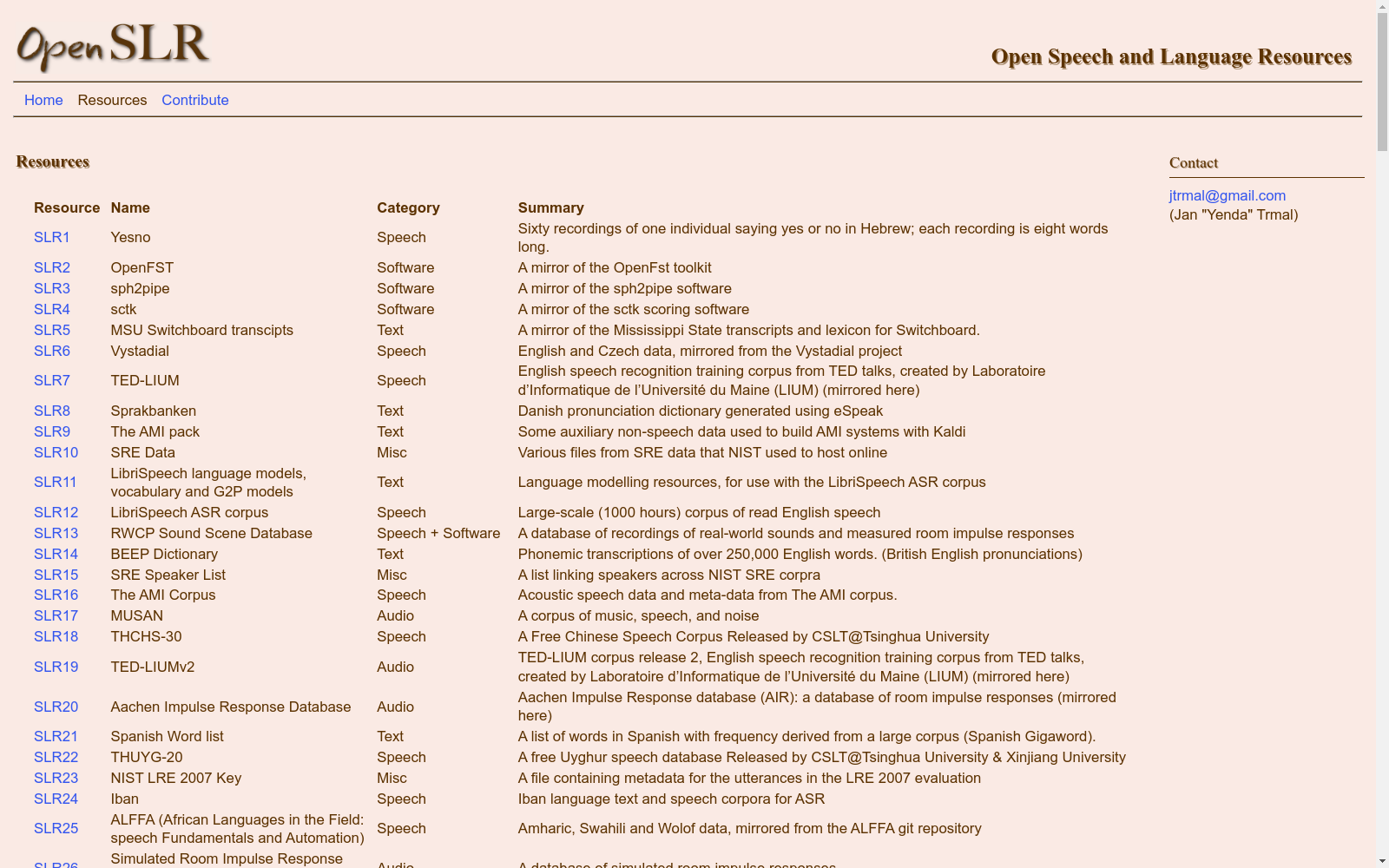

https://www.openslr.org/resources.php

下载链接

链接失效反馈官方服务:

资源简介:

MUSAN数据集由约翰霍普金斯大学的语言与语音处理中心创建,包含约109小时的音频,涵盖音乐、语音和噪音三大类。数据集中的音频来自美国公共领域和创意共享许可,允许商业使用。音乐部分包含多种风格,语音部分涵盖12种语言,噪音部分则包含多种技术与非技术噪音。该数据集主要用于训练语音活动检测(VAD)和音乐/语音区分模型,解决音频分类中的实际问题。

The MUSAN dataset was created by the Center for Language and Speech Processing at Johns Hopkins University. It contains approximately 109 hours of audio covering three main categories: music, speech, and noise. The audio in the dataset is sourced from US public domain and Creative Commons licensed materials, permitting commercial use. The music section includes various genres, the speech section covers 12 languages, and the noise section contains a variety of technical and non-technical noises. This dataset is primarily used for training voice activity detection (VAD) and music/speech discrimination models to address practical issues in audio classification.

提供机构:

语言与语音处理中心

创建时间:

2015-10-29

搜集汇总

数据集介绍

构建方式

MUSAN数据集的构建基于广泛的音乐、语音和噪声资源,这些资源主要来源于美国公共领域和Creative Commons许可的内容。数据集包含了约109小时的音频,分为三个主要类别:语音、音乐和噪声。语音部分包括来自Librivox的60小时朗读语音,涵盖12种语言;音乐部分则从Jamendo、Free Music Archive等平台下载,涵盖多种风格和流派;噪声部分包含929个文件,涵盖技术噪声和环境声音。所有音频文件均为16kHz的WAV格式,并附有详细的许可证和元数据信息。

特点

MUSAN数据集的显著特点在于其多样性和合法性。数据集不仅涵盖了多种语言和音乐风格,还包含了丰富的噪声类型,适用于多种音频处理任务。此外,所有数据均来自合法的公共领域或Creative Commons许可,确保了数据的可重用性和商业应用的自由。数据集中的每个子目录都附有LICENSE文件,详细说明了每个音频文件的许可类型和来源信息,增强了数据集的透明度和可信度。

使用方法

MUSAN数据集适用于多种音频处理任务,如语音活动检测(VAD)和音乐/语音分类。用户可以通过Kaldi ASR工具包进行实验,利用数据集训练高斯混合模型(GMM)进行音乐/语音分类和VAD。数据集的详细元数据和分类信息有助于用户进行精细化的模型训练和评估。此外,数据集的开放性和合法性使得其在学术研究和商业应用中均具有广泛的使用价值。

背景与挑战

背景概述

MUSAN数据集,由Johns Hopkins大学的Center for Language and Speech Processing中心的研究人员David Snyder、Guoguo Chen和Daniel Povey创建,于2015年发布。该数据集旨在为语音活动检测(VAD)和音乐/语音分类提供高质量的音频资源。MUSAN数据集包含了来自多个流派的音乐、十二种语言的语音以及多种技术与非技术噪音,总计约109小时的音频数据。这些数据主要来源于Creative Commons和US Public Domain,确保了数据的自由再分发。MUSAN数据集的发布填补了公开可用音频数据集在版权和再分发权限方面的空白,对语音识别、说话人验证等领域的研究具有重要推动作用。

当前挑战

MUSAN数据集在构建过程中面临了多个挑战。首先,数据集的多样性要求确保音乐、语音和噪音的广泛覆盖,这需要从多个来源收集和整理数据,确保每种音频类型的代表性。其次,版权问题是构建此类数据集时的重要考虑因素,MUSAN通过选择Creative Commons和Public Domain资源,有效规避了这一问题。此外,数据集的标注工作也具有挑战性,需要对音乐的流派、语音的语言和说话人进行准确标注,以支持后续的模型训练和评估。最后,数据集的应用场景多样,包括语音活动检测和音乐/语音分类,这要求数据集在不同任务中都能提供有效的支持,确保其在实际应用中的广泛适用性。

常用场景

经典使用场景

MUSAN数据集在语音活动检测(VAD)和音乐/语音分类任务中展现了其经典应用。通过提供多样化的音频数据,包括音乐、语音和噪声,该数据集支持了基于高斯混合模型(GMM)的VAD系统训练,以及音乐与语音的区分模型。这些模型在广播新闻和说话人识别等实际应用中表现出色,特别是在处理混合音频信号时,能够有效区分语音和非语音部分。

解决学术问题

MUSAN数据集解决了音频分类领域中的多个关键学术问题。首先,它填补了公开可用音频数据集中版权问题的空白,确保了数据的合法性和可再分发性。其次,通过提供丰富的音乐、语音和噪声样本,该数据集促进了VAD和音乐/语音分类模型的研究,特别是在处理多语言和多类型音频数据时,显著提升了模型的泛化能力和准确性。

衍生相关工作

基于MUSAN数据集,研究者们开发了多种改进的音频处理模型和算法。例如,一些研究工作利用该数据集训练了更复杂的深度学习模型,如时间延迟深度神经网络(TDNN),以提升说话人识别的性能。此外,MUSAN数据集还启发了对多语言语音数据处理的研究,推动了跨语言语音识别技术的发展。

以上内容由遇见数据集搜集并总结生成