Alpaca comparison data

收藏github2023-03-01 更新2025-01-17 收录

下载链接:

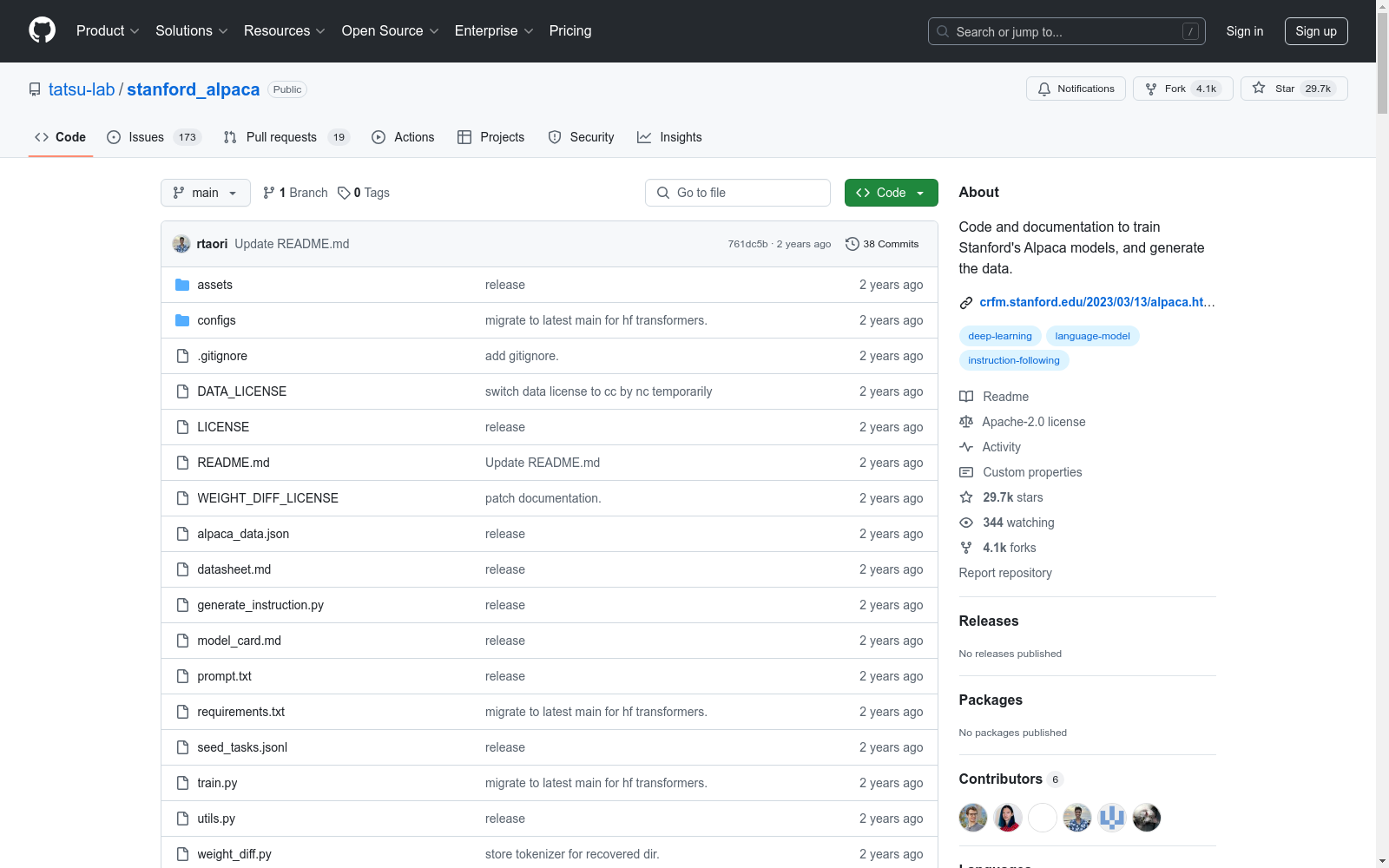

https://github.com/tatsu-lab/stanford_alpaca

下载链接

链接失效反馈资源简介:

The Alpaca comparison data dataset consists of 51K examples comparing three models. The results of the comparisons serve as a form of preference feedback. The preference evaluation method involves using GPT-4 to score the quality of responses, thus creating preference samples. Each example includes a prompt input, a high-quality answer, and a low-quality answer.

阿尔帕卡比较数据集(Alpaca Comparison Data Dataset)包含5.1万个对比三款模型的样本,其对比结果可作为一类偏好反馈。该偏好评估方法采用GPT-4对回复质量进行评分,以此生成偏好样本。每个样本均包含提示输入(Prompt Input)、高质量回答与低质量回答。

提供机构:

斯坦福大学

创建时间:

2023-03-01

搜集汇总

数据集介绍

构建方式

Stanford Alpaca数据集的构建基于LLaMA模型,通过52K指令跟随数据进行微调。数据生成过程采用了Self-Instruct框架,并结合了text-davinci-003模型进行指令生成。生成过程中,团队对原始框架进行了多项优化,包括使用更高效的批量解码技术、简化数据生成流程以及减少每个指令的生成实例数量,从而显著降低了数据生成的成本。最终生成的指令数据集具有较高的多样性和实用性,适用于指令跟随模型的训练。

使用方法

Stanford Alpaca数据集主要用于微调LLaMA模型,以构建指令跟随模型。用户可以通过Hugging Face的训练代码进行模型微调,支持LLaMA-7B和LLaMA-13B等不同规模的模型。微调过程中,用户需设置适当的学习率、批量大小和训练轮数等超参数。数据集的使用方法还包括通过权重差分恢复Alpaca模型的权重,用户需按照提供的步骤将Meta发布的权重转换为Hugging Face格式,并结合权重差分文件恢复完整的模型权重。数据集的使用仅限于非商业研究目的,遵循CC BY NC 4.0许可协议。

背景与挑战

背景概述

Stanford Alpaca数据集由斯坦福大学的研究团队于2023年发布,旨在构建一个能够遵循指令的LLaMA模型。该数据集基于52K条指令跟随数据,这些数据通过Self-Instruct技术生成,并结合了LLaMA模型进行微调。Alpaca项目的核心研究问题是如何通过指令微调提升语言模型的任务执行能力,尤其是在复杂指令理解和生成方面。该数据集在自然语言处理领域具有重要影响力,特别是在指令跟随模型的开发中,为研究者提供了一个高质量的训练和评估基准。

当前挑战

Stanford Alpaca数据集在构建和应用过程中面临多重挑战。首先,指令跟随任务的多样性和复杂性要求模型能够处理广泛的指令类型,这对数据生成和模型微调提出了高要求。其次,数据生成过程中需要确保指令的多样性和质量,以避免模型过拟合或生成偏差。此外,模型的安全性尚未完全解决,Alpaca模型尚未经过充分的安全性和无害性微调,这在实际应用中可能带来潜在风险。最后,数据生成和模型训练的高成本也是一个显著挑战,尽管团队通过批量解码等技术降低了成本,但仍需进一步优化以支持更大规模的研究。

常用场景

经典使用场景

在自然语言处理领域,Alpaca comparison data 数据集主要用于训练和评估指令跟随模型。通过对52K条指令数据进行微调,研究人员能够构建出能够理解和执行复杂指令的模型。这一数据集的使用场景涵盖了从文本生成到问答系统的广泛任务,尤其是在需要模型根据特定指令生成响应的场景中表现出色。

解决学术问题

Alpaca comparison data 数据集解决了指令跟随模型在多样性和泛化能力上的挑战。通过生成大量多样化的指令数据,该数据集帮助研究人员克服了传统数据集中指令单一、泛化能力不足的问题。此外,该数据集还为研究模型在复杂指令下的表现提供了基础,推动了指令跟随模型在学术研究中的进一步发展。

实际应用

在实际应用中,Alpaca comparison data 数据集被广泛用于开发智能助手、自动化客服系统以及教育领域的智能辅导工具。通过微调基于该数据集的模型,企业能够构建出能够理解用户指令并提供准确响应的智能系统,从而提升用户体验和操作效率。

数据集最近研究

最新研究方向

近年来,随着大规模语言模型的快速发展,指令跟随模型的研究成为自然语言处理领域的热点之一。Stanford Alpaca数据集基于LLaMA模型,通过52K指令跟随数据进行微调,展示了在指令理解和执行任务上的显著能力。该数据集的研究方向主要集中在如何通过自生成指令(Self-Instruct)技术进一步提升模型的多样性和泛化能力。当前研究还关注模型的安全性和伦理问题,尤其是在实际应用中可能产生的潜在风险。通过开源数据和代码,Alpaca为学术界提供了宝贵的资源,推动了指令跟随模型在复杂任务中的应用和优化。

以上内容由遇见数据集搜集并总结生成