FreshQA

收藏github2023-10-01 更新2025-02-07 收录

下载链接:

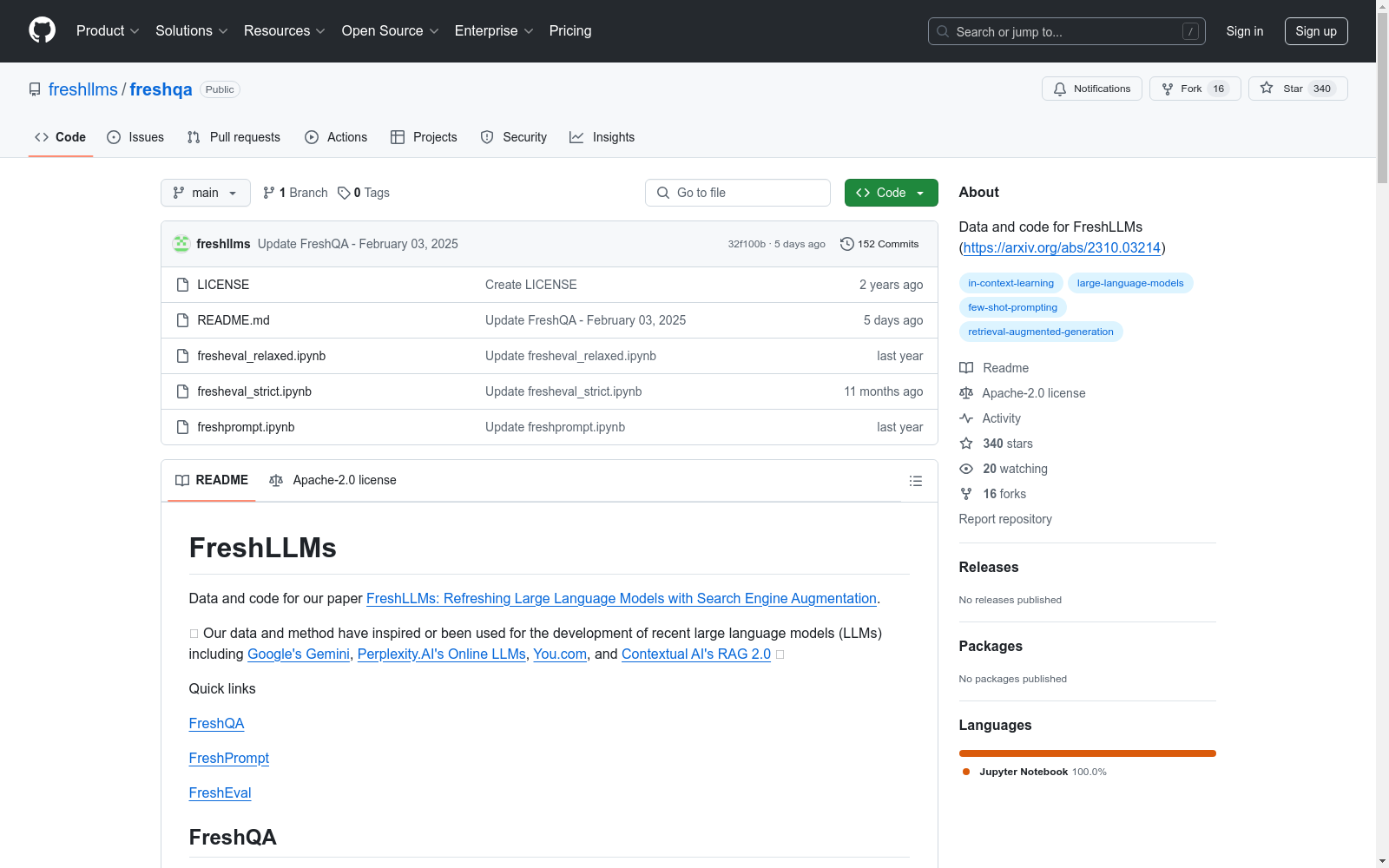

https://github.com/freshllms/freshqa

下载链接

链接失效反馈资源简介:

FreshQA数据集作为一个动态的问答(QA)基准测试,包含600个英语评估样本。针对大型语言模型(LLMs)的问题根据答案的特点被分为四类:答案保持不变、答案逐渐变化、答案快速变化以及答案基于错误前提。这种评估旨在审查LLMs在回答问题时是否会产生幻觉现象,以及它们是否有能力在不被误导的情况下反驳错误的事实假设。

The FreshQA dataset serves as a dynamic question-answering (QA) benchmark, encompassing 600 English evaluation samples. The questions posed to large language models (LLMs) are categorized into four classes based on the characteristics of the answers: answers that remain unchanged, answers that gradually change, answers that rapidly change, and answers based on erroneous premises. This assessment aims to examine whether LLMs produce delusional phenomena in their responses to questions and whether they possess the ability to refute erroneous factual assumptions without being misled.

提供机构:

Google et al.

创建时间:

2023-10-01

原始信息汇总

FreshLLMs数据集概述

数据集基本信息

- 名称: FreshLLMs

- 关联论文: FreshLLMs: Refreshing Large Language Models with Search Engine Augmentation

- 主要用途: 用于增强大型语言模型的搜索引擎数据

数据集组成

1. FreshQA

- 最新版本: FreshQA March 24, 2025

- 更新频率: 每周或根据请求更新

- 反馈渠道: 通过数据集电子表格评论或发送邮件至freshllms@google.com

- 历史版本: 包含2024年2月至2025年3月的多个版本

2. FreshPrompt

- 工具链接: FreshPrompt notebook

3. FreshEval

- 评估方式: 提供Relaxed和Strict两种评估模式

- 评估工具:

- 推荐模型: 建议使用

gpt-4-1106-preview进行自动评估

评估方法

- 人工评估: 推荐使用人工评估检测幻觉等问题

- 自动评估:

- 标准指标: F1/exact match或recall

- LLM自动评估: 如FactScore或FreshEval

致谢

- 感谢多位贡献者对FreshQA问题和答案的更新

- 感谢SerpApi为FreshPrompt用户提供10,000次搜索赞助

引用

bibtex @misc{vu2023freshllms, title={FreshLLMs: Refreshing Large Language Models with Search Engine Augmentation}, author={Tu Vu and Mohit Iyyer and Xuezhi Wang and Noah Constant and Jerry Wei and Jason Wei and Chris Tar and Yun-Hsuan Sung and Denny Zhou and Quoc Le and Thang Luong}, year={2023}, eprint={2310.03214}, archivePrefix={arXiv}, primaryClass={cs.CL} }

搜集汇总

数据集介绍

构建方式

FreshQA数据集的构建依托于搜索引擎增强技术,旨在通过定期更新确保其内容的时效性和准确性。数据集通过每周更新或根据用户请求进行维护,确保问题与答案的实时性。用户可以通过数据集提供的电子表格提交反馈,帮助修正可能的错误或遗漏。这种动态更新机制使得FreshQA能够持续反映最新的知识和信息。

特点

FreshQA数据集的特点在于其高度动态性和广泛的应用场景。数据集不仅涵盖了多样化的问答对,还通过搜索引擎增强技术确保了答案的准确性和时效性。其独特的更新机制使得它能够及时反映最新的知识和信息,适用于多种大型语言模型的开发和评估。此外,数据集的设计还考虑了人类评估与自动评估的结合,提供了灵活的评估方式。

使用方法

使用FreshQA数据集时,用户可以通过访问其GitHub页面获取最新的数据集版本。数据集以电子表格形式提供,用户可以直接下载并使用。对于评估任务,用户可以选择使用`FreshEval`工具进行自动评估,该工具通过少样本学习的方式对模型响应进行评分。用户还可以根据需求调整评估模式(如`Relaxed`或`Strict`),并通过提供的Colab笔记本快速实现评估流程。

背景与挑战

背景概述

FreshQA数据集由Google等机构的研究团队于2023年创建,旨在通过搜索引擎增强大语言模型(LLMs)的实时信息检索与更新能力。该数据集的核心研究问题在于如何有效提升LLMs在动态信息环境中的准确性与时效性,特别是在处理实时更新的事实性问题时。FreshQA的发布不仅推动了LLMs在搜索引擎增强领域的发展,还直接影响了Google的Gemini、Perplexity.AI的在线LLMs等模型的开发,成为相关领域的重要基准。

当前挑战

FreshQA数据集面临的挑战主要分为两个方面。首先,在领域问题层面,如何确保LLMs在动态信息环境中保持高准确性和低幻觉率是一个关键难题,尤其是在处理实时更新的数据时,模型容易产生过时或错误的回答。其次,在数据集构建过程中,如何高效收集、验证和更新海量实时数据,并确保其质量与一致性,也是一个巨大的挑战。此外,数据集的持续更新机制需要依赖用户反馈与人工审核,这对资源与时间的要求极高。

常用场景

经典使用场景

FreshQA数据集在自然语言处理领域中被广泛用于评估和提升大型语言模型(LLMs)的事实性回答能力。通过提供实时更新的问答对,该数据集能够帮助研究人员测试模型在处理最新信息时的表现,尤其是在面对动态变化的知识时。这种场景下,FreshQA成为了验证模型是否能够准确回答基于时间敏感问题的关键工具。

实际应用

在实际应用中,FreshQA数据集被用于优化搜索引擎增强的大型语言模型,如Google的Gemini和Perplexity.AI的在线LLMs。这些模型通过结合FreshQA的实时数据,能够更好地响应用户的查询,尤其是在需要最新信息的场景中,如新闻摘要、金融分析和医疗咨询等领域。

衍生相关工作

FreshQA数据集催生了一系列相关研究工作,包括Google的Gemini、Perplexity.AI的在线LLMs、You.com的API以及Contextual AI的RAG 2.0。这些工作通过利用FreshQA的实时问答数据,进一步提升了模型在动态知识环境中的表现,推动了大型语言模型在搜索增强和事实性验证方面的创新。

以上内容由遇见数据集搜集并总结生成