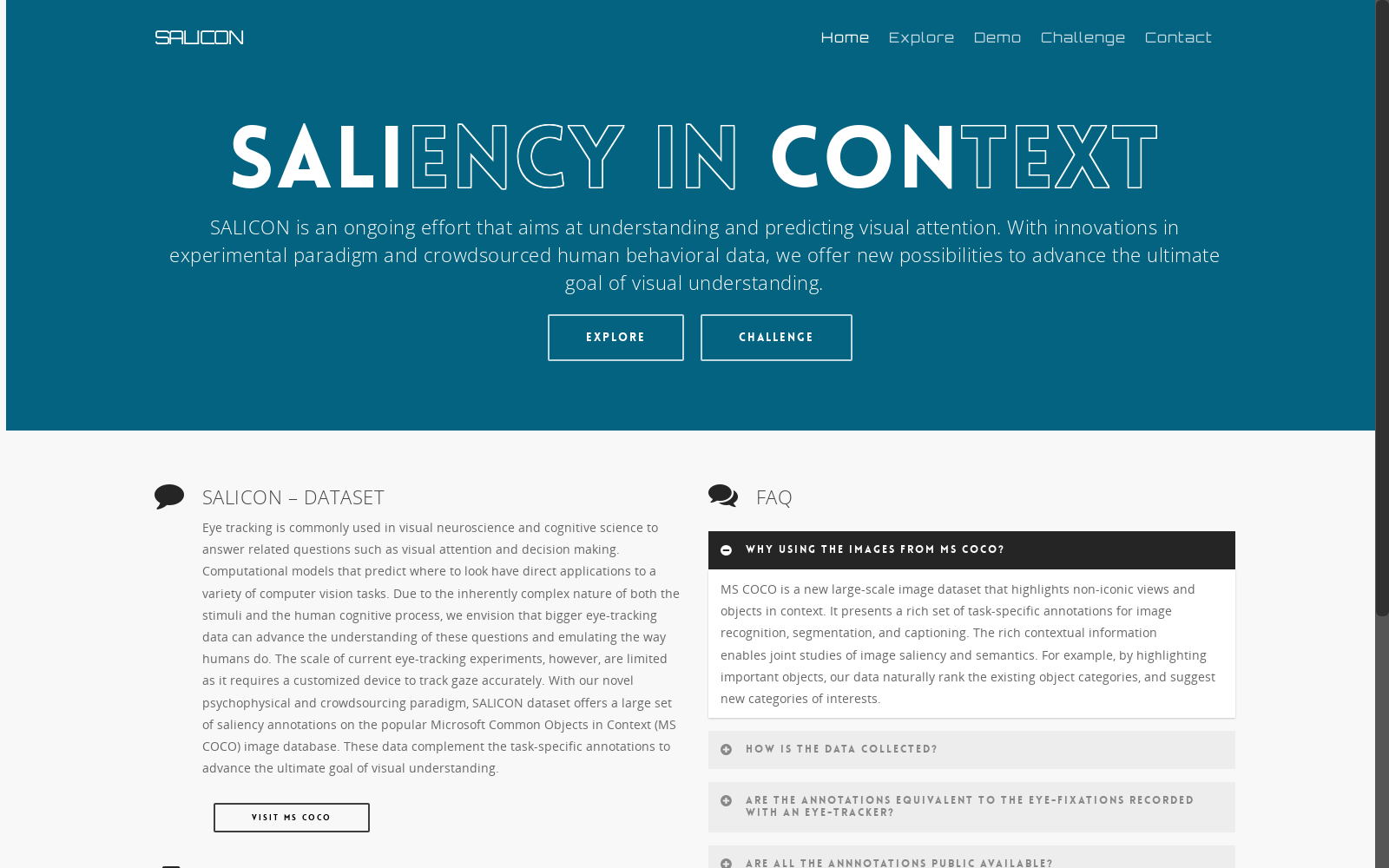

SALICON|视觉注意力数据集|机器学习数据集

收藏

- SALICON数据集首次发表,由Wang等人提出,旨在解决视觉显著性预测问题。

- SALICON数据集被广泛应用于多个视觉显著性预测模型中,成为该领域的重要基准数据集。

- SALICON数据集的扩展版本发布,增加了更多的图像和注视点数据,进一步提升了其在视觉显著性研究中的应用价值。

- SALICON数据集的相关研究成果在多个国际顶级会议上发表,推动了视觉显著性预测技术的发展。

COVID-19 Data Hub

COVID-19 Data Hub是一个全球性的COVID-19数据集,包含了来自多个国家和地区的疫情数据,涵盖了病例数、死亡数、康复数、测试数等信息。此外,数据集还包括了与疫情相关的经济、社会和政策数据。

covid19datahub.io 收录

RAVDESS

情感语音和歌曲 (RAVDESS) 的Ryerson视听数据库包含7,356个文件 (总大小: 24.8 GB)。该数据库包含24位专业演员 (12位女性,12位男性),以中性的北美口音发声两个词汇匹配的陈述。言语包括平静、快乐、悲伤、愤怒、恐惧、惊讶和厌恶的表情,歌曲则包含平静、快乐、悲伤、愤怒和恐惧的情绪。每个表达都是在两个情绪强度水平 (正常,强烈) 下产生的,另外还有一个中性表达。所有条件都有三种模态格式: 纯音频 (16位,48kHz .wav),音频-视频 (720p H.264,AAC 48kHz,.mp4) 和仅视频 (无声音)。注意,Actor_18没有歌曲文件。

OpenDataLab 收录

FAOSTAT Agricultural Data

FAOSTAT Agricultural Data 是由联合国粮食及农业组织(FAO)提供的全球农业数据集。该数据集涵盖了农业生产、贸易、价格、土地利用、水资源、气候变化、人口统计等多个方面的详细信息。数据包括了全球各个国家和地区的农业统计数据,旨在为政策制定者、研究人员和公众提供全面的农业信息。

www.fao.org 收录

CHARLS

中国健康与养老追踪调查(CHARLS)数据集,旨在收集反映中国45岁及以上中老年人家庭和个人的高质量微观数据,用以分析人口老龄化问题,内容包括健康状况、经济状况、家庭结构和社会支持等。

charls.pku.edu.cn 收录

CMACD

这是一个基于社交媒体用户的多标签中文情感计算数据集,整合了用户的性格特质与六种情感及微情感,每种情感都标注了强度级别。数据集旨在推进机器对复杂人类情感的识别,并为心理学、教育、市场营销、金融和政治等领域的研究提供数据支持。

github 收录