GAOKAO-Bench

收藏arXiv2024-02-24 更新2024-06-21 收录

下载链接:

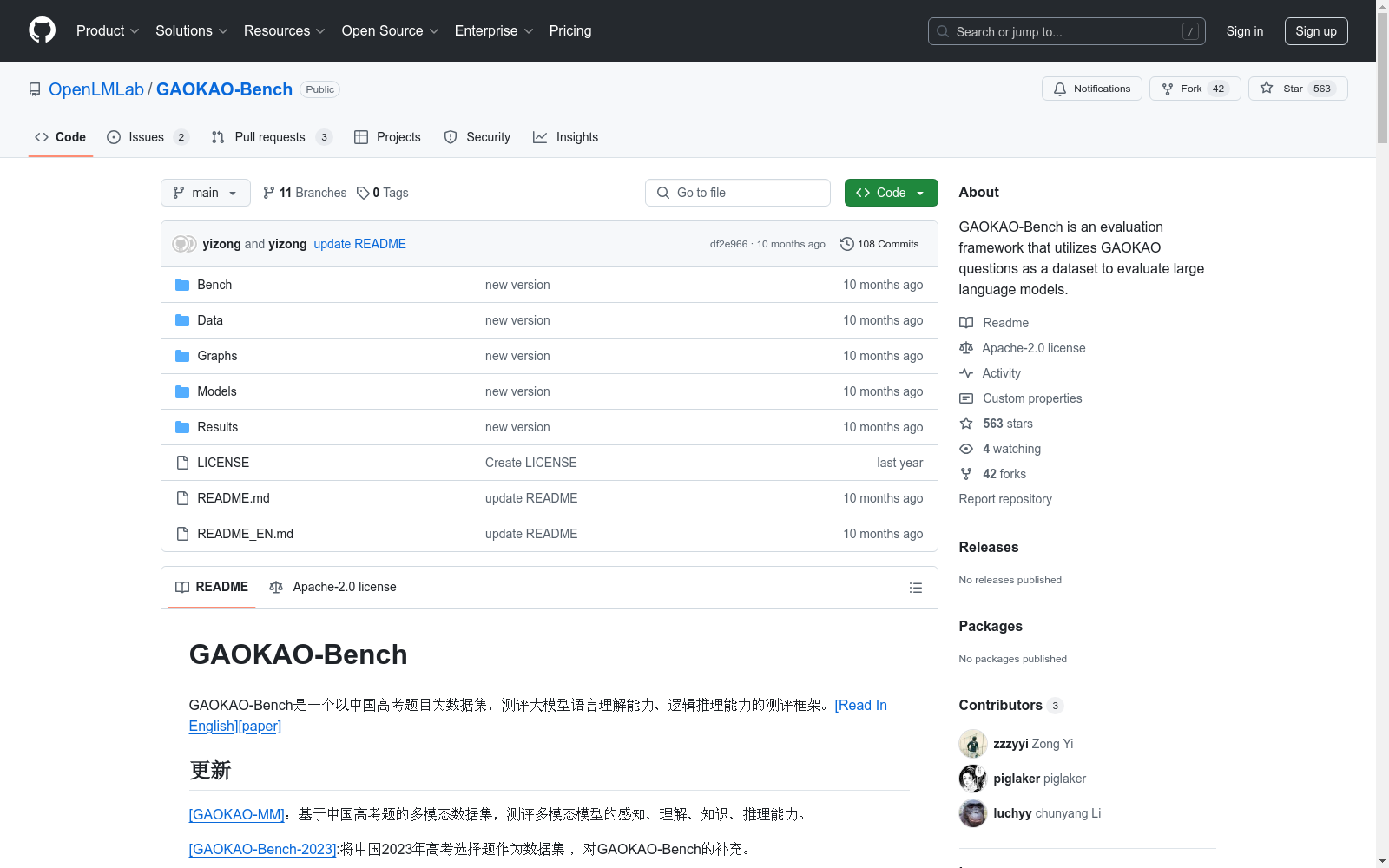

https://github.com/OpenLMLab/GAOKAO-Bench

下载链接

链接失效反馈资源简介:

GAOKAO-Bench是由复旦大学计算机科学与技术学院创建的数据集,涵盖了2010至2022年间中国高考的所有科目题目,共计2811题。该数据集包含1781道客观题和1030道主观题,题型多样,包括单选、填空、改错、开放性问题等。数据集通过自动化脚本和人工标注将PDF格式的题目转换为JSON文件,数学公式则转换为LATEX格式。GAOKAO-Bench旨在为大型语言模型提供一个全面且贴近实际应用的评估基准,特别是在解决中国高考相关问题上的表现。

GAOKAO-Bench is a dataset created by the School of Computer Science and Technology at Fudan University, encompassing all subjects' questions from the Chinese Gaokao examination from 2010 to 2022, totaling 2811 questions. The dataset includes 1781 objective questions and 1030 subjective questions, featuring a variety of question types such as single-choice, fill-in-the-blanks, error correction, and open-ended questions. The questions in PDF format were converted to JSON files using automated scripts and manual annotation, with mathematical formulas converted to LATEX format. GAOKAO-Bench is designed to provide a comprehensive and practical assessment benchmark for large language models, particularly in their performance on addressing questions related to the Chinese Gaokao.

提供机构:

复旦大学计算机科学与技术学院

创建时间:

2023-05-21

搜集汇总

数据集介绍

构建方式

GAOKAO-Bench数据集的构建基于中国高考(GAOKAO)的试题,涵盖了从2010年至2022年的所有科目。通过自动化脚本和人工注释相结合的方式,将PDF格式的试题转换为JSON文件格式,并确保数学公式以LATEX格式呈现。数据集包括主观题和客观题,共计2811道题目,其中1030道为主观题,1781道为客观题。

特点

GAOKAO-Bench数据集的特点在于其全面性和直观性,涵盖了高考中的多种题型,包括单选题、填空题、改错题和开放性问题等。此外,数据集采用了零样本设置的方法来评估大型语言模型(LLMs)的性能,确保评估方法与人类考试方式相一致。

使用方法

GAOKAO-Bench数据集可用于评估大型语言模型在高考题型上的表现,包括客观题和主观题。使用者可以通过提供的JSON格式数据进行模型训练和测试,利用零样本设置策略来模拟人类考试环境。此外,数据集还提供了人工注释的评分标准,可用于进一步验证模型的评分一致性。

背景与挑战

背景概述

GAOKAO-Bench数据集是由复旦大学和华东师范大学联合开发,旨在评估大型语言模型(LLMs)在中国高考(GAOKAO)中的表现。该数据集创建于2023年,主要研究人员包括Xiaotian Zhang、Chunyang Li和Xipeng Qiu等。其核心研究问题是全面且准确地评估LLMs在处理中国高考题目中的能力,特别是主观题和客观题的表现。GAOKAO-Bench的推出填补了现有评估基准中缺乏主观题的空白,为未来LLMs的评估提供了强有力的工具,并对教育评估领域产生了深远影响。

当前挑战

GAOKAO-Bench数据集面临的挑战包括:1) 如何有效评估LLMs在复杂主观题上的表现,这需要高度的语义理解和推理能力;2) 数据集构建过程中,如何确保题目的高质量和多样性,以及如何处理从PDF格式转换为JSON格式时可能出现的技术问题。此外,由于高考题目的高度保密性,获取和处理这些数据也带来了法律和伦理上的挑战。

常用场景

经典使用场景

GAOKAO-Bench数据集的经典使用场景在于评估大型语言模型(LLMs)在高考题目上的表现。通过包含主观和客观题目的综合测试,该数据集能够全面评估LLMs在知识掌握、逻辑推理和写作能力等方面的表现。

衍生相关工作

GAOKAO-Bench数据集的推出催生了多项相关研究工作,包括对LLMs在不同学科表现差异的深入分析、LLMs作为主观题目评分工具的可行性研究等。这些研究为进一步优化和扩展LLMs的应用提供了宝贵的数据支持。

数据集最近研究

最新研究方向

近年来,GAOKAO-Bench数据集在评估大型语言模型(LLMs)的性能方面取得了显著进展。该数据集利用中国高考题目作为测试样本,涵盖了主观和客观问题,旨在全面准确地评估LLMs的表现。研究者们设计了基于零样本设置的方法,以模拟人类考试方式,并通过人工评分获得LLMs的总分。研究发现,LLMs在中国高考中取得了竞争性分数,但在不同科目间存在显著的性能差异。此外,LLMs在主观题评分上与人类评分具有中等程度的一致性。这一研究为未来大型语言模型的评估提供了坚实的基准,并揭示了这些模型的优势与局限性。

相关研究论文

- 1Evaluating the Performance of Large Language Models on GAOKAO Benchmark复旦大学计算机科学与技术学院 · 2024年

以上内容由遇见数据集搜集并总结生成