LMentry

收藏arXiv2022-12-19 更新2024-06-21 收录

下载链接:

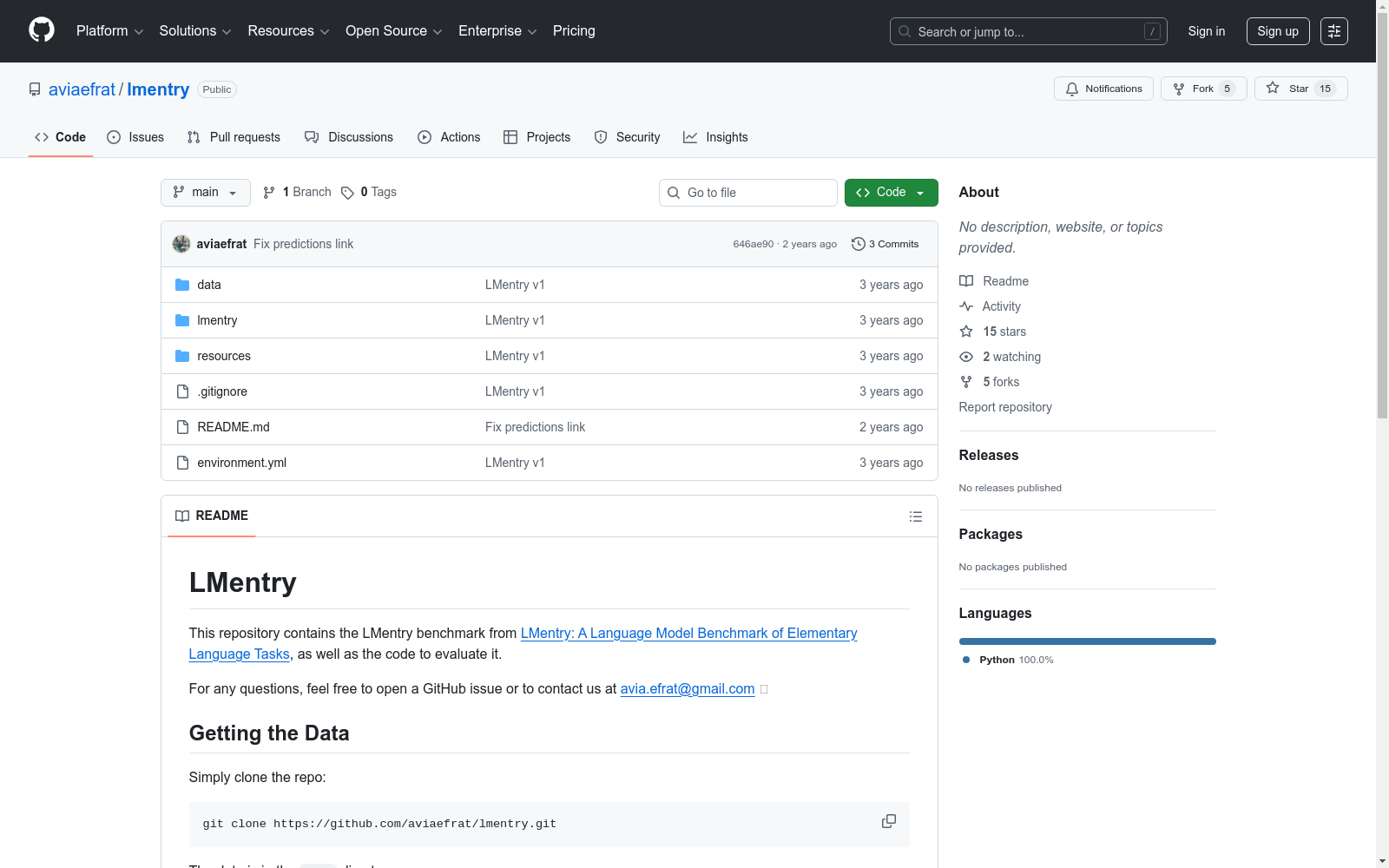

https://github.com/aviaefrat/lmentry

下载链接

链接失效反馈资源简介:

LMentry是一个专为大型语言模型设计的基准测试数据集,由特拉维夫大学创建。该数据集包含25个简单的语言任务,旨在快速评估模型的能力和鲁棒性。这些任务对人类来说非常简单,如包含特定单词的句子写作或识别列表中属于特定类别的单词。数据集创建过程中,每个任务都遵循了特定的指导原则,确保任务的简单性和可解释性。LMentry的应用领域主要集中在零样本评估,旨在解决大型语言模型在简单任务上的表现问题,以及对输入扰动的鲁棒性测试。

提供机构:

特拉维夫大学

创建时间:

2022-11-04

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,评估大型语言模型的基础能力需要精心设计的基准测试。LMentry数据集的构建遵循一套严谨的指导原则,旨在创建对人类而言极其简单、但对模型具有挑战性的任务。该数据集包含25个核心任务,每个任务均设计为可由小学生轻松解决,例如撰写包含特定词汇的句子或判断两个单词的长短。为确保任务的多样性和评估的稳健性,每个任务都配备了三种不同的提示模板,并通过参数实例化生成了总计超过11万个测试样本。数据集的构建过程强调自动评估的可行性,所有任务均支持通过正则表达式模式进行快速、准确的评分,从而为模型能力的诊断提供了高效且可复现的测试环境。

特点

LMentry数据集的核心特点在于其专注于评估语言模型的基础语言能力与稳健性。该数据集避开了当前基准测试日益复杂的“军备竞赛”,转而采用一系列对人类而言微不足道的任务,从而能够清晰、可解释地揭示模型在基本语言理解上的缺陷。数据集不仅测量模型的准确率,还系统性地评估其对输入扰动的稳健性,包括参数顺序、参数内容、提示模板及相邻任务差异等四个维度。通过引入LMentry综合分数——即准确率与稳健性的乘积,该数据集提供了一个单一且全面的性能指标。其任务设计高度多样化,涵盖生成与判别形式,且所有任务均支持零样本评估,无需任何任务特定的训练或调整。

使用方法

LMentry数据集主要用于零样本评估大型语言模型的基础能力与稳健性。研究人员可通过官方发布的评估套件,将模型的生成输出与数据集提供的正则表达式模式进行匹配,从而自动计算任务准确率及各项稳健性指标。使用时应遵循数据集的零样本设定,即直接向模型提供单个任务提示,无需提供示例或进行微调。评估过程支持贪婪解码等标准生成策略,并建议对生成长度进行适当限制。数据集内置的规范字符串有助于识别训练数据中是否混入了LMentry样本,确保评估结果的纯净性。该数据集可作为大型复杂基准的补充,为模型提供快速、自动化的“单元测试”,尤其适合资源有限的研究团队进行模型能力的初步诊断与深入分析。

背景与挑战

背景概述

LMentry数据集由特拉维夫大学与Meta AI的研究团队于2022年联合推出,旨在为大型语言模型提供一种简洁而高效的评估基准。该数据集聚焦于人类能够轻松完成的基础语言任务,例如包含特定词汇的句子生成、词汇类别识别以及简单比较等。其核心研究问题在于揭示大型语言模型在看似简单的语言理解与生成任务中的实际能力与鲁棒性,弥补了传统复杂基准测试在可解释性与可访问性方面的不足。LMentry通过零样本评估方式,为模型性能提供了快速且自动化的“单元测试”,对推动语言模型评估方法的多元化发展具有重要影响。

当前挑战

LMentry所解决的领域问题在于评估大型语言模型在基础语言任务上的能力与鲁棒性,其核心挑战在于模型对这些人类认为琐碎的任务表现出的显著脆弱性。例如,即使在参数规模达1750亿的指令微调模型中,LMentry得分最高仅为66.1%,远低于人类接近完美的表现。具体挑战包括模型对输入顺序的敏感性,如答案在选项中的位置变化会导致准确性大幅波动;对模板表述的依赖性,轻微的语言调整可能引发性能显著下降;以及对任务细微差异的应对不足,例如正反义任务之间出现超过30个百分点的准确性差距。在构建过程中,研究团队面临确保任务既足够简单又具备评估价值的平衡挑战,同时需设计自动评估机制以处理开放生成答案的多样性,并维护数据集的严谨性与可复现性。

常用场景

经典使用场景

在大型语言模型评估领域,LMentry 作为一项基础语言能力基准测试,其经典使用场景在于对模型进行零样本评估。该数据集通过设计25项对人类而言极其简单的语言任务,如判断词语长度、识别类别归属或构造包含特定词汇的句子,为研究者提供了一种快速、自动化的“单元测试”工具。这种评估方式能够直观揭示模型在基础语言理解与生成方面的能力边界,尤其适用于在模型部署前对其核心语言技能进行系统性检验。

衍生相关工作

LMentry 的提出激发了后续研究对基础能力评估的重视,其设计理念影响了多个衍生工作的发展方向。例如,后续研究开始关注模型在算术推理、逻辑一致性等基础认知任务上的表现,形成了“模型能力诊断”这一新兴研究方向。同时,该数据集揭示的指令微调有效性现象,进一步推动了高效模型优化方法的研究。其采用的鲁棒性量化框架也被扩展应用于其他评估场景,促进了评估方法学从单一精度指标向多维度综合评估的演进。

数据集最近研究

最新研究方向

在大型语言模型评估领域,LMentry数据集以其聚焦基础语言能力的独特定位,成为当前研究的前沿热点。该数据集通过设计25项对人类而言极其简单的语言任务,如判断单词长度、识别类别归属等,旨在揭示模型在基本语言理解与鲁棒性方面的深层缺陷。最新研究表明,即使如TextDavinci002等千亿参数规模的指令微调模型,在LMentry上的表现仍显著低于人类水平,其综合得分仅为66.1%,暴露出模型对输入顺序、内容细微变化及模板表述的高度敏感性。这一发现挑战了传统评估中“模型规模扩大即性能提升”的线性假设,凸显了指令微调在提升基础语言能力方面可能比单纯扩大规模更为有效。LMentry的推出促使学界重新审视模型评估范式,推动研究从复杂任务竞赛转向对模型基础认知能力的系统性诊断,为构建更稳健、可解释的大型语言模型提供了关键基准。

相关研究论文

- 1LMentry: A Language Model Benchmark of Elementary Language Tasks特拉维夫大学 · 2022年

以上内容由遇见数据集搜集并总结生成